Clear Sky Science · es

YOLO-MFD: un marco de características multiescala y head dinámico para la detección subacuática de objetos en litorales prefabricados

Ojos más inteligentes bajo los litorales urbanos

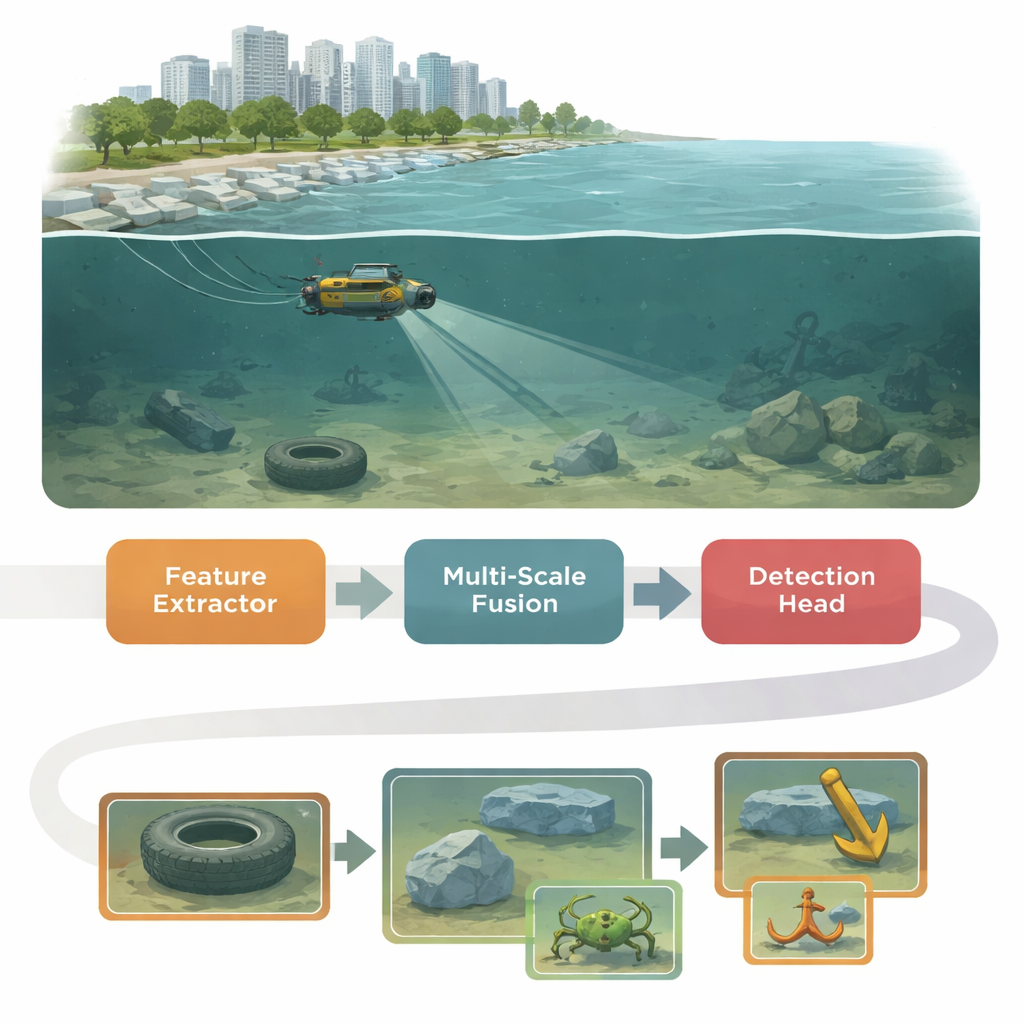

A medida que las ciudades construyen más muros, muelles y escolleras prefabricadas a lo largo de ríos y lagos, gran parte de la infraestructura crítica queda oculta bajo el agua. Comprobar si estos bloques son estables, están agrietados o están llenos de escombros es difícil, especialmente en aguas turbias y someras donde la visibilidad es pobre. Este artículo presenta YOLO-MFD, un nuevo sistema de visión por computador que ayuda a los robots submarinos a detectar objetos pequeños y tenues a lo largo de los litorales de forma más fiable y rápida, incluso cuando el agua está turbia y la escena está concurrida.

Por qué las imágenes subacuáticas son tan difíciles de interpretar

Los ríos, lagos y aguas litorales urbanas rara vez están cristalinos. La luz es absorbida y dispersada, los colores se desplazan hacia el verde o el azul y las partículas en suspensión difuminan los contornos. Pequeños organismos, residuos marinos o defectos en bloques prefabricados pueden ser diminutos, de bajo contraste y densamente agrupados. Los sistemas estándar de detección de objetos, diseñados originalmente para escenas urbanas despejadas, tienden a perder estos blancos o confundirlos con el ruido de fondo. Al mismo tiempo, los robots de inspección y los dispositivos integrados usados cerca de los litorales tienen potencia de cálculo limitada, por lo que cualquier solución debe ser tanto precisa como eficiente.

Un cerebro en tres partes para aguas turbias

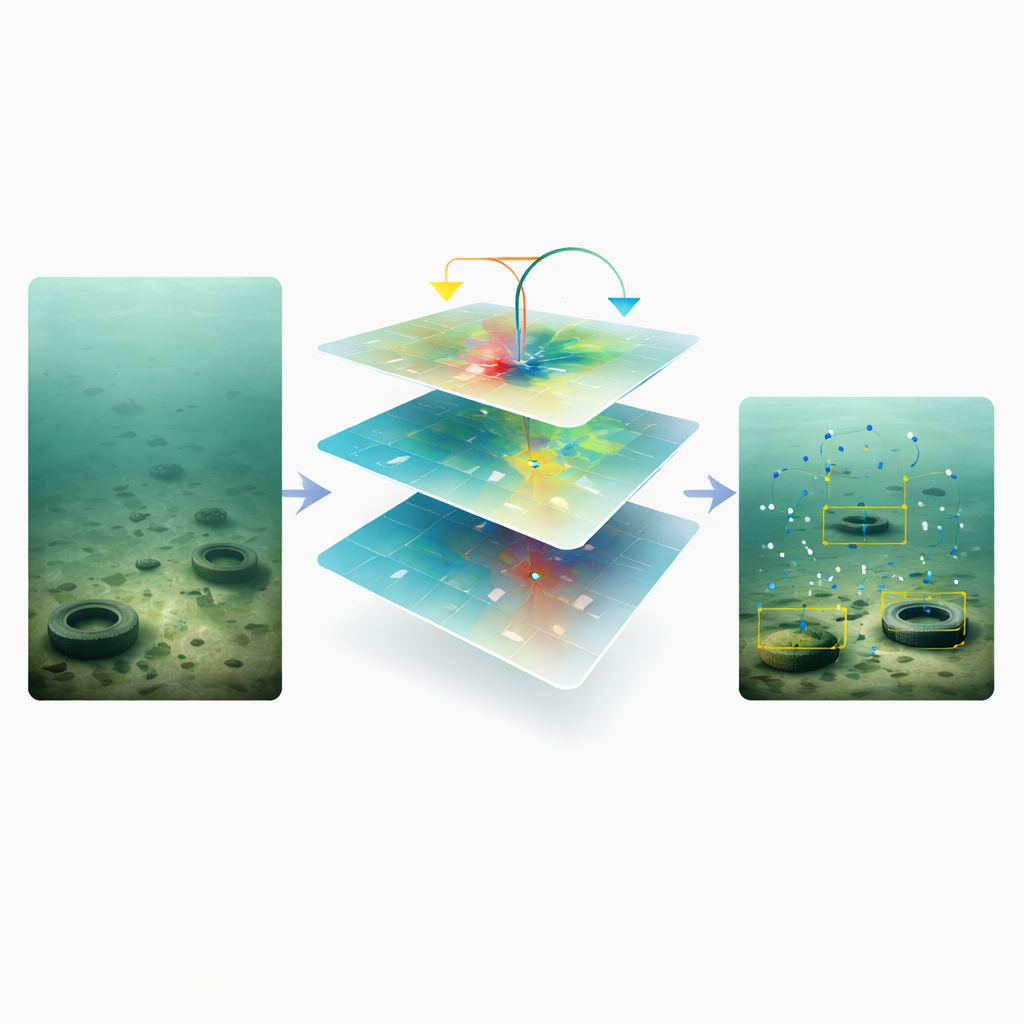

YOLO-MFD se basa en la popular familia YOLO de detectores en tiempo real, pero remodela su “cerebro” interno en tres etapas coordinadas. Primero, un nuevo backbone llamado CUMANet (Cross-scale Unified Multi-scale Attention Network) aprende a extraer características de las imágenes prestando atención al contexto amplio. Usa ramas paralelas y una convolución especializada que se comporta como un módulo de múltiples ramas durante el entrenamiento, pero se simplifica a una única operación eficiente en el despliegue. Esto ayuda a la red a mirar más allá del ruido local, capturar pistas de largo alcance y conservar detalles importantes que podrían perderse por la turbidez y la distorsión de color.

Seguimiento de pistas diminutas a distintas escalas

La segunda etapa, Adaptive Feature Modulation (AFM), aborda una debilidad común en los sistemas de visión: al combinar información de resoluciones gruesas y finas, los detalles a pequeña escala a menudo se apagan. AFM reúne dos mapas de características alineando primero sus tamaños y canales, y luego calculando compuertas suaves e independientes para cada rama. En lugar de forzar que una escala domine, AFM permite que ambas contribuyan siempre que aporten señales útiles, y añade un atajo residual para evitar perder patrones débiles pero importantes. Esta fusión multiescala equilibrada es especialmente útil para detectar pepinos de mar pequeños, estrellas de mar o grietas en el hormigón que apenas se distinguen del fondo.

Un decisor final más flexible

La etapa final, DPNDyHead (Dual-Pooling and Normalized Dynamic Head), refina las características justo antes de que el sistema decida qué y dónde están los objetos. Toma prestada la idea de las convoluciones deformables, que desplazan sus puntos de muestreo para seguir mejor formas difuminadas o distorsionadas bajo el agua. Para manejar objetos de tamaños muy diferentes, DPNDyHead usa tanto pooling medio como pooling máximo a través de escalas, mezclando contexto global con respuestas locales nítidas como bordes o texturas. Un paso de normalización estabiliza las estadísticas de las características antes de generar activaciones específicas por tarea, reduciendo el impacto de los cambios de color y la iluminación desigual. En conjunto, estos recursos ayudan a alinear la confianza de la clasificación (qué es el objeto) con la precisión de la localización (dónde está).

¿Qué tan bien funciona en el mundo real?

Los autores probaron YOLO-MFD en dos conjuntos de datos subacuáticos públicos procedentes de acuicultura y granjas marinas abiertas, que incluyen muchos objetivos pequeños y agrupados y una fuerte degradación de imagen. En DUO y UDD, el nuevo marco superó a detectores clásicos de dos etapas, métodos sin anclas, modelos modernos basados en Transformers y variantes recientes de YOLO. Logró una mayor media de Precisión Promedio (mAP) y recall—lo que significa que tanto encontró más objetos verdaderos como cometió menos errores—mientras empleaba solo unos pocos millones de parámetros y un consumo de cálculo moderado. Experimentos detallados mostraron que cada uno de los tres módulos (CUMANet, AFM y DPNDyHead) aportó ganancias medibles, y su combinación produjo el mejor equilibrio global entre precisión, robustez y velocidad.

Visión más clara para litorales más seguros

En términos prácticos, este trabajo ofrece a los robots submarinos y a los sistemas de monitorización una vista más nítida y fiable de lo que hay a lo largo de los litorales urbanos y las riberas prefabricadas. Al diseñar un detector de objetos que contrarresta explícitamente el agua turbia, el desequilibrio de escalas y las predicciones desalineadas, los autores proporcionan una herramienta que puede seguir mejor la salud de la infraestructura, apoyar estudios ecológicos y guiar la gestión inteligente de estructuras litorales prefabricadas. A medida que trabajos futuros exploren entornos más amplios y versiones aún más ligeras del modelo, métodos como YOLO-MFD podrían convertirse en parte clave de la inspección subacuática rutinaria, ayudando a mantener más seguros y mejor mantenidos a los litorales urbanos y las vías fluviales interiores.

Cita: Gang, Y., Li, T., Li, S. et al. YOLO-MFD: a multi-scale feature and dynamic head framework for prefabricated shoreline underwater object detection. Sci Rep 16, 10971 (2026). https://doi.org/10.1038/s41598-026-45591-1

Palabras clave: detección de objetos subacuáticos, infraestructura litoral, visión por computador, vehículos submarinos autónomos, aprendizaje profundo