Clear Sky Science · nl

Adaptieve robotbegeleiding via realtime compliantie-schatting en dual-mode besturing

Robots leren betere hulpverleners te zijn

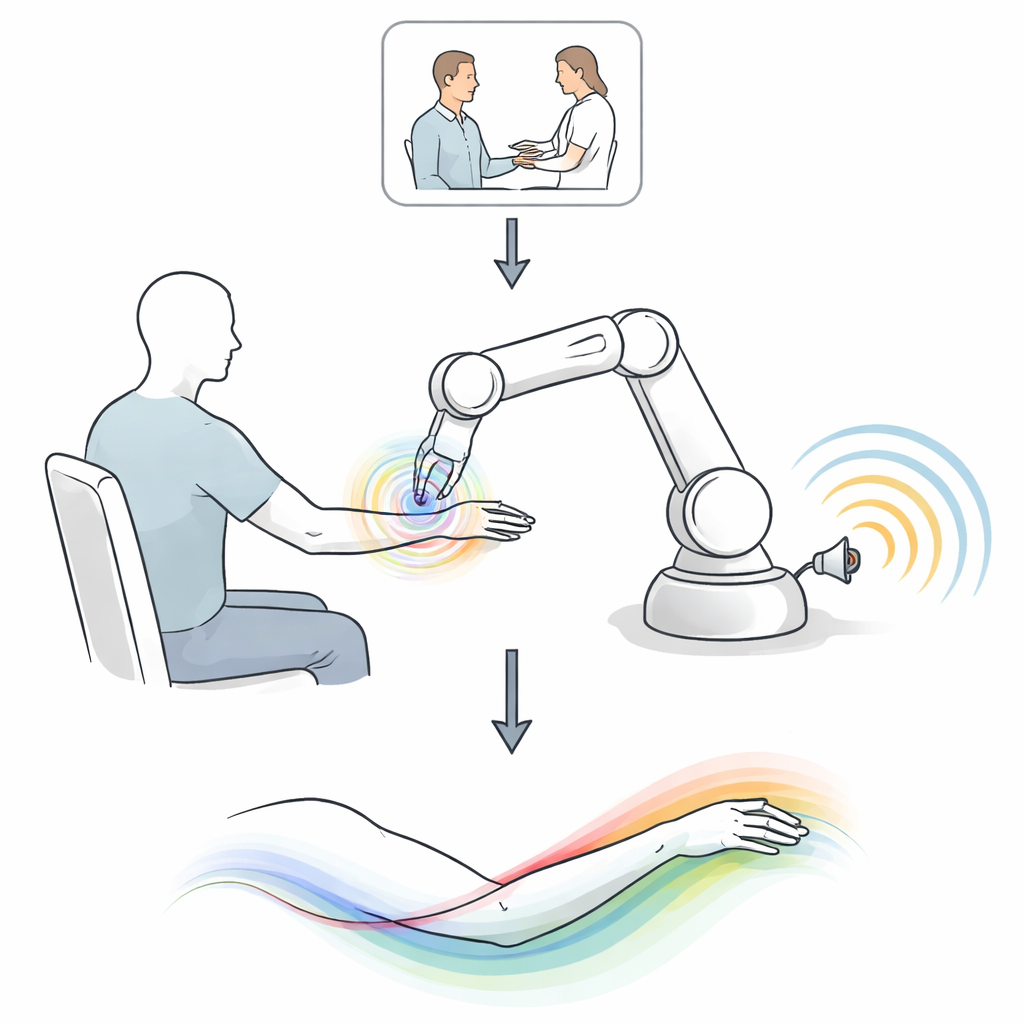

Stel je voor dat je een nieuwe dansbeweging leert of je schouder revalideert. Een menselijke instructeur duwt je arm niet alleen in positie; die geeft ook stapsgewijze aanwijzingen en aanmoediging. Hedendaagse robots bewegen je daarentegen meestal stilletjes of ze praten zonder aan te kunnen raken. Dit artikel introduceert een nieuwe manier waarop robots aanraking en spraak kunnen mengen en zich in realtime aanpassen aan hoe goed iemand volgt, zodat de hulp veiliger, natuurlijker en effectiever aanvoelt.

Waarom aanraking en stem combineren er toe doet

Menselijke docenten passen voortdurend aan hoeveel ze je fysiek sturen versus hoeveel ze praten. Als je uit de pas loopt, kunnen ze je arm stevig verplaatsen en duidelijke aanwijzingen geven. Naarmate je beter wordt, doen ze minder en bieden ze lichtere begeleiding en meer aanmoediging. Robots hebben moeite gehad dit te doen omdat fysieke krachten en gesproken taal heel verschillende soorten signalen zijn. De auteurs wilden de robot iets geven dat lijkt op de intuïtie van een instructeur: een manier om in te schatten hoe bereid en bekwaam iemand is om begeleiding te volgen, en vervolgens te beslissen wanneer te duwen, wanneer te praten en hoe beide te combineren.

Hoe de adaptieve robotcoach werkt

Het team ontwierp een Robot Guidance Controller met drie hoofdonderdelen. Ten eerste schat deze continu de “compliantie” — hoe nauwkeurig iemand de gewenste beweging volgt — met eenvoudige maatstaven zoals de afstand tussen waar de arm zou moeten zijn en waar hij is, en hoe vloeiend de beweging verloopt. Ten tweede bepaalt een optimalisatiestap hoeveel van de correctie door fysieke kracht moet komen versus gesproken aanwijzingen, waarbij de balans verschuift naarmate het gedrag van de persoon verandert. Ten derde zet een kracht-naar-taalmodel de interne plannen van de robot om in korte, contextpassende zinnen, zoals zachte tips of aanmoedigingen, gebaseerd op patronen geleerd van menselijke therapeuten. Samen stellen deze elementen de robot in staat zijn handen en zijn “stem” in realtime te coördineren.

Leren van ervaren therapeuten

Om het systeem te verankeren in realistisch lesgedrag bestudeerden de onderzoekers fysiotherapeuten die met patiënten werkten aan een eenvoudige maar klinisch belangrijke taak: de arm van langs de zijkant omhoog naar boven en terug tillen. In zorgvuldig opgenomen sessies gaven therapeuten soms alleen verbale begeleiding, soms alleen aanraking, en soms beide. Het team vond duidelijke patronen. Wanneer patiënten weerstand boden of moeite hadden, gebruikten therapeuten sterkere fysieke hulp en vaker instructieve spraak. Naarmate patiënten nauwkeuriger volgden, lieten therapeuten hun greep losser, spraken ze minder vaak en schakelden ze van bevelen naar aanmoediging. Deze patronen waren directe inspiratie voor hoe de robot compliantie inschat en besluit wanneer hij meer op kracht, spraak of een mix moet vertrouwen.

De robotcoach op de proef stellen

De nieuwe controller werd geëvalueerd met twaalf gezonde vrijwilligers die dezelfde schouderhef-oefening uitvoerden samen met een collaboratieve robot. In één reeks proeven vergeleken de onderzoekers enkelvoudige hulpmodi — alleen verbale aanwijzingen, alleen fysieke krachten — met een basis dual-mode controller die ze altijd op een vaste manier combineerde. In een tweede studie vergeleken ze die vaste dual-mode configuratie met hun adaptieve Robot Guidance Controller. De prestaties werden gemeten aan de hand van hoe nauwkeurig deelnemers het bedoelde pad volgden, hoe vloeiend hun bewegingen waren, hoe lang ze erover deden en hoe de spraakpatronen van de robot veranderden.

Wat de experimenten onthulden

Over de condities heen bleek het combineren van aanraking en spraak over het algemeen beter te werken dan het gebruik van slechts één van beide, vooral wanneer het nieuw toegevoegde kanaal het enige was waarop de persoon daadwerkelijk lette. In sommige gevallen verminderde het toevoegen van fysieke begeleiding de positiemissers meer dan de helft en maakte de bewegingen aanzienlijk vloeiender en sneller. De adaptieve controller ging nog verder: hij snoeide trackingfouten tot wel 50% weg, verbeterde de vloeiendheid en verkortte de voltooiingstijd met ongeveer een kwart vergeleken met de vaste dual-mode referentie. Opvallend was dat zijn spraakpatronen — hoe vaak hij “sprak” en hoeveel hij overschakelde van instructies naar aanmoediging — nauwer overeenkwamen met die van ervaren therapeuten, en deelnemers beoordeelden de adaptieve begeleiding als natuurlijker en meer als samenwerken met een menselijke coach.

Wat dit kan betekenen voor het dagelijks leven

Voor niet-experts is de les dat robots geleerd kunnen worden mensen te begeleiden zoals bekwame menselijke instructeurs: met een mix van zachte aanraking en tijdige woorden die zich aanpast terwijl je leert. Hoewel dit werk is aangetoond in een revalidatieoefening, zouden de onderliggende ideeën kunnen worden uitgebreid naar het aanleren van handschrift, sportvaardigheden of complexe werktaken. Door te voelen hoe goed iemand reageert en fysieke en verbale hulp in één keer aan te passen, kunnen toekomstige robots niet alleen precieze machines worden, maar geduldige, responsieve partners in leren en herstel.

Bronvermelding: Tejwani, R., Payne, J., Velazquez, K. et al. Adaptive robot guidance through real-time compliance estimation and dual-modal control. Commun Eng 5, 81 (2026). https://doi.org/10.1038/s44172-026-00632-5

Trefwoorden: mens-robot interactie, rehabilitatie-robotica, adaptieve begeleiding, robotische coaching, multimodale besturing