Clear Sky Science · de

Adaptive Roboterführung durch Echtzeit-Steifigkeitsabschätzung und dualmodale Steuerung

Roboter lehren, bessere Helfer zu sein

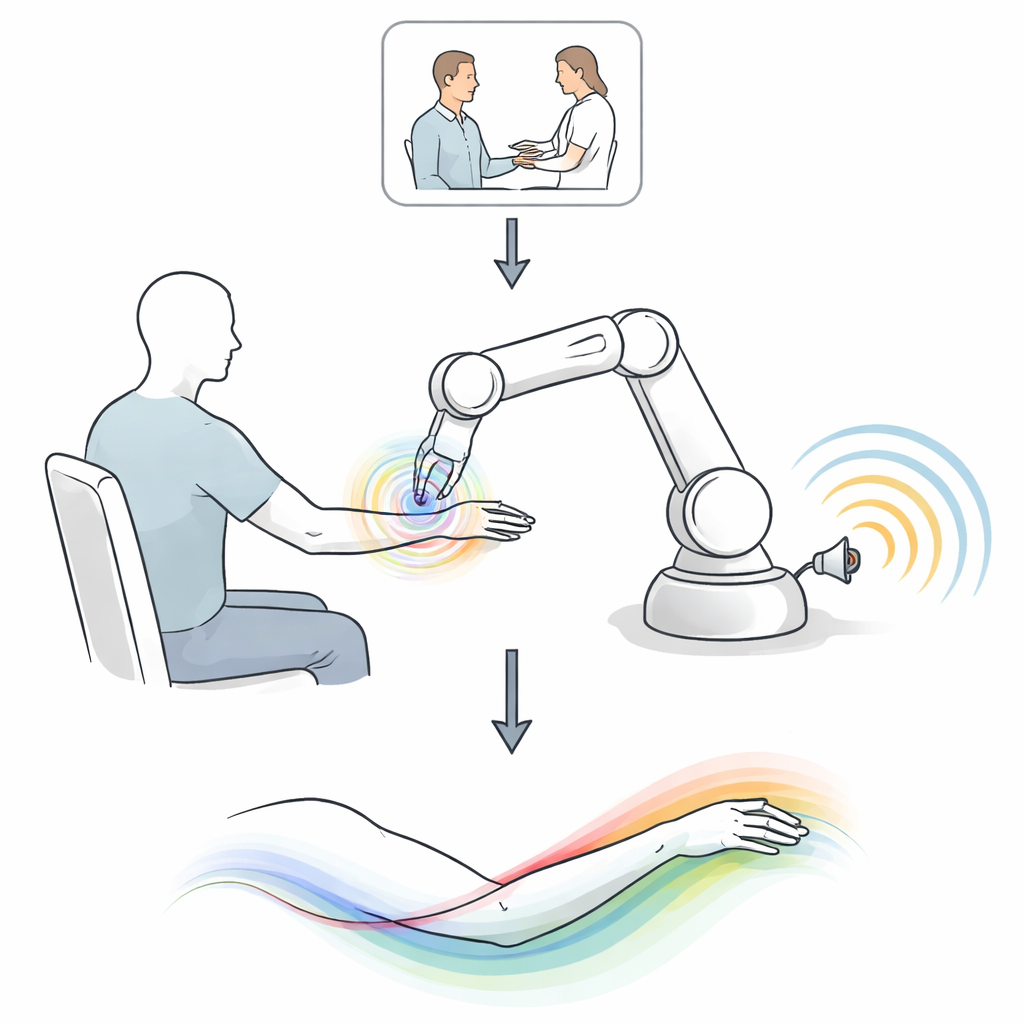

Stellen Sie sich vor, Sie lernen eine neue Tanzbewegung oder rehabilitieren eine schmerzende Schulter. Ein menschlicher Lehrer schiebt Ihren Arm nicht einfach nur an die richtige Stelle; er gibt auch Schritt-für-Schritt-Tipps und Ermutigung. Heutige Roboter bewegen einen im Gegensatz dazu meist lautlos oder sprechen, ohne berühren zu können. Dieses Papier stellt eine neue Methode vor, mit der Roboter Berührung und Sprache verbinden und sich in Echtzeit anpassen können, wie gut eine Person den Anweisungen folgt, sodass die Hilfe sicherer, natürlicher und wirksamer wirkt.

Warum die Kombination aus Berührung und Stimme wichtig ist

Menschen passen ständig an, wie stark sie physisch leiten und wie viel sie sprechen. Wenn Sie danebenliegen, könnten sie Ihren Arm kräftig führen und klare Anweisungen geben. Je besser Sie werden, desto weniger eingreifend werden sie, bieten leichtere Führung und mehr Ermutigung. Roboter hatten damit Schwierigkeiten, weil physische Kräfte und gesprochene Sprache sehr unterschiedliche Signale sind. Die Autoren wollten einem Roboter etwas wie die Intuition eines Lehrers geben: eine Methode, abzuschätzen, wie bereit und fähig eine Person ist, Anweisungen zu folgen, und dann zu entscheiden, wann er schieben, wann er sprechen und wie er beides kombinieren sollte.

Wie der adaptive Robotercoach funktioniert

Das Team entwarf einen Robot Guidance Controller mit drei Hauptkomponenten. Erstens schätzt er kontinuierlich die „Compliance“ — wie genau eine Person der gewünschten Bewegung folgt — mithilfe einfacher Messgrößen wie dem Abstand zwischen Soll- und Ist-Position des Arms und der Geschmeidigkeit der Bewegung. Zweitens entscheidet ein Optimierungsschritt, wie viel der Korrektur durch physische Kraft versus gesprochene Hinweise erfolgen soll und verschiebt das Verhältnis, wenn sich das Verhalten der Person ändert. Drittens wandelt ein Kraft-zu-Sprache-Modell die internen Pläne des Roboters in kurze, kontextgerechte Phrasen um, etwa sanfte Hinweise oder Ermutigungen, basierend auf Mustern, die von echten Physiotherapeuten gelernt wurden. Zusammen ermöglichen diese Elemente dem Roboter, seine Hände und seine „Stimme“ in Echtzeit zu koordinieren.

Vom Fachpersonal lernen

Um das System in reales Lehrverhalten einzubetten, untersuchten die Forscher Physiotherapeuten, die mit Patienten eine einfache, aber klinisch relevante Aufgabe durchführten: den Arm seitlich anheben, über den Kopf führen und wieder absenken. In sorgfältig aufgezeichneten Sitzungen führten Therapeuten manchmal nur mit Sprache, manchmal nur mit Berührung und manchmal mit beidem. Das Team fand klare Muster. Wenn Patienten Widerstand leisteten oder zu kämpfen hatten, setzten Therapeuten stärkere physische Unterstützung und häufigere, instruktive Sprachäußerungen ein. Wenn die Patienten genauer folgten, lockerten die Therapeuten ihren Griff, sprachen seltener und wechselten von Anweisungen zu Ermutigung. Diese Muster inspirierten direkt, wie der Roboter Compliance abschätzt und entscheidet, wann er auf Kraft, Sprache oder eine Mischung von beidem setzt.

Den Robotercoach auf die Probe stellen

Der neue Controller wurde mit zwölf gesunden Versuchspersonen bewertet, die dieselbe Schulterhebungsübung neben einem kollaborativen Roboter ausführten. In einer Versuchsreihe verglichen die Forscher einzelne Hilfsmodi — nur verbale Hinweise, nur physische Kräfte — mit einem einfachen dualmodalen Controller, der beides stets in fester Weise kombinierte. In einer zweiten Studie verglichen sie diese feste dualmodale Lösung mit ihrem adaptiven Robot Guidance Controller. Die Leistung wurde gemessen anhand der Genauigkeit, mit der die Teilnehmer dem vorgegebenen Pfad folgten, der Geschmeidigkeit ihrer Bewegung, der benötigten Zeit bis zum Abschluss und wie sich die Sprachmuster des Roboters veränderten.

Was die Experimente zeigten

Über alle Bedingungen hinweg war die Kombination aus Berührung und Sprache im Allgemeinen besser als jeweils nur eine der Modalitäten, besonders dann, wenn der neu hinzugekommene Kanal der einzige war, dem die Person tatsächlich Aufmerksamkeit schenkte. In manchen Fällen halbierte die zusätzliche physische Führung die Positionsfehler und machte die Bewegungen deutlich geschmeidiger und schneller. Der adaptive Controller ging noch weiter: Er reduzierte Nachführfehler um bis zu 50 %, verbesserte die Geschmeidigkeit und verkürzte die Abschlusszeit gegenüber der festen dualmodalen Basislösung um etwa ein Viertel. Bemerkenswert war, dass seine Sprachmuster — wie oft er „sprach“ und wie stark er von Anweisungen zu Ermutigung wechselte — den Mustern erfahrener Therapeuten näherkamen, und die Teilnehmenden bewerteten die adaptive Anleitung als natürlicher und menschlicher.

Was das im Alltag bedeuten könnte

Für Nicht-Expertinnen und -Experten lautet die Botschaft: Roboter können so trainiert werden, Menschen eher wie erfahrene Lehrkräfte zu führen — mit einer Mischung aus sanfter Berührung und passenden Worten, die sich beim Lernen anpasst. Obwohl diese Arbeit in einer Rehabilitationsübung demonstriert wurde, könnten die zugrunde liegenden Ideen auf Handschriftunterricht, Sportfähigkeiten oder komplexe berufliche Aufgaben ausgeweitet werden. Indem sie erfassen, wie gut jemand reagiert, und physische sowie verbale Hilfe spontan anpassen, könnten zukünftige Roboter nicht nur präzise Maschinen, sondern geduldige, ansprechbare Partner beim Lernen und in der Genesung werden.

Zitation: Tejwani, R., Payne, J., Velazquez, K. et al. Adaptive robot guidance through real-time compliance estimation and dual-modal control. Commun Eng 5, 81 (2026). https://doi.org/10.1038/s44172-026-00632-5

Schlüsselwörter: Mensch-Roboter-Interaktion, Rehabilitationsrobotik, adaptive Anleitung, robotisches Coaching, multimodale Steuerung