Clear Sky Science · es

Guía robótica adaptativa mediante estimación de conformidad en tiempo real y control multimodal

Enseñar a los robots a ser mejores ayudantes

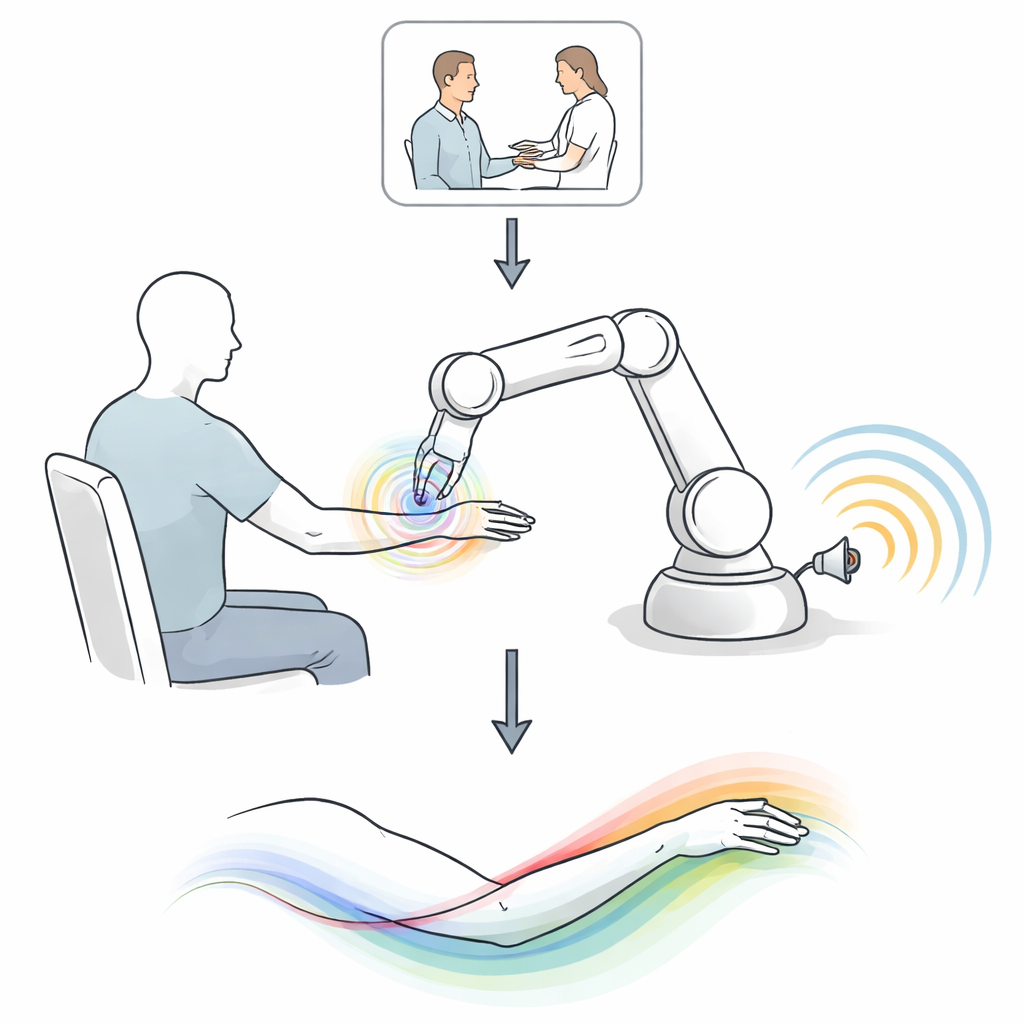

Imagínese aprender un nuevo paso de baile o rehabilitar un hombro dolorido. Un instructor humano no se limita a empujar su brazo hasta la posición; también ofrece consejos paso a paso y ánimo. Los robots actuales, en cambio, suelen o bien moverlo en silencio o bien hablar sin poder tocar. Este artículo presenta una forma nueva de combinar tacto y voz en los robots, adaptándose en tiempo real a qué tan bien la persona sigue las indicaciones para que la ayuda resulte más segura, natural y eficaz.

Por qué importa combinar tacto y voz

Los profesores humanos ajustan constantemente cuánto guían físicamente frente a cuánto hablan. Si usted se desvía, pueden mover su brazo con firmeza y dar instrucciones claras. Conforme mejora, se retiran, ofreciendo una guía más ligera y más ánimo. Los robots han tenido dificultades para hacer esto porque las fuerzas físicas y el lenguaje hablado son señales muy distintas. Los autores buscaron dotar al robot de algo parecido a la intuición de un instructor: una forma de estimar la disposición y habilidad de la persona para seguir la guía, y luego decidir cuándo empujar, cuándo hablar y cómo combinar ambos modos.

Cómo funciona el entrenador robótico adaptativo

El equipo diseñó un Controlador de Guía Robótica con tres partes principales. Primero, estima de forma continua la “conformidad”: qué tan estrechamente la persona sigue el movimiento deseado, usando medidas simples como la diferencia entre dónde debería estar el brazo y dónde está, y qué tan suave es su movimiento. Segundo, un paso de optimización decide cuánto de la corrección debe provenir de fuerza física frente a señales verbales, desplazando el equilibrio según cambie el comportamiento de la persona. Tercero, un modelo que convierte fuerza en lenguaje transforma los planes internos del robot en frases breves y adecuadas al contexto, como consejos suaves o palabras de ánimo, basadas en patrones aprendidos de terapeutas humanos reales. En conjunto, estos elementos permiten que el robot coordine sus manos y su “voz” en tiempo real.

Aprender de terapeutas expertos

Para anclar el sistema en el comportamiento docente del mundo real, los investigadores estudiaron a fisioterapeutas trabajando con pacientes en una tarea simple pero clínicamente importante: elevar el brazo desde el costado hasta por encima de la cabeza y volver. En sesiones cuidadosamente grabadas, los terapeutas a veces guiaban solo con la voz, a veces solo con el tacto y a veces con ambos. El equipo observó patrones claros. Cuando los pacientes se resistían o tenían dificultades, los terapeutas empleaban asistencia física más intensa y un habla más frecuente e instructiva. A medida que los pacientes seguían más de cerca, los terapeutas aflojaban el agarre, hablaban menos y pasaban de órdenes a ánimo. Estos patrones inspiraron directamente cómo el robot estima la conformidad y decide cuándo apoyarse en la fuerza, el habla o una mezcla de ambas.

Poner a prueba al entrenador robótico

El nuevo controlador se evaluó con doce voluntarios sanos realizando el mismo ejercicio de elevación del hombro junto a un robot colaborativo. En un conjunto de pruebas, los investigadores compararon modos únicos de ayuda —solo señales verbales, solo fuerzas físicas— con un controlador bimodal básico que siempre los combinaba de forma fija. En un segundo estudio, compararon esa configuración bimodal fija con su Controlador de Guía Robótica adaptativo. El rendimiento se midió por la proximidad con la trayectoria prevista, la suavidad del movimiento, el tiempo total para completar la tarea y cómo cambiaban los patrones de habla del robot.

Qué revelaron los experimentos

En todas las condiciones, combinar tacto y voz superó generalmente al uso de cualquiera de los dos por separado, sobre todo cuando el canal recién añadido era el único al que la persona realmente prestaba atención. En algunos casos, añadir guía física redujo los errores de posición en más de la mitad y hizo los movimientos notablemente más suaves y rápidos. El controlador adaptativo fue más allá, recortando errores de seguimiento hasta en un 50%, mejorando la suavidad y reduciendo el tiempo de finalización en alrededor de una cuarta parte en comparación con la línea base bimodal fija. Cabe destacar que sus patrones de habla —con qué frecuencia “hablaba” y cuánto pasaba de instrucciones a ánimo— coincidían más con los de los terapeutas expertos, y los participantes calificaron la guía adaptativa como más natural y más parecida a trabajar con un entrenador humano.

Qué podría significar esto para la vida cotidiana

Para los no expertos, la conclusión es que se puede enseñar a los robots a guiar a las personas más como los instructores humanos hábiles: usando una mezcla de tacto suave y palabras oportunas que se adapta conforme usted aprende. Aunque este trabajo se demostró en un ejercicio de rehabilitación, las ideas subyacentes podrían extenderse a enseñar caligrafía, habilidades deportivas o tareas laborales complejas. Al detectar qué tan bien responde alguien y ajustar la ayuda física y verbal al instante, los futuros robots podrían convertirse no solo en máquinas precisas, sino en compañeros pacientes y sensibles en el aprendizaje y la recuperación.

Cita: Tejwani, R., Payne, J., Velazquez, K. et al. Adaptive robot guidance through real-time compliance estimation and dual-modal control. Commun Eng 5, 81 (2026). https://doi.org/10.1038/s44172-026-00632-5

Palabras clave: interacción humano-robot, robótica de rehabilitación, guía adaptativa, entrenamiento robótico, control multimodal