Clear Sky Science · nl

Biomimetische harige affectieve-aanraak sensorische AI-interface

Waarom het leren van aanraking aan machines ertoe doet

We beoordelen vaak hoe iemand zich voelt aan de manier waarop diegene ons aanraakt: een snelle klop, een gespannen duw, een langzame geruststellende strijk. Huidige robots en slimme apparaten kunnen zien en horen, maar missen grotendeels dit rijke emotionele kanaal. Dit artikel introduceert een nieuw type zachte, harige elektronische huid waarmee machines niet alleen kunnen detecteren dat ze aangeraakt worden, maar ook hoe die aanraking emotioneel aanvoelt, wat de deur opent naar zachtere, natuurlijkere interacties tussen mensen en AI.

Een nieuw soort kunstmatige harige huid

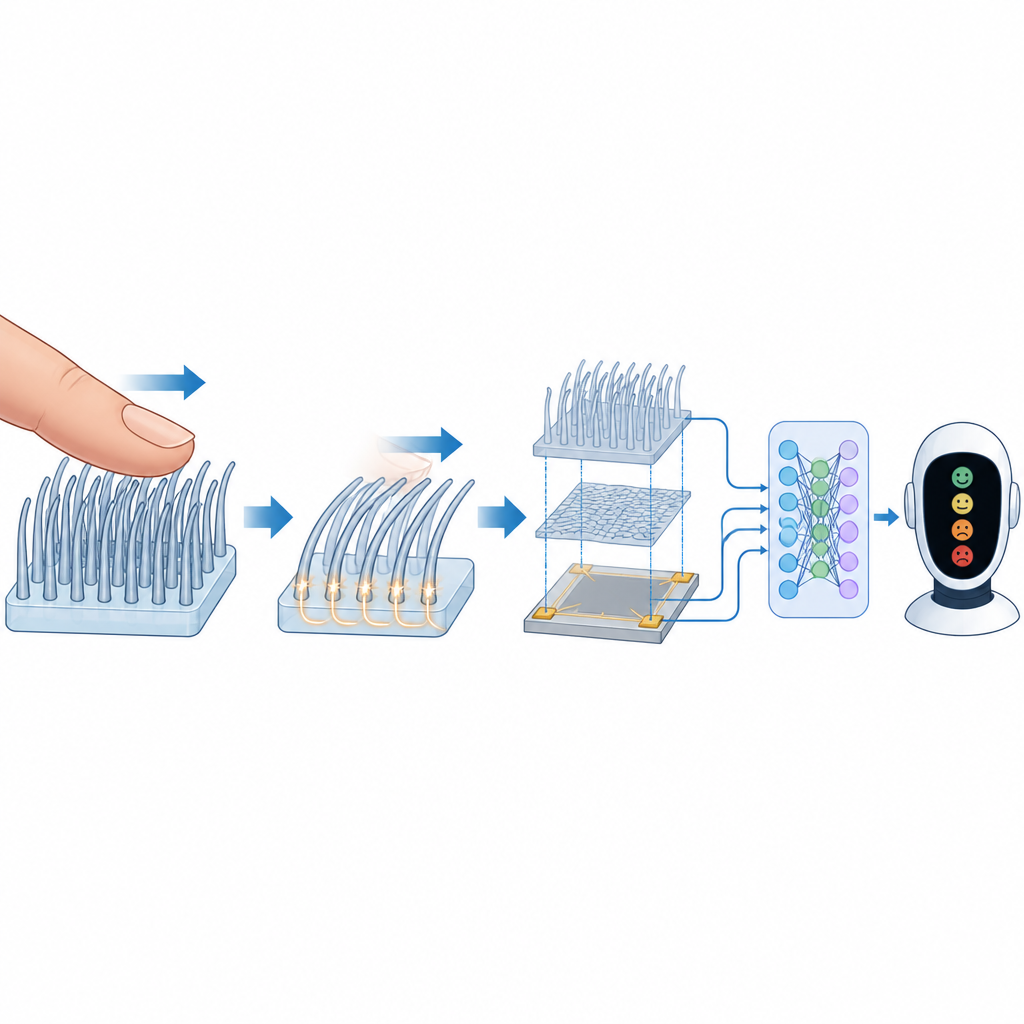

De onderzoekers hebben een flexibele sensor ontwikkeld, genoemd BioAI2, die de fijne haren op de huid van zoogdieren nabootst. Bij dieren detecteren kleine zenuwuiteinden rond haarwortels lichte strelingen en zenden signalen uit die samenhangen met comfort en sociale binding. BioAI2 kopieert dit idee met een bed van zachte siliconenharen die op een dun, zeer uniform geleidend netwerk rusten. Wanneer een vinger over de haren strijkt, buigen ze en veren terug, waarbij ze korte elektrische pulsen genereren zonder batterijen of externe voeding. Deze pulsen dragen informatie over waar de aanraking plaatsvindt, hoe hard er gedrukt wordt en hoe snel de beweging is, vergelijkbaar met de signalen van onze eigen aanrakinggevoelige zenuwvezels.

Van zachte strelingen naar hersenachtige signalen

Onder de oppervlakte benut het apparaat een eenvoudig fysisch effect: wanneer twee verschillende materialen contact maken en vervolgens scheiden, verplaatsen zich kleine ladingen tussen hen. Menselijke huid en de siliconenharen wisselen lading uit terwijl de vinger schuift, en het onderliggende netwerk verzamelt deze veranderingen als een reeks scherpe pulsen. Door haren van twee verschillende hoogtes en afstanden zorgvuldig te ontwerpen, maakten de onderzoekers de sensor bijzonder gevoelig voor lichte krachten terwijl hij ook sterker drukken aankan. Ze ontdekten dat de frequentie van elektrische pulsen stijgt met de streepsnelheid tot een ideaal punt en daarna weer afneemt, wat overeenkomt met hoe bepaalde menselijke aanrakingzenuwen het beste reageren op aaiachtige snelheden. Dit maakt de output niet alleen een technisch signaal, maar een directe representatie van de wijze waarop ons lichaam aangename aanraking codeert.

Kracht, locatie en beweging tegelijk waarnemen

In tegenstelling tot veel eerdere aanrakingssensoren die alleen druk op vaste punten meten, leest BioAI2 meerdere aspecten van aanraking uit een enkele dunne plaat. Vier elektroden in de hoeken verzamelen pulsen waarvan sterkte en timing variëren met waar de vinger terechtkomt en hoe deze beweegt. De onderzoekers ontwikkelden een wiskundige toewijzingsmethode gebaseerd op vloeiende "isoline"-curven zodat zelfs aanrakingen dicht bij de randen zeer nauwkeurig over een groot oppervlak gelokaliseerd kunnen worden. Het stekelige haardesign maakt elke puls ook extreem kort in de tijd, waardoor het systeem overlappende aanrakingen van meerdere vingers kan scheiden en complexe paden kan reconstrueren, zoals letters of vormen die op het oppervlak zijn getekend.

Machines leren gevoelens uit aanraking te lezen

Om deze patronen aan menselijke emoties te koppelen, keken vrijwilligers naar filmfragmenten die positieve, neutrale of negatieve stemmingen opwekten en voerden daarna alledaagse gebaren uit zoals strelen, kloppen en slaan op het harige oppervlak. Het apparaat legde duizenden voorbeelden vast en het team zette de ruwe signalen om in kleurrijke tijd-frequentiebeelden, met extra indicatoren voor streepsnelheid en kracht. Een deep learning-systeem leerde zowel het type gebaar als de waarschijnlijke emotionele toon erachter te herkennen. Over verschillende personen herkende het systeem het gebaar bijna altijd correct en labelde het de emotionele toestand met meer dan 80 procent nauwkeurigheid, wat aantoont dat emotionele aanwijzingen in aanraking ontcijferd kunnen worden met deze kunstmatige huid.

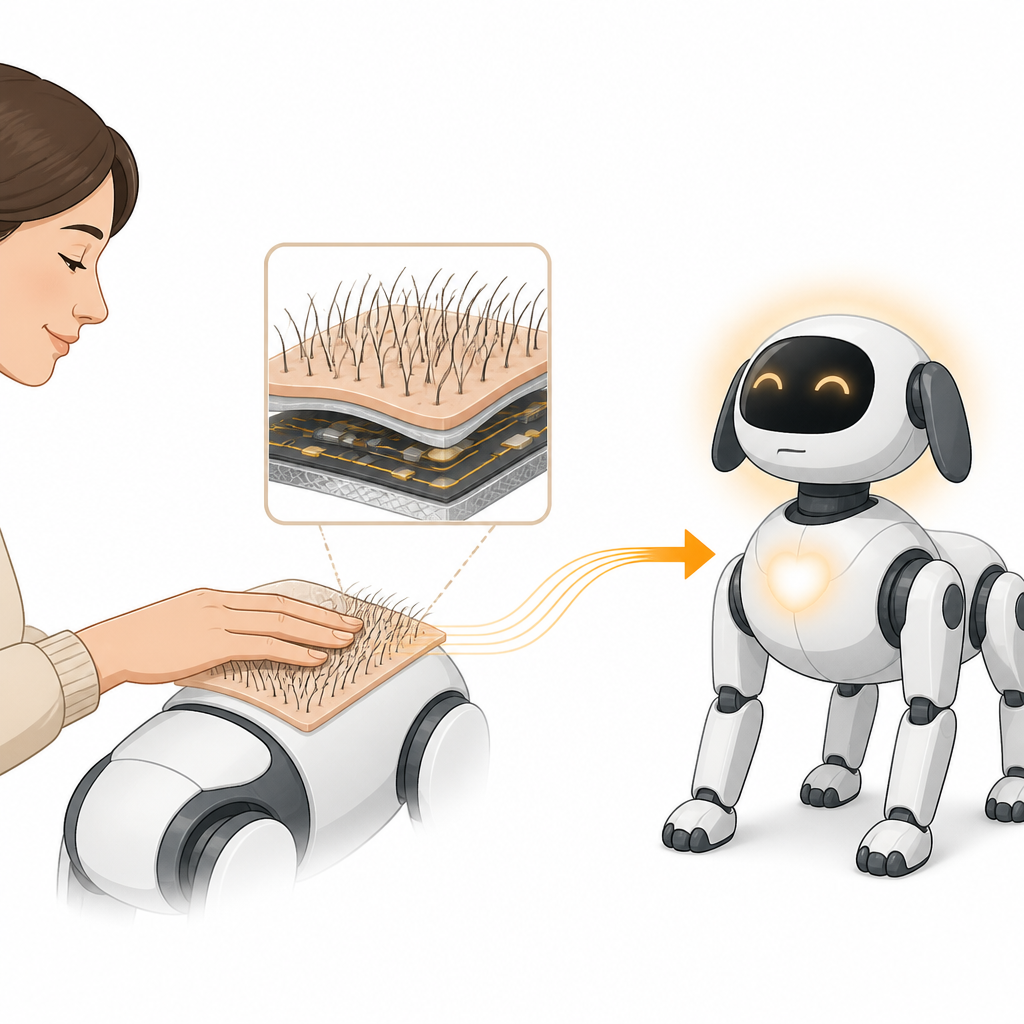

De emotionele lus sluiten met robots

Tenslotte combineerden de onderzoekers de harige huid met een robotachtige hond en een groot taalmodel vergelijkbaar met moderne chatbots. De huid detecteerde hoe de eigenaar de robot aaide, terwijl het taalmodel extra context kreeg zoals de situatie en de relatie tussen mens en robot. Samen kozen ze passende expressieve acties, zoals springen, uitrusten of snuffelen, die overeenkomen met de gedetecteerde stemming. Dit creëert een volledige lus: een persoon drukt emotie uit via aanraking, de machine interpreteert zowel de aanraking als de context, en reageert vervolgens op een manier die emotioneel passend aanvoelt.

Wat dit betekent voor toekomstige mens-machine relaties

Dit werk laat zien dat een dunne, zachte, met haren bedekte elektronische huid subtiele aanrakingpatronen kan omzetten in signalen die machines kunnen gebruiken om onze gevoelens te detecteren. Door deze sensor te combineren met moderne AI kunnen robots en apparaten verder gaan dan stijve knopdrukken naar interacties die lijken op het troosten van een dier of het vasthouden van een hand. Hoewel het systeem nog grotere oppervlakken, meer data en andere zintuigen zoals temperatuur nodig heeft om volledig aan menselijke aanraking te evenaren, wijst het op een toekomst waarin technologie kan reageren op onze emotionele staat via aanraking, waardoor digitale metgezellen, assistieve robots en therapeutische hulpmiddelen mensgerichter en ondersteunender aanvoelen.

Bronvermelding: Hong, J., Xiao, Y., Chen, Y. et al. Biomimetic hairy affective-touch sensory AI interface. Nat Commun 17, 4146 (2026). https://doi.org/10.1038/s41467-026-70334-1

Trefwoorden: affectieve aanraking, elektronische huid, mens-robot interactie, tactiele detectie, emotieherkenning