Clear Sky Science · nl

Groot-array sub-millimeter nauwkeurige coherente flits drie-dimensionale beeldvorming

Diepte waarnemen met ongelooflijke detail

Stel je een camera voor die niet alleen de wereld in drie dimensies ziet, maar afstanden zo precies kan meten dat hij veranderingen kleiner dan de dikte van een bankpas kan detecteren vanaf tientallen meters afstand. Dat is wat de onderzoekers achter dit werk hebben gebouwd: een nieuw soort laser‑gebaseerde 3D‑camera die lange afstand, zeer fijne dieptenauwkeurigheid en ruimte om naar veel meer pixels op te schalen combineert. Zo’n instrument kan helpen bij het monitoren van kleine verschuivingen in bruggen of gebouwen, het digitaal conserveren van kwetsbare kunstvoorwerpen en het levensechter maken van virtuele realiteitsscènes.

Waarom afstand meten zo moeilijk is

Moderne auto’s, robots en kaartvormingssystemen vertrouwen steeds vaker op LiDAR, een methode die laserlicht op een scène schijnt en de terugkeertijd meet om een 3D‑beeld op te bouwen. Veel huidige systemen sturen een smalle laserstraal met bewegende spiegels, wat snelheid en betrouwbaarheid beperkt. Solid‑state benaderingen zonder bewegende onderdelen komen op, maar zij kampen nog steeds met compromissen: ontwerpen die stralen elektronisch sturen zijn moeilijk op te schalen en scannen vaak langzaam, terwijl zeer gevoelige single‑photon detectoren moeite hebben met het vormen van grote, ruisarme arrays met fijne dieptenauwkeurigheid. Conventionele camerasensoren zoals CCD’s bieden al enorme aantallen pixels, maar wanneer ze in 3D‑systemen worden gebruikt vertrouwen ze meestal op grove timingtrucs die alleen afstanden binnen enkele centimeters kunnen onderscheiden.

Een nieuwe manier om licht en radio samen te gebruiken

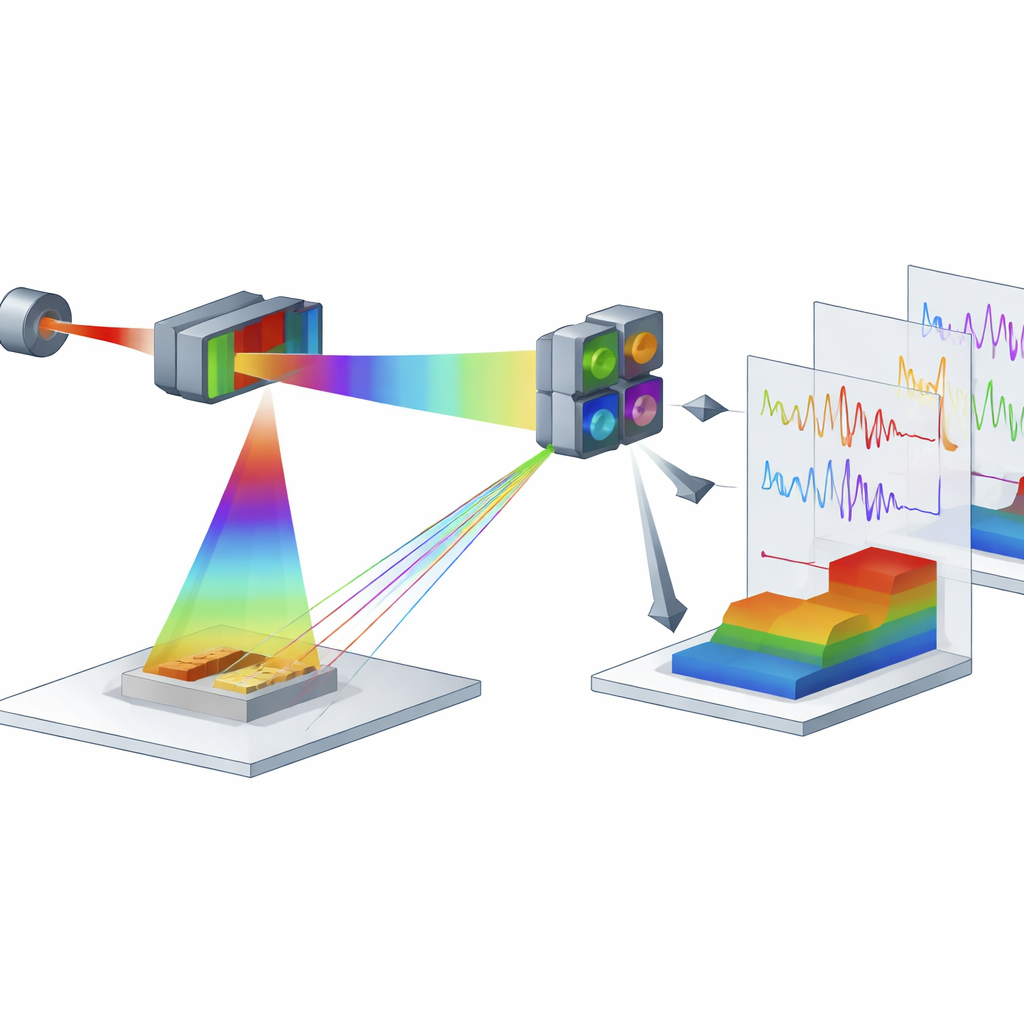

De auteurs presenteren een andere strategie die de volwassenheid van CCD‑technologie combineert met een techniek die bekendstaat als coherente detectie, veelgebruikt in hogesnelheids vezeloptische communicatie. In plaats van korte laserpulsen af te vuren, schijnen ze continu een laser waarvan de helderheid ritmisch wordt aangestuurd door een radiofrequentiesignaal dat in de loop van de tijd door vele nauwe frequenties stapt. Een deel van dit gemoduleerde licht overstroomt de scène als een "probe", terwijl een ander deel als "lokale referentie" wordt vastgehouden. Bij de ontvanger combineert een optische opstelling het zwakke terugkerende licht van elke punt in de scène met het sterkere referentielicht en voert het resultaat naar vier gesynchroniseerde CCD‑camera’s die samen als één "coherente beeldsensor" functioneren. Binnen elke pixel codeert het mengen van probe en referentie afstand als een subtiel patroon in het opgenomen signaal.

Flikkeringen omzetten in een 3D‑beeld

Tijdens één volledige sweep van radiofrequenties registreert elke CCD‑pixel een reeks helderheidswaarden over duizenden frames. Op zichzelf tonen deze ruwe beelden bijna niets — het terugkerende licht is veel zwakker dan de referentie. Maar wanneer de onderzoekers een op maat gemaakt verwerkingsalgoritme toepassen, halen ze een klein oscillerend component uit het signaal van elke pixel. De frequentie van deze oscillatie blijkt direct te correleren met hoe ver dat punt in de scène van de camera verwijderd is. Door een frequentieanalyse uit te voeren, zet het systeem de tijdreeks van elke pixel om in een nauwkeurige afstandsmeting en stapelt deze metingen tot een gedetailleerde 3D‑kaart. In tests met een trapvormig doel op 30,5 meter afstand, loste de camera duidelijk treden van slechts 5 millimeter hoogte op en reconstrueerde het volledige oppervlak in drie dimensies met alle 320 × 256 pixels.

Reële scènes testen en de grenzen verleggen

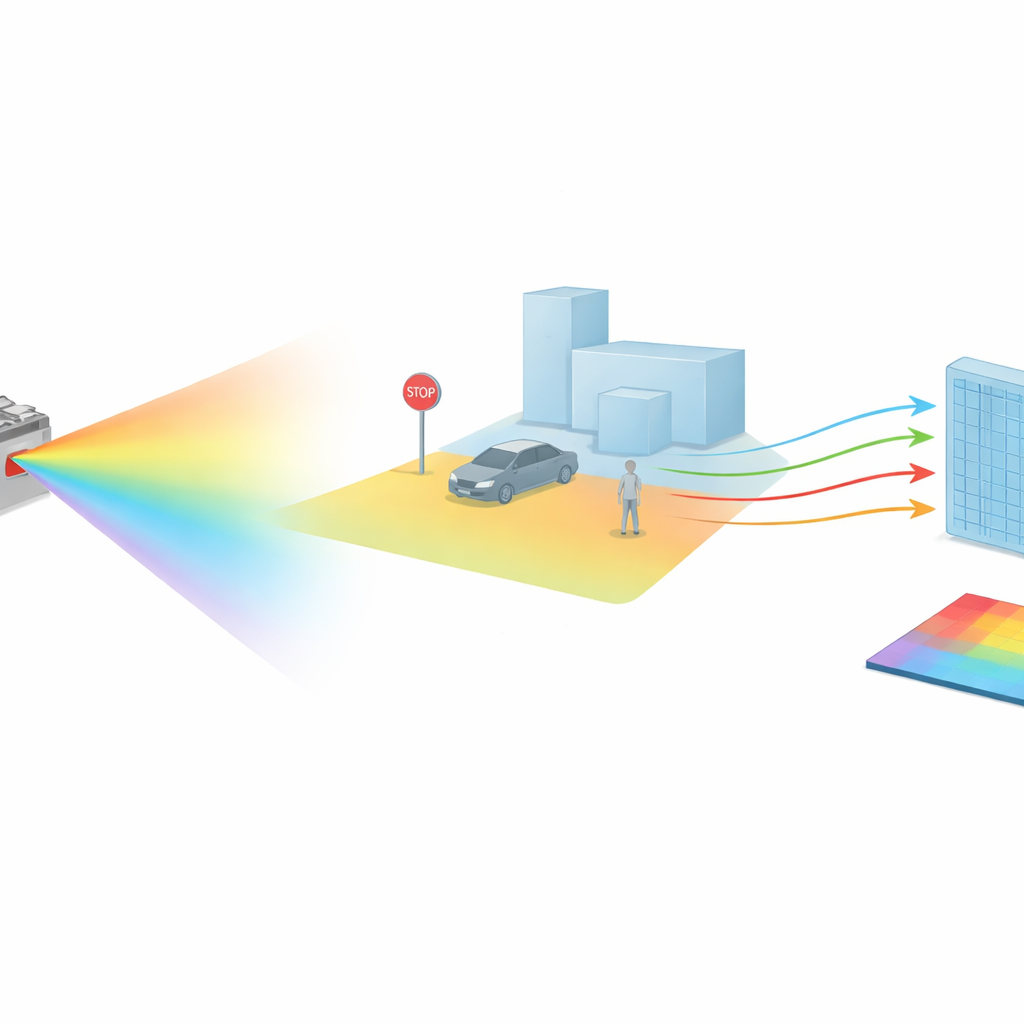

Om te laten zien wat het systeem in de praktijk kan, beeldde het team een miniatuur verkeersscène af met een auto, een voetganger en straatmeubilair op dezelfde 30,5 meter afstand. Met slechts enkele tientallen milliwatts optisch vermogen herstelde de camera een scherp 3D‑model waarin individuele objecten, hun schaduwen en features op millimeterschaal zichtbaar waren. Met een vlak doelvlak maten ze een dieptenauwkeurigheid van slechts 0,47 millimeter — ten minste tien keer beter dan veel andere solid‑state LiDAR‑ontwerpen. Ze onderzochten ook hoe de prestatie verandert met het aantal gebruikte frames en vonden een afweging tussen snelheid en precisie: snellere opnames geven grovere diepte, terwijl langere acquisities de metingen verscherpen. Het systeem bleef robuust, zelfs wanneer lucht turbulentie langs het optische pad werd geïntroduceerd, en het kon objecten die zijwaarts bewogen tot 300 millimeter per seconde reconstrueren door de belichtingstijd te verkorten.

Van standbeelden tot toekomstige digitale werelden

Naast testpatronen gebruikte het team hun camera om een buste te scannen vanuit acht kijkhoeken, elk op meer dan 30 meter afstand. Door deze beelden aan elkaar te rijgen bouwden ze een levensecht virtueel model dat rondgedraaid en vanaf elke richting onderzocht kan worden. Omdat de techniek in principe op zichtbare golflengten kan werken en hardware kan delen met gewone fotografie, opent het de deur naar apparaten die tegelijk gedetailleerde kleurfoto’s en ultranauwkeurige dieptekaarten vastleggen. Hoewel de huidige prototype wordt beperkt door de framesnelheid van zijn CCD‑sensoren, zouden snellere beeldchips en slimmer bemonsteringsschema’s de snelheid dramatisch kunnen verhogen. In eenvoudige bewoordingen toont dit werk aan dat door radio‑achtige modulatie slim te combineren met bekende cameratechnologie, het mogelijk is de 3D‑wereld op lange afstand met sub‑millimeter nauwkeurigheid te zien — een vooruitgang met verstrekkende gevolgen voor monitoring, mapping en meeslepende digitale ervaringen.

Bronvermelding: Wang, B., Tian, J., Wang, J. et al. Large-array sub-millimeter precision coherent flash three-dimensional imaging. Nat Commun 17, 2780 (2026). https://doi.org/10.1038/s41467-026-69188-4

Trefwoorden: 3D-beeldvorming, LiDAR, dieptesensor, coherente detectie, CCD-camera's