Clear Sky Science · nl

Een overzicht van grote taalmodellen in biologie en chemie

Computers het taalgebruik van moleculen leren

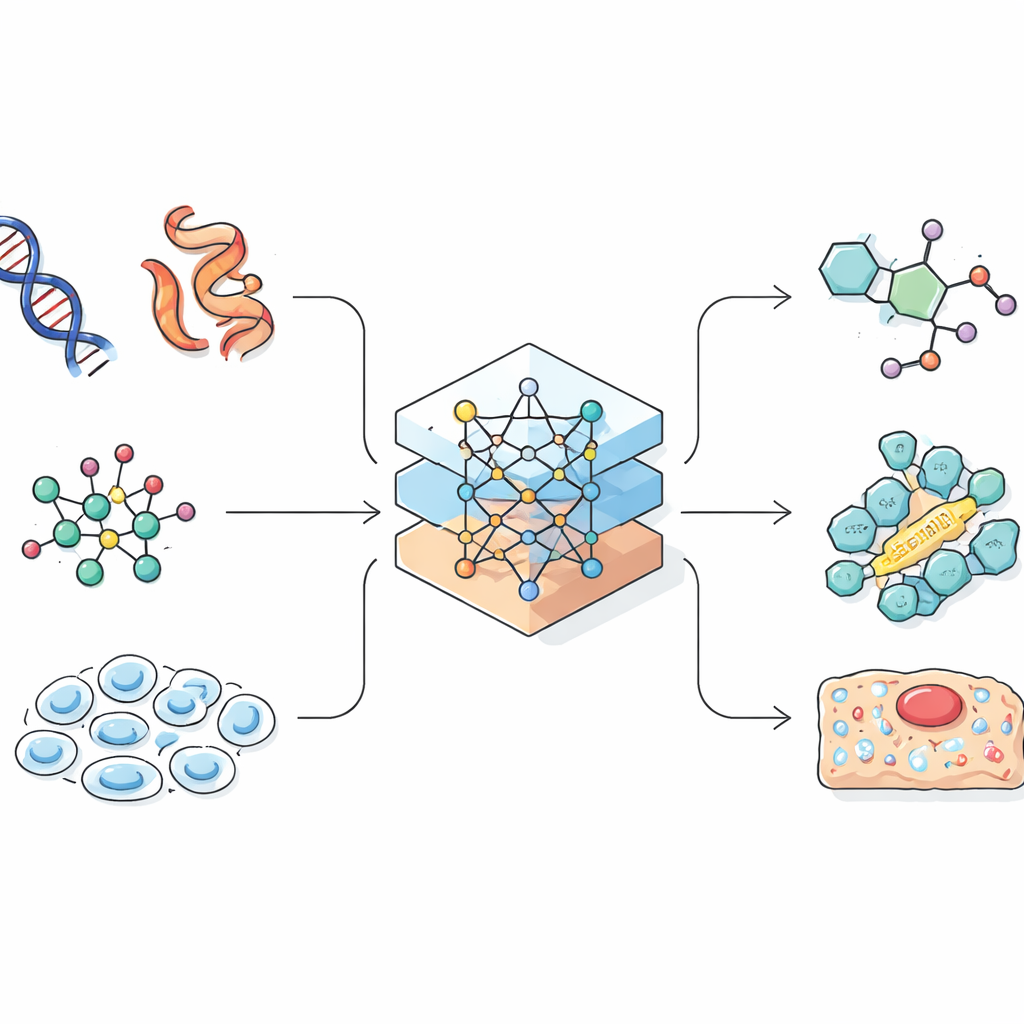

De moderne biologie en chemie produceren nu meer data dan een mens ooit kan lezen. Dit artikel legt uit hoe grote taalmodellen—dezelfde soort AI achter chatbots—worden hergebruikt om de “talen” van DNA, eiwitten en kleine moleculen te lezen en te schrijven. Voor een niet‑specialist is de aantrekkingskracht duidelijk: deze instrumenten beloven snellere medicijnontwikkeling, beter begrip van ziekten en zelfs computers die helpen bij het ontwerpen en uitvoeren van experimenten in het laboratorium.

Van woorden en zinnen naar genen en moleculen

Taalmodellen zijn oorspronkelijk gebouwd om het volgende woord in een zin te voorspellen. Wetenschappers realiseerden zich dat veel biologische en chemische gegevens, zoals eiwitsequenties of lineaire coderingen van moleculen, ook op reeksen lijken. Als een AI patronen in natuurlijke taal kan leren, kan ze misschien ook patronen leren die een gensequentie verbinden met zijn rol in een cel, of een chemische formule met zijn eigenschappen. De review laat zien hoe onderzoekers zorgvuldig complexe driedimensionale moleculen en cellen converteren naar eendimensionale reeksen, grafen of puntwolken die een AI aankan. Deze ontwerpfase is cruciaal, omdat de manier waarop informatie wordt voorgesteld bepaalt wat het model kan leren en welke soorten ontdekkingen mogelijk zijn.

Eiwitten, DNA en het leven van individuele cellen lezen

Een belangrijk aandachtspunt zijn “biologische taalmodellen” die met levende systemen werken. Voor eiwitten kunnen modellen die op miljoenen sequenties zijn getraind nu voorspellen hoe een lineaire keten van aminozuren zal vouwen tot een driedimensionale structuur, en ze evenaren daarmee tijdrovende laboratoriumtechnieken. Sommige modellen gaan verder en suggereren nieuwe eiwitontwerpen die nooit in de natuur voorkwamen maar mogelijk als geneesmiddel of industrieel enzym kunnen dienen. Voor DNA en RNA passen onderzoekers taalmodellering aan om lange reeksen van slechts vier letters te verwerken, waardoor AI controlegebieden in het genoom kan herkennen of de effecten van mutaties kan voorspellen. Op celniveau behandelen nieuwe benaderingen het genactiviteitsprofiel van elke cel als een document waarvan de “woorden” genen zijn, waardoor modellen celtypen kunnen clusteren, voorspellen hoe cellen op behandelingen reageren en laboratoriumgegevens kunnen verbinden met bestaande biologische kennis.

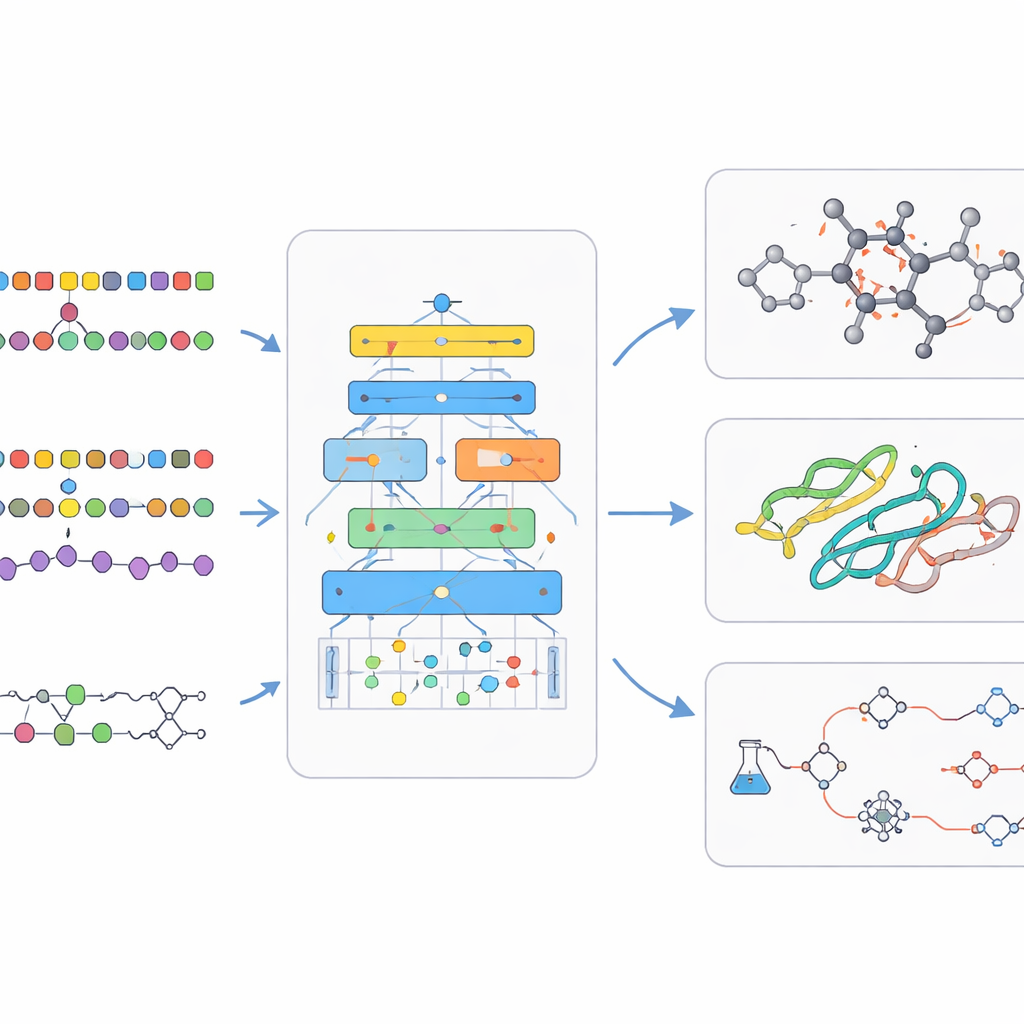

De chemie een eigen digitale grammatica geven

Chemische taalmodellen richten zich op de wereld van kleine moleculen, zoals kandidaat‑geneesmiddelen. Hier gebruiken chemici compacte, tekstachtige codes om structuren te beschrijven, die aan taalmodellen gevoerd kunnen worden als zinnen. Encoder‑achtige modellen richten zich op begrip: ze leren een rijk intern vingerafdruk voor elk molecuul die helpt eigenschappen te voorspellen zoals oplosbaarheid of toxiciteit. Decoder‑achtige modellen richten zich op creatie: ze genereren stap voor stap geheel nieuwe moleculen en worden daarbij gestuurd richting gewenste eigenschappen. Gecombineerde modellen die de ene sequentie in de andere vertalen, worden gebruikt om de uitkomst van reacties te voorspellen of manieren voor te stellen om een doelverbinding te synthetiseren. Geavanceerdere systemen mengen tekst, tweedimensionale tekeningen, driedimensionale vormen en grafen zodat de AI over meerdere manieren van chemische beschrijving kan redeneren.

Hoe deze modellen leren en verbeteren

Onder de motorkap vertrouwen bio‑chemische taalmodellen op slimme trainingstrucs. Ze beginnen vaak met zelfgestuurd leren, waarbij de AI ontbrekende stukken van de input moet raden, wat hen dwingt de onderliggende structuur te begrijpen zonder menselijke labels. Multitask‑training laat één model gelijktijdig veel verwante problemen oefenen, wat de algemene vaardigheden versterkt. Andere ontwerpen laten het model tijdens het beantwoorden externe databases raadplegen, waardoor de outputs geworteld worden in echte chemie en biologie en het aantal verzinsels afneemt. Daarna worden kleinere rondes van gesuperviseerd trainen gebruikt om het model af te stemmen op specifieke taken zoals het voorspellen van medicijnveiligheid of het plannen van een reactie. De review behandelt ook de grote openbare datasets en benchmarks die het mogelijk maken te beoordelen of een nieuw model echt beter is, en niet alleen groter.

Op weg naar AI‑laboratoriumassistenten en verantwoord gebruik

Buiten op zichzelf staande modellen benadrukken de auteurs een verschuiving naar interactieve “agentachtige” systemen. In deze opstellingen kan een taalmodel gespecialiseerde tools aanroepen—bijvoorbeeld een programma dat reacties controleert, literatuur doorzoekt of laboratoriumrobots aanstuurt—en hun uitkomsten aaneenschakelen. Vroege demonstraties tonen aan dat zulke agenten syntheseroutes voorstellen, experimenten ontwerpen en zelfs geautomatiseerde laboratoria aansturen. De review besluit dat, mits gecombineerd met sterke waarborgen, transparante beoordeling en zorgvuldige aandacht voor ethiek en regelgeving, deze bio‑chemische taalmodellen kerninfrastructuur voor de wetenschap kunnen worden. Voor niet‑experts is de kernboodschap dat AI leert de code van leven en materie te lezen en te schrijven, met de potentie het traject van idee naar medicijn, materiaal of biologisch inzicht te verkorten.

Bronvermelding: Ashyrmamatov, I., Gwak, S.J., Jin, SY. et al. A survey on large language models in biology and chemistry. Exp Mol Med 58, 970–980 (2026). https://doi.org/10.1038/s12276-025-01583-1

Trefwoorden: grote taalmodellen, medicijnontwikkeling, eiwitstructuur, chemische taalmodellen, genomica