Clear Sky Science · zh

神经网络模型与机器翻译评估指标:两种自动化评估交替传译信息忠实性方法的比较

这项研究与日常语言使用者的关系

每当你聆听一场从一种语言翻译成另一种语言的口译稿时,你会期望核心信息在传递过程中没有丢失。检验这种“忠实度”长期以来依赖专家人工评估,既慢又昂贵。本研究探讨现代人工智能能否帮助判断口译者传达信息的准确性,有可能让语言服务更公平、更便宜,并更易于大规模质量检查。

理解忠实的口译

口译质量有许多维度,但专业人士普遍认为信息忠实性——意图和信息被多大程度和多准确地传达——是最重要的。传统上,专家会听原始演讲与口译版本,或将口译与理想的书面译本对照,然后评分以判断主要观点、观点之间的关联以及说话人的语气是否被保留。这些方法细致而富有洞见,但需要受过高度训练的人反复听录音、在语言之间切换并做出细致判断。因此,细致的人类评估通常用于考试或研究,而非日常培训或大规模质量控制。

从翻译尺子到智能模型

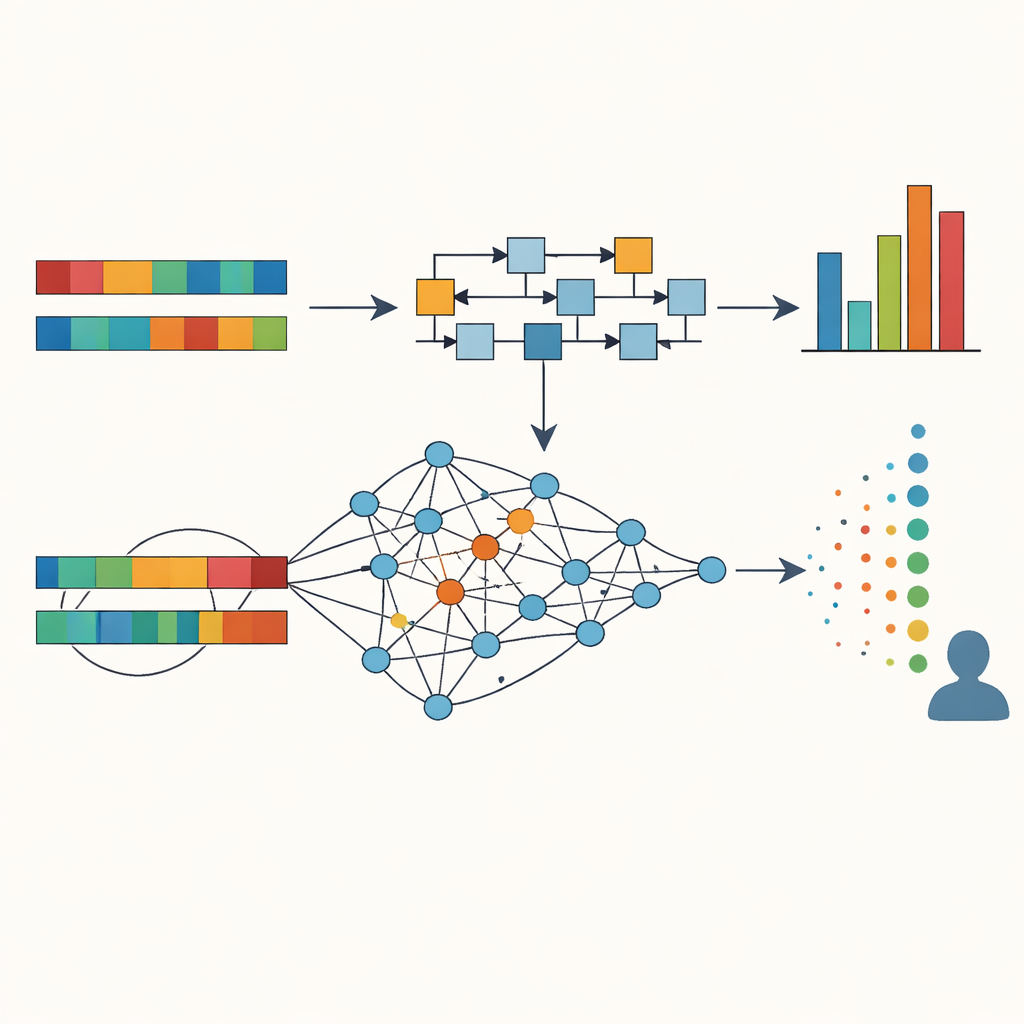

为减轻人工评分者的负担,研究人员借用了机器翻译领域的工具,在那里计算机程序通过将系统输出与若干可信的人类译本比较来评估质量。经典指标如 BLEU 和 METEOR 寻找语句与参考译本之间的词汇重叠,给出数值评分。当存在多份高质量参考译本时,这些指标效果最佳,但这类参考译本成本高昂,逐词重叠也常常忽略意义层面的整体把握,尤其在英汉等结构差异较大的语言对之间更为明显。

研究如何检验人类与机器

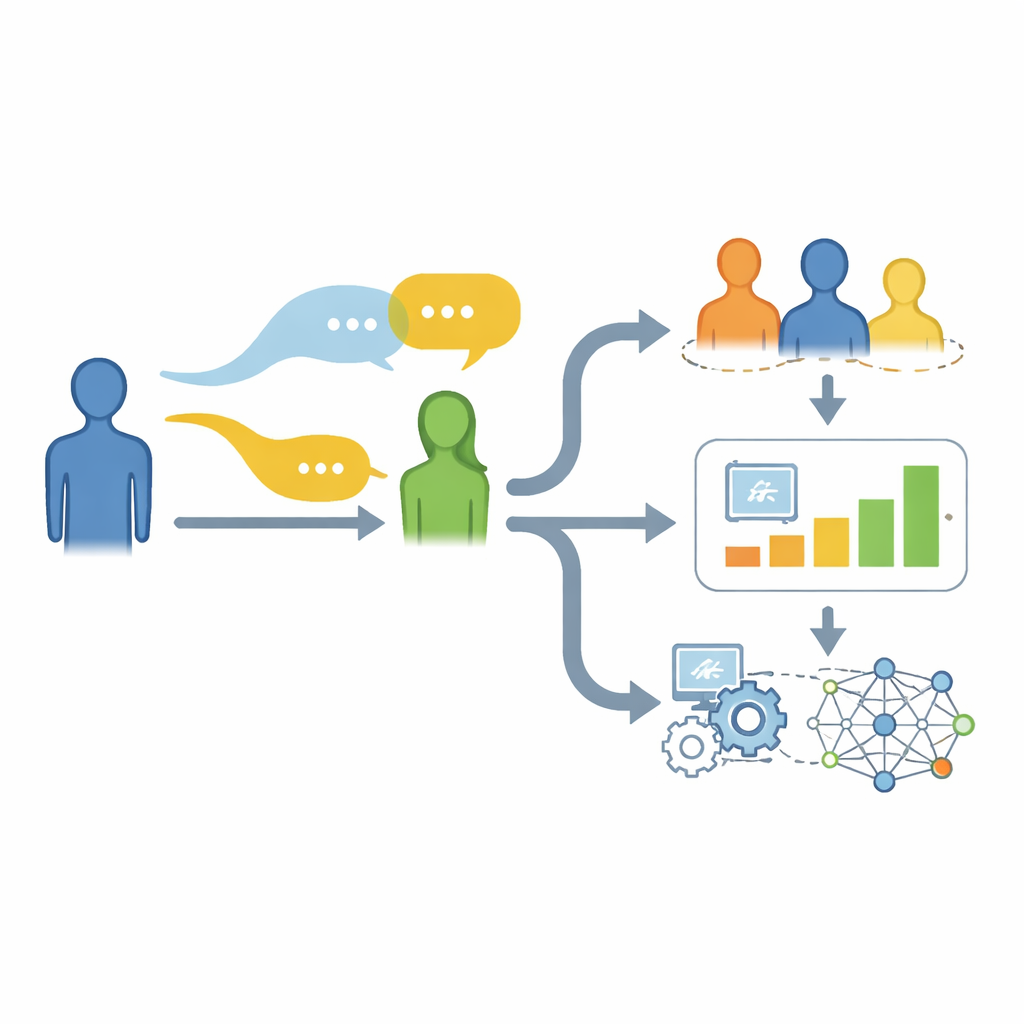

本研究聚焦于英—中交替传译的学员口译。作者从更大的语料中挑选出三段分别代表高、中、低总体质量的样例口译,转录了原始英文演讲与中文口译,去除语气词并将其对齐为94对对应句子。两位有经验的评分员随后为每对句子评分其忠实度——涵盖主要观点、观点之间的关联、支持细节以及说话人的态度和意图——两者之间达成了很高的一致性。与此同时,研究者为每个句子计算了两类自动分数:传统翻译评估指标(基于对原文的若干经修订的机器翻译作为参考的 BLEU 和 METEOR)以及一组直接衡量英中文句子跨语言相似性的神经模型。

机器在口译中“看到”的东西

研究通过统计相关性将机器得分与人工评分进行比较。传统指标表现出中等一致性:平均而言,它们的分数与人工判断较为吻合(约 r = 0.45),其中最简单的 BLEU 变体表现略优于 METEOR。神经方法总体表现更好,尤其是将不同语言句子映射到共同数值“嵌入”以捕捉意义的那些方法。一个名为 MUSE 的多语句嵌入模型与人工评分的匹配度最高(r = 0.55),而来自大型语言模型如 GPT 和 LLaMA 的嵌入,以及基于 GPT 的直接评分,也呈中等相关。重要的是,这些模型更能应对自然的意译——例如当中文句子重组了英文句子但保留了其含义时,基于词汇重叠的指标可能错误地判定为不正确,而神经模型则能识别其等效性。聚类分析将口译按机器得分分组,显示出将多种指标组合起来可以在很大程度上如实区分低、中、高质量的口译,结果与人工评分相近。

对未来语言评估的意义

对非专业读者的结论是,如今的人工智能已经能够提供有用但并非完美的信号,帮助判断口译在多大程度上保留了演讲内容。直接比较意义的跨语神经模型,而非仅仅对照参考文本计算共享词汇,更接近人工判断,能够在措辞或结构不同但含义相同的情况下识别出好的口译。这些相关性在统计上具有显著性,但不足以完全取代专家评分。研究建议在低风险场景中将神经分数与传统指标结合使用,作为快速、低成本的辅助工具:课堂反馈、练习环节或大规模评估中的初步筛查。对于高风险决策以及捕捉风格、语境和伦理的细微差别,人类专业知识仍然不可或缺,但基于 AI 的工具有望成为保障口译信息忠实性的有价值伙伴。

引用: Wang, X., Wang, B. Neural network models vs. MT evaluation metrics: a comparison between two approaches to automated assessment of information fidelity in consecutive interpreting. Humanit Soc Sci Commun 13, 567 (2026). https://doi.org/10.1057/s41599-026-06562-z

关键词: 口译质量, 信息忠实性, 神经网络评估, 机器翻译指标, 英中口译