Clear Sky Science · tr

Sinir ağı modelleri ve MT değerlendirme metrikleri: ardıl çeviride bilgi sadakatinin otomatik değerlendirilmesine yönelik iki yaklaşımın karşılaştırması

Bu araştırma sıradan dil kullanıcıları için neden önemli

Bir konuşmayı bir dilden başka bir dile dinlediğinizde, temel mesajın yolculuğu sağ salim atlattığına güvenirsiniz. Bu "sadakatin" kontrolü uzun süre uzman insanlara dayanıyordu; bu da yavaş ve maliyetliydi. Bu çalışma, modern yapay zekânın bir tercümanın bilgiyi ne kadar doğru aktardığını değerlendirmede yardımcı olup olamayacağını sorguluyor; bu da dil hizmetlerini daha adil, daha ucuz ve büyük ölçekte kalite kontrolü açısından daha erişilebilir kılabilir.

Sadık çeviriyi anlamak

Çeviri kalitesi birçok boyuta sahiptir, ancak uzmanlar çoğunlukla bilgi sadakatinin —anlamın ne kadar eksiksiz ve doğru aktarıldığı— en önemli unsur olduğu konusunda hemfikirdir. Geleneksel olarak uzmanlar orijinal konuşmayı ve tercüme edilmiş versiyonu dinler veya tercümeyi ideal bir yazılı versiyonla karşılaştırır ve fikirlerin, fikirler arasındaki bağların ve konuşmacının üslubunun ne kadar korunduğunu puanlarlar. Bu yöntemler zengin ve nüanslıdır, fakat eğitimli kişilerin kayıtları tekrar tekrar dinlemesini, diller arasında geçiş yapmasını ve ince ayrıntılarda kararlar vermesini gerektirir. Sonuç olarak, ayrıntılı insan değerlendirmesi genellikle sınavlar veya araştırma için ayrılır; günlük eğitim ve geniş çaplı kalite kontrol için nadiren uygulanır.

Çeviri cetvellerinden akıllı modellere

İnsan değerlendiricilerin yükünü hafifletmek için araştırmacılar, bir sistemin çıktısını birkaç güvenilir insan çevirisiyle karşılaştıran makine çevirisi araçlarını ödünç aldılar. BLEU ve METEOR gibi klasik metrikler, söylenen ile bir dizi referans versiyon arasındaki örtüşen kelime kalıplarını arar ve sayısal bir skor üretir. Birden çok yüksek kaliteli referans çeviri mevcutsa iyi çalışırlar, ancak bu referansların üretilmesi maliyetlidir ve kelime düzeyindeki örtüşme, özellikle İngilizce ile Çince gibi yapısal olarak farklı diller arasında, anlamın bütünü kaçırılabilir.

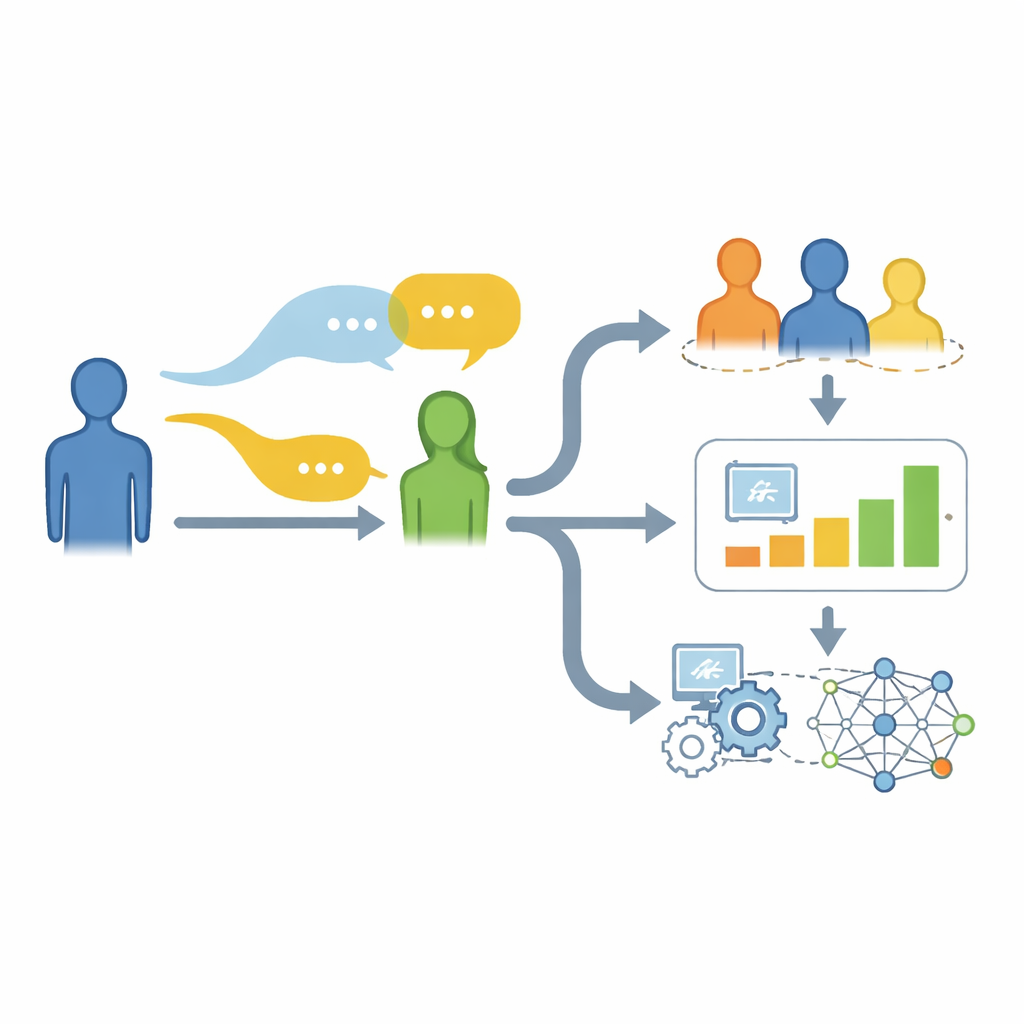

Çalışma insanları ve makineleri nasıl teste soktu

Bu araştırma, stajyer tercümanların yaptığı İngilizce–Çince ardıl çeviriye odaklandı. Yazarlar, daha büyük bir havuzdan yüksek, orta ve düşük genel kaliteyi temsil eden üç örnek çeviri seçtiler. Hem orijinal İngilizce konuşmayı hem de Çince çevirileri yazıya döktüler, dolgu sözcükleri temizlediler ve bunları 94 eşleşen cümle çiftine hizaladılar. İki deneyimli değerlendirici daha sonra her çifti sadakat açısından —ana fikirler, fikirler arası bağlantılar, destekleyici ayrıntılar ve konuşmacının tutumu/niyeti— puanladı ve aralarında çok yüksek bir uyum sağladılar. Paralel olarak, araştırmacılar her cümle için iki araç ailesi kullanarak otomatik skorlar hesapladılar: geleneksel çeviri metrikleri (kaynak konuşmanın birden çok düzeltilmiş makine çevirisini referans olarak kullanan BLEU ve METEOR) ve İngilizce cümle ile onun Çince yorumu arasında doğrudan dil‑ötesi benzerliği ölçen bir dizi sinir ağı tabanlı model.

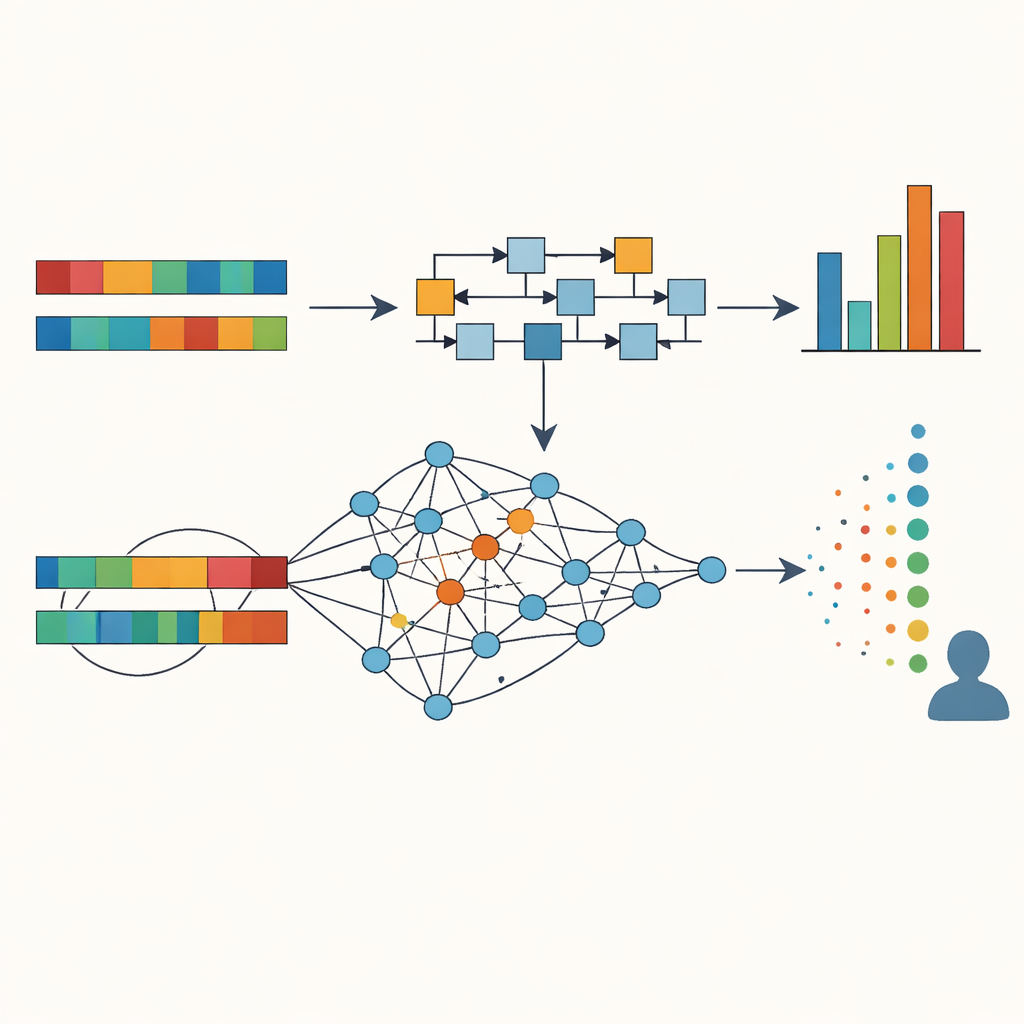

Makinelerin çevirilerde gördükleri

Çalışma, makine skorlarını insan puanlarıyla istatistiksel korelasyonlar kullanarak karşılaştırdı. Geleneksel metrikler orta düzeyde uyum gösterdi: ortalama olarak skorları insan yargılarını makul düzeyde izledi (yaklaşık r = 0.45), ve en basit BLEU çeşidi METEOR’dan biraz daha iyi performans sergiledi. Sinir ağı yaklaşımları genel olarak daha iyi sonuç verdi; özellikle farklı dillerdeki cümleleri anlamı yakalayan ortak sayısal "gömülere" (embedding) çeviren modeller daha başarılıydı. MUSE adlı çokdilli cümle‑gömme modeli insan puanlarıyla en güçlü uyumu gösterdi (r = 0.55), büyük dil modellerinden (GPT ve LLaMA gibi) elde edilen gömmeler ve doğrudan GPT‑tabanlı puanlama da orta düzeyde korelasyon gösterdi. Önemli olarak, bu modeller doğal yeniden ifadelendelerle —örneğin bir Çince cümlenin İngilizceyi yeniden düzenleyip anlamı koruması durumunda— daha iyi başa çıktı; kelime örtüşmesine dayanan metrikler bunu yanlışlıkla başarısızlık olarak işaretleyebilirdi. Makine skorlarına göre çevirileri gruplandıran küme analizleri, birkaç metriğin birlikte kullanılmasının düşük, orta ve yüksek kaliteyi insan puanlarına yakın şekilde ayırabildiğini gösterdi.

Gelecekte dil değerlendirmesi için anlamı

Uzman olmayanlar için çıkarım şu: günümüz yapay zekâsı, bir tercümanın bir konuşmayı ne kadar sadık aktardığı konusunda kullanışlı, fakat kusursuz olmayan sinyaller sağlayabiliyor. Anlamı doğrudan karşılaştıran çapraz‑dilli sinir modelleri, sadece referans metinlere karşı paylaşılan kelimeleri saymaktan daha çok insan yargısına yaklaşır ve farklı kelimeleme veya yapı kullanan iyi çevirileri tespit edebilir. Korelasyonlar istatistiksel olarak anlamlı seviyede güçlü olsa da uzman değerlendiricilerin yerini tamamen alacak düzeyde değildir. Bunun yerine çalışma, sinir ağı skorları ile geleneksel metriklerin bir karışımının "düşük riskli" durumlar için hızlı ve düşük maliyetli bir yardımcı olmasını öneriyor: sınıf içi geri bildirim, uygulama oturumları veya geniş çaplı değerlendirmelerde ön eleme gibi. İnsan uzmanlığı yüksek riskli kararlar ve mevcut makinelerin tam olarak yakalayamadığı üslup, bağlam ve etik nüansları yakalamak için hâlâ hayati önemdedir; ancak yapay zekâ tabanlı araçlar, tercüme edilmiş iletişimin sadakatini korumada değerli birer ortak haline gelmeye adaydır.

Atıf: Wang, X., Wang, B. Neural network models vs. MT evaluation metrics: a comparison between two approaches to automated assessment of information fidelity in consecutive interpreting. Humanit Soc Sci Commun 13, 567 (2026). https://doi.org/10.1057/s41599-026-06562-z

Anahtar kelimeler: çeviri kalitesi, bilgi sadakati, sinir ağı değerlendirmesi, makine çevirisi metrikleri, İngilizce–Çince çeviri