Clear Sky Science · pt

Modelos de redes neurais vs. métricas de avaliação de MT: uma comparação entre duas abordagens para avaliação automatizada da fidelidade informacional na interpretação consecutiva

Por que esta pesquisa importa para usuários comuns de língua

Sempre que você escuta um discurso interpretado de uma língua para outra, confia que a mensagem central sobreviveu à transição. Verificar essa “fidelidade” tem dependido há muito de especialistas humanos, o que é lento e caro. Este estudo pergunta se a inteligência artificial moderna pode ajudar a julgar com que precisão um intérprete transmitiu informação, potencialmente tornando os serviços linguísticos mais justos, baratos e mais fáceis de verificar em larga escala.

Entendendo a interpretação fiel

A qualidade da interpretação tem muitas dimensões, mas profissionais concordam amplamente que a fidelidade da informação – quão completa e precisa é a transferência do significado – é a mais importante. Tradicionalmente, especialistas ouvem o discurso original e a versão interpretada, ou comparam a interpretação com uma versão escrita ideal, e então pontuam o quanto as ideias, as ligações entre elas e o tom do orador foram preservados. Esses métodos são ricos e nuançados, mas exigem pessoas altamente treinadas gastando muito tempo reproduzindo gravações, alternando entre línguas e fazendo julgamentos detalhados. Como resultado, avaliações humanas pormenorizadas costumam ser reservadas para exames ou pesquisas, não para treinamento cotidiano e controle de qualidade em grande escala.

Das réguas de tradução a modelos inteligentes

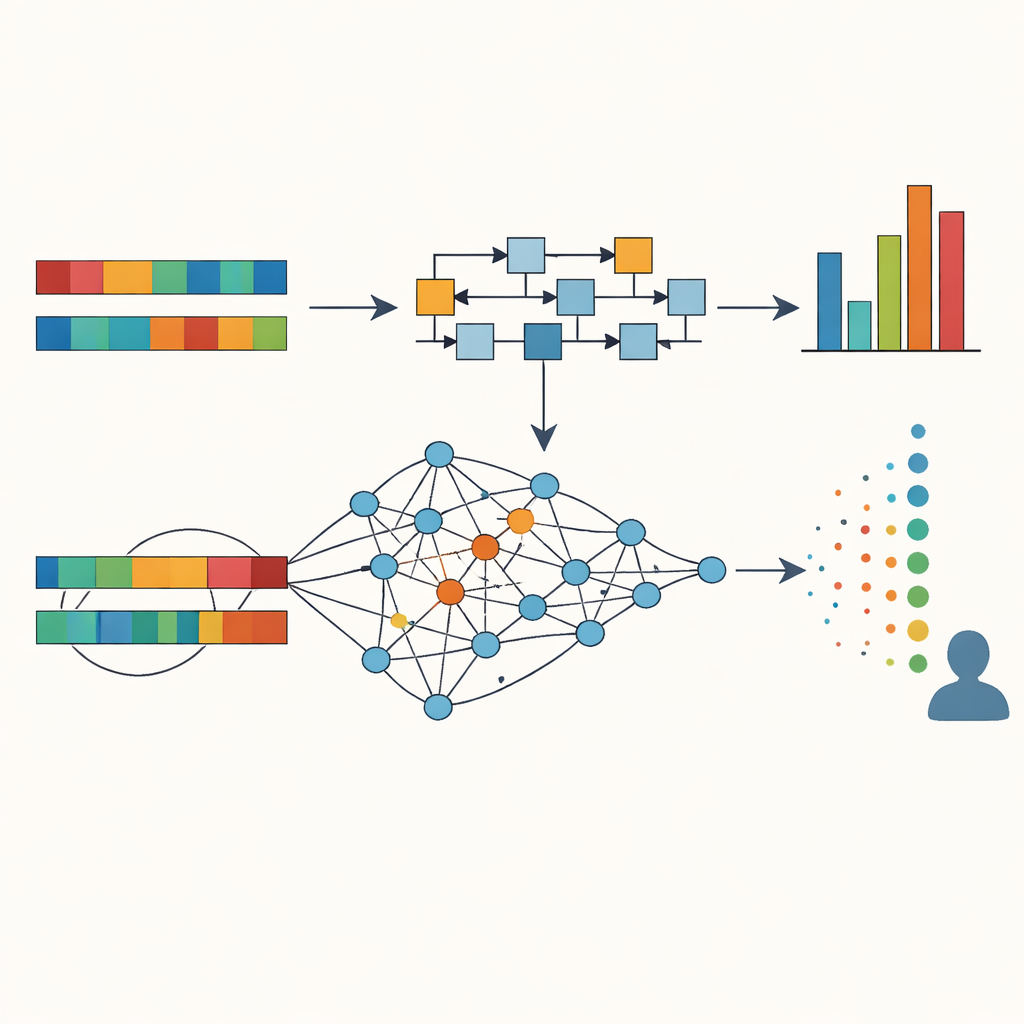

Para aliviar a carga sobre avaliadores humanos, pesquisadores emprestaram ferramentas da tradução automática, em que programas comparam a saída de um sistema com várias traduções humanas de referência. Métricas clássicas como BLEU e METEOR procuram padrões de sobreposição de palavras entre o que foi dito e um conjunto de versões de referência, produzindo uma pontuação numérica. Elas funcionam melhor quando várias traduções de alta qualidade estão disponíveis, mas tais referências são caras de produzir, e a sobreposição palavra a palavra frequentemente perde o quadro maior do significado, especialmente entre línguas estruturalmente diferentes como inglês e chinês.

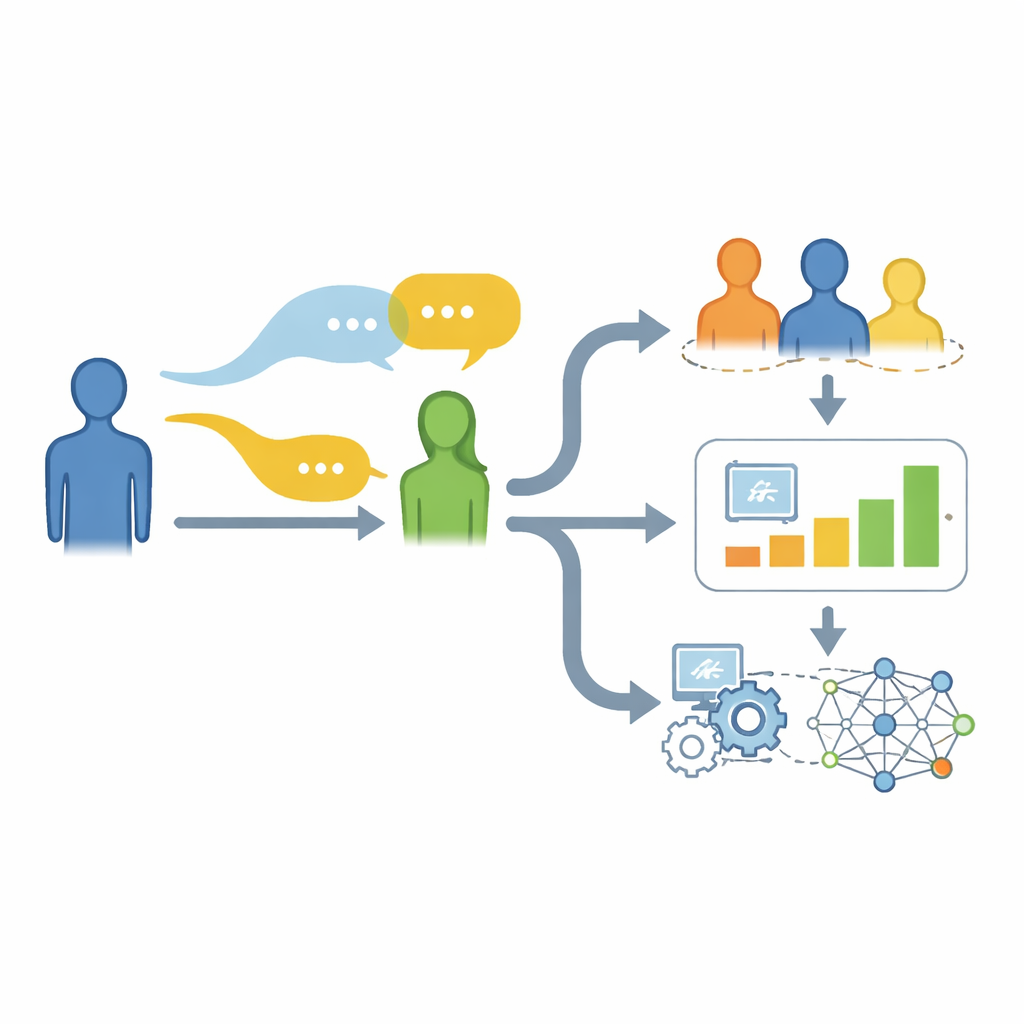

Como o estudo testou humanos e máquinas

Esta pesquisa focou em interpretação consecutiva inglês–chinês por intérpretes em formação. Os autores selecionaram três interpretações amostrais representando qualidade geral alta, média e baixa a partir de um conjunto maior. Transcreveram tanto o discurso original em inglês quanto as interpretações em chinês, removeram muletas verbais e alinharam-os em 94 pares de frases correspondentes. Dois avaliadores experientes então pontuaram cada par quanto à fidelidade – cobrindo ideias principais, como as ideias se conectavam, detalhes de apoio e a atitude e intenção do falante – alcançando concordância muito alta entre si. Em paralelo, os pesquisadores calcularam pontuações automáticas para cada frase usando duas famílias de ferramentas: métricas tradicionais de tradução (BLEU e METEOR, baseadas em múltiplas traduções automáticas revisadas do discurso fonte como referências) e um conjunto de modelos neurais que medem similaridade cross‑lingual diretamente entre a frase em inglês e sua versão interpretada em chinês.

O que as máquinas viram nas interpretações

O estudo comparou as pontuações das máquinas com as avaliações humanas usando correlações estatísticas. Métricas tradicionais mostraram alinhamento moderado: em média, suas pontuações acompanharam razoavelmente bem os julgamentos humanos (por volta de r = 0,45), com a variante mais simples do BLEU tendo desempenho ligeiramente melhor que o METEOR. Abordagens neurais se saíram melhor no geral, especialmente as que transformam frases em línguas diferentes em “embeddings” numéricos compartilhados que capturam o significado. Um modelo multilingue de embeddings de sentenças chamado MUSE mostrou a maior correspondência com as pontuações humanas (r = 0,55), enquanto embeddings de grandes modelos de linguagem como GPT e LLaMA, e pontuações diretas baseadas em GPT, também apresentaram correlações moderadas. Importante: esses modelos lidaram melhor com reformulações naturais, por exemplo quando uma frase chinesa reorganiza uma inglesa mas preserva seu sentido, situação em que métricas de sobreposição de palavras podem sinalizar falsamente uma falha. Análises de cluster, que agruparam interpretações pelas pontuações das máquinas, mostraram que combinar várias métricas podia separar interpretações de baixa, média e alta qualidade de maneiras que ecoaram de perto as avaliações humanas.

O que isso significa para futuras avaliações de língua

Para não especialistas, a conclusão é que a IA atual já pode fornecer sinais úteis, embora não perfeitos, sobre quão fielmente um intérprete transmitiu um discurso. Modelos neurais cross‑linguais que comparam significados diretamente, em vez de apenas contar palavras compartilhadas contra textos de referência, chegam mais perto do julgamento humano e conseguem identificar boas interpretações mesmo quando usam formulações ou estruturas diferentes. As correlações são fortes o bastante para serem estatisticamente significativas, mas não para substituir avaliadores especialistas totalmente. Em vez disso, o estudo sugere usar uma combinação de pontuações neurais e métricas tradicionais como auxílio rápido e de baixo custo em situações de “baixo risco”: feedback em sala de aula, sessões de prática ou triagem preliminar em avaliações em larga escala. A expertise humana continua crucial para decisões de alto risco e para captar nuances de estilo, contexto e ética que as máquinas atuais não conseguem abarcar por completo, mas ferramentas baseadas em IA estão prontas para se tornar parceiras valiosas na salvaguarda da fidelidade da comunicação interpretada.

Citação: Wang, X., Wang, B. Neural network models vs. MT evaluation metrics: a comparison between two approaches to automated assessment of information fidelity in consecutive interpreting. Humanit Soc Sci Commun 13, 567 (2026). https://doi.org/10.1057/s41599-026-06562-z

Palavras-chave: qualidade da interpretação, fidelidade da informação, avaliação por redes neurais, métricas de tradução automática, interpretação inglês–chinês