Clear Sky Science · pl

Modele sieci neuronowych kontra metryki MT: porównanie dwóch podejść do automatycznej oceny wierności informacji w tłumaczeniu konsekutywnym

Dlaczego to badanie ma znaczenie dla zwykłych użytkowników języka

Kiedy słuchasz przemówienia tłumaczonego z jednego języka na drugi, zakładasz, że zasadniczy przekaz przetrwał tę podróż. Sprawdzenie tej „wierności” od dawna zależało od ekspertów‑ludzi, co jest czasochłonne i kosztowne. W badaniu pytano, czy nowoczesna sztuczna inteligencja może pomóc ocenić, jak dokładnie tłumacz ustny przekazał informacje, co potencjalnie uczyniłoby usługi językowe sprawiedliwszymi, tańszymi i łatwiejszymi do kontroli jakości na szeroką skalę.

Rozumienie wiernego tłumaczenia ustnego

Jakość tłumaczenia ustnego ma wiele wymiarów, lecz specjaliści w przeważającej większości zgadzają się, że najważniejsza jest wierność informacji – jak kompletne i precyzyjne jest przeniesienie sensu. Tradycyjnie eksperci słuchają oryginalnego przemówienia i wersji tłumaczonej albo porównują interpretację z wzorcową wersją pisemną, a następnie oceniają, jak dobrze zachowano główne idee, powiązania między nimi oraz ton mówcy. Metody te są bogate i wielowymiarowe, ale wymagają wysoko wykwalifikowanych osób, które poświęcają dużo czasu na odtwarzanie nagrań, przełączanie się między językami i dokonywanie drobiazgowych ocen. W efekcie szczegółowe oceny ludzkie są zwykle zarezerwowane dla egzaminów lub badań, a nie dla codziennego szkolenia czy kontroli jakości na dużą skalę.

Od miar tłumaczeń do inteligentnych modeli

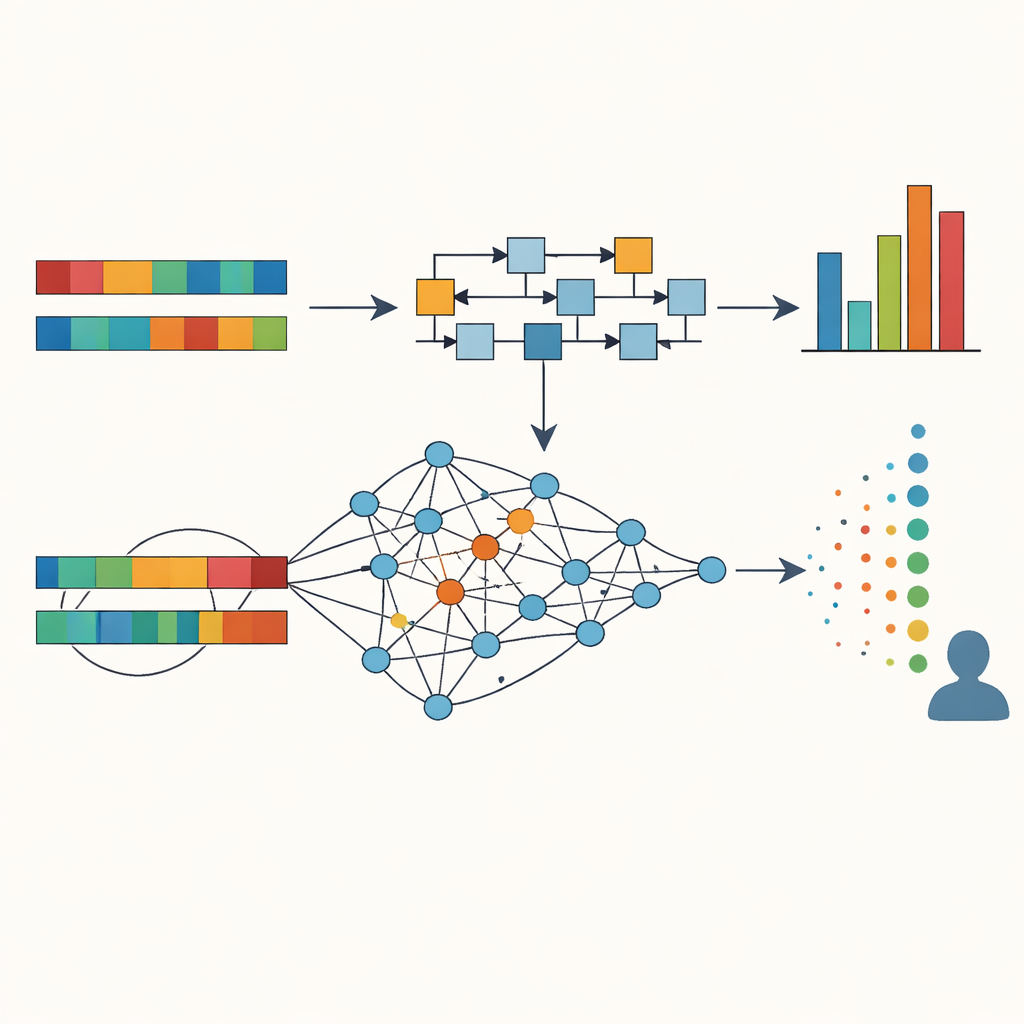

Aby odciążyć ludzkich oceniających, badacze zapożyczyli narzędzia z tłumaczeń maszynowych, gdzie programy komputerowe porównują wynik systemu z kilkoma zaufanymi tłumaczeniami ludzkimi. Klasyczne metryki, takie jak BLEU i METEOR, szukają nakładających się wzorców słów między tym, co zostało powiedziane, a zestawem wersji referencyjnych, generując wynik liczbowy. Działają najlepiej, gdy dostępnych jest kilka wysokiej jakości tłumaczeń referencyjnych, lecz ich przygotowanie jest kosztowne, a dopasowanie słowo w słowo często nie uchwyci szerszego sensu, zwłaszcza przy językach o odmiennej strukturze, jak angielski i chiński.

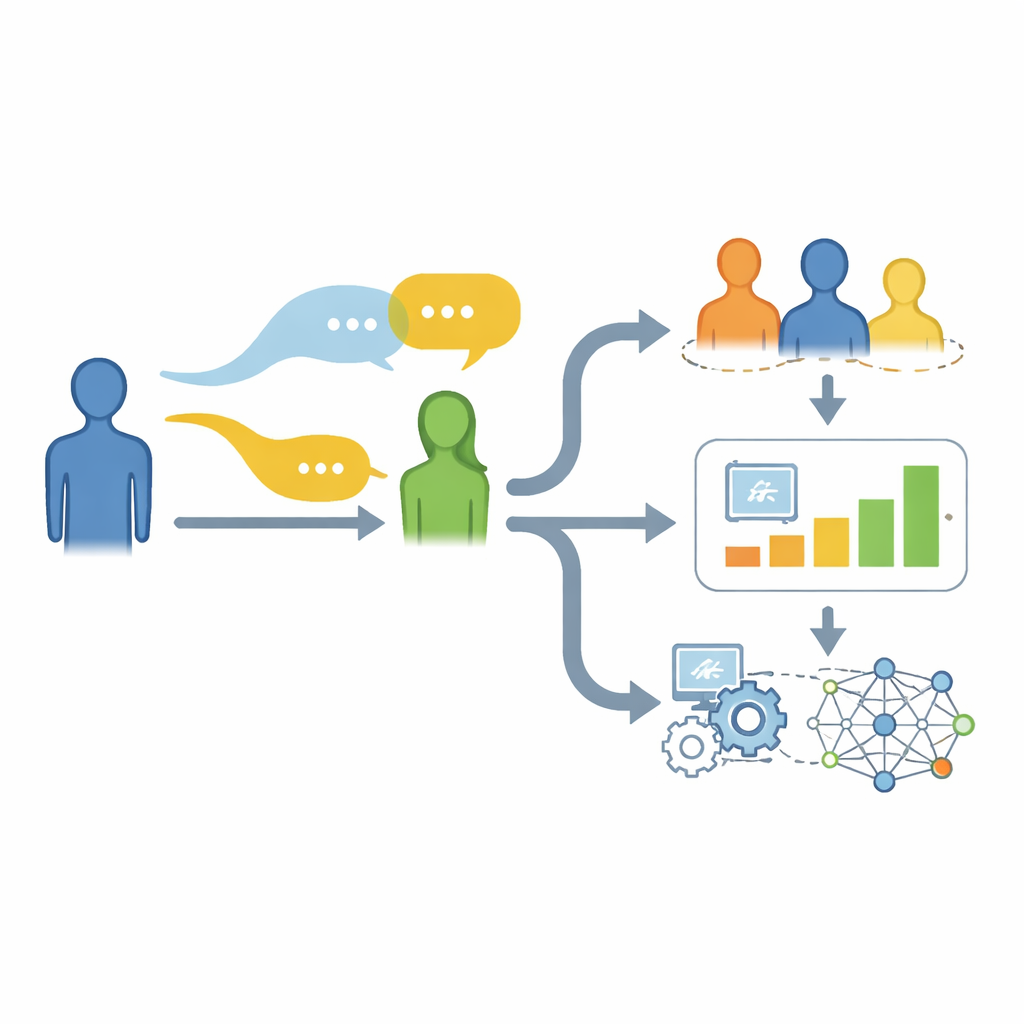

Jak badanie porównało ludzi i maszyny

Badanie skupiło się na tłumaczeniu konsekutywnym angielsko‑chińskim wykonywanym przez tłumaczy w trakcie szkolenia. Autorzy wybrali trzy przykładowe interpretacje reprezentujące wysoką, średnią i niską jakość z większej puli. Transkrybowali zarówno oryginalne przemówienie w języku angielskim, jak i chińskie interpretacje, usunęli wypełniacze i dopasowali je do 94 odpowiadających sobie par zdań. Dwóch doświadczonych oceniających następnie punktowało każdą parę pod względem wierności – obejmującej główne idee, powiązania między nimi, informacje uzupełniające oraz postawę i intencję mówcy – osiągając bardzo wysoką zgodność między sobą. Równolegle badacze obliczyli automatyczne oceny dla każdego zdania, używając dwóch rodzin narzędzi: tradycyjnych metryk tłumaczeniowych (BLEU i METEOR, bazujących na wielokrotnie zrewidowanych tłumaczeniach maszynowych mowy źródłowej jako referencjach) oraz zestawu modeli neuronowych mierzących semantyczne podobieństwo między zdaniem angielskim a jego chińską wersją.

Co maszyny „zobaczyły” w interpretacjach

Badanie porównało wyniki maszynowe z ocenami ludzkimi za pomocą korelacji statystycznych. Tradycyjne metryki wykazały umiarkowaną zgodność: ich wyniki w średnim stopniu odzwierciedlały oceny ludzi (około r = 0,45), przy czym najprostsza odmiana BLEU wypadła nieco lepiej niż METEOR. Podejścia neuronowe radziły sobie lepiej ogólnie, zwłaszcza te, które zamieniają zdania w różnych językach na wspólne numeryczne „osadzenia” (embeddings) uchwytujące znaczenie. Wielojęzyczny model osadzeń zdaniowych o nazwie MUSE wykazał najsilniejsze dopasowanie do ocen ludzkich (r = 0,55), podczas gdy osadzenia z dużych modeli językowych takich jak GPT i LLaMA oraz bezpośrednie oceny oparte na GPT również korelowały umiarkowanie dobrze. Co ważne, modele te lepiej radziły sobie z naturalnymi parafrazami, np. gdy chińskie zdanie reorganizowało angielskie, lecz zachowywało sens — w sytuacjach, w których metryki oparte na pokrywaniu się słów mogły fałszywie sygnalizować błąd. Analizy klastrowe, grupujące interpretacje według wyników maszynowych, pokazały, że łączenie kilku metryk pozwalało rozróżnić niską, średnią i wysoką jakość interpretacji w sposób zbliżony do ocen ludzkich.

Co to oznacza dla przyszłej oceny językowej

Dla nietechnicznych odbiorców wniosek jest taki, że dzisiejsza AI potrafi już dostarczać użyteczne, choć nie idealne, sygnały o tym, jak wiernie tłumacz ustny przekazał przemówienie. Modelom neuronowym porównującym znaczenia bezpośrednio, zamiast jedynie liczyć wspólne słowa względem tekstów referencyjnych, najbliżej do ocen ludzkich i potrafią rozpoznać dobre interpretacje nawet przy odmiennym doborze słów czy strukturze. Korelacje są na tyle silne, by miały znaczenie statystyczne, ale niewystarczające, by całkowicie zastąpić ekspertów. Zamiast tego badanie sugeruje użycie mieszanki wyników neuronowych i tradycyjnych metryk jako szybkiej, niskokosztowej pomocy w sytuacjach o niskiej stawce: informacje zwrotne w klasie, sesje ćwiczeniowe czy wstępne przesiewy przy ocenach na dużą skalę. Ekspertyza ludzka pozostaje kluczowa w decyzjach o wysokiej stawce oraz przy uchwyceniu niuansów stylu, kontekstu i etyki, których obecne maszyny nie są w stanie w pełni objąć, lecz narzędzia oparte na AI mają potencjał stać się wartościowymi partnerami w dbaniu o wierność komunikacji tłumaczonej.

Cytowanie: Wang, X., Wang, B. Neural network models vs. MT evaluation metrics: a comparison between two approaches to automated assessment of information fidelity in consecutive interpreting. Humanit Soc Sci Commun 13, 567 (2026). https://doi.org/10.1057/s41599-026-06562-z

Słowa kluczowe: jakość tłumaczenia ustnego, wierność informacji, ocena przy użyciu sieci neuronowych, metryki tłumaczeń maszynowych, tłumaczenie angielsko‑chińskie