Clear Sky Science · fr

Modèles de réseaux neuronaux vs. métriques d’évaluation MT : comparaison de deux approches d’évaluation automatisée de la fidélité de l’information en interprétation consécutive

Pourquoi cette recherche compte pour les utilisateurs quotidiens de langues

Chaque fois que vous écoutez un discours interprété d’une langue à une autre, vous supposez que le message essentiel a survécu à la transformation. Vérifier cette « fidélité » a longtemps dépendu d’experts humains, ce qui est lent et coûteux. Cette étude se demande si l’intelligence artificielle moderne peut aider à juger dans quelle mesure un interprète a fidèlement transmis l’information, ouvrant la voie à des services linguistiques plus équitables, moins chers et plus faciles à contrôler à grande échelle.

Comprendre l’interprétation fidèle

La qualité de l’interprétation a de nombreuses dimensions, mais les professionnels s’accordent largement à dire que la fidélité de l’information — à quel point le sens est rendu complètement et précisément — est la plus importante. Traditionnellement, des experts écoutent le discours original et la version interprétée, ou comparent l’interprétation à une version écrite de référence, puis évaluent dans quelle mesure les idées, les liens entre elles et le ton du locuteur ont été préservés. Ces méthodes sont riches et nuancées, mais elles exigent des personnes hautement qualifiées qui passent beaucoup de temps à réécouter des enregistrements, à basculer entre les langues et à porter des jugements fins. En conséquence, l’évaluation humaine détaillée est généralement réservée aux examens ou à la recherche, et non à la formation quotidienne ou au contrôle qualité à grande échelle.

Des étalons de traduction aux modèles intelligents

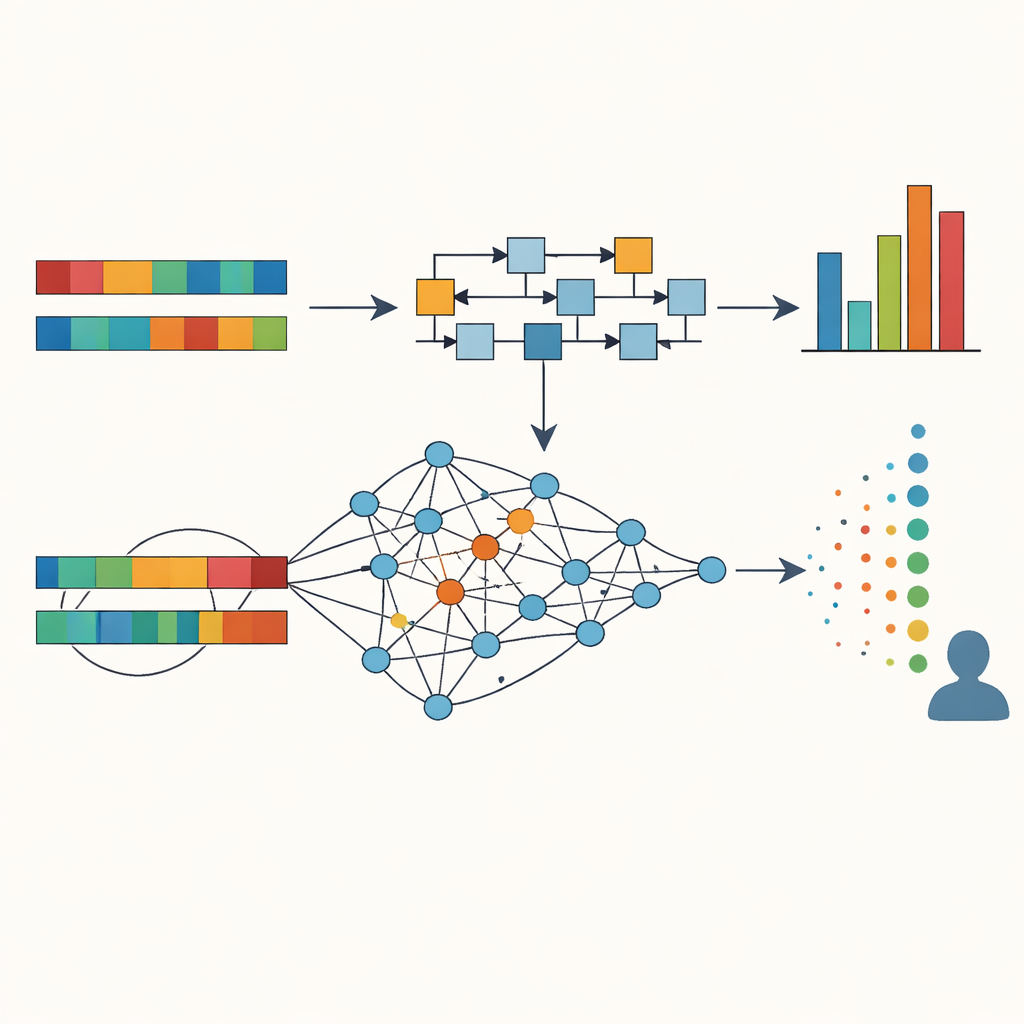

Pour alléger la charge des évaluateurs humains, les chercheurs ont emprunté des outils à la traduction automatique, où des programmes comparent la sortie d’un système à plusieurs traductions humaines de référence. Des métriques classiques comme BLEU et METEOR recherchent des recouvrements de séquences de mots entre ce qui a été dit et un ensemble de références, produisant un score numérique. Elles fonctionnent mieux lorsqu’il existe plusieurs traductions de haute qualité, mais ces références sont coûteuses à produire, et le simple recoupement mot à mot rate souvent l’essentiel du sens, surtout entre des langues structurellement différentes comme l’anglais et le chinois.

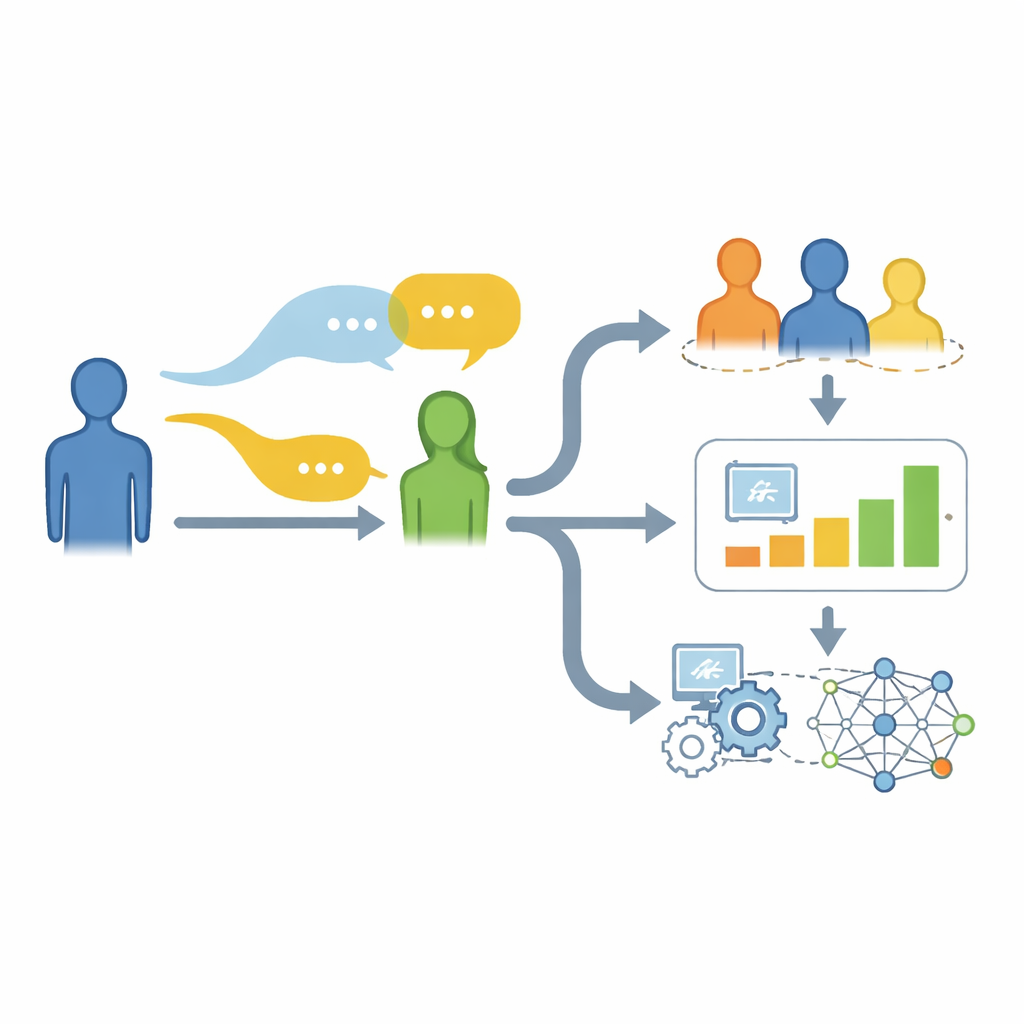

Comment l’étude a mis humains et machines à l’épreuve

Cette recherche s’est concentrée sur l’interprétation consécutive anglais–chinois réalisée par des stagiaires interprètes. Les auteurs ont sélectionné trois interprétations exemples représentant une qualité globale élevée, moyenne et faible à partir d’un corpus plus large. Ils ont transcrit le discours original en anglais et les interprétations en chinois, nettoyé les mots‑parasites, et aligné le tout en 94 paires de phrases correspondantes. Deux évaluateurs expérimentés ont ensuite noté chaque paire pour la fidélité — couvrant les idées principales, les liens logiques, les détails secondaires et l’attitude et l’intention du locuteur — obtenant un très haut niveau d’accord entre eux. En parallèle, les chercheurs ont calculé des scores automatiques pour chaque phrase en utilisant deux familles d’outils : des métriques de traduction traditionnelles (BLEU et METEOR, basées sur plusieurs traductions machines révisées du discours source comme références) et un ensemble de modèles neuronaux mesurant directement la similarité cross‑lingue entre la phrase anglaise et sa version chinoise interprétée.

Ce que les machines ont perçu dans les interprétations

L’étude a comparé les scores machine aux évaluations humaines au moyen de corrélations statistiques. Les métriques traditionnelles montraient un alignement modéré : en moyenne, leurs scores suivaient raisonnablement bien les jugements humains (aux alentours de r = 0,45), la variante la plus simple de BLEU faisant légèrement mieux que METEOR. Les approches neuronales ont mieux performé dans l’ensemble, en particulier celles qui transforment des phrases de langues différentes en « embeddings » numériques partagés capturant le sens. Un modèle multilingue d’embeddings de phrases appelé MUSE a montré la concordance la plus forte avec les scores humains (r = 0,55), tandis que des embeddings issus de grands modèles de langage comme GPT et LLaMA, ainsi qu’une notation directe basée sur GPT, corrélaient aussi modérément. Fait important, ces modèles ont mieux géré les reformulations naturelles — par exemple lorsqu’une phrase chinoise réorganise une phrase anglaise tout en en conservant le sens — là où les métriques basées sur le recouvrement de mots pouvaient faussement signaler un échec. Des analyses par clusters, regroupant les interprétations selon leurs scores machine, ont montré que la combinaison de plusieurs métriques pouvait séparer les interprétations de faible, moyenne et haute qualité d’une manière qui reflétait étroitement les évaluations humaines.

Ce que cela signifie pour l’évaluation linguistique future

Pour les non‑spécialistes, la conclusion est que l’IA d’aujourd’hui peut déjà fournir des indicateurs utiles, bien que non parfaits, de la fidélité d’une interprétation. Les modèles neuronaux cross‑lingues qui comparent directement le sens, plutôt que de compter les mots partagés par rapport à des textes de référence, se rapprochent le plus du jugement humain et peuvent repérer de bonnes interprétations même lorsqu’elles utilisent des formulations ou des structures différentes. Les corrélations sont suffisamment fortes pour être significatives sur le plan statistique, mais pas pour remplacer totalement les évaluateurs experts. L’étude suggère plutôt d’utiliser un mélange de scores neuronaux et de métriques traditionnelles comme aide rapide et peu coûteuse pour des situations à faible enjeu : retours en classe, séances d’entraînement ou présélection dans des évaluations à grande échelle. L’expertise humaine reste cruciale pour les décisions à fort enjeu et pour saisir les nuances de style, de contexte et d’éthique que les machines actuelles ne maîtrisent pas entièrement, mais les outils basés sur l’IA sont prêts à devenir des partenaires précieux pour préserver la fidélité de la communication interprétée.

Citation: Wang, X., Wang, B. Neural network models vs. MT evaluation metrics: a comparison between two approaches to automated assessment of information fidelity in consecutive interpreting. Humanit Soc Sci Commun 13, 567 (2026). https://doi.org/10.1057/s41599-026-06562-z

Mots-clés: qualité de l’interprétation, fidélité de l’information, évaluation par réseaux neuronaux, métriques de traduction automatique, interprétation anglais–chinois