Clear Sky Science · de

Neuronale Netzwerkmodelle vs. MT‑Bewertungsmetriken: ein Vergleich zweier Ansätze zur automatisierten Bewertung der Informations‑Treue bei konsekutiver Verdolmetschung

Warum diese Forschung für Alltagsnutzer von Sprache wichtig ist

Jedes Mal, wenn Sie eine Rede hören, die von einer Sprache in eine andere gedolmetscht wurde, vertrauen Sie darauf, dass die Kernbotschaft die Übertragung überstanden hat. Die Überprüfung dieser "Treue" beruhte lange Zeit auf Experten‑Menschen, was langsam und teuer ist. Diese Studie untersucht, ob moderne künstliche Intelligenz dabei helfen kann zu beurteilen, wie genau ein Dolmetscher Informationen vermittelt hat — mit dem Potenzial, Sprachdienste gerechter, günstiger und leichter in großem Maßstab qualitätsgeprüft zu machen.

Was treues Dolmetschen ausmacht

Die Qualität des Dolmetschens hat viele Dimensionen, doch Fachleute sind sich weitgehend einig, dass Informations‑Treue – also wie vollständig und akkurat die Bedeutung übertragen wird – die wichtigste ist. Traditionell hören Experten die Originalrede und die Verdolmetschung oder vergleichen die Interpretation mit einer idealen schriftlichen Version und bewerten dann, wie gut Ideen, Verknüpfungen zwischen Ideen und die Tonalität des Sprechers erhalten geblieben sind. Diese Methoden sind inhaltlich reich und nuanciert, benötigen jedoch hochqualifizierte Personen, die viel Zeit damit verbringen, Aufnahmen mehrfach anzuhören, zwischen Sprachen zu wechseln und fein abgestufte Urteile zu fällen. Deshalb werden detaillierte menschliche Bewertungen meist für Prüfungen oder Forschung eingesetzt, nicht für den alltäglichen Unterricht oder großflächige Qualitätskontrollen.

Von Übersetzungsmaßstäben zu intelligenten Modellen

Um die Belastung für menschliche Bewerter zu verringern, haben Forscher Werkzeuge aus der maschinellen Übersetzung übernommen, wo Computerprogramme die Ausgabe eines Systems mit mehreren vertrauenswürdigen menschlichen Übersetzungen vergleichen. Klassische Metriken wie BLEU und METEOR suchen nach überlappenden Wortmustern zwischen dem Gesagten und einer Reihe von Referenzversionen und liefern eine numerische Bewertung. Sie funktionieren am besten, wenn mehrere hochwertige Referenzübersetzungen vorliegen, doch solche Referenzen sind teuer herzustellen, und eine Wort‑für‑Wort‑Übereinstimmung verfehlt oft das größere Bedeutungsbild, insbesondere zwischen strukturell unterschiedlichen Sprachen wie Englisch und Chinesisch.

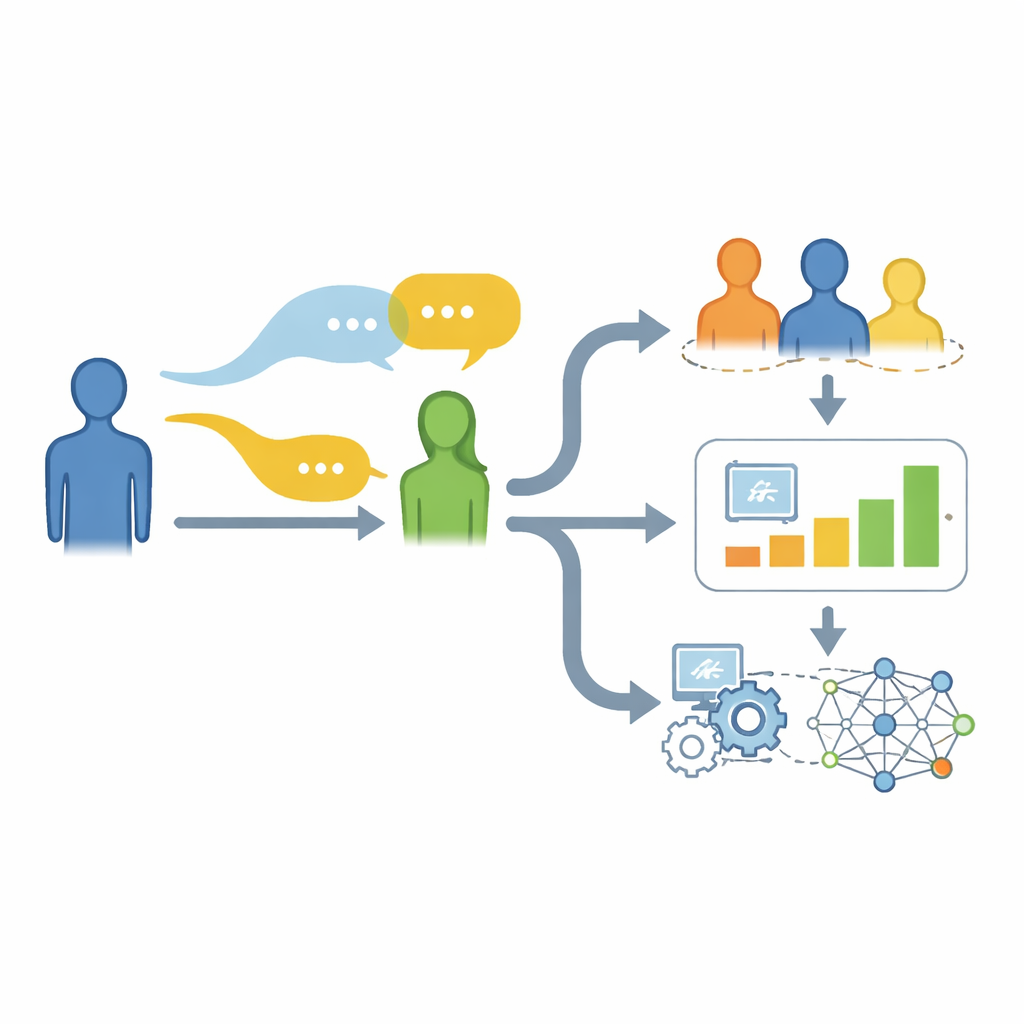

Wie die Studie Menschen und Maschinen prüfte

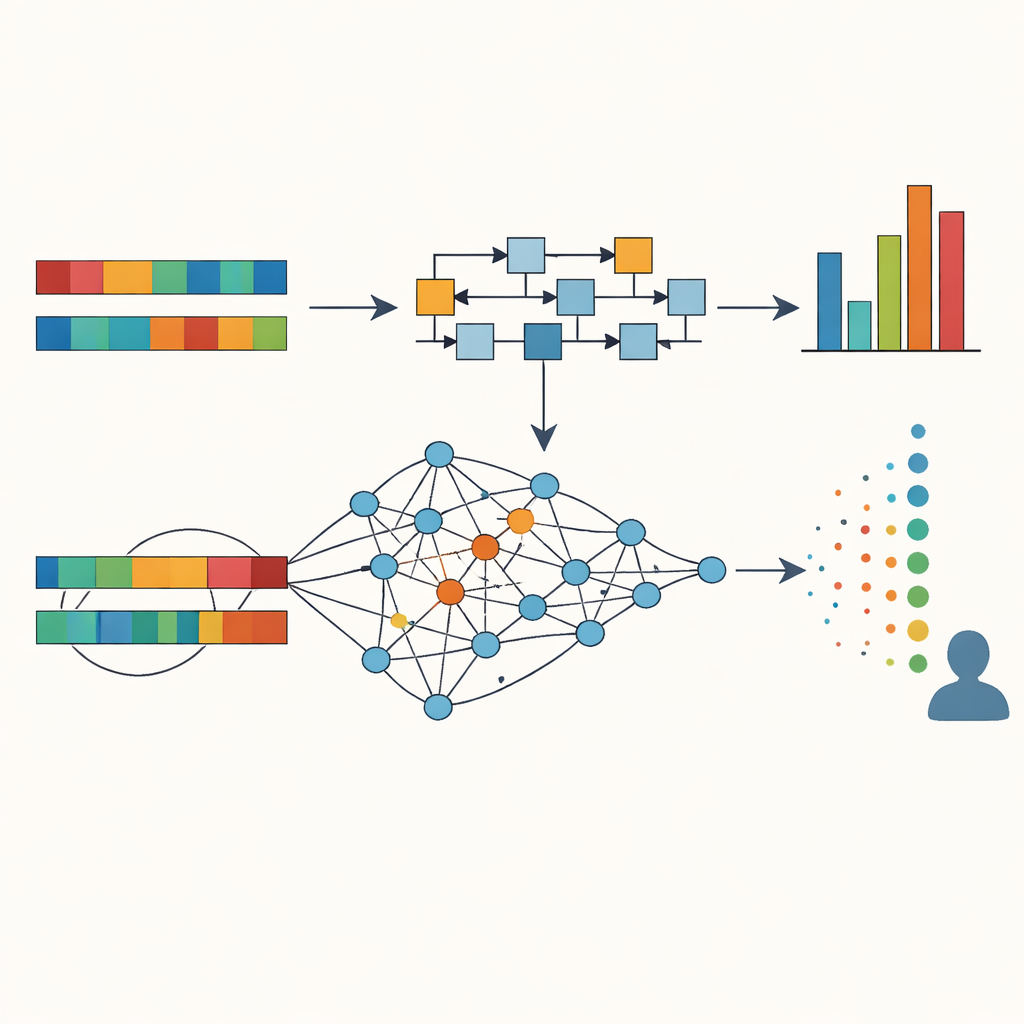

Die Forschung konzentrierte sich auf Englisch–Chinesisch‑Konsekutivdolmetschen durch Dolmetsch‑Trainees. Die Autoren wählten drei Interpretationen als Beispiele aus einem größeren Pool aus, die insgesamt hohe, mittlere und niedrige Qualität repräsentierten. Sie transkribierten sowohl die ursprüngliche englische Rede als auch die chinesischen Interpretationen, entfernten Füllwörter und ordneten sie in 94 passende Satzpaare. Zwei erfahrene Bewerter bewerteten dann jedes Paar hinsichtlich Treue – wobei Hauptideen, Verknüpfungen zwischen Ideen, unterstützende Details und die Haltung und Absicht des Sprechers beurteilt wurden – und erzielten dabei sehr hohe Übereinstimmung. Parallel berechneten die Forscher automatische Scores für jeden Satz mit zwei Werkzeuggattungen: traditionellen Übersetzungsmetriken (BLEU und METEOR, basierend auf mehreren überarbeiteten maschinellen Übersetzungen der Ausgangsrede als Referenzen) und einer Reihe neuronaler Modelle, die die cross‑linguale Ähnlichkeit direkt zwischen dem englischen Satz und seiner chinesischen Interpretation messen.

Was die Maschinen in den Interpretationen erkannten

Die Studie verglich Maschinenbewertungen mit den menschlichen Ratings mittels statistischer Korrelationen. Traditionelle Metriken zeigten eine moderate Übereinstimmung: Im Durchschnitt korrelierten ihre Werte einigermaßen gut mit menschlichen Urteilen (etwa r = 0,45), wobei die einfachste BLEU‑Variante leicht besser abschnitt als METEOR. Neuronale Ansätze schnitten insgesamt besser ab, besonders solche, die Sätze in verschiedenen Sprachen in gemeinsame numerische "Embeddings" übersetzen, welche die Bedeutung erfassen. Ein multilingualer Satz‑Embedding‑Modell namens MUSE zeigte die stärkste Übereinstimmung mit den menschlichen Bewertungen (r = 0,55), während Embeddings aus großen Sprachmodellen wie GPT und LLaMA sowie direkte GPT‑basierte Bewertungen ebenfalls moderat korrelierten. Wichtig ist, dass diese Modelle besser mit natürlicher Umformulierung zurechtkamen, etwa wenn ein chinesischer Satz einen englischen Satz umorganisierte, aber dessen Sinn bewahrte, wo Wort‑Überlappungsmetriken fälschlich ein Versagen signalisieren könnten. Clusteranalysen, die Interpretationen nach ihren Maschinenwerten gruppierten, zeigten, dass die Kombination mehrerer Metriken niedrige, mittlere und hohe Qualitätsstufen trennen konnte — in einer Weise, die den menschlichen Bewertungen nahekam.

Was das für künftige Sprachbewertungen bedeutet

Für Nicht‑Spezialisten lautet die Botschaft: Die heutige KI kann bereits nützliche, wenn auch nicht perfekte, Hinweise darauf geben, wie treu ein Dolmetscher eine Rede wiedergegeben hat. Cross‑linguale neuronale Modelle, die Bedeutungen direkt vergleichen statt nur gemeinsame Wörter gegen Referenztexte zu zählen, kommen menschlichen Urteilen am nächsten und erkennen gute Interpretationen auch dann, wenn unterschiedliche Formulierungen oder Strukturen verwendet werden. Die Korrelationen sind statistisch bedeutsam, jedoch nicht so stark, dass sie Expertenbewertungen vollständig ersetzen könnten. Stattdessen empfiehlt die Studie, eine Mischung aus neuronalen Scores und traditionellen Metriken als schnelles, kostengünstiges Hilfsmittel in "gering‑riskanten" Situationen zu nutzen: Rückmeldungen im Unterricht, Übungssitzungen oder Vor‑Screenings bei groß angelegten Bewertungen. Menschliche Expertise bleibt für Entscheidungen mit hohem Risiko sowie zum Erfassen von Stil‑, Kontext‑ und Ethiknuancen, die heutige Maschinen nicht vollständig abbilden können, entscheidend; zugleich sind KI‑gestützte Werkzeuge gut positioniert, wertvolle Partner beim Schutz der Treue von verdolmetschter Kommunikation zu werden.

Zitation: Wang, X., Wang, B. Neural network models vs. MT evaluation metrics: a comparison between two approaches to automated assessment of information fidelity in consecutive interpreting. Humanit Soc Sci Commun 13, 567 (2026). https://doi.org/10.1057/s41599-026-06562-z

Schlüsselwörter: Dolmetschqualität, Informations‑Treue, Bewertung durch neuronale Netze, Maschinenübersetzungs‑Metriken, Englisch–Chinesisch‑Dolmetschen