Clear Sky Science · it

Modelli di reti neurali vs. metriche di valutazione MT: un confronto tra due approcci per la valutazione automatizzata della fedeltà informativa nell’interpretazione consecutiva

Perché questa ricerca è rilevante per gli utenti linguistici di tutti i giorni

Ogni volta che ascolti un discorso interpretato da una lingua a un’altra, dai per scontato che il nucleo del messaggio sia rimasto intatto. Verificare questa «fedeltà» è a lungo spettato a esperti umani, un processo lento e costoso. Questo studio si chiede se l’intelligenza artificiale moderna possa aiutare a giudicare quanto accuratamente un interprete ha trasmesso le informazioni, rendendo potenzialmente i servizi linguistici più equi, meno dispendiosi e più facili da verificare su larga scala.

Comprendere l’interpretazione fedele

La qualità dell’interpretazione ha molte dimensioni, ma i professionisti concordano in larga misura che la fedeltà informativa — quanto compiutamente e accuratamente il significato viene trasferito — sia la più importante. Tradizionalmente, gli esperti ascoltano il discorso originale e la versione interpretata, oppure confrontano l’interpretazione con una versione scritta ideale, quindi valutano quanto bene idee, legami tra idee e il tono del parlante siano stati preservati. Questi metodi sono ricchi e sfumati, ma richiedono persone altamente formate che dedichino molto tempo a riascoltare registrazioni, passare da una lingua all’altra e formulare giudizi dettagliati. Di conseguenza, la valutazione umana approfondita è generalmente riservata a esami o ricerca, non alla formazione quotidiana e al controllo qualità su larga scala.

Dai criteri per la traduzione ai modelli intelligenti

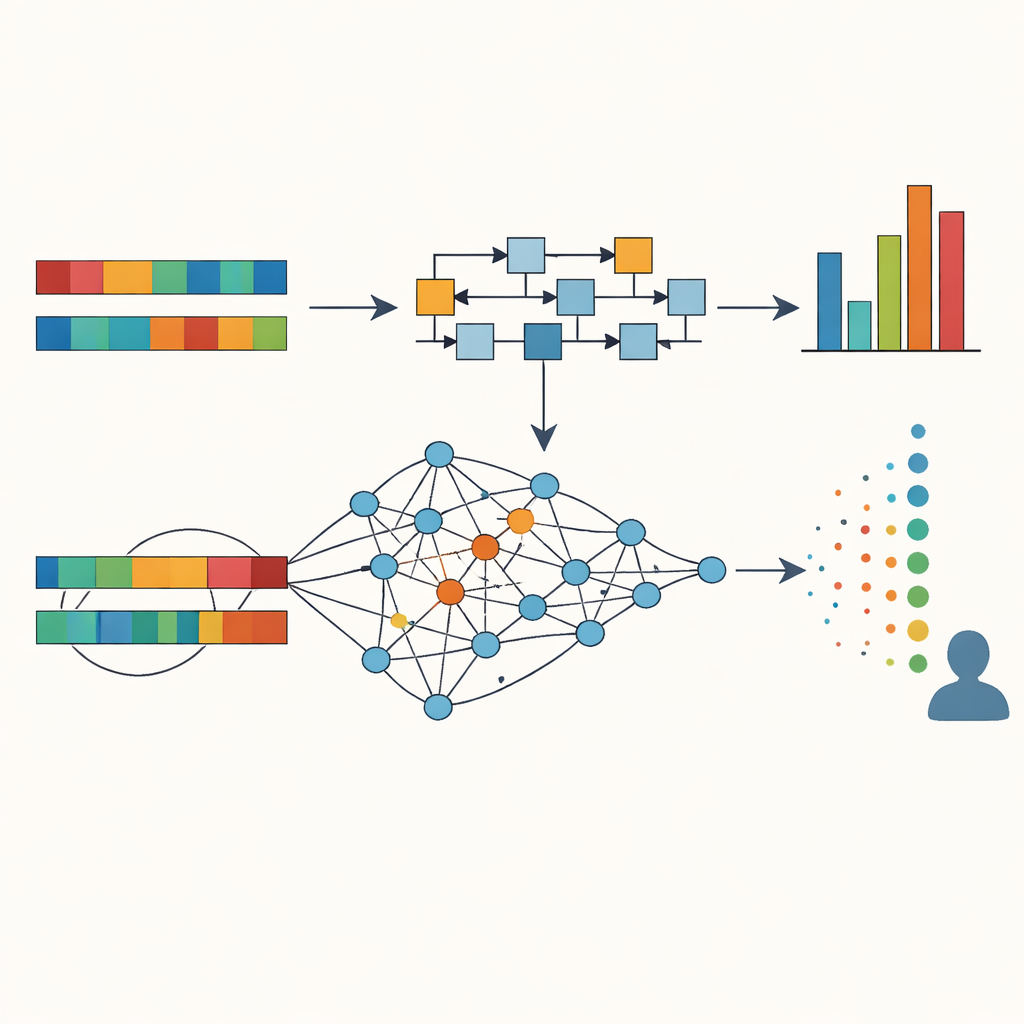

Per alleggerire il carico sui valutatori umani, i ricercatori hanno preso in prestito strumenti dalla traduzione automatica, dove i programmi confrontano l’output di un sistema con diverse traduzioni umane di riferimento. Metriche classiche come BLEU e METEOR cercano corrispondenze di pattern lessicali tra quanto è stato detto e un insieme di versioni di riferimento, producendo un punteggio numerico. Funzionano meglio quando sono disponibili più traduzioni di riferimento di alta qualità, ma tali riferimenti sono costosi da produrre, e la sovrapposizione parola per parola spesso perde il quadro più ampio del significato, specialmente tra lingue strutturalmente diverse come inglese e cinese.

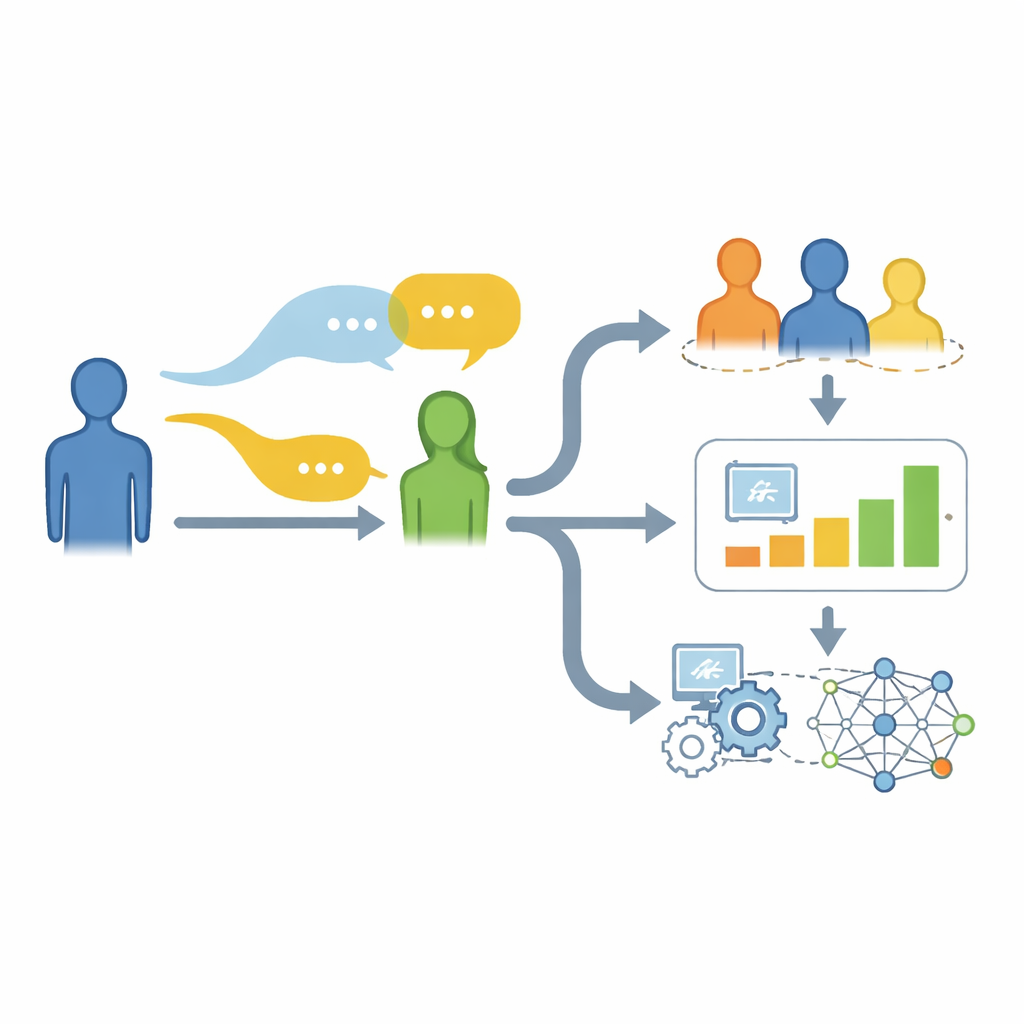

Come lo studio ha messo alla prova umani e macchine

La ricerca si è concentrata sull’interpretazione consecutiva inglese–cinese effettuata da interpreti in formazione. Gli autori hanno selezionato tre interpretazioni campione rappresentative di qualità complessiva alta, media e bassa da un pool più ampio. Hanno trascritto sia il discorso originale in inglese sia le interpretazioni in cinese, rimosso riempitivi e allineato il materiale in 94 coppie di frasi corrispondenti. Due valutatori esperti hanno quindi assegnato a ciascuna coppia un punteggio di fedeltà — coprendo idee principali, legami tra le idee, dettagli di supporto e l’atteggiamento e l’intento del parlante — ottenendo un accordo molto elevato tra loro. Parallelamente, i ricercatori hanno calcolato punteggi automatici per ogni frase usando due famiglie di strumenti: metriche tradizionali per la traduzione (BLEU e METEOR, basate su più traduzioni automatiche riviste del discorso di partenza come riferimenti) e una serie di modelli neurali che misurano direttamente la similarità cross‑linguistica tra la frase inglese e la sua versione interpretata in cinese.

Cosa hanno visto le macchine nelle interpretazioni

Lo studio ha confrontato i punteggi delle macchine con le valutazioni umane tramite correlazioni statistiche. Le metriche tradizionali hanno mostrato un allineamento moderato: in media i loro punteggi seguivano ragionevolmente i giudizi umani (circa r = 0,45), con la variante più semplice di BLEU leggermente migliore di METEOR. Gli approcci neurali hanno dato risultati migliori nel complesso, soprattutto quelli che trasformano frasi in lingue diverse in «embedding» numerici condivisi che catturano il significato. Un modello multilingue di sentence‑embedding chiamato MUSE ha mostrato la corrispondenza più forte con i punteggi umani (r = 0,55), mentre gli embedding derivati da grandi modelli linguistici come GPT e LLaMA, e la valutazione diretta basata su GPT, hanno mostrato correlazioni moderate. È importante che questi modelli abbiano gestito meglio la riformulazione naturale, ad esempio quando una frase cinese riorganizza una frase inglese ma ne conserva il senso, situazioni in cui le metriche basate sulla sovrapposizione di parole possono segnalare erroneamente un fallimento. Analisi di clustering, che hanno raggruppato le interpretazioni secondo i punteggi automatici, hanno mostrato che combinare diverse metriche può separare interpretazioni di qualità bassa, media e alta in modo molto vicino ai giudizi umani.

Cosa significa per la valutazione linguistica futura

Per i non specialisti, la conclusione è che l’IA odierna può già offrire segnali utili, seppure non perfetti, su quanto fedelmente un interprete ha trasmesso un discorso. I modelli neurali cross‑lingua che confrontano direttamente i significati, invece di contare solo parole condivise rispetto a testi di riferimento, si avvicinano di più al giudizio umano e riescono a individuare buone interpretazioni anche quando sono espresse con parole o strutture diverse. Le correlazioni sono abbastanza forti da essere statisticamente significative, ma non tali da sostituire del tutto i valutatori esperti. Lo studio suggerisce invece di usare un mix di punteggi neurali e metriche tradizionali come strumento rapido e a basso costo per situazioni a basso rischio: feedback in aula, sessioni di pratica o screening preliminare in valutazioni su larga scala. L’esperienza umana rimane cruciale per decisioni ad alta posta in gioco e per cogliere sfumature di stile, contesto ed etica che le macchine attuali non possono pienamente comprendere, ma gli strumenti basati su IA sono pronti a diventare partner preziosi nella tutela della fedeltà della comunicazione interpretata.

Citazione: Wang, X., Wang, B. Neural network models vs. MT evaluation metrics: a comparison between two approaches to automated assessment of information fidelity in consecutive interpreting. Humanit Soc Sci Commun 13, 567 (2026). https://doi.org/10.1057/s41599-026-06562-z

Parole chiave: qualità dell’interpretazione, fedeltà informativa, valutazione con reti neurali, metriche per la traduzione automatica, interpretazione inglese–cinese