Clear Sky Science · es

Modelos de redes neuronales frente a métricas de evaluación de MT: una comparación entre dos enfoques para la valoración automatizada de la fidelidad informativa en interpretación consecutiva

Por qué esta investigación importa para los usuarios cotidianos del lenguaje

Siempre que escuchas un discurso interpretado de una lengua a otra, confías en que el mensaje central ha sobrevivido al proceso. Comprobar esa “fidelidad” ha dependido históricamente de expertos humanos, lo que resulta lento y costoso. Este estudio pregunta si la inteligencia artificial moderna puede ayudar a juzgar con qué precisión un intérprete ha transmitido la información, lo que potencialmente haría los servicios lingüísticos más justos, baratos y fáciles de supervisar a gran escala.

Entender la interpretación fiel

La calidad de la interpretación tiene muchas dimensiones, pero los profesionales coinciden en que la fidelidad de la información —qué tan completa y precisa es la transmisión del significado— es la más importante. Tradicionalmente, los expertos escuchan el discurso original y la versión interpretada, o comparan la interpretación con una versión escrita ideal, y luego puntúan hasta qué punto se han preservado las ideas, los enlaces entre ellas y el tono del orador. Estos métodos son ricos y matizados, pero requieren personas muy formadas que dediquen mucho tiempo a reproducir grabaciones, cambiar entre idiomas y emitir juicios detallados. Como resultado, la evaluación humana detallada suele reservarse para exámenes o investigación, no para la formación cotidiana ni para el control de calidad a gran escala.

De las reglas de traducción a los modelos inteligentes

Para aligerar la carga de los evaluadores humanos, los investigadores han tomado prestadas herramientas de la traducción automática, donde programas informáticos comparan la salida de un sistema con varias traducciones humanas de referencia. Métricas clásicas como BLEU y METEOR buscan patrones de solapamiento de palabras entre lo que se dijo y un conjunto de versiones de referencia, y producen una puntuación numérica. Funcionan mejor cuando hay varias traducciones de referencia de alta calidad, pero esas referencias son caras de producir, y la coincidencia palabra por palabra a menudo pierde la imagen más amplia del significado, especialmente entre lenguas estructuralmente diferentes como el inglés y el chino.

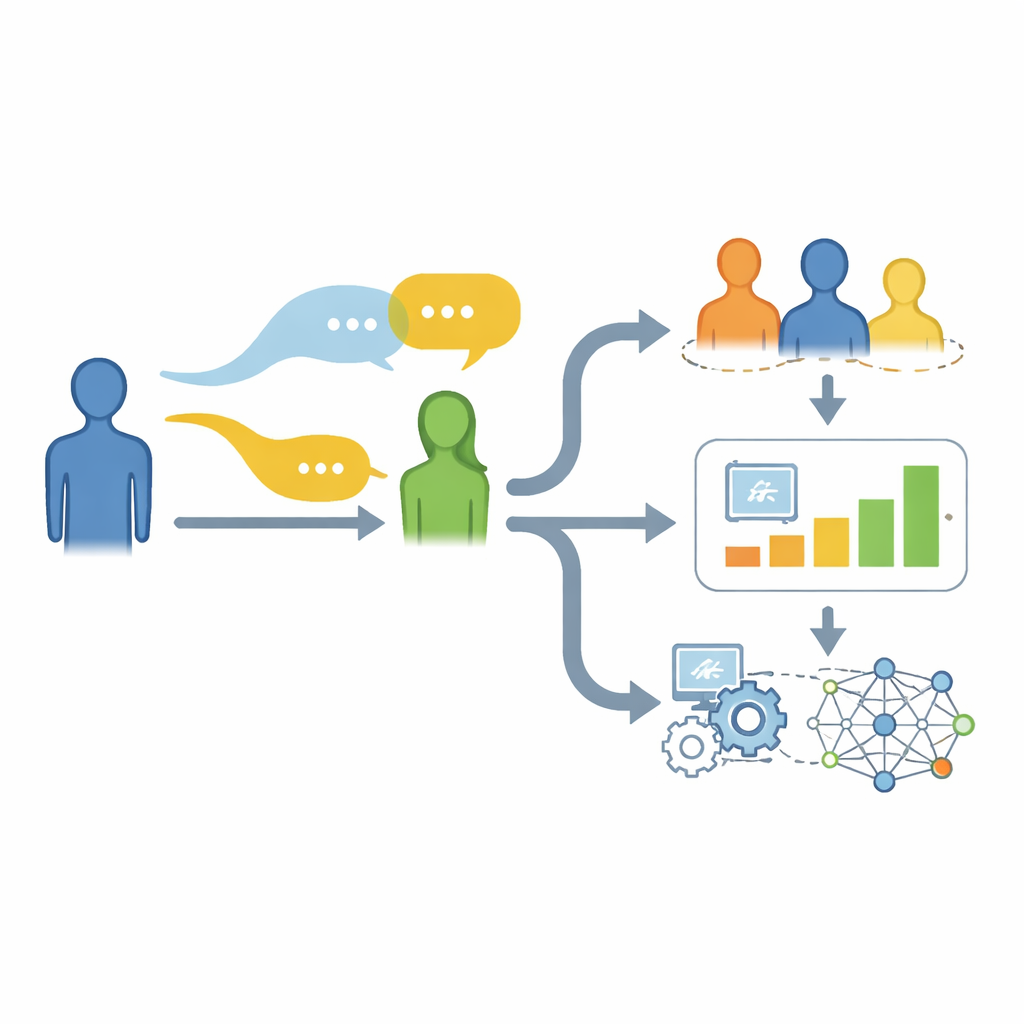

Cómo el estudio puso a prueba a humanos y máquinas

Esta investigación se centró en la interpretación consecutiva inglés–chino realizada por intérpretes en formación. Los autores seleccionaron tres interpretaciones de muestra que representaban calidad alta, media y baja de una muestra mayor. Transcribieron tanto el discurso original en inglés como las interpretaciones en chino, limpiaron muletillas y las alinearon en 94 pares de oraciones coincidentes. Dos evaluadores experimentados puntuaron cada par en fidelidad —cubriendo ideas principales, cómo se enlazan las ideas, detalles de apoyo y la actitud e intención del hablante— logrando un acuerdo muy alto entre ellos. Paralelamente, los investigadores calcularon puntuaciones automáticas para cada oración usando dos familias de herramientas: métricas tradicionales de traducción (BLEU y METEOR, basadas en varias traducciones automáticas revisadas del discurso fuente como referencias) y un conjunto de modelos neuronales que miden la similitud cross‑lingüística directamente entre la oración en inglés y su versión interpretada en chino.

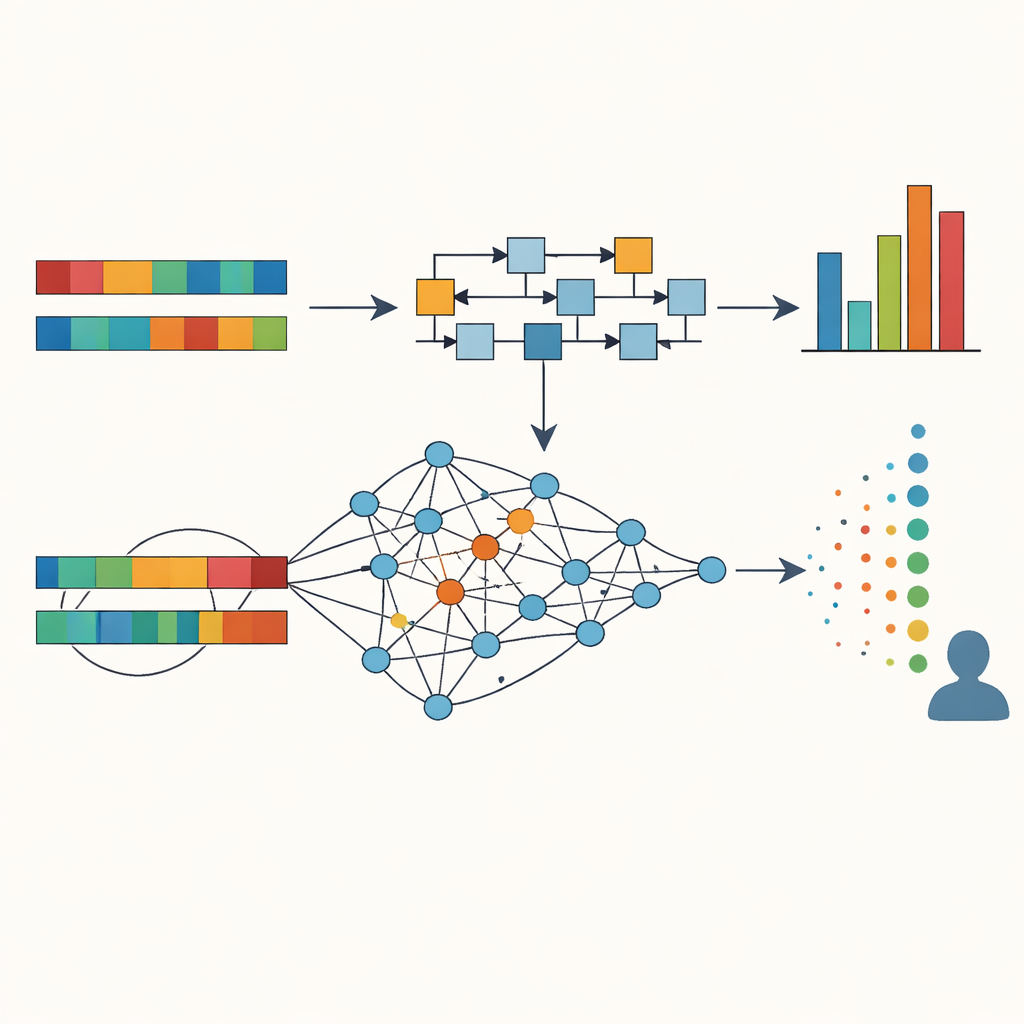

Lo que las máquinas detectaron en las interpretaciones

El estudio comparó las puntuaciones automáticas con las valoraciones humanas mediante correlaciones estadísticas. Las métricas tradicionales mostraron una alineación moderada: en promedio, sus puntajes seguían razonablemente las valoraciones humanas (alrededor de r = 0,45), con la variante más simple de BLEU rindiendo ligeramente mejor que METEOR. Los enfoques neuronales funcionaron mejor en conjunto, especialmente aquellos que convierten oraciones en distintos idiomas en “embeddings” numéricos compartidos que capturan el significado. Un modelo multilingüe de embeddings de oraciones llamado MUSE mostró la mayor concordancia con las puntuaciones humanas (r = 0,55), mientras que embeddings procedentes de grandes modelos de lenguaje como GPT y LLaMA, y la puntuación directa basada en GPT, también se correlacionaron de forma moderada. Es importante que estos modelos lidiaron mejor con la reexpresión natural, por ejemplo cuando una oración en chino reorganiza una inglesa pero preserva su sentido, situación en la que las métricas de solapamiento de palabras pueden señalar erróneamente un fallo. Los análisis de clúster, que agruparon interpretaciones según sus puntuaciones automáticas, mostraron que combinar varias métricas permitía separar interpretaciones de baja, media y alta calidad de maneras que reflejaban de cerca las valoraciones humanas.

Qué implica esto para la evaluación lingüística futura

Para los no especialistas, la conclusión es que la IA de hoy ya puede ofrecer señales útiles, aunque imperfectas, sobre cuán fielmente un intérprete ha transmitido un discurso. Los modelos neuronales cross‑lingüísticos que comparan significados directamente, en lugar de limitarse a contar palabras compartidas con textos de referencia, se acercan más al juicio humano y pueden identificar buenas interpretaciones incluso cuando usan formulaciones o estructuras distintas. Las correlaciones son lo bastante sólidas como para ser estadísticamente significativas, pero no para sustituir por completo a los evaluadores expertos. En cambio, el estudio sugiere usar una mezcla de puntuaciones neuronales y métricas tradicionales como ayuda rápida y de bajo coste en situaciones de "baja implicación": retroalimentación en clase, sesiones de práctica o cribado preliminar en evaluaciones a gran escala. La pericia humana sigue siendo crucial para decisiones de alto riesgo y para captar matices de estilo, contexto y ética que las máquinas actuales no pueden abarcar completamente, pero las herramientas basadas en IA están preparadas para convertirse en socias valiosas en la salvaguarda de la fidelidad de la comunicación interpretada.

Cita: Wang, X., Wang, B. Neural network models vs. MT evaluation metrics: a comparison between two approaches to automated assessment of information fidelity in consecutive interpreting. Humanit Soc Sci Commun 13, 567 (2026). https://doi.org/10.1057/s41599-026-06562-z

Palabras clave: calidad de la interpretación, fidelidad de la información, evaluación con redes neuronales, métricas de traducción automática, interpretación inglés–chino