Clear Sky Science · zh

使用与临床结局相关参数的全身FDG‑PET/CT可解释预测

为癌症护理提供更智能的影像

医生已经依赖强大的全身扫描来发现和追踪癌症,但这些影像中有大量信息未被利用,因为它们过于复杂,难以用肉眼全面分析。本研究展示了一种人工智能(AI)系统如何将全身癌症扫描转化为紧凑、易于分析的形式,同时仍能对患者的肿瘤和整体健康做出准确且可理解的预测。该方法不仅追求智能,还力求足够透明,使临床医生能够看到AI“注视”的内容,从而有助于建立对计算机辅助决策的信任。

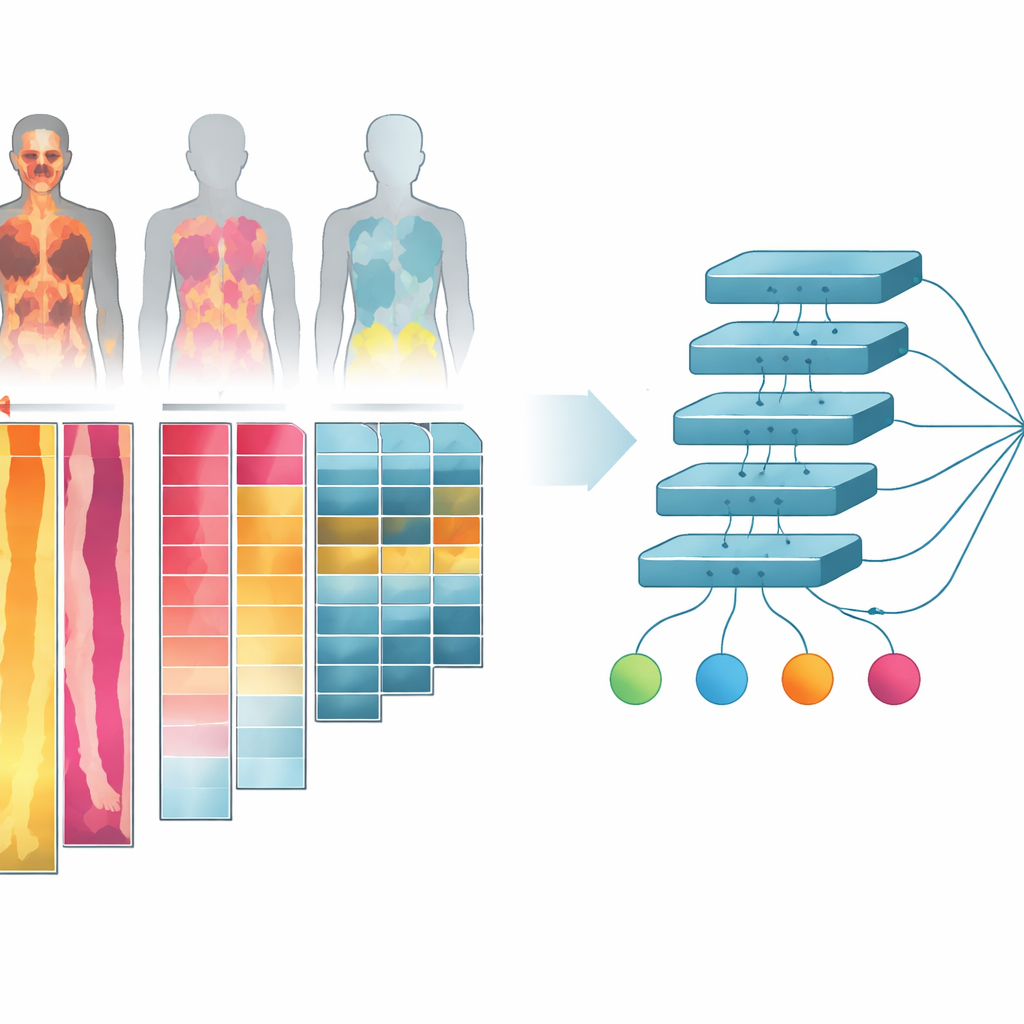

将三维全身扫描转换为平面图像带

研究人员使用了来自千余名癌症患者和健康对照者的PET/CT联合扫描。这些扫描既显示身体结构(CT),又展示不同组织的糖代谢活性(PET),后者重要因为癌组织通常比正常组织消耗更多的葡萄糖。研究者没有把完整的三维图像直接输入AI——那将对计算硬件要求很高——而是将扫描压缩为二维“投影”。他们还将身体划分为几类简单的组织群:骨骼、如肌肉与器官的瘦组织、体脂以及如肺等充气空间。针对每种组织类型和不同视角,创建了既反映组织外观又反映代谢活性的图像通道,然后将这些通道排列成每个人的单张拼贴式图像。

教AI读取健康信号

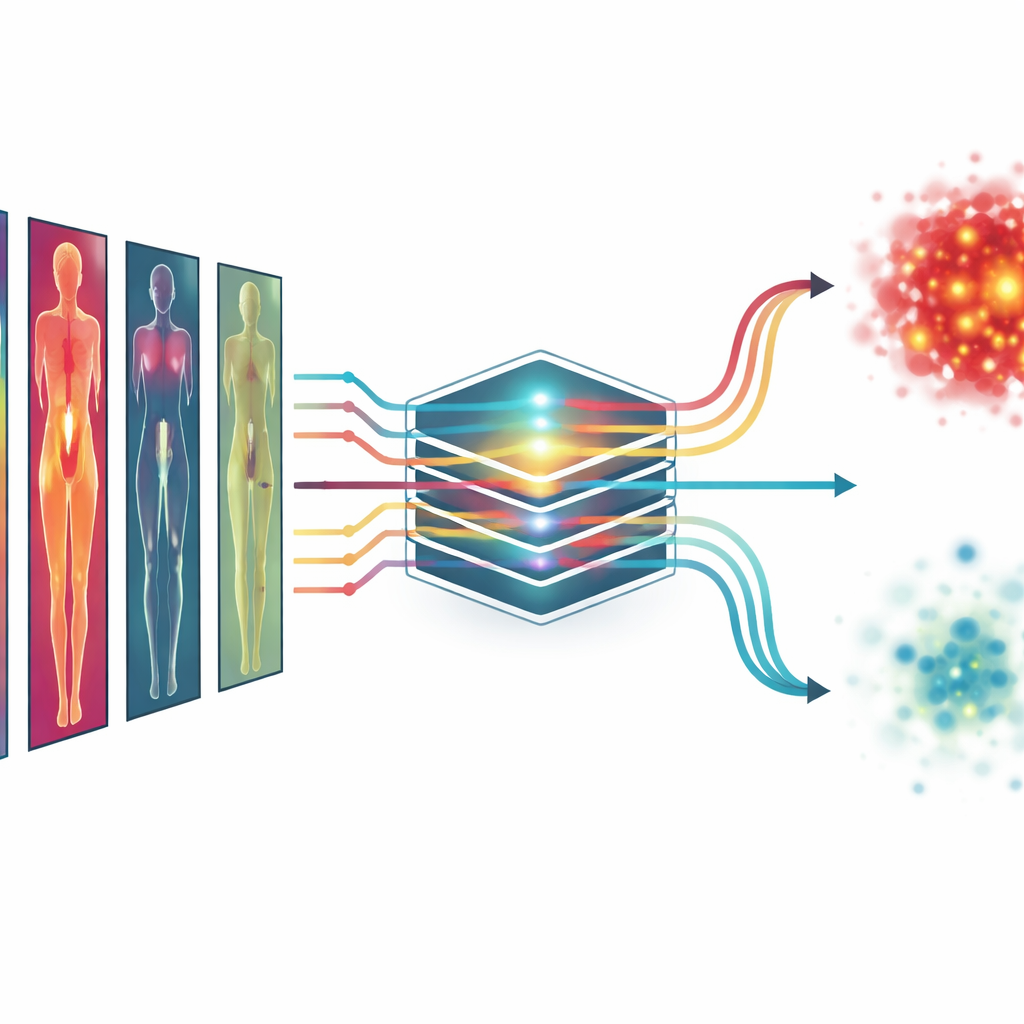

利用这些按组织分割的拼贴图,团队训练了一个深度学习模型来预测若干已知影响癌症结局的关键指标。这些包括总代谢性肿瘤体积(衡量活跃肿瘤的总体量)、独立病灶数量、患者年龄以及患者是否患有癌症。模型还被要求判断性别。其中一些目标(如肿瘤体积)在影像中可见;另一些(如年龄)则不明显,需要AI捕捉身体结构和代谢的细微模式。为保证评估公平,研究者多次将数据划分为训练组和测试组,确保每例扫描在某个时点都能作为独立测试样本。

系统的表现如何

采用所有按组织区分的PET通道的AI在预测肿瘤体积和病灶数目时具有较高精度,接近于检查每一层切片的更复杂三维方法的表现。它还将年龄估计到了平均约七年内,并几乎完美地完成了性别分类。在判定某次扫描是否来自癌症患者时,系统也达到了很高的准确率。重要的是,包含来自多种组织和多视角的信息几乎总是能比使用单一简单图像提高性能。这表明,癌症不仅在明显的“热点”留下痕迹,也会在全身更微妙的变化中显现,而多通道投影有助于揭示这些变化。

查看AI的关注区域

为了解决人们对AI“黑箱”性质的担忧,研究者使用了一种称为显著性映射的技术来突出显示哪些图像区域对每项预测影响最大。对于肿瘤体积以及有无癌症的判断,这些映射中的热点与真实肿瘤位置相吻合,表明模型关注的是医学上合理的区域。对于年龄预测,它集中在如肝脏、大腿和肩部肌肉以及接近骨盆的区域,这些部位随年龄和体成分改变而发生变化。对于性别分类,它则聚焦于胸部和骨盆区域。这些模式在整组患者中的一致性表明,系统学到的是有意义的线索,而非依赖随机噪声。

这对患者可能意味着什么

尽管这项工作仍属早期概念验证,但它表明复杂的全身癌症扫描可以被浓缩为高效且可解释的二维图像,同时仍允许AI预测具有临床意义的信息。未来,类似模型可能不仅限于肿瘤大小与数目,还能估计患者的预期生存期、对治疗的潜在反应或疾病进展程度——利用已在常规诊疗中采集的信息。由于该方法还能展示AI得出结论的依据,它有望帮助医生更好地理解并信任其建议,从而支持更个体化和更透明的癌症护理。

引用: Tarai, S., Lundström, E., Ahmad, N. et al. Interpretable predictions from whole-body FDG-PET/CT using parameters associated with clinical outcome. Commun Med 6, 232 (2026). https://doi.org/10.1038/s43856-026-01567-w

关键词: FDG‑PET/CT 成像, 肿瘤学中的深度学习, 肿瘤负荷预测, 可解释人工智能, 临床结局建模