Clear Sky Science · de

Interpretierbare Vorhersagen aus Ganzkörper‑FDG‑PET/CT mithilfe von Parametern, die mit dem klinischen Ergebnis assoziiert sind

Intelligentere Scans für die Krebsversorgung

Ärztinnen und Ärzte verlassen sich bereits auf leistungsfähige Ganzkörperscans, um Krebs zu erkennen und zu überwachen, doch viele Informationen in diesen Bildern bleiben ungenutzt, weil sie zu komplex sind, um sie mit dem Auge zu analysieren. Diese Studie zeigt, wie ein System der künstlichen Intelligenz (KI) Ganzkörperscans bei Krebs in eine kompakte, leicht analysierbare Form überführen kann und dennoch genaue, verständliche Vorhersagen über Tumoren und den allgemeinen Gesundheitszustand eines Patienten liefert. Der Ansatz zielt nicht nur auf hohe Leistungsfähigkeit ab, sondern auch auf Transparenz, sodass Klinikteams nachvollziehen können, worauf die KI „schaut“ und so Vertrauen in computerunterstützte Entscheidungen gefördert wird.

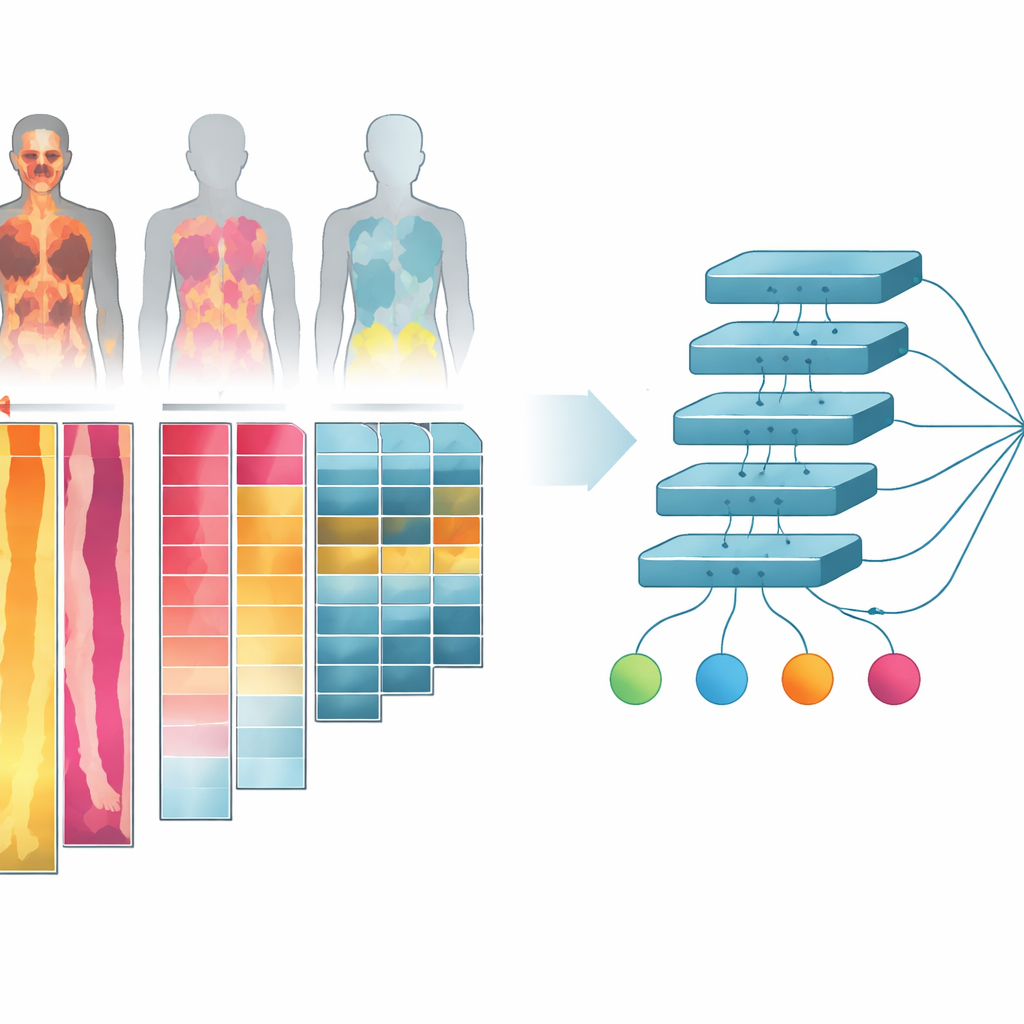

3D‑Körperscans in flache Bildstreifen verwandeln

Die Forschenden arbeiteten mit mehr als tausend kombinierten PET/CT‑Scans von Krebspatienten und gesunden Kontrollen. Diese Scans zeigen sowohl die Körperstruktur (CT) als auch, wie sehr verschiedene Gewebe Zucker verbrauchen (PET) — wichtig, weil Tumoren in der Regel mehr Zucker aufnehmen als normales Gewebe. Anstatt die vollständigen dreidimensionalen Bilder in die KI zu füttern — was sehr hohe Anforderungen an die Hardware stellen würde — reduzierten sie die Scans zu zweidimensionalen „Projektionen“. Außerdem teilten sie den Körper in einfache Gewebegruppen auf: Knochen, mageres Gewebe wie Muskeln und Organe, Körperfett und luftgefüllte Räume wie die Lungen. Für jeden Gewebetyp und aus verschiedenen Blickwinkeln erzeugten sie Bildkanäle, die Form und Aktivität des Gewebes erfassen, und ordneten diese Kanäle zu einer einzigen collageartigen Abbildung pro Person an.

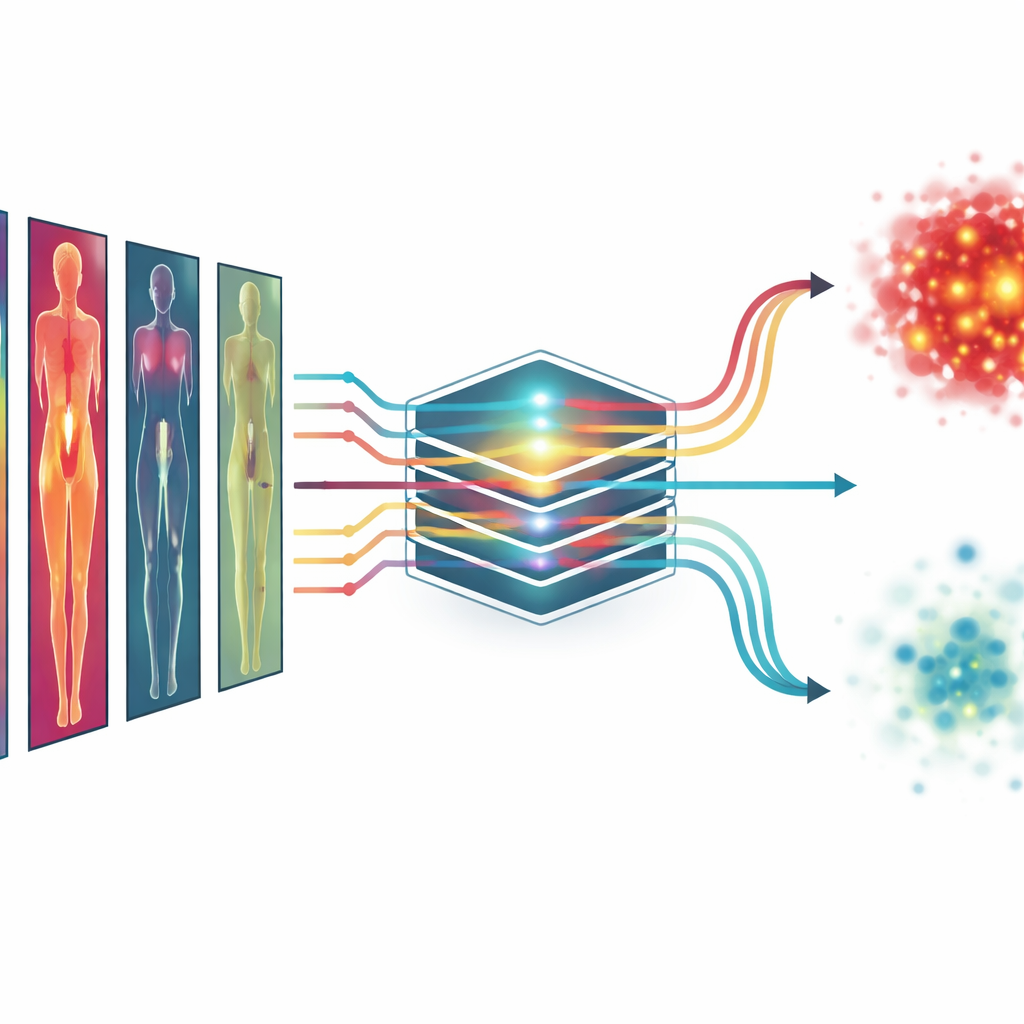

Die KI darin schulen, Gesundheitssignale zu lesen

Mithilfe dieser gewebespezifischen Collagen trainierte das Team ein tiefes Lernmodell, um mehrere Schlüsselfaktoren vorherzusagen, von denen bekannt ist, dass sie für das klinische Ergebnis bei Krebs wichtig sind. Dazu gehörten das gesamte metabolische Tumorvolumen (ein Maß dafür, wie viel aktiver Tumor vorhanden ist), die Anzahl separater Läsionen, das Alter der Patientin bzw. des Patienten und ob Krebs vorlag oder nicht. Das Modell sollte zudem zwischen männlich und weiblich unterscheiden. Einige dieser Zielgrößen, etwa das Tumorvolumen, sind in den Scans sichtbar; andere, wie das Alter, sind nicht offensichtlich und erfordern, dass die KI subtile Muster in Körperstruktur und Stoffwechsel erkennt. Um die Bewertung fair zu gestalten, teilten die Forschenden die Daten wiederholt in Trainings‑ und Testsets auf, sodass jeder Scan zu einem Zeitpunkt als unabhängiger Test diente.

Wie gut das System abschnitt

Die KI, die alle gewebespezifischen PET‑Kanäle nutzte, sagte Tumorvolumen und Läsionsanzahl mit hoher Genauigkeit voraus und erreichte damit Leistungen nahe an komplexeren dreidimensionalen Methoden, die jede Schicht des Scans untersuchen. Sie schätzte das Alter im Mittel auf etwa sieben Jahre genau und klassifizierte das Geschlecht nahezu fehlerfrei. Auch bei der Entscheidung, ob ein Scan von einer Person mit Krebs stammte, erreichte das System eine sehr hohe Genauigkeit. Wichtig ist, dass die Einbeziehung von Informationen aus mehreren Geweben und Blickrichtungen die Leistung fast immer gegenüber der Verwendung eines einzelnen, einfacheren Bildes verbesserte. Das legt nahe, dass Tumoren ihre Spuren nicht nur in offensichtlichen Hotspots hinterlassen, sondern auch in subtileren Veränderungen im ganzen Körper, die durch die Mehrkanalprojektionen besser sichtbar werden.

Sichtbar machen, wohin die KI blickt

Um eine verbreitete Sorge gegenüber KI zu adressieren — dass sie wie eine Blackbox arbeitet — verwendeten die Forschenden eine Technik namens Saliency‑Mapping, um hervorzuheben, welche Bildbereiche die jeweiligen Vorhersagen am stärksten beeinflussten. Für Tumorvolumen und Krebs vs. kein Krebs stimmten die Hotspots in diesen Karten mit den tatsächlichen Tumorpositionen überein, was zeigt, dass das Modell auf medizinisch sinnvolle Regionen achtete. Bei der Altersvorhersage konzentrierte es sich auf Bereiche wie Leber, Oberschenkel‑ und Schultermuskulatur sowie Regionen nahe dem Becken, die mit Alter und Körperzusammensetzung in Verbindung stehen. Bei der Geschlechtsklassifikation fokussierte es Brust‑ und Beckenbereiche. Diese Muster, bestätigt über die gesamte Patientengruppe hinweg, deuten darauf hin, dass das System sinnvolle Hinweise lernt und nicht nur zufälliges Rauschen ausnutzt.

Was das für Patientinnen und Patienten bedeuten könnte

Auch wenn diese Arbeit einen frühen Proof‑of‑Concept darstellt, zeigt sie, dass komplexe Ganzkörperscans bei Krebs in effiziente, interpretierbare 2D‑Bilder überführt werden können, die der KI weiterhin erlauben, klinisch relevante Informationen vorherzusagen. Künftige Modelle könnten über Tumorgröße und -anzahl hinausgehen und beispielsweise schätzen, wie lange eine Patientin bzw. ein Patient voraussichtlich leben wird, wie gut sie oder er auf eine Behandlung ansprechen könnte oder wie sich die Erkrankung entwickelt — und zwar auf Basis von Informationen, die bereits routinemäßig erhoben werden. Da die Methode auch zeigt, woher die KI ihre Antworten ableitet, könnte sie Ärzten helfen, die Vorschläge besser zu verstehen und ihnen zu vertrauen, und so zu einer personalisierteren und transparenteren Krebsversorgung beitragen.

Zitation: Tarai, S., Lundström, E., Ahmad, N. et al. Interpretable predictions from whole-body FDG-PET/CT using parameters associated with clinical outcome. Commun Med 6, 232 (2026). https://doi.org/10.1038/s43856-026-01567-w

Schlüsselwörter: FDG‑PET/CT‑Bildgebung, Tiefenlernen in der Onkologie, Prognose der Tumorlast, erklärbare KI, Modellierung klinischer Ergebnisse