Clear Sky Science · fr

Prédictions interprétables à partir d’un FDG‑PET/TDM corps entier en utilisant des paramètres associés au devenir clinique

Des examens plus intelligents pour la prise en charge du cancer

Les médecins s’appuient déjà sur des examens corporels puissants pour détecter et suivre les cancers, mais une grande partie des informations contenues dans ces images reste inutilisée parce qu’elle est trop complexe pour être analysée à l’œil nu. Cette étude montre comment un système d’intelligence artificielle (IA) peut transformer des examens corps entier en une forme compacte et facile à analyser, tout en produisant des prédictions précises et compréhensibles sur les tumeurs et l’état général d’un patient. L’approche vise non seulement l’efficacité, mais aussi la transparence, afin que les cliniciens puissent voir ce que l’IA « regarde », ce qui aide à instaurer la confiance dans l’aide à la décision informatisée.

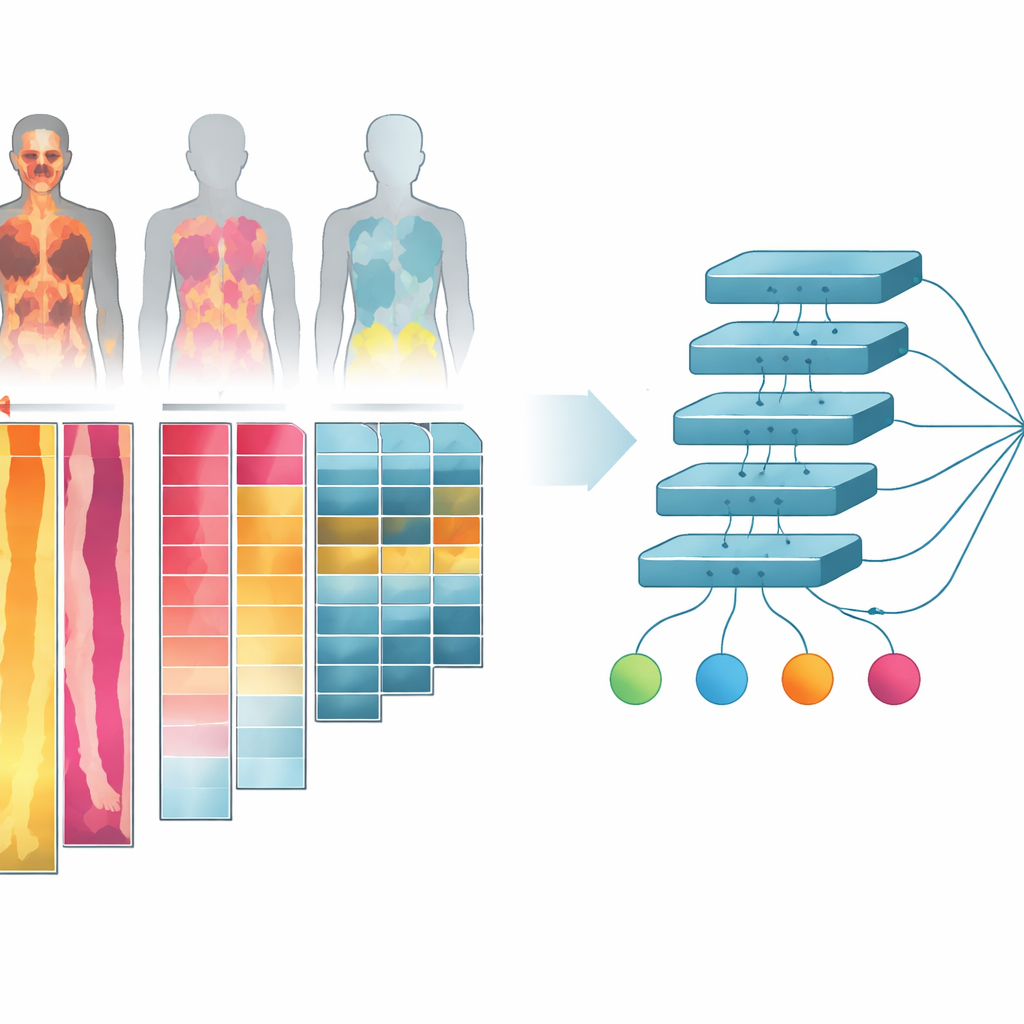

Transformer des scans 3D en bandes d’images plates

Les chercheurs ont travaillé sur plus d’un millier de scans PET/TDM combinés provenant de patients atteints de cancer et de témoins sains. Ces examens montrent à la fois la structure du corps (TDM) et l’appétit pour le glucose des différents tissus (PET), ce qui est important car les cancers consomment généralement plus de sucre que les tissus normaux. Plutôt que d’alimenter les images tridimensionnelles complètes dans l’IA — ce qui serait très exigeant pour le matériel informatique — ils ont aplati les examens en « projections » bidimensionnelles. Ils ont aussi séparé le corps en groupes de tissus simples : os, tissus maigres comme les muscles et les organes, graisse corporelle et espaces remplis d’air comme les poumons. Pour chaque type de tissu et pour différents angles de vue, ils ont créé des canaux d’image capturant l’aspect et l’activité du tissu, puis ont agencé ces canaux en une image unique de type collage pour chaque personne.

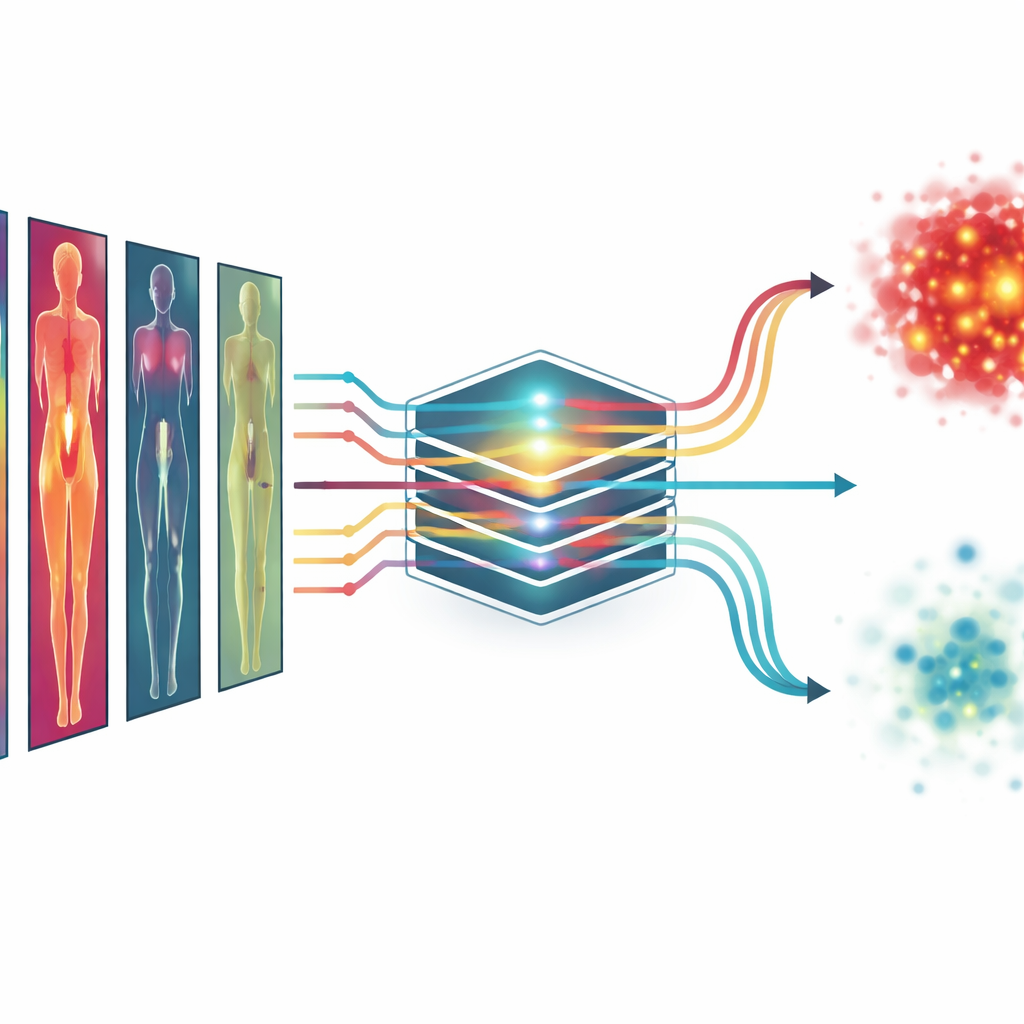

Apprendre à l’IA à lire les signaux de santé

En utilisant ces collages par tissu, l’équipe a entraîné un modèle d’apprentissage profond à prédire plusieurs valeurs clés connues pour influencer les issues en oncologie. Cela incluait le volume tumoral métabolique total (une mesure de la quantité de tumeur active), le nombre de lésions distinctes, l’âge du patient et s’il avait un cancer ou non. Le modèle devait aussi distinguer le sexe. Certaines cibles, comme le volume tumoral, sont visibles dans les scans ; d’autres, comme l’âge, ne sont pas du tout évidentes et exigent que l’IA détecte des motifs subtils dans la structure et le métabolisme du corps. Pour assurer une évaluation équitable, les chercheurs ont répété des divisions des données en groupes d’entraînement et de test, de sorte que chaque scan ait servi de test indépendant à un moment donné.

Performance du système

L’IA utilisant tous les canaux PET spécifiques aux tissus a prédit le volume tumoral et le nombre de lésions avec une grande précision, se rapprochant des performances de méthodes tridimensionnelles plus complexes qui analysent chaque coupe du scan. Elle a également estimé l’âge à environ sept ans près en moyenne et classifié le sexe presque parfaitement. Pour la détection d’un cancer sur un scan, le système a atteint une très bonne précision également. Il est important de noter que l’inclusion d’informations provenant de plusieurs tissus et directions de vue améliorait presque toujours les performances comparativement à l’utilisation d’une seule image plus simple. Cela suggère que les cancers « laissent leur trace » non seulement dans des points chauds évidents, mais aussi dans des modifications plus subtiles à l’échelle du corps que les projections multicanaux aident à révéler.

Voir où l’IA regarde

Pour répondre à une inquiétude fréquente concernant l’IA — qu’elle fonctionne comme une boîte noire — les chercheurs ont utilisé une technique appelée cartographie de saillance pour mettre en évidence les parties des images qui ont le plus influencé chaque prédiction. Pour le volume tumoral et la classification cancer vs. absence de cancer, les points chauds de ces cartes correspondaient aux localisations tumorales réelles, montrant que le modèle portait attention à des régions médicalement pertinentes. Pour la prédiction de l’âge, il s’est focalisé sur des zones telles que le foie, les muscles des cuisses et des épaules, et des régions proches du bassin, qui évoluent avec l’âge et la composition corporelle. Pour la classification du sexe, l’attention s’est concentrée sur la poitrine et la région pelvienne. Ces motifs, confirmés à l’échelle du groupe de patients, suggèrent que le système apprend des indices significatifs plutôt que de s’appuyer sur du bruit aléatoire.

Ce que cela pourrait signifier pour les patients

Bien que ce travail soit une preuve de concept précoce, il montre que des examens corps entier complexes peuvent être distillés en images 2D efficaces et interprétables qui permettent néanmoins à l’IA de prédire des informations cliniquement importantes. À l’avenir, des modèles similaires pourraient aller au‑delà de la taille et du nombre de tumeurs pour estimer l’espérance de vie d’un patient, la probabilité de réponse à un traitement, ou l’évolution de sa maladie — en utilisant des informations déjà collectées dans les soins de routine. Parce que la méthode montre aussi d’où l’IA tire ses réponses, elle pourrait aider les médecins à mieux comprendre et faire confiance à ses suggestions, favorisant une prise en charge du cancer plus personnalisée et transparente.

Citation: Tarai, S., Lundström, E., Ahmad, N. et al. Interpretable predictions from whole-body FDG-PET/CT using parameters associated with clinical outcome. Commun Med 6, 232 (2026). https://doi.org/10.1038/s43856-026-01567-w

Mots-clés: Imagerie FDG‑PET/TDM, apprentissage profond en oncologie, prévision de la charge tumorale, IA explicable, modélisation du devenir clinique