Clear Sky Science · pl

Interpretowalne prognozy z całego ciała FDG-PET/CT wykorzystujące parametry powiązane z wynikami klinicznymi

Inteligentniejsze skany dla opieki nad chorymi na raka

Lekarze już teraz polegają na zaawansowanych badaniach obrazowych całego ciała w wykrywaniu i monitorowaniu nowotworów, jednak znaczna część informacji zawartych w tych obrazach pozostaje niewykorzystana, ponieważ jest zbyt złożona do analizy gołym okiem. Badanie to pokazuje, jak system sztucznej inteligencji (AI) może przekształcić skany całego ciała w zwarte, łatwe do analizy formy i jednocześnie generować dokładne, zrozumiałe prognozy dotyczące guzów pacjenta i jego ogólnego stanu zdrowia. Podejście to ma na celu nie tylko wysoką skuteczność, ale też przejrzystość, dzięki której klinicyści mogą zobaczyć, „na co” AI zwraca uwagę, co pomaga budować zaufanie do wspomaganych komputerowo decyzji.

Przekształcanie trójwymiarowych skanów ciała w płaskie pasy obrazowe

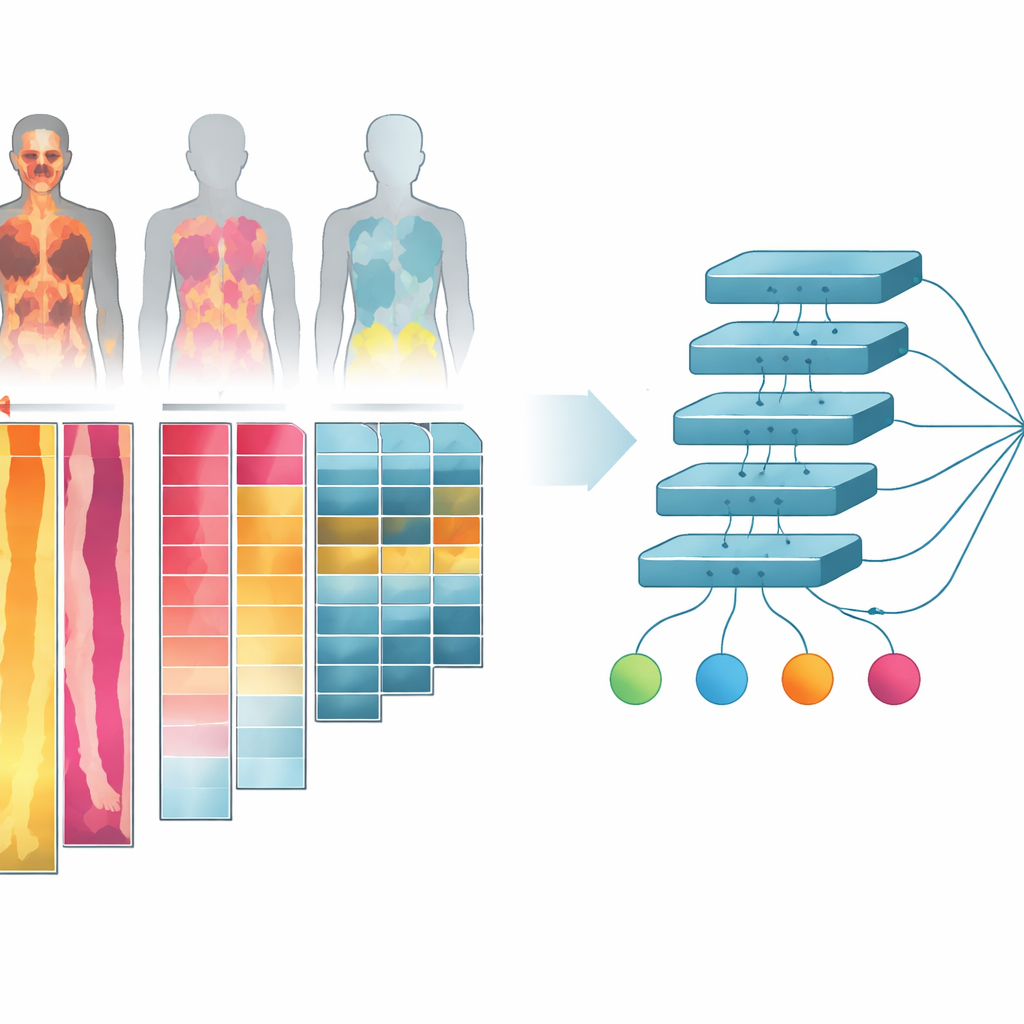

Naukowcy pracowali na ponad tysiącu połączonych skanów PET/CT pochodzących od pacjentów onkologicznych oraz zdrowych kontrolnych. Te badania ukazują zarówno strukturę ciała (CT), jak i to, jak bardzo różne tkanki „przyciągają” glukozę (PET), co jest istotne, ponieważ nowotwory zwykle zużywają więcej cukru niż tkanki prawidłowe. Zamiast wprowadzać pełne obrazy trójwymiarowe do AI — co byłoby bardzo wymagające dla sprzętu komputerowego — zeskanowane dane zostały zredukowane do dwuwymiarowych „projekcji”. Podzielono też ciało na proste grupy tkankowe: kości, tkankę chudą jak mięśnie i narządy, tłuszcz ciała oraz przestrzenie wypełnione powietrzem, takie jak płuca. Dla każdego typu tkanki i różnych kątów widzenia utworzono kanały obrazowe oddające wygląd i aktywność tkanki, a następnie ułożono te kanały w pojedynczy, kolażowy obraz dla każdej osoby.

Uczenie AI rozpoznawania sygnałów zdrowotnych

Wykorzystując takie tkankowe kolaże, zespół wytrenował model uczenia głębokiego do przewidywania kilku kluczowych wskaźników znanych z istotnego wpływu na przebieg choroby nowotworowej. Należały do nich całkowita metaboliczna objętość guza (miara ilości aktywnego nowotworu), liczba odrębnych zmian ogniskowych, wiek pacjenta oraz to, czy pacjent ma raka, czy nie. Modelowi powierzono także zadanie rozróżnienia płci. Niektóre z tych celów, jak objętość guza, są widoczne na skanach; inne, jak wiek, nie są wprost oczywiste i wymagają od AI wychwycenia subtelnych wzorców w strukturze ciała i metabolizmie. Aby zapewnić rzetelną ocenę, badacze wielokrotnie dzielili dane na grupy treningowe i testowe, tak aby każdy skan w pewnym momencie pełnił rolę niezależnego testu.

Jak dobrze działał system

AI wykorzystujące wszystkie specyficzne dla tkanek kanały PET przewidywało objętość guza i liczbę zmian z wysoką dokładnością, zbliżając się do wyników bardziej złożonych, trójwymiarowych metod analizujących każdy przekrój skanu. System również oszacował wiek średnio z dokładnością do około siedmiu lat i niemal bezbłędnie sklasyfikował płeć. W rozstrzyganiu, czy skan pochodzi od osoby z rakiem, system osiągnął również bardzo wysoką skuteczność. Co ważne, uwzględnienie informacji z wielu tkanek i kierunków widzenia niemal zawsze poprawiało wydajność w porównaniu z użyciem pojedynczego, prostszego obrazu. Sugeruje to, że nowotwory „zostawiają ślady” nie tylko w wyraźnych obszarach o wysokiej aktywności, lecz także w subtelnych zmianach rozciągających się po całym ciele, które wielokanałowe projekcje pomagają uwidocznić.

Wskazywanie, gdzie AI patrzy

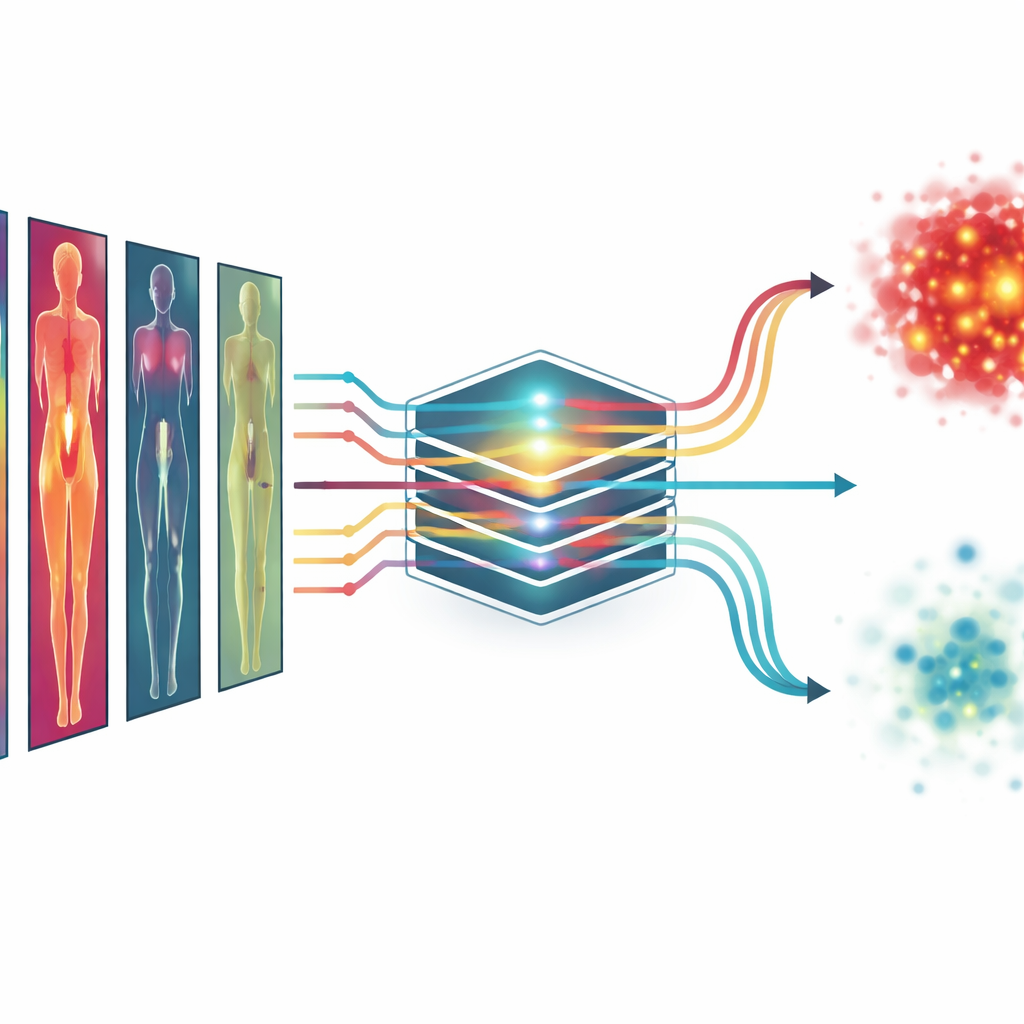

Aby rozwiązać powszechne zastrzeżenia dotyczące AI — że działa jak czarna skrzynka — badacze zastosowali technikę zwaną mapowaniem saliencyjnym, aby uwydatnić, które części obrazów najbardziej wpływały na poszczególne przewidywania. Dla objętości guza i rozróżnienia rak vs. brak raka, gorące plamy na tych mapach odpowiadały rzeczywistym lokalizacjom guzów, co pokazuje, że model zwracał uwagę na medycznie sensowne obszary. Przy przewidywaniu wieku koncentrował się na miejscach takich jak wątroba, mięśnie uda i barku oraz okolice miednicy, które są znane ze zmian związanych z wiekiem i składem ciała. W klasyfikacji płci skupiał się na okolicach klatki piersiowej i miednicy. Te wzorce, potwierdzone w całej grupie pacjentów, sugerują, że system uczy się istotnych sygnałów zamiast opierać się na losowym szumie.

Co to może znaczyć dla pacjentów

Chociaż praca ta stanowi wczesne potwierdzenie koncepcji, pokazuje, że złożone skany całego ciała można sprowadzić do wydajnych, interpretowalnych obrazów 2D, które nadal pozwalają AI przewidywać klinicznie istotne informacje. W przyszłości podobne modele mogą wykraczać poza rozmiar i liczbę guzów, aby oszacować, jak długo pacjent prawdopodobnie przeżyje, jak dobrze może zareagować na leczenie lub jak przebiega postęp choroby — wykorzystując informacje już gromadzone w rutynowej opiece. Ponieważ metoda pokazuje także, skąd AI czerpie swoje odpowiedzi, może pomóc lekarzom lepiej rozumieć i ufać jej sugestiom, wspierając bardziej spersonalizowaną i przejrzystą opiekę onkologiczną.

Cytowanie: Tarai, S., Lundström, E., Ahmad, N. et al. Interpretable predictions from whole-body FDG-PET/CT using parameters associated with clinical outcome. Commun Med 6, 232 (2026). https://doi.org/10.1038/s43856-026-01567-w

Słowa kluczowe: obrazowanie FDG-PET/CT, uczenie głębokie w onkologii, predykcja obciążenia guzem, wyjaśnialna sztuczna inteligencja, modelowanie wyników klinicznych