Clear Sky Science · it

Predizioni interpretabili da FDG-PET/CT whole-body usando parametri associati all’esito clinico

Scanner più intelligenti per la cura del cancro

I medici già si affidano a potenti esami corpo‑intero per individuare e monitorare il cancro, ma gran parte delle informazioni contenute in queste immagini resta inutilizzata perché troppo complessa da analizzare a occhio nudo. Questo studio mostra come un sistema di intelligenza artificiale (IA) può trasformare le scansioni oncologiche whole‑body in una forma compatta e facile da analizzare, pur producendo predizioni accurate e comprensibili sui tumori e sulle condizioni generali del paziente. L’approccio non mira solo a essere efficace, ma anche sufficientemente trasparente da permettere ai clinici di vedere su cosa l’IA «si sta concentrando», contribuendo a costruire fiducia nelle decisioni assistite dal computer.

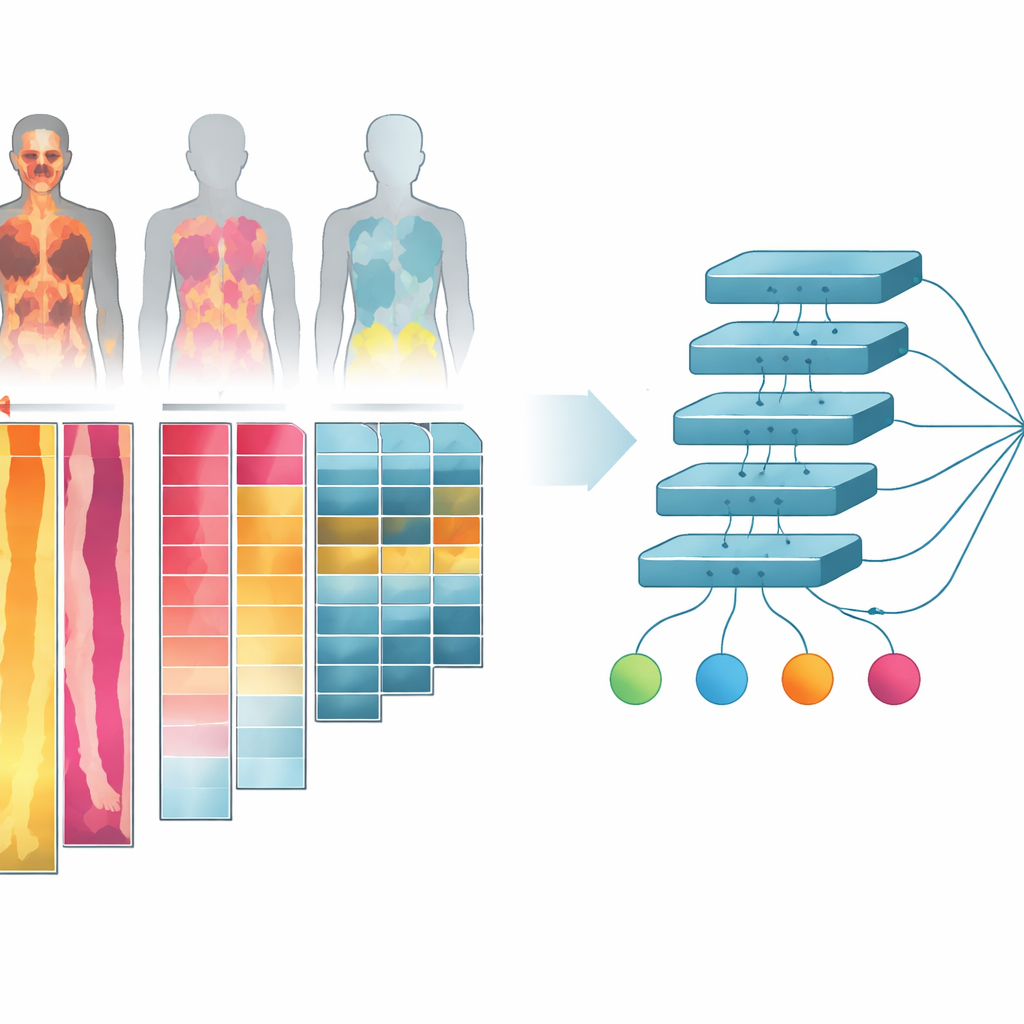

Trasformare scansioni 3D in strisce di immagini piatte

I ricercatori hanno lavorato con oltre mille scansioni PET/CT combinate provenienti da pazienti oncologici e controlli sani. Queste scansioni mostrano sia la struttura corporea (CT) sia quanto i tessuti consumano zucchero (PET), un aspetto importante perché i tumori tendono a consumare più zucchero rispetto ai tessuti normali. Invece di fornire le immagini tridimensionali complete all’IA — operazione molto esigente per l’hardware — le hanno ridotte in «proiezioni» bidimensionali. Hanno inoltre suddiviso il corpo in gruppi di tessuto semplici: osso, tessuto magro come muscoli e organi, grasso corporeo e spazi pieni d’aria come i polmoni. Per ogni tipo di tessuto e per diverse angolazioni di visuale hanno creato canali d’immagine che catturano l’aspetto e l’attività del tessuto, quindi hanno disposto questi canali in un’unica immagine collage per ogni individuo.

Addestrare l’IA a leggere segnali di salute

Usando questi collage per tessuto, il gruppo ha addestrato un modello di deep learning a predire vari numeri chiave noti per essere rilevanti negli esiti oncologici. Tra questi c’erano il volume metabolico totale del tumore (una misura di quanto tumore attivo è presente), il numero di lesioni separate, l’età del paziente e se il paziente aveva o meno il cancro. Al modello è stato anche chiesto di distinguere il sesso maschile da quello femminile. Alcuni di questi obiettivi, come il volume tumorale, sono visibili nelle scansioni; altri, come l’età, non sono affatto evidenti e richiedono che l’IA colga pattern sottili nella struttura corporea e nel metabolismo. Per rendere la valutazione equa, i ricercatori hanno ripetutamente suddiviso i dati in gruppi di addestramento e test, in modo che ogni scansione fungesse da test indipendente in qualche momento.

Come si è comportato il sistema

L’IA che utilizzava tutti i canali PET specifici per tessuto ha previsto con alta accuratezza il volume tumorale e il conteggio delle lesioni, avvicinandosi alle prestazioni di metodi tridimensionali più complessi che analizzano ogni slice della scansione. Ha stimato anche l’età con un errore medio di circa sette anni e ha classificato il sesso quasi perfettamente. Anche nella decisione se una scansione provenisse da una persona con cancro, il sistema ha raggiunto un’accuratezza molto elevata. È importante notare che l’inclusione di informazioni provenienti da più tessuti e direzioni di visuale ha quasi sempre migliorato le prestazioni rispetto all’uso di una singola immagine più semplice. Questo suggerisce che i tumori «lasciano un segno» non solo nelle evidenti zone calde, ma anche in cambiamenti più sottili diffuse nel corpo che le proiezioni multi‑canale aiutano a rivelare.

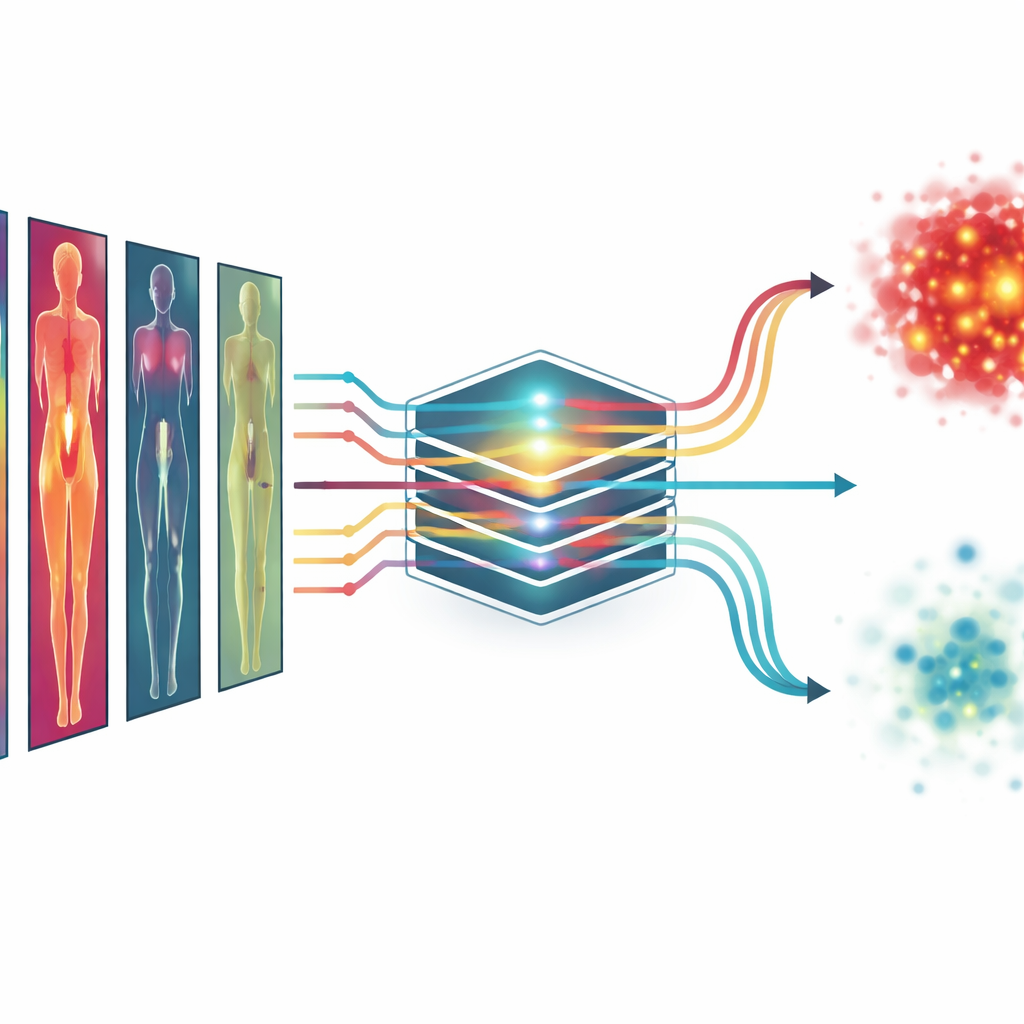

Vedere dove guarda l’IA

Per affrontare una preoccupazione comune sull’IA — che funzioni come una scatola nera — i ricercatori hanno impiegato una tecnica chiamata mappatura di salienza per evidenziare le parti delle immagini che più influenzavano ogni predizione. Per il volume tumorale e la distinzione cancro vs. assenza di cancro, le aree più calde in queste mappe corrispondevano alle posizioni tumorali reali, mostrando che il modello prestava attenzione a regioni sensate dal punto di vista medico. Per la predizione dell’età, si è concentrato su aree come il fegato, i muscoli di coscia e spalla e le zone vicino al bacino, note per cambiare con l’età e la composizione corporea. Per la classificazione del sesso, si è focalizzato su torace e area pelvica. Questi schemi, confermati sull’intero gruppo di pazienti, suggeriscono che il sistema sta imparando indizi significativi piuttosto che aggrapparsi a rumore casuale.

Cosa potrebbe significare per i pazienti

Pur essendo un primo proof of concept, questo lavoro dimostra che scansioni oncologiche whole‑body complesse possono essere distillate in immagini 2D efficienti e interpretabili che consentono comunque all’IA di predire informazioni clinicamente importanti. In futuro, modelli simili potrebbero andare oltre la dimensione e il conteggio dei tumori per stimare quanto a lungo è probabile che un paziente viva, quanto bene potrebbe rispondere a un trattamento o come sta progredendo la malattia — usando informazioni già raccolte nella pratica clinica routinaria. Poiché il metodo mostra anche da dove l’IA trae le sue risposte, potrebbe aiutare i medici a comprendere meglio e a fidarsi dei suggerimenti, sostenendo una cura del cancro più personalizzata e trasparente.

Citazione: Tarai, S., Lundström, E., Ahmad, N. et al. Interpretable predictions from whole-body FDG-PET/CT using parameters associated with clinical outcome. Commun Med 6, 232 (2026). https://doi.org/10.1038/s43856-026-01567-w

Parole chiave: Imaging FDG-PET/CT, deep learning in oncologia, predizione del carico tumorale, IA spiegabile, modellazione dell’esito clinico