Clear Sky Science · sv

Tolkbara prediktioner från helkropps-FDG-PET/CT med parametrar kopplade till kliniskt utfall

Smartare skanningar för cancervård

Läkare förlitar sig redan på kraftfulla kroppsskanningar för att hitta och följa cancer, men mycket av informationen i dessa bilder förblir oanvänd eftersom den är för komplex för att analyseras med blotta ögat. Denna studie visar hur ett artificiellt intelligens (AI)-system kan omvandla helkropps-cancerskanningar till en kompakt, lättanalyserad form och ändå göra korrekta, begripliga prediktioner om en patients tumörer och övergripande hälsa. Tillvägagångssättet strävar inte bara efter att vara smart, utan också tillräckligt transparent så att kliniker kan se vad AI:n "tittar på", vilket hjälper till att bygga förtroende för datorstödda beslut.

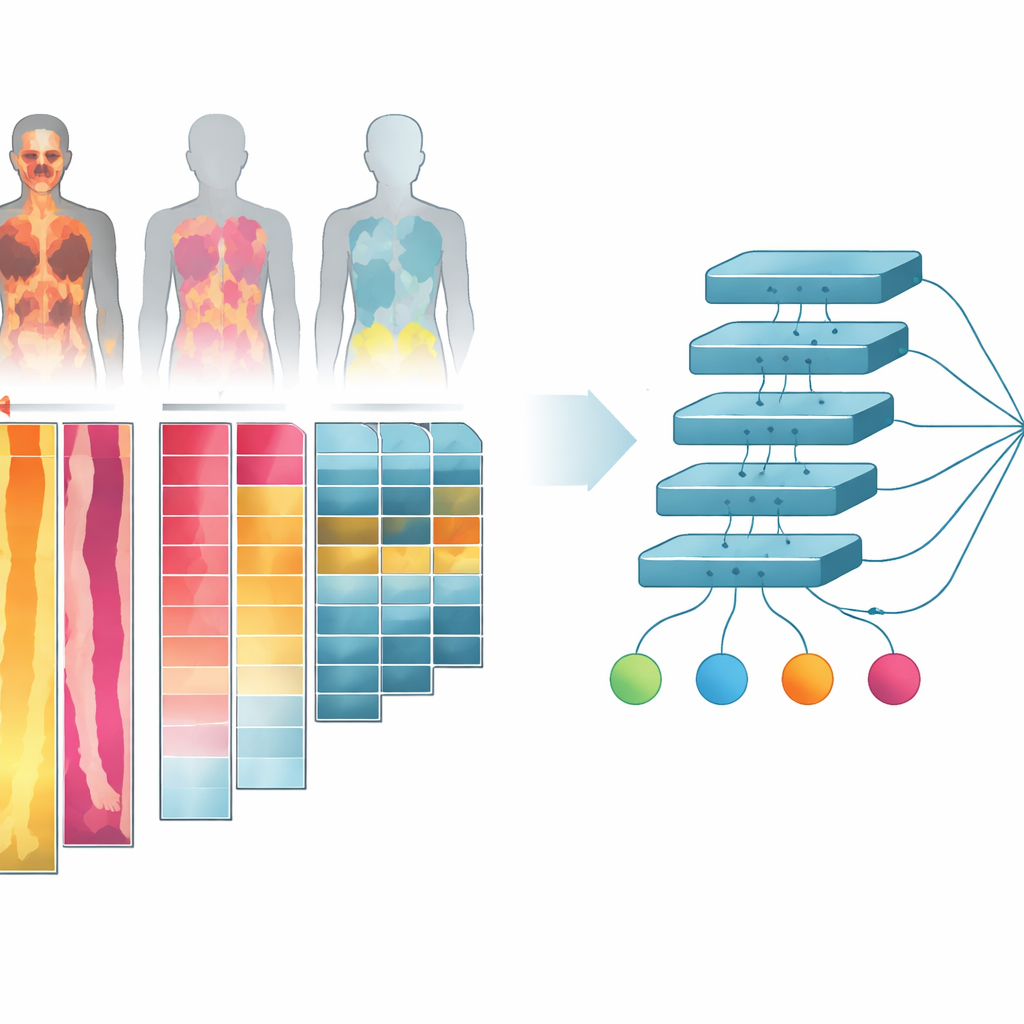

Att omvandla 3D-kroppsskanningar till platta bildremsor

Forskarlaget arbetade med mer än tusen kombinerade PET/CT-skanningar från cancerpatienter och friska kontrollpersoner. Dessa skanningar visar både kroppens struktur (CT) och hur sockerhungrigt olika vävnader är (PET), vilket är viktigt eftersom cancer oftast förbrukar mer socker än normal vävnad. Istället för att mata in hela de tredimensionella bilderna i AI:n — vilket skulle vara mycket krävande för hårdvaran — kollapsade de skanningarna till tvådimensionella "projektioner." De delade också in kroppen i enkla vävnadsgrupper: ben, magra vävnader som muskler och organ, kroppsfett och luftfyllda utrymmen såsom lungor. För varje vävnadstyp och för olika visningsvinklar skapade de bildkanaler som fångar hur vävnaden ser ut och hur aktiv den är, och arrangerade sedan dessa kanaler till en enda collage‑liknande bild för varje person.

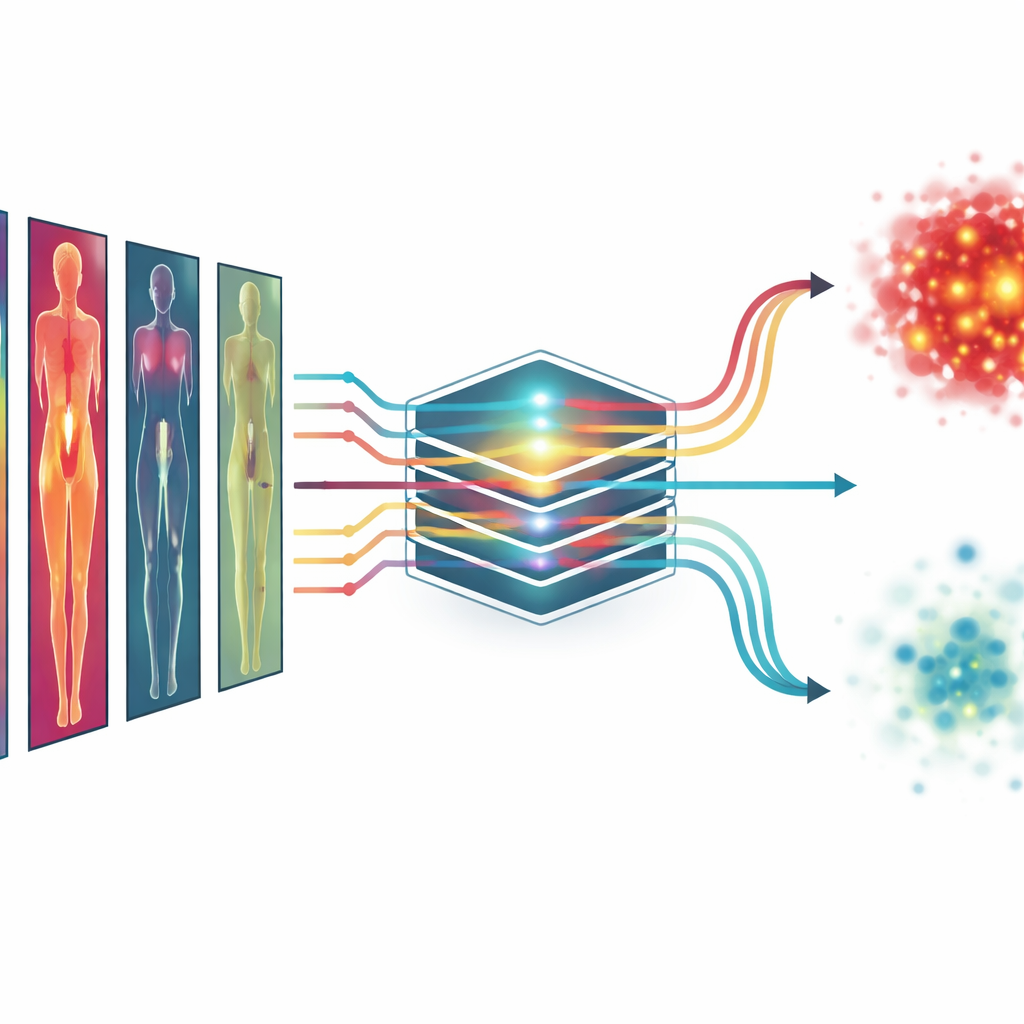

Att lära AI:n läsa hälsosignaler

Med dessa vävnadsspecifika collager tränade teamet en djupinlärningsmodell för att förutsäga flera nyckeltal som är kända för att påverka cancerutfall. Dessa inkluderade total metabolisk tumörvolym (en mätning av hur mycket aktiv tumör som finns), antalet separata lesioner, patientens ålder och huruvida patienten hade cancer eller inte. Modellen fick också i uppgift att avgöra kön. Vissa av dessa mål, som tumörvolym, är synliga i skanningarna; andra, som ålder, är inte alls uppenbara och kräver att AI:n plockar upp subtila mönster i kroppens struktur och ämnesomsättning. För att göra utvärderingen rättvis delade forskarna upp data upprepade gånger i tränings- och testgrupper, så att varje skanning vid något tillfälle fungerade som ett oberoende test.

Hur bra systemet presterade

AI:n som använde alla vävnadsspecifika PET-kanaler förutspådde tumörvolym och lesionsantal med hög noggrannhet, och kom nära prestandan hos mer komplexa tredimensionella metoder som undersöker varje snitt i skanningen. Den uppskattade också åldern med i genomsnitt omkring sju års felmarginal och klassificerade kön nästan perfekt. När det gällde att avgöra om en skanning kom från en person med cancer uppnådde systemet också mycket hög noggrannhet. Viktigt är att inkludering av information från flera vävnader och visningsriktningar nästan alltid förbättrade prestandan jämfört med att använda en enda, enklare bild. Det tyder på att cancer lämnar sitt avtryck inte bara i uppenbara varma fläckar, utan också i mer subtila förändringar över kroppen som multikanalsprojektionerna hjälper till att avslöja.

Att se var AI:n tittar

För att bemöta en vanlig oro kring AI — att den fungerar som en svart låda — använde forskarna en teknik kallad saliency-mappning för att framhäva vilka delar av bilderna som mest påverkade varje prediktion. För tumörvolym och cancer kontra ingen cancer överensstämde de heta områdena i dessa kartor med verkliga tumörlokaler, vilket visar att modellen uppmärksammade medicinskt rimliga regioner. För åldersprediktion fokuserade den på områden såsom levern, lår- och skuldmuskler samt regioner nära bäckenet, vilka är kända för att förändras med ålder och kroppssammansättning. För könsklassificering koncentrerade den sig på bröst- och bäckenområdet. Dessa mönster, bekräftade över hela patientgruppen, tyder på att systemet lär sig meningsfulla ledtrådar snarare än att haka upp sig på slumpmässigt brus.

Vad detta kan betyda för patienter

Även om detta arbete är ett tidigt proof of concept visar det att komplexa helkropps-cancerskanningar kan destilleras till effektiva, tolkbara 2D-bilder som ändå låter AI förutsäga kliniskt viktig information. I framtiden kan liknande modeller gå bortom tumörstorlek och antal för att uppskatta hur länge en patient troligen kommer att leva, hur väl de kan komma att svara på behandling eller hur deras sjukdom utvecklas — med hjälp av information som redan samlas in i rutinvård. Eftersom metoden också visar var AI:n hämtar sina svar kan den hjälpa läkare att bättre förstå och lita på dess förslag, och därigenom stödja mer personanpassad och transparent cancervård.

Citering: Tarai, S., Lundström, E., Ahmad, N. et al. Interpretable predictions from whole-body FDG-PET/CT using parameters associated with clinical outcome. Commun Med 6, 232 (2026). https://doi.org/10.1038/s43856-026-01567-w

Nyckelord: FDG-PET/CT-avbildning, djupinlärning inom onkologi, prediktion av tumörbörda, förklarbar AI, modellering av kliniskt utfall