Clear Sky Science · pt

Previsões interpretáveis a partir de FDG-PET/CT de corpo inteiro usando parâmetros associados ao desfecho clínico

Exames mais inteligentes para o cuidado do câncer

Já existem exames corporais potentes que os médicos usam para detectar e acompanhar o câncer, mas grande parte da informação nestas imagens fica subutilizada porque é complexa demais para ser analisada a olho nu. Este estudo demonstra como um sistema de inteligência artificial (IA) pode transformar exames de corpo inteiro em uma forma compacta e fácil de analisar, mantendo a capacidade de fazer previsões precisas e compreensíveis sobre os tumores e a saúde geral do paciente. A abordagem visa não apenas ser inteligente, mas também suficientemente transparente para que os clínicos vejam o que a IA está “observando”, ajudando a construir confiança nas decisões assistidas por computador.

Transformando exames 3D em faixas planas de imagem

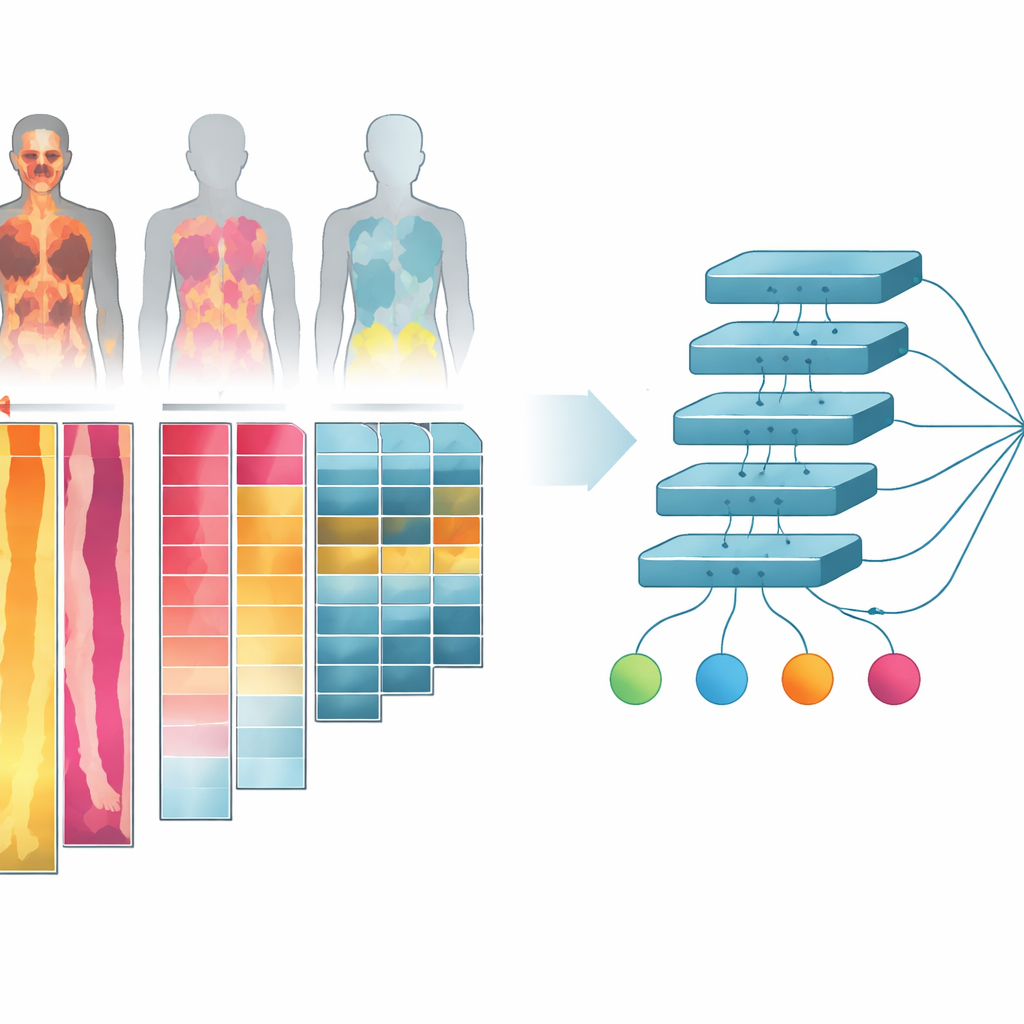

Os pesquisadores trabalharam com mais de mil exames combinados de PET/CT de pacientes com câncer e controles saudáveis. Esses exames mostram tanto a estrutura corporal (CT) quanto o apetite por glicose dos diferentes tecidos (PET), o que é importante porque tumores geralmente consomem mais açúcar que o tecido normal. Em vez de alimentar as imagens tridimensionais completas na IA — o que seria muito exigente para o hardware — eles reduziram os exames para “projeções” bidimensionais. Também separaram o corpo em grupos de tecido simples: osso, tecido magro como músculos e órgãos, gordura corporal e espaços preenchidos por ar, como os pulmões. Para cada tipo de tecido e para diferentes ângulos de visão, criaram canais de imagem que capturam a aparência e a atividade do tecido, então organizaram esses canais em uma única imagem tipo colagem para cada pessoa.

Ensinando a IA a ler sinais de saúde

Usando essas colagens por tecido, a equipe treinou um modelo de aprendizado profundo para prever vários números-chave que se sabe serem relevantes para desfechos oncológicos. Entre eles estavam o volume metabólico tumoral total (uma medida de quanto tumor ativo está presente), o número de lesões separadas, a idade do paciente e se o paciente tinha câncer ou não. O modelo também foi solicitado a identificar o sexo biológico. Alguns desses alvos, como o volume tumoral, são visíveis nas imagens; outros, como a idade, não são óbvios e exigem que a IA capte padrões sutis na estrutura corporal e no metabolismo. Para garantir avaliação justa, os pesquisadores dividiram repetidamente os dados em grupos de treinamento e teste, de modo que cada exame serviu como teste independente em algum momento.

Desempenho do sistema

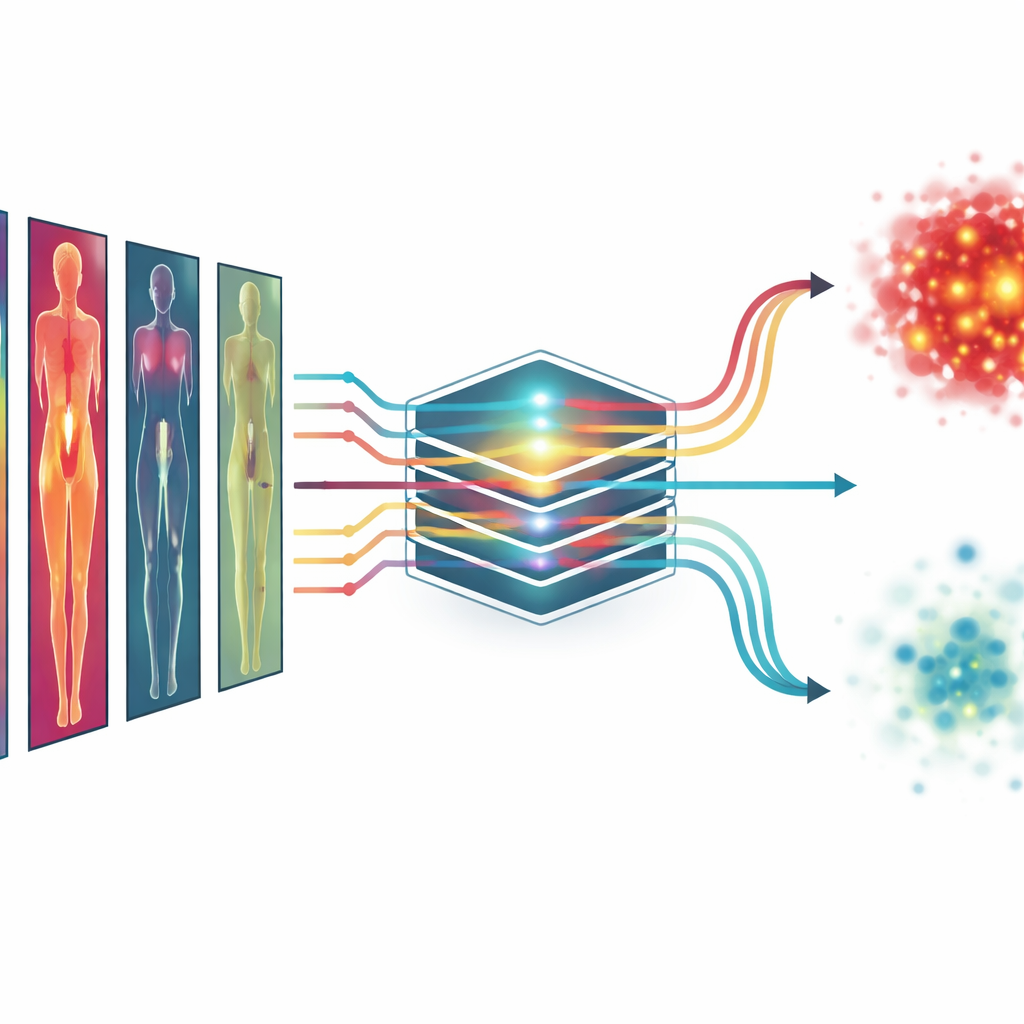

A IA que usou todos os canais PET específicos por tecido previu o volume tumoral e a contagem de lesões com alta precisão, aproximando‑se do desempenho de métodos tridimensionais mais complexos que examinam cada fatia do exame. Também estimou a idade com uma precisão média de cerca de sete anos e classificou o sexo quase perfeitamente. Ao decidir se um exame pertencia a uma pessoa com câncer, o sistema alcançou também uma acurácia muito alta. Importante, a inclusão de informações de múltiplos tecidos e direções de visualização quase sempre melhorou o desempenho em comparação com o uso de uma única imagem mais simples. Isso sugere que os cânceres “deixam sua marca” não apenas em pontos quentes evidentes, mas também em mudanças mais sutis por todo o corpo que as projeções multicanais ajudam a revelar.

Visualizando onde a IA observa

Para enfrentar uma preocupação comum sobre IA — de que funciona como uma caixa‑preta — os pesquisadores usaram uma técnica chamada mapeamento de saliência para destacar quais partes das imagens mais influenciaram cada previsão. Para o volume tumoral e câncer versus ausência de câncer, os pontos quentes nesses mapas corresponderam às localizações reais dos tumores, mostrando que o modelo estava atento a regiões com sentido médico. Para a predição de idade, ele concentrou‑se em áreas como o fígado, músculos da coxa e do ombro e regiões próximas à pelve, conhecidas por mudar com a idade e a composição corporal. Para a classificação de sexo, focalizou-se nas áreas do tórax e da pelve. Esses padrões, confirmados em todo o grupo de pacientes, sugerem que o sistema está aprendendo pistas significativas em vez de se apegar a ruído aleatório.

O que isso pode significar para os pacientes

Embora este trabalho seja uma prova de conceito inicial, ele mostra que exames complexos de corpo inteiro podem ser destilados em imagens 2D eficientes e interpretáveis que ainda permitem à IA prever informações clinicamente importantes. No futuro, modelos semelhantes podem ir além do tamanho e da contagem de tumores para estimar quanto tempo um paciente pode viver, quão bem ele pode responder a um tratamento ou como a doença está progredindo — usando informações que já são coletadas na prática clínica rotineira. Como o método também mostra de onde a IA obtém suas respostas, ele pode ajudar os médicos a entender melhor e a confiar nas sugestões, apoiando um cuidado do câncer mais personalizado e transparente.

Citação: Tarai, S., Lundström, E., Ahmad, N. et al. Interpretable predictions from whole-body FDG-PET/CT using parameters associated with clinical outcome. Commun Med 6, 232 (2026). https://doi.org/10.1038/s43856-026-01567-w

Palavras-chave: Imagem FDG-PET/CT, aprendizado profundo em oncologia, predição da carga tumoral, IA explicável, modelagem de desfecho clínico