Clear Sky Science · es

Predicciones interpretables a partir de FDG‑PET/CT corporal completo usando parámetros asociados con el resultado clínico

Escáneres más inteligentes para la atención del cáncer

Los médicos ya confían en potentes exploraciones corporales para detectar y controlar el cáncer, pero gran parte de la información en estas imágenes queda sin usar porque es demasiado compleja para analizarla a simple vista. Este estudio muestra cómo un sistema de inteligencia artificial (IA) puede convertir exploraciones oncológicas de cuerpo entero en una forma compacta y fácil de analizar, y aun así ofrecer predicciones precisas y comprensibles sobre los tumores de un paciente y su salud general. El enfoque pretende no solo ser inteligente, sino también lo bastante transparente para que los clínicos puedan ver qué está “mirando” la IA, lo que ayuda a generar confianza en las decisiones asistidas por ordenador.

Convertir escáneres 3D del cuerpo en tiras planas de imagen

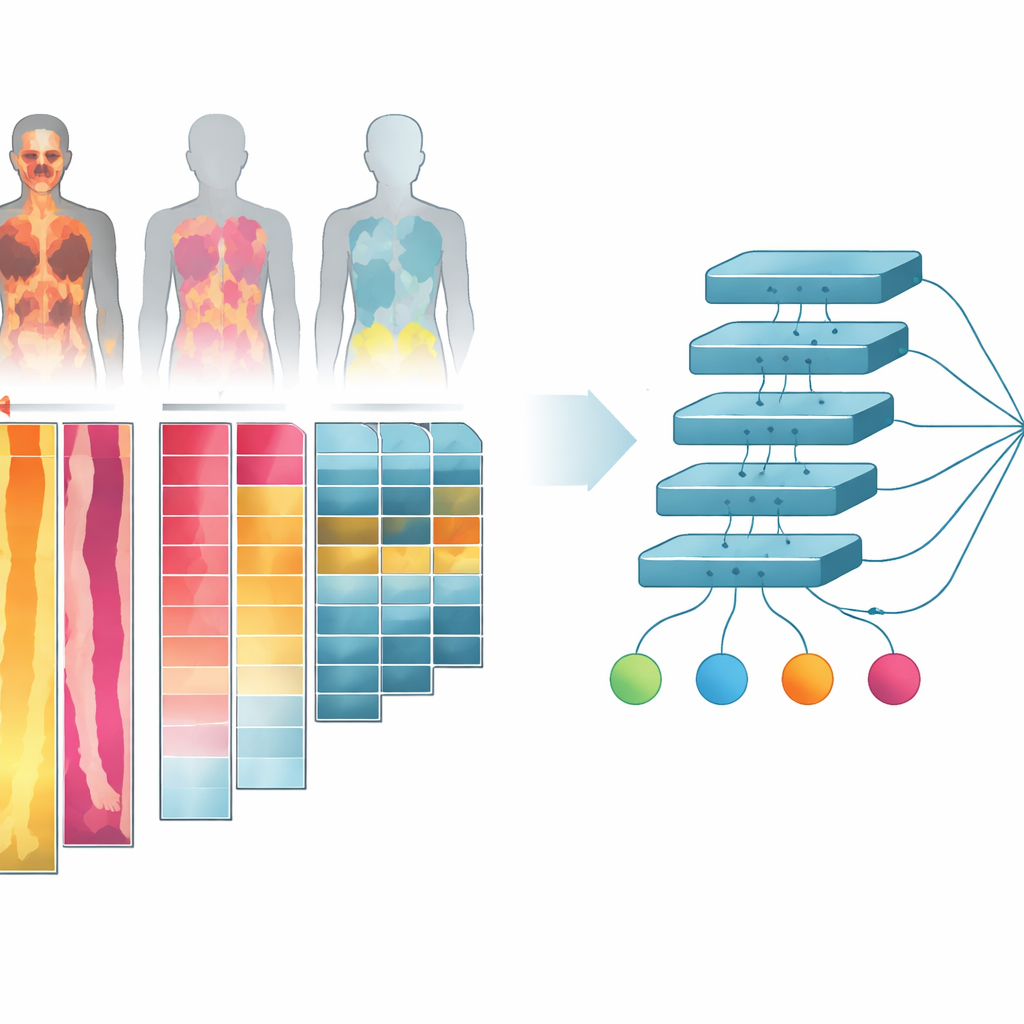

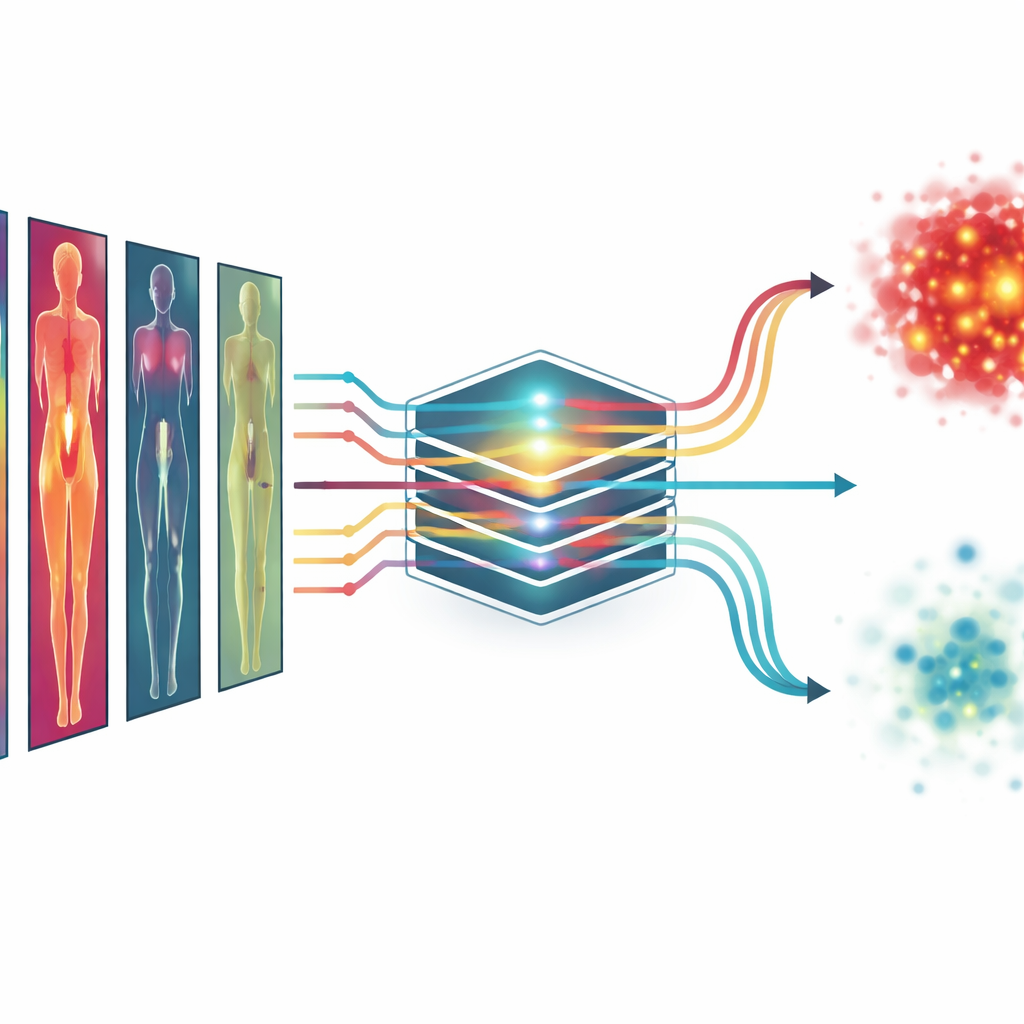

Los investigadores trabajaron con más de mil exploraciones PET/CT combinadas de pacientes con cáncer y controles sanos. Estas exploraciones muestran tanto la estructura corporal (CT) como el apetito de azúcar de distintos tejidos (PET), lo cual es importante porque los cánceres suelen consumir más azúcar que el tejido normal. En lugar de introducir las imágenes tridimensionales completas en la IA —lo que exigiría mucho al hardware— colapsaron las exploraciones en “proyecciones” bidimensionales. También separaron el cuerpo en grupos de tejidos sencillos: hueso, tejido magro como músculos y órganos, grasa corporal y espacios llenos de aire como los pulmones. Para cada tipo de tejido y distintos ángulos de visión, crearon canales de imagen que capturan el aspecto del tejido y su actividad, y luego organizaron esos canales en una imagen tipo collage para cada persona.

Enseñar a la IA a leer señales de salud

Usando estos collages por tejidos, el equipo entrenó un modelo de aprendizaje profundo para predecir varios números clave que se sabe que importan en los resultados oncológicos. Estos incluyeron el volumen tumoral metabólico total (una medida de cuánto tumor activo hay), el número de lesiones independientes, la edad del paciente y si el paciente tenía cáncer o no. También se pidió al modelo que identificara el sexo. Algunos de estos objetivos, como el volumen tumoral, son visibles en las exploraciones; otros, como la edad, no son evidentes y requieren que la IA detecte patrones sutiles en la estructura corporal y el metabolismo. Para que la evaluación fuera justa, los investigadores dividieron repetidamente los datos en grupos de entrenamiento y prueba, de modo que cada exploración sirviera como prueba independiente en algún momento.

Qué tan bien funcionó el sistema

La IA que utilizó todos los canales PET específicos por tejido predijo con alta precisión el volumen tumoral y el recuento de lesiones, acercándose al rendimiento de métodos tridimensionales más complejos que examinan cada corte de la exploración. También estimó la edad con una precisión media de alrededor de siete años y clasificó el sexo casi perfectamente. Al decidir si una exploración pertenecía a una persona con cáncer, el sistema alcanzó asimismo una precisión muy alta. Es importante que incluir información de múltiples tejidos y direcciones de visión mejoró casi siempre el rendimiento en comparación con usar una única imagen más simple. Esto sugiere que los cánceres “dejan su huella” no solo en puntos calientes evidentes, sino también en cambios más sutiles en todo el cuerpo que las proyecciones multicanal ayudan a revelar.

Ver dónde mira la IA

Para abordar una preocupación habitual sobre la IA —que funciona como una caja negra— los investigadores emplearon una técnica llamada mapeo de saliencia para resaltar qué partes de las imágenes influyeron más en cada predicción. Para el volumen tumoral y el diagnóstico cáncer vs. sin cáncer, los puntos calientes en estos mapas coincidieron con ubicaciones reales de tumores, lo que demuestra que el modelo prestaba atención a regiones médicamente sensatas. Para la predicción de la edad, se centró en áreas como el hígado, los músculos del muslo y del hombro, y regiones cercanas a la pelvis, que se sabe cambian con la edad y la composición corporal. Para la clasificación por sexo, se concentró en el pecho y la zona pélvica. Estos patrones, confirmados en todo el conjunto de pacientes, sugieren que el sistema está aprendiendo señales significativas en lugar de fijarse en ruido aleatorio.

Qué podría significar esto para los pacientes

Aunque este trabajo es una prueba de concepto temprana, demuestra que complejas exploraciones oncológicas de cuerpo entero pueden destilarse en imágenes 2D eficientes e interpretables que aún permiten a la IA predecir información clínicamente relevante. En el futuro, modelos similares podrían ir más allá del tamaño y el número de tumores para estimar cuánto tiempo es probable que viva un paciente, cuán bien puede responder al tratamiento o cómo progresa su enfermedad —utilizando información que ya se recoge en la atención rutinaria. Dado que el método también muestra de dónde obtiene la IA sus respuestas, podría ayudar a los médicos a entender mejor y confiar en sus sugerencias, apoyando una atención oncológica más personalizada y transparente.

Cita: Tarai, S., Lundström, E., Ahmad, N. et al. Interpretable predictions from whole-body FDG-PET/CT using parameters associated with clinical outcome. Commun Med 6, 232 (2026). https://doi.org/10.1038/s43856-026-01567-w

Palabras clave: Imágenes FDG‑PET/CT, aprendizaje profundo en oncología, predicción de carga tumoral, IA explicable, modelado de resultados clínicos