Clear Sky Science · nl

Interpreteerbare voorspellingen uit whole-body FDG-PET/CT met parameters gerelateerd aan klinische uitkomst

Slimmere scans voor kankerzorg

Artsen vertrouwen al op krachtige lichaamsscans om kanker op te sporen en te volgen, maar veel informatie in deze beelden blijft onbenut omdat het te complex is om met het blote oog te analyseren. Deze studie laat zien hoe een kunstmatig intelligentiesysteem (AI) whole-body kankerscans kan omzetten in een compacte, gemakkelijk te analyseren vorm en toch nauwkeurige, begrijpelijke voorspellingen kan doen over de tumoren en de algehele gezondheid van een patiënt. De aanpak streeft er niet alleen naar slimmer te zijn, maar ook transparant genoeg zodat clinici kunnen zien waar de AI ‘naar kijkt’, wat helpt vertrouwen in computerondersteunde beslissingen op te bouwen.

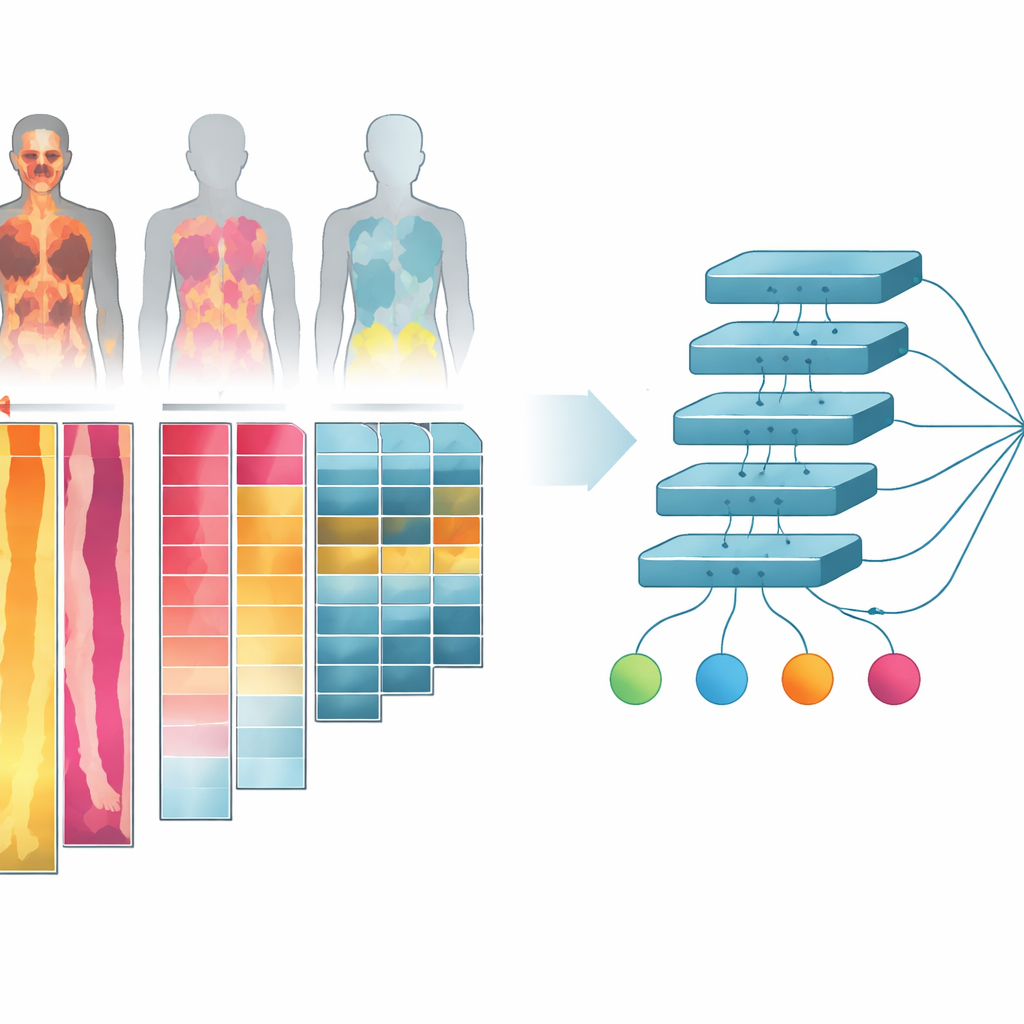

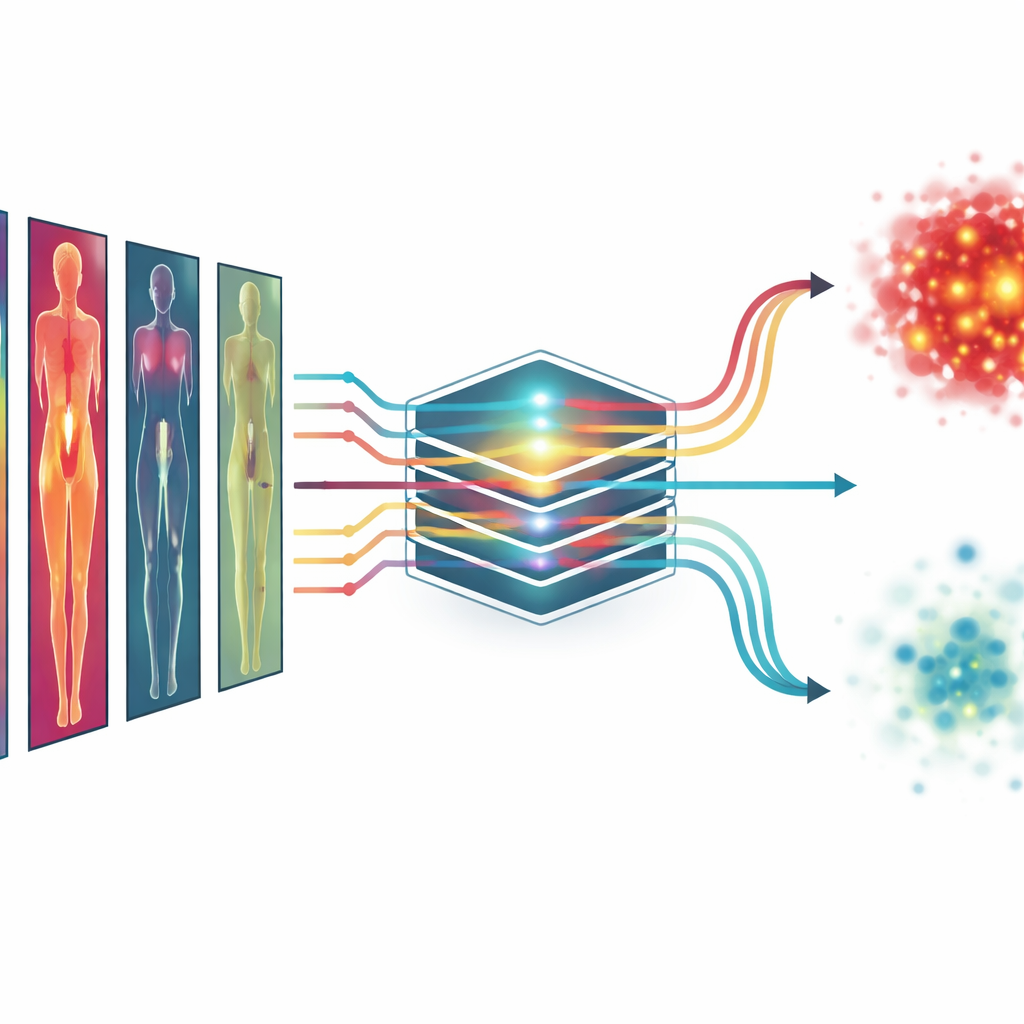

3D-lichaamsscans omzetten in platte beeldstroken

De onderzoekers werkten met meer dan duizend gecombineerde PET/CT-scans van kankerpatiënten en gezonde controles. Deze scans tonen zowel de lichaamsstructuur (CT) als hoe suikerhongerig verschillende weefsels zijn (PET), wat belangrijk is omdat kankers doorgaans meer suiker verbruiken dan normaal weefsel. In plaats van de volledige driedimensionale beelden in de AI te voeren—wat zwaar zou zijn voor computerhardware—vouwden ze de scans samen tot tweedimensionale “projecties.” Ze verdeelden het lichaam ook in eenvoudige weefselgroepen: bot, mager weefsel zoals spieren en organen, lichaamsvet, en met lucht gevulde ruimten zoals de longen. Voor elk weefseltype en voor verschillende kijkhoeken creëerden ze beeldkanalen die vastleggen hoe het weefsel eruitziet en hoe actief het is, en rangschikten deze kanalen vervolgens tot één collage-achtig beeld per persoon.

De AI leren gezondheidssignalen te lezen

Met deze weefselgewijze collages trainde het team een deep learning-model om verschillende belangrijke grootheden te voorspellen die bekend staan als relevant voor kankeruitkomsten. Daartoe behoorden het totale metabolische tumorvolume (een maat voor hoeveel actief tumorweefsel aanwezig is), het aantal afzonderlijke laesies, de leeftijd van de patiënt en de vraag of de patiënt wel of geen kanker had. Het model moest ook man en vrouw onderscheiden. Sommige van deze doelen, zoals tumorvolume, zijn zichtbaar in de scans; andere, zoals leeftijd, zijn helemaal niet voor de hand liggend en vereisen dat de AI subtiele patronen in lichaamsstructuur en metabolisme oppikt. Om de evaluatie eerlijk te maken, splitsten de onderzoekers de gegevens herhaaldelijk in trainings- en testgroepen, zodat elke scan op enig moment als onafhankelijke test diende.

Hoe goed het systeem presteerde

De AI die alle weefsel-specifieke PET-kanalen gebruikte, voorspelde tumorvolume en aantal laesies met hoge nauwkeurigheid en kwam dicht in de buurt van de prestaties van complexere driedimensionale methoden die elke laag van de scan onderzoeken. Het schatte ook de leeftijd gemiddeld tot binnen ongeveer zeven jaar en classificeerde het geslacht bijna perfect. Bij de vraag of een scan van een persoon met kanker kwam, behaalde het systeem eveneens een zeer hoge nauwkeurigheid. Belangrijk is dat het opnemen van informatie uit meerdere weefsels en kijkrichtingen vrijwel altijd de prestaties verbeterde vergeleken met het gebruik van één eenvoudiger beeld. Dit suggereert dat kankers niet alleen hun stempel drukken in duidelijke hete plekken, maar ook in subtielere veranderingen door het lichaam heen die de multi‑channel projecties helpen te onthullen.

Zien waar de AI naar kijkt

Om een veelgehoorde zorg over AI aan te pakken—dat het werkt als een black box—gebruikten de onderzoekers een techniek genaamd saliency mapping om te benadrukken welke delen van de beelden de grootste invloed hadden op elke voorspelling. Voor tumorvolume en kanker versus geen kanker kwamen de hete plekken in deze kaarten overeen met echte tumorlokaties, wat aangeeft dat het model lette op medisch zinnige regio’s. Voor leeftijdsvoorspelling concentreerde het zich op gebieden zoals de lever, dij- en schouderspieren, en regio’s nabij het bekken, die bekend staan te veranderen met leeftijd en lichaamssamenstelling. Voor geslachtsclassificatie lag de focus op de borst- en bekkenstreek. Deze patronen, bevestigd over de hele groep patiënten, suggereren dat het systeem betekenisvolle aanwijzingen leert in plaats van zich vast te klampen aan willekeurige ruis.

Wat dit voor patiënten kan betekenen

Hoewel dit werk een vroege proof of concept is, laat het zien dat complexe whole-body kankerscans kunnen worden gedistilleerd tot efficiënte, interpreteerbare 2D-afbeeldingen die de AI toch in staat stellen klinisch belangrijke informatie te voorspellen. In de toekomst zouden vergelijkbare modellen verder kunnen gaan dan tumorgrootte en aantal en kunnen schatten hoe lang een patiënt waarschijnlijk zal leven, hoe goed hij of zij op behandeling zal reageren, of hoe de ziekte vordert—met gebruik van informatie die al in de routinematige zorg wordt verzameld. Omdat de methode ook laat zien waar de AI zijn antwoorden vandaan haalt, kan het artsen helpen de suggesties beter te begrijpen en te vertrouwen, en zo meer gepersonaliseerde en transparante kankerzorg ondersteunen.

Bronvermelding: Tarai, S., Lundström, E., Ahmad, N. et al. Interpretable predictions from whole-body FDG-PET/CT using parameters associated with clinical outcome. Commun Med 6, 232 (2026). https://doi.org/10.1038/s43856-026-01567-w

Trefwoorden: FDG-PET/CT beeldvorming, deep learning in oncologie, voorspelling van tumorlading, verklaarbare AI, modellering van klinische uitkomst