Clear Sky Science · zh

针对边缘设备上实时检测的大型 YOLOv8 与 RT-DETR 能效评估综述

边缘的智能摄像头

从递送无人机到交通监控摄像头,越来越多的设备需要在远离耗电数据中心的环境中自主识别人和物体。本文提出了这一趋势背后的一个实用问题:如今那些大型且高精度的目标检测模型,能否在树莓派等小型计算机或用于机器人的紧凑 AI 板上高速且高效地运行,而不会耗尽电池?

两种竞争的物体识别“头脑”

作者将注意力集中在两种已成为计算机视觉主力的现代检测器上。一种称为 YOLOv8,是经典卷积神经网络的精简演化,因其速度与精度的平衡长期受到青睐。另一种 RT-DETR 则将这些卷积与变压器模块结合——这种源自语言模型的新型网络擅长捕捉长距离模式。研究使用这两种模型的大型版本,规模大致可比,并测试它们在流行的 COCO 图像集合中识别日常物体的能力。

微型计算机,多种软件路径

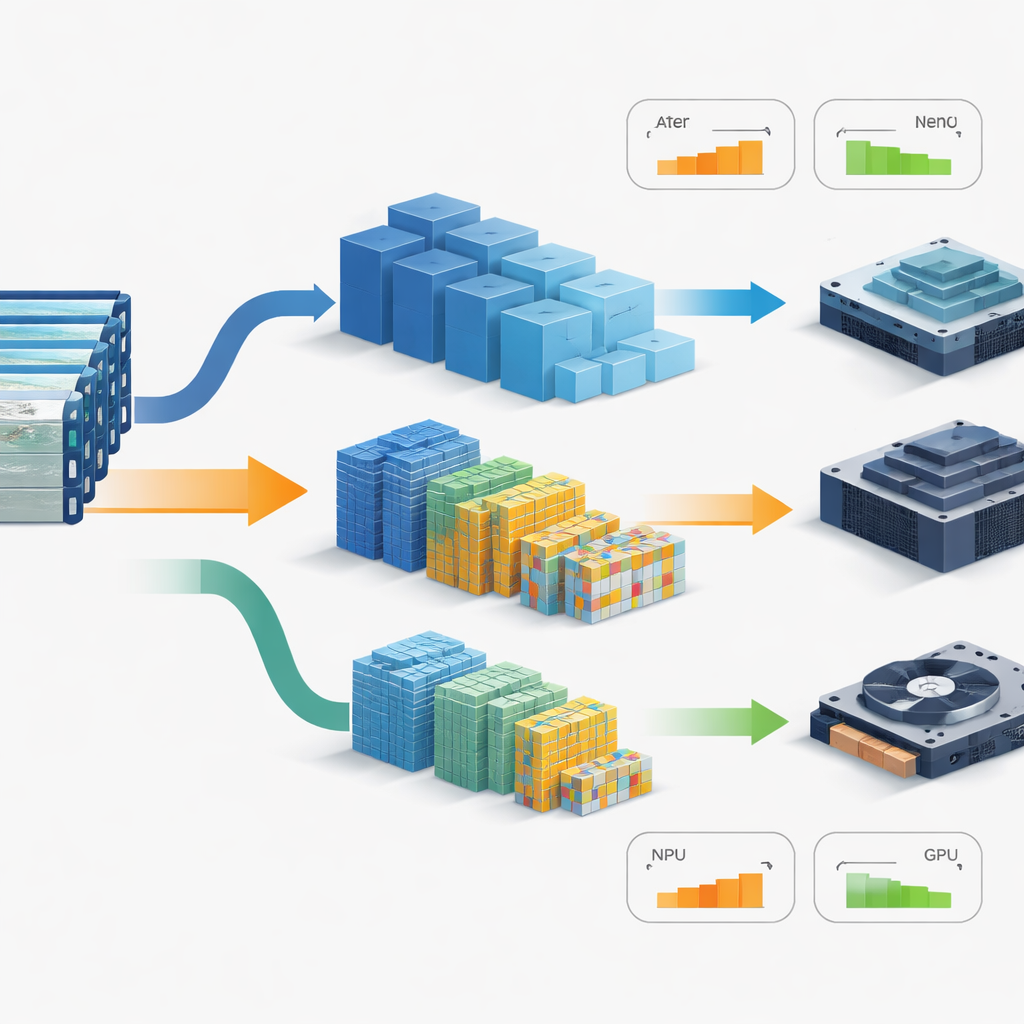

研究团队没有把模型放在大型桌面 GPU 上运行,而是转向两种类似无人机与小型机器人“脑”的边缘平台:树莓派 5 和英伟达 Jetson Orin NX。在树莓派上,他们测试了纯 CPU 执行以及诸如谷歌 Edge TPU 和基于 Hailo-8 的 Raspberry Pi AI HAT+ 等外挂神经加速器。在 Jetson 板上,则依赖其内置 GPU。每个模型通过多种软件引擎运行——从面向研究的框架如 PyTorch 到高度调优的部署工具如 TensorRT、NCNN、MNN、Paddle Lite 和 TensorFlow Lite——以观察软件选择如何重塑速度、功耗与精度。

同时测量速度、功耗与精度

为了模拟真实使用场景,作者不仅计时核心网络。他们输入完整的高清摄像视频流,包括帧解码、为模型准备数据、执行检测和整理结果。他们将“实时”定义为至少每秒处理 25 帧,即标准视频的帧率。虽然模型在许多运行时下的原始检测质量保持较高,但总体帧率和能耗差异巨大。在树莓派上,仅用 CPU 运行大型模型会导致每帧多秒级的延迟和极差的能效。专用神经加速器改变了这种局面:基于 Hailo-8 的路径为 YOLOv8 带来了高能效与强精度,而 Edge TPU 则运行速度快但迫使降低输入分辨率并采用激进的数值舍入,从而使检测质量远低于可用水平。

GPU 调优改变胜负

更强大的 GPU 使 Jetson Orin NX 能更清晰地审视模型设计与部署软件之间的拉锯。在该平台上,TensorRT——一个为英伟达硬件编译与压缩模型的工具链——显著缩短了推理时间并提升了两种检测器的每瓦帧率。在默认的研究设置下,YOLOv8 看起来更快;但在经过全面的 TensorRT 优化并采用低精度计算后,RT-DETR 迎头赶上,甚至在大型模型的原始吞吐量上超越了 YOLOv8。然而,当作者将结果按模型所宣称执行的数学运算量归一化时,YOLOv8 仍在名义工作量单位下用时更少、能耗更低,而 RT-DETR 对于不同工具链之间的转换更为敏感。

为什么原始数字并不能说明全部

为了解读这些发现,论文将性能分为三类成分:模型在纸面上看起来所需的基本计算量、其构建模块在内存中实际移动数据的方式,以及运行时软件带来的开销。像 RT-DETR 中的变压器依赖注意力层,将许多图像位置相互连接,会产生大型中间数据结构,这即使在名义运算量看起来适中时也会加重内存与调度负担。相比之下,卷积为主的设计如 YOLOv8 更易于在嵌入式 GPU 上实现融合核与局部数据重用。作者还表明,部分归因于低精度计算的精度损失实际上在更早阶段就已产生:即从原始训练框架转换为硬件优化引擎时就会发生精度下降。

这对真实设备意味着什么

最终,在任一设备上,所有大型模型配置均未达到完整视频管线严格的每秒 25 帧目标。研究给工程师的结论是,选择“适合边缘”的检测器并非简单从参数量或理论运算数上一眼看出。真正的成功取决于模型结构与特定芯片的相互作用、运行时软件如何编译与调度其操作,以及导出与量化后有多少精度能被保留。目前,要在小型、受功耗限制的平台上实现真正的实时性能,仍需要面向硬件的调优,并且在许多情况下需要采用这些模型的更小版本,而非最大、最精确的版本。

引用: Suchý, I., Turčaník, M. Review of large YOLOv8 and RT-DETR energy efficiency on edge devices for real-time detection. Sci Rep 16, 10908 (2026). https://doi.org/10.1038/s41598-026-46453-6

关键词: 边缘人工智能, 目标检测, 能效, 嵌入式 GPU, 模型量化