Clear Sky Science · pl

Przegląd energooszczędności dużych modeli YOLOv8 i RT-DETR na urządzeniach brzegowych dla detekcji w czasie rzeczywistym

Inteligentne kamery na brzegu sieci

Od dronów dostarczających przesyłki po kamery monitorujące ruch — coraz więcej maszyn musi samodzielnie rozpoznawać osoby i obiekty, działając z dala od energochłonnych centrów danych. Artykuł stawia praktyczne pytanie wynikające z tego trendu: czy dzisiejsze duże, wysokodokładne modele detekcji obiektów mogą działać szybko i energooszczędnie na małych komputerach, takich jak Raspberry Pi czy kompaktowe płytki AI stosowane w robotach, bez nadmiernego zużywania baterii?

Dwa konkurencyjne „mózgi” do wykrywania obiektów

Autorzy koncentrują się na dwóch nowoczesnych detektorach obiektów, które stały się podstawowymi narzędziami w wizji komputerowej. Jeden, nazwany YOLOv8, to wysmukła ewolucja klasycznych sieci splotowych, od dawna cenionych za kompromis między szybkością a dokładnością. Drugi, RT-DETR, łączy te sploty z blokami transformerów — nowszym typem sieci zapożyczonym z modeli językowych, doskonałym w uchwyceniu długozasięgowych zależności. Badanie wykorzystuje duże wersje obu modeli, mniej więcej porównywalne pod względem rozmiaru, i testuje, jak dobrze rozpoznają codzienne obiekty w popularnym zbiorze obrazów COCO.

Malutkie komputery, wiele ścieżek oprogramowania

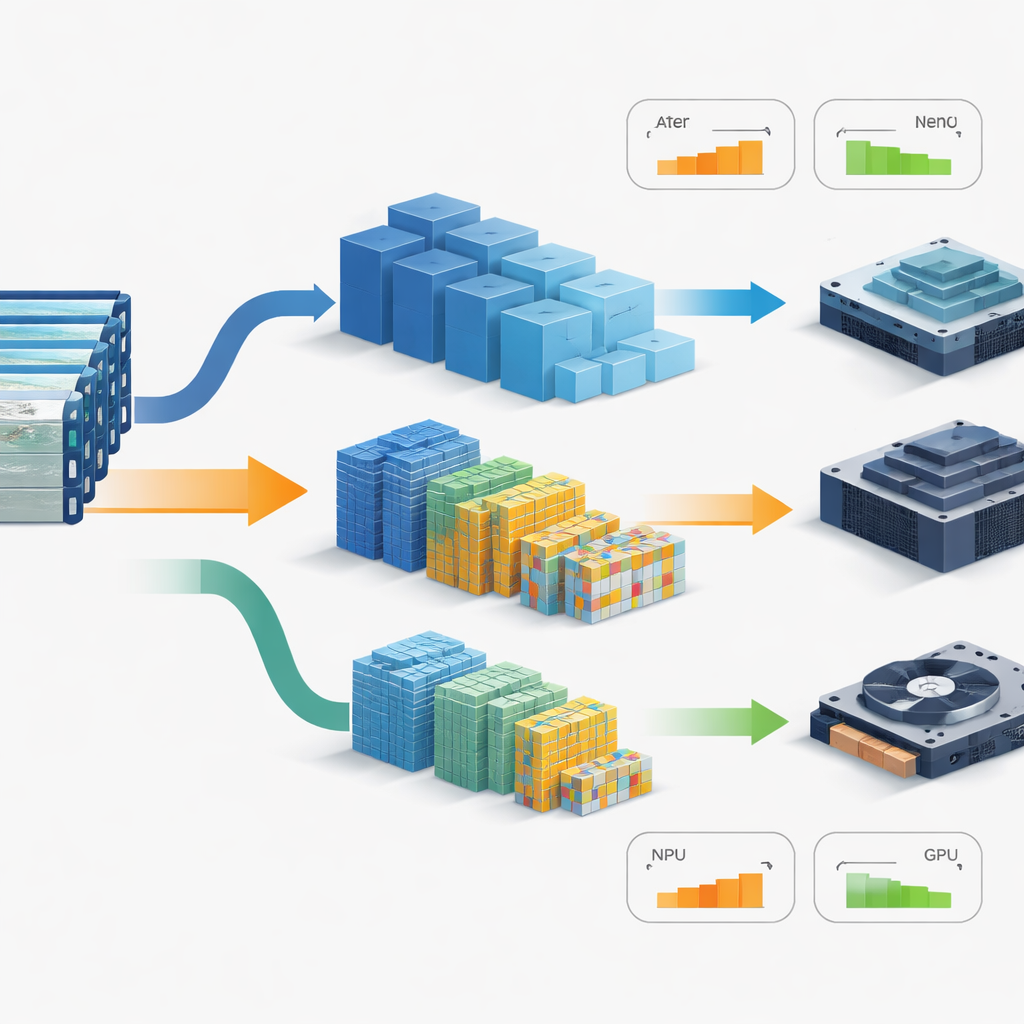

Zamiast uruchamiać te modele na dużej karcie GPU w stacji roboczej, zespół sięga po dwie platformy brzegowe przypominające mózgi dronów i małych robotów: Raspberry Pi 5 i Nvidia Jetson Orin NX. Na Raspberry Pi testują działanie tylko na CPU oraz dedykowane układy neuronowe, takie jak Edge TPU firmy Google oraz oparty na Hailo-8 moduł Raspberry Pi AI HAT+. Na płytce Jetson polegają na wbudowanym GPU. Każdy model jest uruchamiany przez wiele silników programowych — od frameworków badawczych jak PyTorch po wysoko wyspecjalizowane narzędzia wdrożeniowe typu TensorRT, NCNN, MNN, Paddle Lite i TensorFlow Lite — by sprawdzić, jak wybór oprogramowania wpływa na szybkość, pobór mocy i dokładność.

Pomiary szybkości, zużycia energii i precyzji razem

Aby odwzorować użycie w warunkach rzeczywistych, autorzy nie mierzą jedynie czasu samej sieci. Wprowadzają pełny strumień wideo w wysokiej rozdzielczości, włączając dekodowanie klatek, przygotowanie ich dla modelu, uruchomienie detekcji i uporządkowanie wyników. Definiują „czas rzeczywisty” jako co najmniej 25 przetworzonych klatek na sekundę, czyli standardową prędkość wideo. Choć surowa jakość detekcji modeli pozostaje wysoka w wielu środowiskach uruchomieniowych, ogólna liczba klatek na sekundę i zużycie energii różnią się znacząco. Na Raspberry Pi uruchamianie dużych modeli wyłącznie na CPU prowadzi do wielosekundowych opóźnień na klatkę i bardzo słabej efektywności energetycznej. Dedykowane układy neuronowe zmieniają ten obraz: ścieżka oparta na Hailo-8 zapewnia YOLOv8 zarówno wysoką efektywność energetyczną, jak i dobrą dokładność, podczas gdy Edge TPU działa szybko, lecz wymusza niższą rozdzielczość wejściową i agresywne zaokrąglanie liczb, co obniża jakość detekcji znacznie poniżej praktycznego poziomu.

Strojenie GPU zmienia zwycięzcę

Jetson Orin NX, z mocniejszym GPU, pozwala przyjrzeć się bliżej rywalizacji między projektem modelu a oprogramowaniem wdrożeniowym. Tutaj TensorRT — łańcuch narzędzi kompilujący i kompresujący modele pod sprzęt Nvidii — skraca czasy inferencji dramatycznie i zwiększa liczbę klatek na sekundę na wat dla obu detektorów. W domyślnej konfiguracji badawczej YOLOv8 wydaje się szybszy. Po pełnej optymalizacji w TensorRT i zastosowaniu arytmetyki niskiej precyzji, RT-DETR dogania, a nawet wyprzedza YOLOv8 w surowej przepustowości dla dużych modeli. Jednak gdy autorzy normalizują wyniki względem zadeklarowanej ilości operacji matematycznych wykonywanych przez każdy model, YOLOv8 nadal zużywa mniej czasu i energii na jednostkę nominalnej pracy, podczas gdy RT-DETR okazuje się bardziej wrażliwy na kroki konwersji między łańcuchami narzędzi.

Dlaczego same liczby nie opowiadają całej historii

Aby rozłożyć te ustalenia, artykuł rozdziela trzy składniki wydajności: podstawową ilość obliczeń, które model wydaje się wymagać na papierze, sposób, w jaki jego bloki rzeczywiście przesuwają dane przez pamięć, oraz narzut dodawany przez oprogramowanie uruchomieniowe. Transformatory, takie jak w RT-DETR, opierają się na warstwach uwagi łączących wiele lokalizacji obrazu między sobą, generując duże struktury pośrednie, które mogą obciążać pamięć i harmonogram nawet wtedy, gdy nominalne liczby operacji wyglądają umiarkowanie. Konstrukcje bazujące na splotach, jak YOLOv8, z kolei łatwiej poddają się fuzji jąder i lokalnemu ponownemu użyciu danych na zintegrowanych GPU. Autorzy pokazują też, że część utraty dokładności przypisywanej arytmetyce niskiej precyzji faktycznie pojawia się wcześniej, podczas konwersji z oryginalnego środowiska treningowego do silnika zoptymalizowanego pod kątem sprzętu.

Co to oznacza dla urządzeń w realnym świecie

Ostatecznie żadna z konfiguracji dużych modeli na którymkolwiek z urządzeń nie osiąga rygorystycznego celu 25 klatek na sekundę dla pełnego potoku wideo. Wnioskiem dla inżynierów jest to, że wybór „gotowego na edge” detektora nie jest tak prosty, jak odczytanie liczby parametrów czy teoretycznych operacji. Prawdziwy sukces zależy od tego, jak struktura modelu współgra z konkretnym układem, jak dobrze oprogramowanie uruchomieniowe kompiluje i harmonogramuje jego operacje oraz ile dokładności przetrwa eksport i kwantyzację. Na razie osiągnięcie rzeczywistej pracy w czasie rzeczywistym na małych, ograniczonych energetycznie platformach będzie nadal wymagać dostrojenia z uwzględnieniem sprzętu i, w wielu przypadkach, użycia mniejszych wersji tych modeli zamiast największych i najdokładniejszych.

Cytowanie: Suchý, I., Turčaník, M. Review of large YOLOv8 and RT-DETR energy efficiency on edge devices for real-time detection. Sci Rep 16, 10908 (2026). https://doi.org/10.1038/s41598-026-46453-6

Słowa kluczowe: edge AI, wykrywanie obiektów, efektywność energetyczna, zintegrowane GPU, kwantyzacja modelu