Clear Sky Science · it

Revisione dell’efficienza energetica di grandi YOLOv8 e RT-DETR su dispositivi edge per il rilevamento in tempo reale

Telecamere intelligenti all’edge

Dai droni per le consegne alle telecamere per il monitoraggio del traffico, sempre più macchine devono riconoscere autonomamente persone e oggetti, lontano dai data center ad alto consumo. Questo articolo pone una domanda pratica dietro a questa tendenza: i moderni modelli di rilevamento oggetti, grandi e ad alta accuratezza, possono essere eseguiti rapidamente ed efficientemente su piccoli computer come un Raspberry Pi o schede AI compatte impiegate nei robot, senza prosciugare le batterie?

Due cervelli rivali per individuare oggetti

Gli autori si concentrano su due rilevatori di oggetti moderni che sono diventati cavalli di battaglia della visione artificiale. Uno, chiamato YOLOv8, è un’evoluzione snella delle reti neuronali convoluzionali classiche, a lungo preferite per l’equilibrio tra velocità e accuratezza. L’altro, RT-DETR, mescola queste convoluzioni con blocchi transformer, un tipo di rete più recente preso in prestito dai modelli linguistici che eccelle nel catturare pattern a lungo raggio. Lo studio utilizza le versioni large di entrambi i modelli, approssimativamente comparabili in dimensione, e verifica quanto bene riescano a individuare oggetti di uso quotidiano nella popolare collezione di immagini COCO.

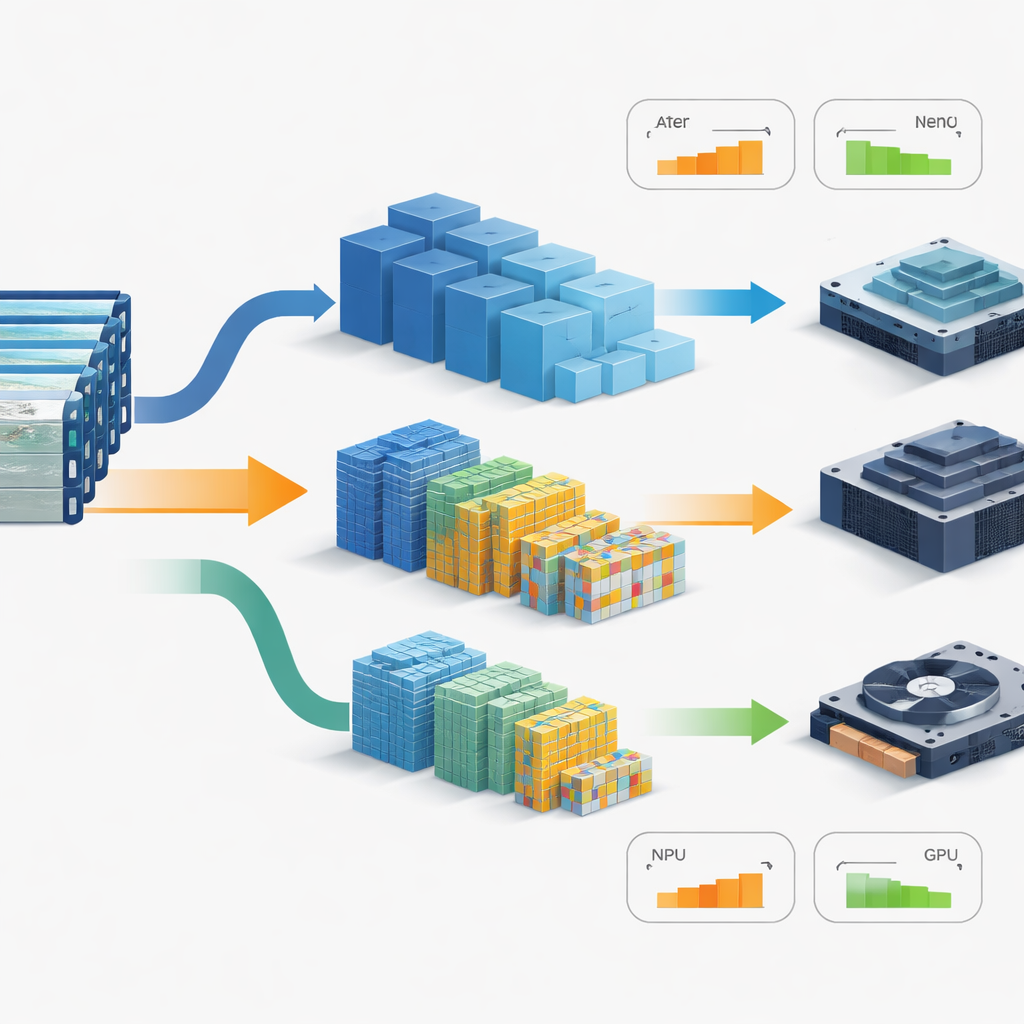

Piccoli computer, molte strade software

Invece di eseguire questi modelli su una grande GPU desktop, il team si rivolge a due piattaforme edge che ricordano i cervelli di droni e piccoli robot: un Raspberry Pi 5 e una Nvidia Jetson Orin NX. Sul Raspberry Pi testano l’esecuzione su sola CPU e chip neurali addizionali come l’Edge TPU di Google e il Raspberry Pi AI HAT+ basato su Hailo-8. Sulla scheda Jetson fanno leva sulla GPU integrata. Ogni modello viene eseguito tramite molteplici motori software — da framework orientati alla ricerca come PyTorch a strumenti di deployment altamente ottimizzati come TensorRT, NCNN, MNN, Paddle Lite e TensorFlow Lite — per vedere come le scelte software rimodellino velocità, consumo energetico e accuratezza.

Misurare insieme velocità, potenza e precisione

Per emulare l’uso reale, gli autori non si limitano a cronometrarne la rete principale. Immettono un flusso video in alta definizione completo, includendo la decodifica dei frame, la loro preparazione per il modello, l’esecuzione del rilevamento e la gestione dei risultati. Definiscono “tempo reale” almeno 25 frame processati al secondo, la velocità del video standard. Mentre la qualità di rilevamento grezza dei modelli resta elevata su molti runtime, il frame rate complessivo e l’uso energetico variano moltissimo. Sul Raspberry Pi, eseguire i modelli large solo sulla CPU porta a ritardi di più secondi per frame e a un’efficienza energetica estremamente scarsa. I chip neurali dedicati cambiano lo scenario: il percorso Hailo-8 conferisce a YOLOv8 sia alta efficienza energetica sia buona accuratezza, mentre l’Edge TPU è veloce ma impone risoluzioni di input inferiori e arrotondamenti numerici aggressivi, che riducono la qualità del rilevamento ben al di sotto di livelli pratici.

La messa a punto GPU ribalta il vincitore

La Jetson Orin NX, con la sua GPU più potente, consente uno sguardo più approfondito alla competizione tra progettazione del modello e software di deployment. Qui, TensorRT — una toolchain che compila e comprime i modelli per hardware Nvidia — riduce drasticamente i tempi di inference e aumenta i frame per secondo per watt per entrambi i rilevatori. Nella configurazione di ricerca di default YOLOv8 sembra più veloce. Dopo l’ottimizzazione completa con TensorRT e l’applicazione di aritmetica a bassa precisione, RT-DETR recupera terreno e supera persino YOLOv8 in throughput grezzo per i modelli large. Tuttavia, quando gli autori normalizzano i risultati rispetto alla quantità dichiarata di operazioni matematiche eseguite da ciascun modello, YOLOv8 usa ancora meno tempo e meno energia per unità di lavoro nominale, mentre RT-DETR si dimostra più sensibile ai passaggi di conversione tra toolchain.

Perché i numeri grezzi non raccontano tutta la storia

Per spiegare questi risultati, l’articolo separa tre ingredienti della performance: la quantità di calcolo che ciascun modello sembra richiedere sulla carta, il modo in cui i suoi blocchi costitutivi effettivamente muovono i dati nella memoria, e l’overhead aggiunto dal software di runtime. I transformer come quelli in RT-DETR si basano su layer di attenzione che connettono molte posizioni dell’immagine tra loro, producendo grandi strutture dati intermedie che possono gravare sulla memoria e sulla schedulazione anche se il conto nominale delle operazioni appare contenuto. I design pesanti di convoluzione come YOLOv8, al contrario, si prestano più facilmente a kernel fusi e al riuso locale dei dati sulle GPU embedded. Gli autori mostrano anche che parte della perdita di accuratezza attribuita all’aritmetica a bassa precisione si manifesta in realtà prima, durante la conversione dal framework di addestramento originale a un motore ottimizzato per l’hardware.

Cosa significa per i dispositivi nel mondo reale

Alla fine, nessuna delle configurazioni con modelli large su nessuno dei due dispositivi raggiunge l’obiettivo stringente di 25 frame al secondo per l’intera pipeline video. Il messaggio dello studio per gli ingegneri è che scegliere un rilevatore “pronto per l’edge” non è semplice come leggere il numero di parametri o le operazioni teoriche. Il successo reale dipende da come la struttura del modello interagisce con il chip specifico, da quanto bene il software di runtime compila e schedula le sue operazioni e da quanta accuratezza sopravvive all’export e alla quantizzazione. Per ora, ottenere prestazioni realmente in tempo reale su piattaforme piccole e a basso consumo richiederà ancora tuning consapevole dell’hardware e, in molti casi, versioni più piccole di questi modelli piuttosto che le varianti più grandi e accurate.

Citazione: Suchý, I., Turčaník, M. Review of large YOLOv8 and RT-DETR energy efficiency on edge devices for real-time detection. Sci Rep 16, 10908 (2026). https://doi.org/10.1038/s41598-026-46453-6

Parole chiave: edge AI, rilevamento oggetti, efficienza energetica, GPU embedded, quantizzazione del modello