Clear Sky Science · nl

Beoordeling van energie-efficiëntie van grote YOLOv8 en RT-DETR op edge-apparaten voor realtime detectie

Slimme camera’s aan de edge

Van bezorgdrones tot verkeerscamera’s: steeds meer apparaten moeten zelfstandig mensen en objecten herkennen, ver weg van energie-intensieve datacenters. Dit artikel stelt een praktische vraag achter die ontwikkeling: kunnen de huidige grote, nauwkeurige objectdetectiemodellen snel en efficiënt draaien op kleine computers zoals een Raspberry Pi of compacte AI-borden in robots, zonder hun batterijen leeg te trekken?

Twee concurrerende ‘hersenen’ voor objectherkenning

De auteurs richten zich op twee moderne objectdetectoren die in computer vision veel gebruikt zijn. De ene, YOLOv8, is een gestroomlijnde evolutie van klassieke convolutionele neurale netwerken, al lang populair vanwege hun balans tussen snelheid en nauwkeurigheid. De andere, RT-DETR, combineert deze convoluties met transformer-blokken, een nieuwere netwerkomgeving ontleend aan taalmodellen die sterk is in het vastleggen van lang-range patronen. De studie gebruikt de grote varianten van beide modellen, ongeveer vergelijkbaar in omvang, en test hoe goed ze alledaagse objecten herkennen in de veelgebruikte COCO-afbeeldingsdataset.

Kleine computers, vele softwareroutes

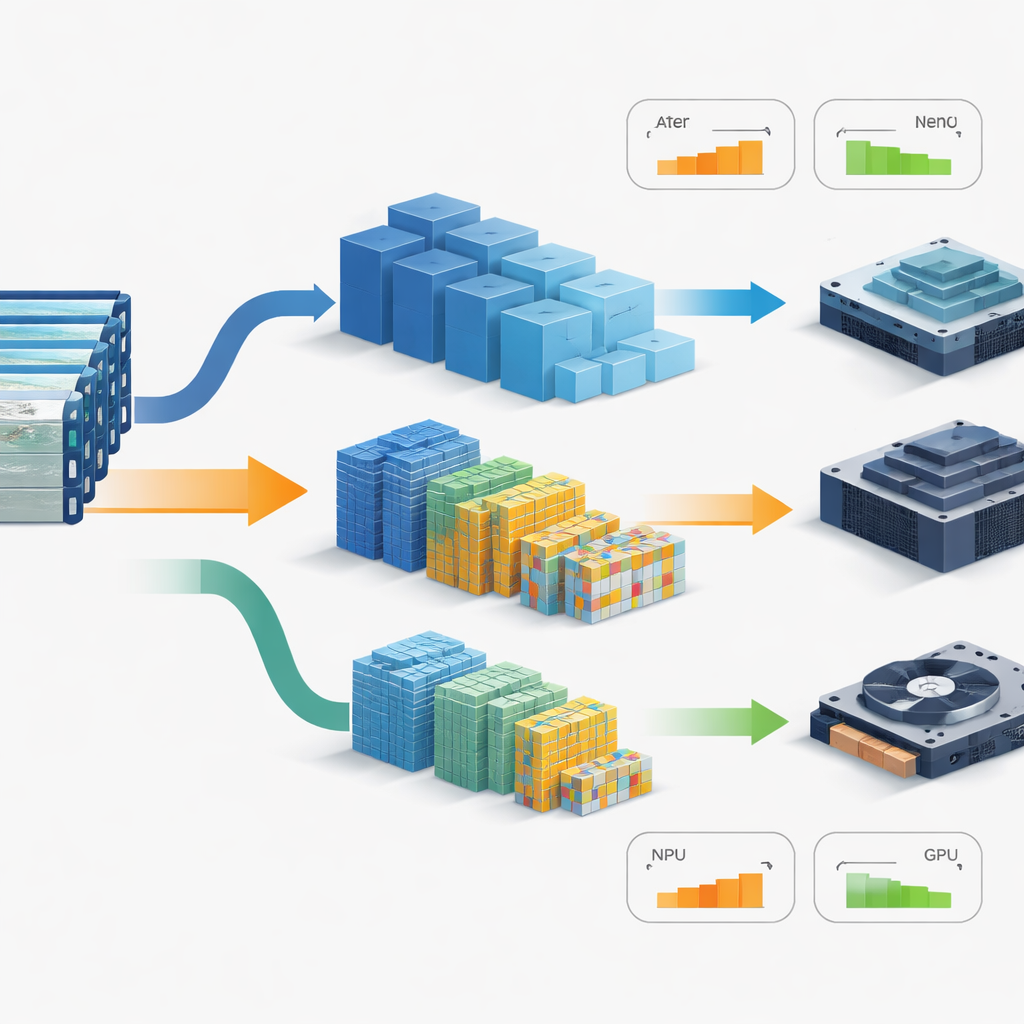

In plaats van deze modellen op een grote desktop-GPU te draaien, kiest het team twee edge-platforms die lijken op de breinen van drones en kleine robots: een Raspberry Pi 5 en een Nvidia Jetson Orin NX. Op de Raspberry Pi testen ze puur CPU-uitvoering en add-on neurale chips zoals Google’s Edge TPU en de Hailo-8-gebaseerde Raspberry Pi AI HAT+. Op het Jetson-bord leunen ze op de ingebouwde GPU. Elk model wordt door meerdere software-engines gehaald—van onderzoekskaders als PyTorch tot sterk geoptimaliseerde deployment-tools zoals TensorRT, NCNN, MNN, Paddle Lite en TensorFlow Lite—om te zien hoe softwarekeuzes snelheid, stroomverbruik en nauwkeurigheid hervormen.

Samen snelheid, vermogen en precisie meten

Om reële toepassing na te bootsen, timen de auteurs niet alleen het kernnetwerk. Ze voeren een volledige high-definition videostream in, inclusief decoderen van frames, voorbereiding voor het model, detectie en het afronden van resultaten. Ze definiëren “realtime” als minstens 25 verwerkte frames per seconde, de frequentie van standaardvideo. Terwijl de ruwe detectiekwaliteit van de modellen bij veel runtimes hoog blijft, variëren de totale framerate en het energiegebruik enorm. Op de Raspberry Pi leidt het draaien van grote modellen alleen op de CPU tot vertragingen van meerdere seconden per frame en extreem slechte energie-efficiëntie. Toegewijde neurale chips veranderen het beeld: het Hailo-8-pad geeft YOLOv8 zowel hoge energie-efficiëntie als sterke nauwkeurigheid, terwijl de Edge TPU snel draait maar lagere invoerresolutie en agressieve afronding forceert, wat de detectiekwaliteit ver onder praktische niveaus drukt.

GPU-afstemming draait de winnaar om

De Jetson Orin NX, met zijn krachtigere GPU, maakt een nauwere blik op de wrijving tussen modelontwerp en deploymentsoftware mogelijk. Hier verkleint TensorRT—een toolchain die modellen compileert en comprimeert voor Nvidia-hardware—de inferentietijden drastisch en verhoogt het aantal frames per seconde per watt voor beide detectors. Onder de standaard onderzoeksopstelling lijkt YOLOv8 sneller. Na volledige TensorRT-optimalisatie en laagprecisie-berekeningen loopt RT-DETR in en overtreft YOLOv8 zelfs in ruwe doorvoer voor grote modellen. Toch, wanneer de auteurs de resultaten normaliseren naar de opgegeven hoeveelheid rekenwerk die elk model uitvoert, gebruikt YOLOv8 nog steeds minder tijd en energie per eenheid nominaal werk, terwijl RT-DETR gevoeliger blijkt voor conversiestappen tussen toolchains.

Waarom ruwe cijfers niet het hele verhaal vertellen

Om deze bevindingen te verklaren, scheidt het artikel drie ingrediënten van prestatie: de basishoeveelheid berekening die elk model op papier lijkt te vereisen, de manier waarop de bouwblokken daadwerkelijk data door het geheugen bewegen, en de overhead die de runtime-software toevoegt. Transformers zoals die in RT-DETR vertrouwen op attention-lagen die veel afbeeldingslocaties met elkaar verbinden, wat grote tussentijdse datastructuren oplevert die geheugen en scheduling kunnen belasten, zelfs als hun nominale operatieaantallen bescheiden lijken. Convolutie-gedreven ontwerpen zoals YOLOv8 lenen zich daarentegen makkelijker voor gefuseerde kernels en lokaal hergebruik van data op embedded GPU’s. De auteurs tonen ook aan dat een deel van het nauwkeurigheidsverlies dat aan laagprecisie-berekeningen wordt toegeschreven, eigenlijk eerder ontstaat tijdens de conversie van het oorspronkelijke trainingskader naar een hardware-geoptimaliseerde engine.

Wat dit betekent voor apparaten in de praktijk

Uiteindelijk haalt geen van de grote-modelconfiguraties op een van beide apparaten het strikte doel van 25 frames per seconde voor de volledige videopijplijn. De les voor ingenieurs is dat het kiezen van een “edge-ready” detector niet zo simpel is als het aflezen van parameteraantallen of theoretische operatiegetallen. Echt succes hangt af van hoe de structuur van het model samenwerkt met de specifieke chip, hoe goed de runtime-software zijn operaties compileert en plant, en hoeveel nauwkeurigheid overblijft na export en quantisatie. Voorlopig vereist het behalen van echte realtime-prestaties op kleine, energie-beperkte platforms nog steeds hardwarebewuste afstemming en, in veel gevallen, kleinere versies van deze modellen in plaats van de grootste en meest accurate varianten.

Bronvermelding: Suchý, I., Turčaník, M. Review of large YOLOv8 and RT-DETR energy efficiency on edge devices for real-time detection. Sci Rep 16, 10908 (2026). https://doi.org/10.1038/s41598-026-46453-6

Trefwoorden: edge-AI, objectdetectie, energie-efficiëntie, embedded GPU, modelquantisatie