Clear Sky Science · pt

Avaliação da eficiência energética de grandes YOLOv8 e RT-DETR em dispositivos de borda para detecção em tempo real

Câmeras inteligentes na borda

De drones de entrega a câmeras de monitoramento de tráfego, cada vez mais máquinas precisam reconhecer pessoas e objetos por conta própria, longe de centros de dados consumidores de energia. Este artigo faz uma pergunta prática por trás dessa tendência: os grandes modelos modernos de detecção de objetos, de alta precisão, conseguem rodar de forma rápida e eficiente em computadores minúsculos como um Raspberry Pi ou placas AI compactas usadas em robôs, sem esgotar suas baterias?

Dois cérebros rivais para detectar objetos

Os autores se concentram em dois detectores modernos de objetos que se tornaram ferramentas de trabalho na visão computacional. Um, chamado YOLOv8, é uma evolução enxuta das redes neurais convolucionais clássicas, há muito tempo favorecidas por seu equilíbrio entre velocidade e precisão. O outro, RT-DETR, mistura essas convoluções com blocos transformer, um tipo mais novo de rede emprestado de modelos de linguagem que se destaca em capturar padrões de longo alcance. O estudo usa as versões large de ambos os modelos, aproximadamente comparáveis em tamanho, e testa quão bem eles conseguem identificar objetos do cotidiano na popular coleção de imagens COCO.

Computadores minúsculos, muitos caminhos de software

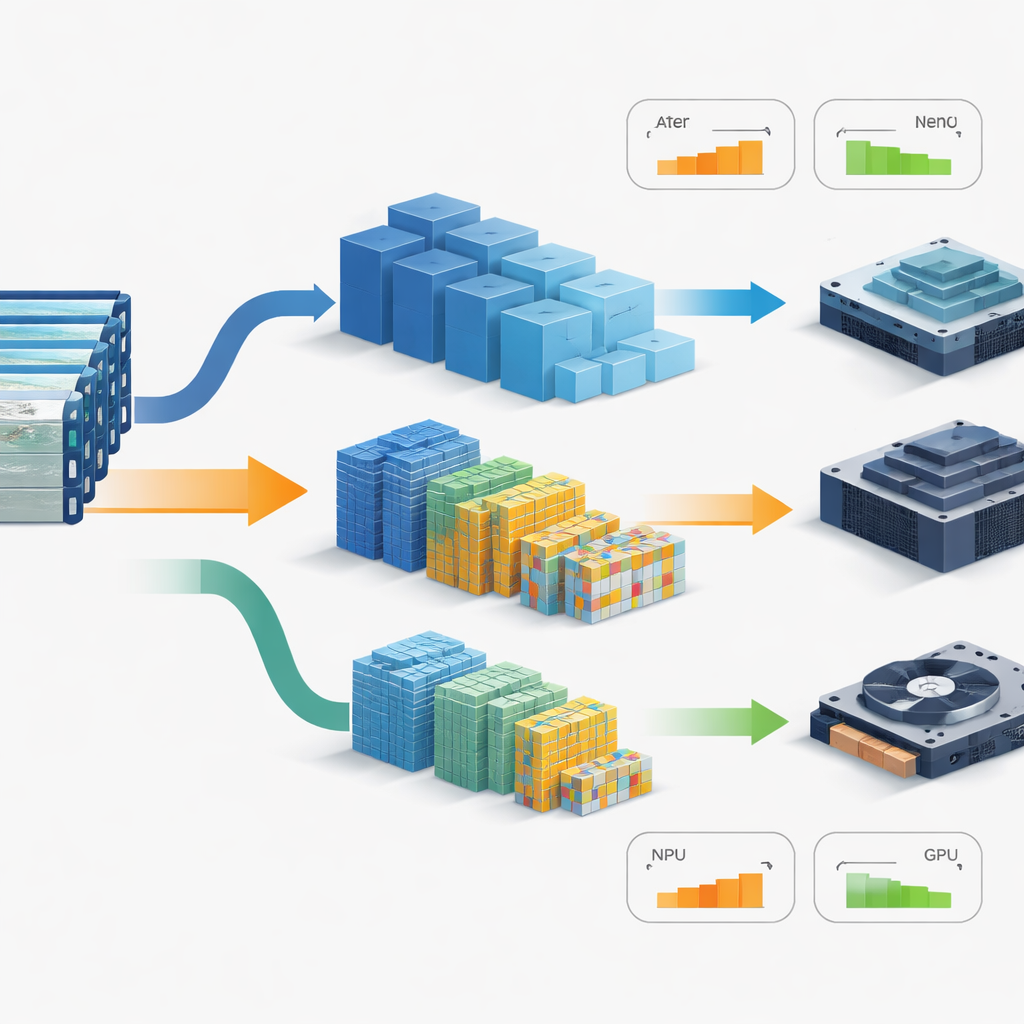

Em vez de rodar esses modelos em uma grande GPU de desktop, a equipe recorre a duas plataformas de borda que se assemelham aos cérebros de drones e pequenos robôs: um Raspberry Pi 5 e uma Nvidia Jetson Orin NX. No Raspberry Pi, eles testam execução pura em CPU e chips neurais adicionais, como o Edge TPU do Google e o Raspberry Pi AI HAT+ baseado em Hailo-8. Na placa Jetson, aproveitam sua GPU integrada. Cada modelo é executado por múltiplos motores de software — de frameworks orientados à pesquisa como PyTorch a ferramentas de deploy altamente ajustadas como TensorRT, NCNN, MNN, Paddle Lite e TensorFlow Lite — para ver como escolhas de software reconfiguram velocidade, consumo de energia e precisão.

Medindo velocidade, energia e precisão em conjunto

Para imitar o uso no mundo real, os autores não cronometraram apenas a rede central. Eles alimentam um fluxo de vídeo em alta definição completo, incluindo a decodificação dos frames, o preparo para o modelo, a execução da detecção e a organização dos resultados. Definem “tempo real” como pelo menos 25 frames por segundo processados, a taxa de vídeo padrão. Enquanto a qualidade bruta de detecção dos modelos permanece alta em muitos runtimes, a taxa de frames e o consumo de energia variam dramaticamente. No Raspberry Pi, executar modelos large apenas na CPU leva a atrasos de vários segundos por frame e eficiência energética extremamente baixa. Chips neurais dedicados mudam essa cena: o caminho com Hailo-8 dá ao YOLOv8 alta eficiência energética e boa precisão, enquanto o Edge TPU roda rapidamente, mas força resolução de entrada menor e arredondamento numérico agressivo, o que reduz a qualidade de detecção muito abaixo de níveis práticos.

Ajustes na GPU viram o vencedor

A Jetson Orin NX, com sua GPU mais poderosa, permite observar mais de perto a disputa entre o desenho do modelo e o software de deploy. Aqui, o TensorRT — uma cadeia de ferramentas que compila e comprime modelos para hardware Nvidia — reduz drasticamente os tempos de inferência e aumenta frames por segundo por watt para ambos os detectores. No setup padrão de pesquisa, o YOLOv8 parece mais rápido. Após otimizações completas do TensorRT e aplicação de aritmética de baixa precisão, o RT-DETR alcança e até supera o YOLOv8 em throughput bruto para modelos large. Ainda assim, quando os autores normalizam os resultados pela quantidade anunciada de operações que cada modelo realiza, o YOLOv8 continua a usar menos tempo e menos energia por unidade de trabalho nominal, enquanto o RT-DETR se mostra mais sensível às etapas de conversão entre toolchains.

Por que números brutos não contam toda a história

Para explicar esses achados, o artigo separa três ingredientes do desempenho: a quantidade básica de computação que cada modelo aparenta exigir no papel, a forma como seus blocos de construção realmente movem dados pela memória e a sobrecarga adicionada pelo software em tempo de execução. Transformers como os do RT-DETR dependem de camadas de atenção que conectam muitas posições da imagem entre si, gerando grandes estruturas de dados intermediárias que podem sobrecarregar memória e escalonamento mesmo que suas contagens nominais de operações pareçam modestas. Projetos pesados em convolução, como o YOLOv8, ao contrário, se prestam mais facilmente a kernels fundidos e reuso local de dados em GPUs embarcadas. Os autores também mostram que parte da perda de precisão atribuída à aritmética de baixa precisão na verdade surge mais cedo, durante a conversão do framework de treinamento original para um motor otimizado para hardware.

O que isso significa para dispositivos do mundo real

No fim, nenhuma das configurações com modelos large em qualquer dos dispositivos alcança a meta estrita de 25 frames por segundo para o pipeline de vídeo completo. A lição do estudo para engenheiros é que escolher um detector “pronto para a borda” não é tão simples quanto olhar contagens de parâmetros ou números teóricos de operações. O sucesso real depende de como a estrutura do modelo interage com o chip específico, de quão bem o software de runtime compila e agenda suas operações e de quanta precisão sobrevive ao processo de exportação e quantização. Por enquanto, alcançar desempenho verdadeiramente em tempo real em plataformas pequenas e com limite de energia ainda exigirá ajuste ciente de hardware e, em muitos casos, versões menores desses modelos em vez das maiores e mais precisas.

Citação: Suchý, I., Turčaník, M. Review of large YOLOv8 and RT-DETR energy efficiency on edge devices for real-time detection. Sci Rep 16, 10908 (2026). https://doi.org/10.1038/s41598-026-46453-6

Palavras-chave: edge AI, detecção de objetos, eficiência energética, GPU embarcada, quantização de modelos