Clear Sky Science · es

Revisión de la eficiencia energética de los grandes YOLOv8 y RT-DETR en dispositivos de borde para detección en tiempo real

Cámaras inteligentes en el borde

Desde drones de reparto hasta cámaras de control del tráfico, cada vez más máquinas necesitan reconocer personas y objetos por sí mismas, lejos de centros de datos que consumen mucha energía. Este artículo plantea una pregunta práctica detrás de esa tendencia: ¿pueden los modelos de detección de objetos grandes y de alta precisión de hoy ejecutarse de forma rápida y eficiente en pequeños ordenadores como un Raspberry Pi o en placas de IA compactas usadas en robots, sin agotar sus baterías?

Dos cerebros rivales para detectar objetos

Los autores se centran en dos detectores modernos de objetos que se han convertido en herramientas habituales en visión por ordenador. Uno, llamado YOLOv8, es una evolución depurada de las redes neuronales convolucionales clásicas, durante mucho tiempo preferidas por su combinación de velocidad y precisión. El otro, RT-DETR, mezcla estas convoluciones con bloques transformer, un tipo de red más reciente tomado de los modelos de lenguaje que sobresale captando patrones de largo alcance. El estudio usa las versiones grandes de ambos modelos, aproximadamente comparables en tamaño, y evalúa qué tan bien detectan objetos cotidianos en la popular colección de imágenes COCO.

Ordenadores diminutos, muchos caminos de software

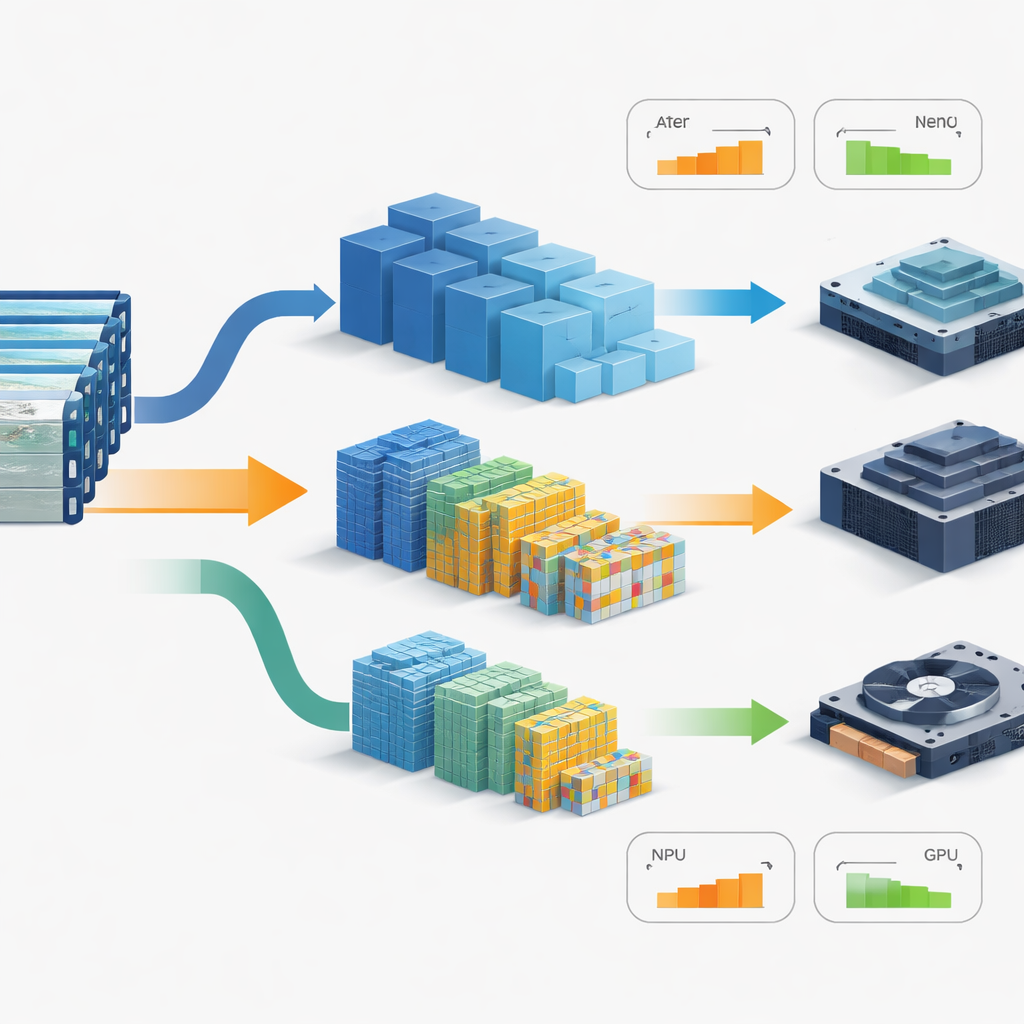

En lugar de ejecutar estos modelos en una GPU de sobremesa potente, el equipo recurre a dos plataformas de borde que se parecen al cerebro de drones y pequeños robots: un Raspberry Pi 5 y una Nvidia Jetson Orin NX. En el Raspberry Pi prueban la ejecución en CPU pura y chips neuronales adicionales como el Edge TPU de Google y la placa Raspberry Pi AI HAT+ basada en Hailo-8. En la placa Jetson se apoyan en su GPU integrada. Cada modelo se ejecuta con múltiples motores de software—desde marcos orientados a investigación como PyTorch hasta herramientas de despliegue muy optimizadas como TensorRT, NCNN, MNN, Paddle Lite y TensorFlow Lite—para ver cómo las elecciones de software reconfiguran la velocidad, el consumo de energía y la precisión.

Midiendo velocidad, consumo y precisión conjuntamente

Para aproximarse al uso real, los autores no se limitan a cronometrar la red central. Alimentan una transmisión de vídeo de alta definición completa, incluyendo decodificación de fotogramas, preparación para el modelo, ejecución de la detección y limpieza de resultados. Definen “tiempo real” como al menos 25 fotogramas procesados por segundo, la tasa del vídeo estándar. Mientras que la calidad de detección bruta de los modelos se mantiene alta en muchos entornos de ejecución, la tasa de fotogramas global y el consumo energético varían enormemente. En el Raspberry Pi, ejecutar modelos grandes solo en la CPU provoca retardos de varios segundos por fotograma y una eficiencia energética extremadamente pobre. Los chips neuronales dedicados cambian el panorama: la vía Hailo-8 da a YOLOv8 tanto alta eficiencia energética como buena precisión, mientras que el Edge TPU funciona rápido pero obliga a menor resolución de entrada y a un redondeo numérico agresivo, lo que reduce la calidad de detección por debajo de niveles prácticos.

El ajuste en GPU cambia al vencedor

La Jetson Orin NX, con su GPU más potente, permite observar de cerca la lucha entre diseño del modelo y software de despliegue. Allí, TensorRT—una cadena de herramientas que compila y comprime modelos para hardware Nvidia—reduce drásticamente los tiempos de inferencia y aumenta los fotogramas por segundo por vatio para ambos detectores. En la configuración de investigación por defecto, YOLOv8 parece más rápido. Tras una optimización completa con TensorRT y la aplicación de aritmética de baja precisión, RT-DETR alcanza e incluso supera a YOLOv8 en rendimiento bruto para los modelos grandes. Sin embargo, cuando los autores normalizan los resultados por la cantidad anunciada de operaciones matemáticas que realiza cada modelo, YOLOv8 sigue consumiendo menos tiempo y menos energía por unidad de trabajo nominal, mientras que RT-DETR resulta más sensible a los pasos de conversión entre cadenas de herramientas.

Por qué las cifras brutas no cuentan toda la historia

Para desentrañar estos hallazgos, el artículo separa tres ingredientes del rendimiento: la cantidad básica de cómputo que cada modelo parece requerir en el papel, la forma en que sus bloques constructores realmente mueven datos a través de la memoria, y la sobrecarga añadida por el software de ejecución. Los transformers como los de RT-DETR dependen de capas de atención que conectan muchas ubicaciones de la imagen entre sí, generando grandes estructuras de datos intermedias que pueden exigir mucho a la memoria y a la planificación incluso si sus recuentos nominales de operaciones parecen modestos. Los diseños basados en convoluciones como YOLOv8, por el contrario, se prestan con más facilidad a núcleos fusionados y a la reutilización local de datos en GPUs embebidas. Los autores también muestran que parte de la pérdida de precisión atribuida a la aritmética de baja precisión surge en realidad antes, durante la conversión desde el marco original de entrenamiento a un motor optimizado para hardware.

Qué significa esto para dispositivos del mundo real

Al final, ninguna de las configuraciones con modelos grandes en ninguno de los dispositivos alcanza la estricta meta de 25 fotogramas por segundo para la canalización de vídeo completa. La conclusión del estudio para los ingenieros es que elegir un detector “listo para el borde” no es tan sencillo como consultar el número de parámetros o las operaciones teóricas. El éxito real depende de cómo la estructura del modelo interactúa con el chip específico, de lo bien que el software de ejecución compile y planifique sus operaciones, y de cuánta precisión sobrevive a la exportación y a la cuantización. Por ahora, lograr un rendimiento verdaderamente en tiempo real en plataformas pequeñas y con limitación de energía seguirá requiriendo ajuste consciente del hardware y, en muchos casos, versiones más pequeñas de estos modelos en lugar de las más grandes y precisas.

Cita: Suchý, I., Turčaník, M. Review of large YOLOv8 and RT-DETR energy efficiency on edge devices for real-time detection. Sci Rep 16, 10908 (2026). https://doi.org/10.1038/s41598-026-46453-6

Palabras clave: IA en el borde, detección de objetos, eficiencia energética, GPU embebida, cuantización de modelos