Clear Sky Science · de

Untersuchung der Energieeffizienz großer YOLOv8- und RT-DETR-Modelle auf Edge‑Geräten für Echtzeit‑Erkennung

Intelligente Kameras am Edge

Von Lieferdrohnen bis zu Verkehrsüberwachungskameras müssen immer mehr Maschinen eigenständig Menschen und Objekte erkennen, weit entfernt von stromhungrigen Rechenzentren. Dieses Papier stellt eine praktische Frage hinter diesem Trend: Können heutige große, hochgenaue Objekterkennungsmodelle auf winzigen Rechnern wie einem Raspberry Pi oder kompakten KI‑Boards, wie sie in Robotern verwendet werden, schnell und effizient laufen, ohne deren Batterien zu leeren?

Zwei konkurrierende Ansätze zur Objekterkennung

Die Autoren konzentrieren sich auf zwei moderne Objektdetektoren, die in der Computer‑Vision zum Standard geworden sind. Das eine, YOLOv8 genannt, ist eine gestraffte Weiterentwicklung klassischer Faltungsnetze, die lange wegen ihres Kompromisses aus Geschwindigkeit und Genauigkeit bevorzugt wurden. Das andere, RT‑DETR, kombiniert diese Faltungen mit Transformer‑Blöcken, einer neueren Netzwerkklasse aus der Sprachmodellforschung, die gut darin ist, großräumige Zusammenhänge zu erfassen. Die Studie verwendet die großen Versionen beider Modelle, die größenmäßig etwa vergleichbar sind, und prüft, wie gut sie alltägliche Objekte in der populären COCO‑Bildsammlung erkennen können.

Winzige Rechner, viele Softwarepfade

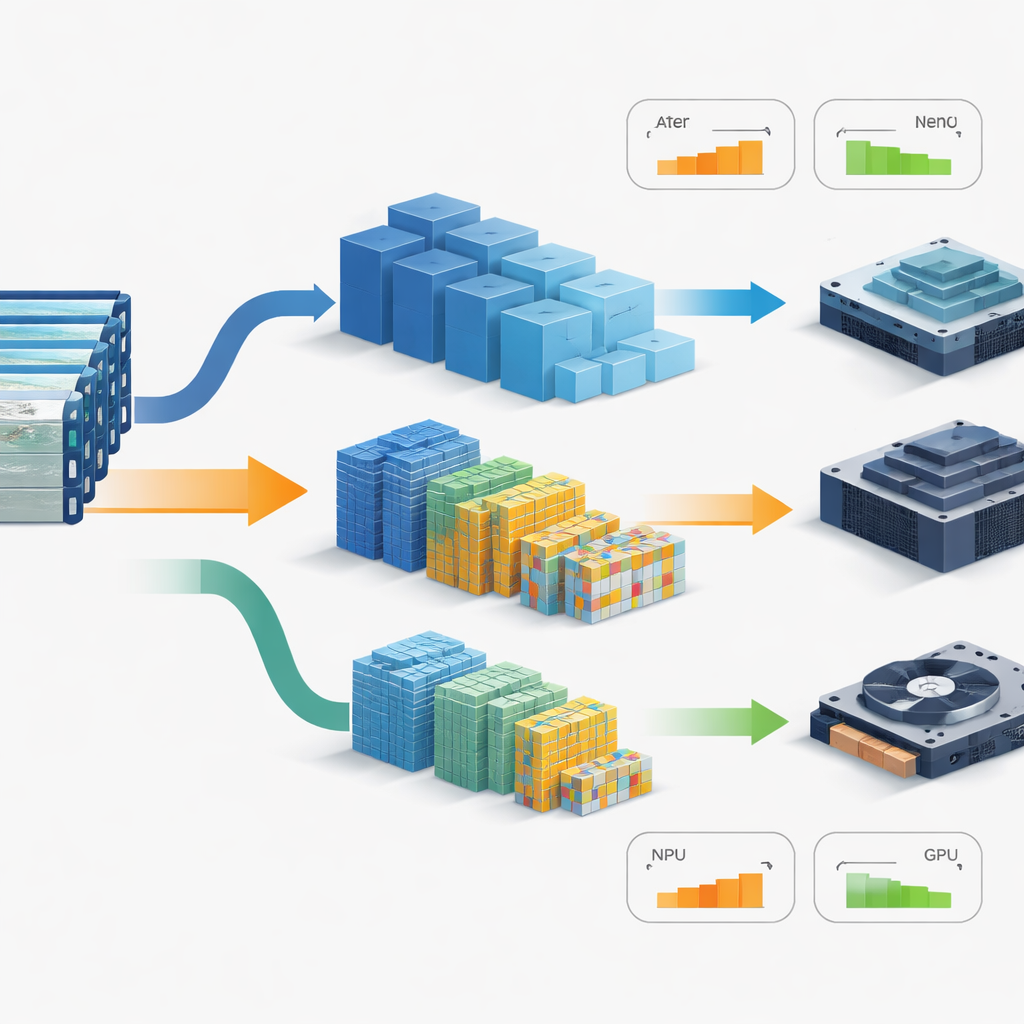

Statt die Modelle auf einer großen Desktop‑GPU laufen zu lassen, wendet sich das Team zwei Edge‑Plattformen zu, die den Steuerungen von Drohnen und kleinen Robotern ähneln: einem Raspberry Pi 5 und einem Nvidia Jetson Orin NX. Auf dem Raspberry Pi testen sie reine CPU‑Ausführung sowie zusätzliche neuronale Beschleuniger wie Googles Edge TPU und das auf Hailo‑8 basierende Raspberry Pi AI HAT+. Auf dem Jetson‑Board setzen sie auf die eingebaute GPU. Jedes Modell wird über mehrere Software‑Engines betrieben – von forschungsorientierten Frameworks wie PyTorch bis zu stark optimierten Deployment‑Tools wie TensorRT, NCNN, MNN, Paddle Lite und TensorFlow Lite –, um zu sehen, wie Software‑Entscheidungen Geschwindigkeit, Leistungsaufnahme und Genauigkeit verändern.

Geschwindigkeit, Energie und Präzision zusammen messen

Um reale Nutzungsszenarien nachzubilden, messen die Autoren nicht nur die reine Netzwerklaufzeit. Sie speisen einen vollständigen HD‑Videostream ein, inklusive Dekodierung der Frames, Vorverarbeitung für das Modell, Ausführung der Erkennung und Aufbereitung der Ergebnisse. „Echtzeit“ definieren sie als mindestens 25 verarbeitete Bilder pro Sekunde, den Standard‑Video‑Frame‑Rate. Während die rohe Erkennungsqualität der Modelle über viele Laufzeiten hinweg hoch bleibt, schwanken die gemessenen Bildraten und der Energieverbrauch stark. Auf dem Raspberry Pi führt das Ausführen großer Modelle allein auf der CPU zu mehrsekündigen Verzögerungen pro Frame und äußerst schlechter Energieeffizienz. Dedizierte neuronale Beschleuniger ändern das Bild: Der Hailo‑8‑Pfad liefert YOLOv8 sowohl hohe Energieeffizienz als auch starke Genauigkeit, während die Edge TPU zwar schnell läuft, aber niedrigere Eingangsauflösung und aggressive Rundung erzwingt, was die Erkennungsqualität deutlich unter praktische Niveaus drückt.

GPU‑Optimierung dreht den Favoriten um

Das Jetson Orin NX mit seiner leistungsfähigeren GPU erlaubt einen genaueren Blick auf das Wechselspiel zwischen Modellarchitektur und Deployment‑Software. Hier reduziert TensorRT – eine Toolchain, die Modelle für Nvidia‑Hardware kompiliert und komprimiert – die Inferenzzeiten drastisch und erhöht die Frames pro Sekunde pro Watt für beide Detektoren. Unter der Standard‑Forschungskonfiguration wirkt YOLOv8 zunächst schneller. Nach vollständiger TensorRT‑Optimierung und Einsatz niederpräziser Arithmetik holt RT‑DETR auf und übertrifft YOLOv8 bei Durchsatz für große Modelle. Wird jedoch das Ergebnis nach der angegebenen Menge an Rechenarbeit normalisiert, benötigt YOLOv8 weiterhin weniger Zeit und Energie pro Einheit nominaler Arbeit, während RT‑DETR empfindlicher auf Konvertierungsschritte zwischen Toolchains reagiert.

Warum reine Zahlen nicht die ganze Geschichte erzählen

Zur Erklärung dieser Befunde trennt das Papier drei Leistungsfaktoren: die auf dem Papier erwartete Grundmenge an Berechnungen, die Art und Weise, wie die Bausteine tatsächlich Daten durch den Speicher bewegen, und den Overhead, den die Laufzeitsoftware hinzufügt. Transformer‑Schichten wie in RT‑DETR setzen auf Attention, die viele Bildpositionen miteinander verbindet und große Zwischenstrukturen erzeugt, die Speicher und Scheduling belasten können, selbst wenn die nominalen Operationszahlen moderat erscheinen. Faltungsintensive Designs wie YOLOv8 hingegen eignen sich leichter für gefügte Kernel und lokale Datenwiederverwendung auf eingebetteten GPUs. Die Autoren zeigen außerdem, dass ein Teil des Genauigkeitsverlusts, der niederpräziser Arithmetik zugeschrieben wird, bereits früher entsteht – bei der Konvertierung vom ursprünglichen Trainingsframework in eine hardwareoptimierte Laufzeitumgebung.

Was das für reale Geräte bedeutet

Am Ende erreicht keine der großen Modellkonfigurationen auf einem der Geräte das strikte Ziel von 25 Bildern pro Sekunde für die vollständige Videopipeline. Die Schlussfolgerung für Ingenieure lautet, dass die Wahl eines „edge‑tauglichen“ Detektors nicht allein über Parameterzahlen oder theoretische Operationsmengen getroffen werden kann. Echter Erfolg hängt davon ab, wie die Modellstruktur mit dem spezifischen Chip interagiert, wie gut die Laufzeitsoftware seine Operationen kompiliert und plant und wie viel Genauigkeit beim Export und bei der Quantisierung erhalten bleibt. Für den Moment erfordert das Erreichen wahrer Echtzeitleistung auf kleinen, energiebegrenzten Plattformen weiterhin hardwarebewusste Optimierung und in vielen Fällen den Einsatz kleinerer Modellvarianten statt der größten und genauesten Modelle.

Zitation: Suchý, I., Turčaník, M. Review of large YOLOv8 and RT-DETR energy efficiency on edge devices for real-time detection. Sci Rep 16, 10908 (2026). https://doi.org/10.1038/s41598-026-46453-6

Schlüsselwörter: Edge‑KI, Objekterkennung, Energieeffizienz, eingebettete GPU, Modellquantisierung