Clear Sky Science · sv

Granskning av energieffektivitet för stora YOLOv8 och RT‑DETR på edge‑enheter för realtidsdetektion

Smarta kameror vid kanten

Från leveransdroner till trafikövervakningskameror behöver allt fler maskiner själva känna igen människor och föremål, långt från energikrävande datacenter. Denna artikel ställer en praktisk fråga bakom den trenden: kan dagens stora, högprecisionella objektdetektionsmodeller köras snabbt och effektivt på pyttesmå datorer som en Raspberry Pi eller kompakta AI‑kort som används i robotar, utan att tömma deras batterier?

Två rivaliserande hjärnor för att se objekt

Författarna koncentrerar sig på två moderna objektdetektorer som blivit arbetsstammar inom datorseende. Den ena, kallad YOLOv8, är en strömlinjeformad utveckling av klassiska konvolutionsnätverk, länge föredragna för sin kombination av hastighet och noggrannhet. Den andra, RT‑DETR, blandar dessa konvolutioner med transformerblock, en nyare nätverkstyp lånad från språkmodeller som är skicklig på att fånga långsiktiga mönster. Studien använder de stora varianterna av båda modellerna, ungefär jämförbara i storlek, och testar hur väl de kan upptäcka vardagliga objekt i den populära COCO‑bildsamlingen.

Pyttedatorer, många mjukvaruvägar

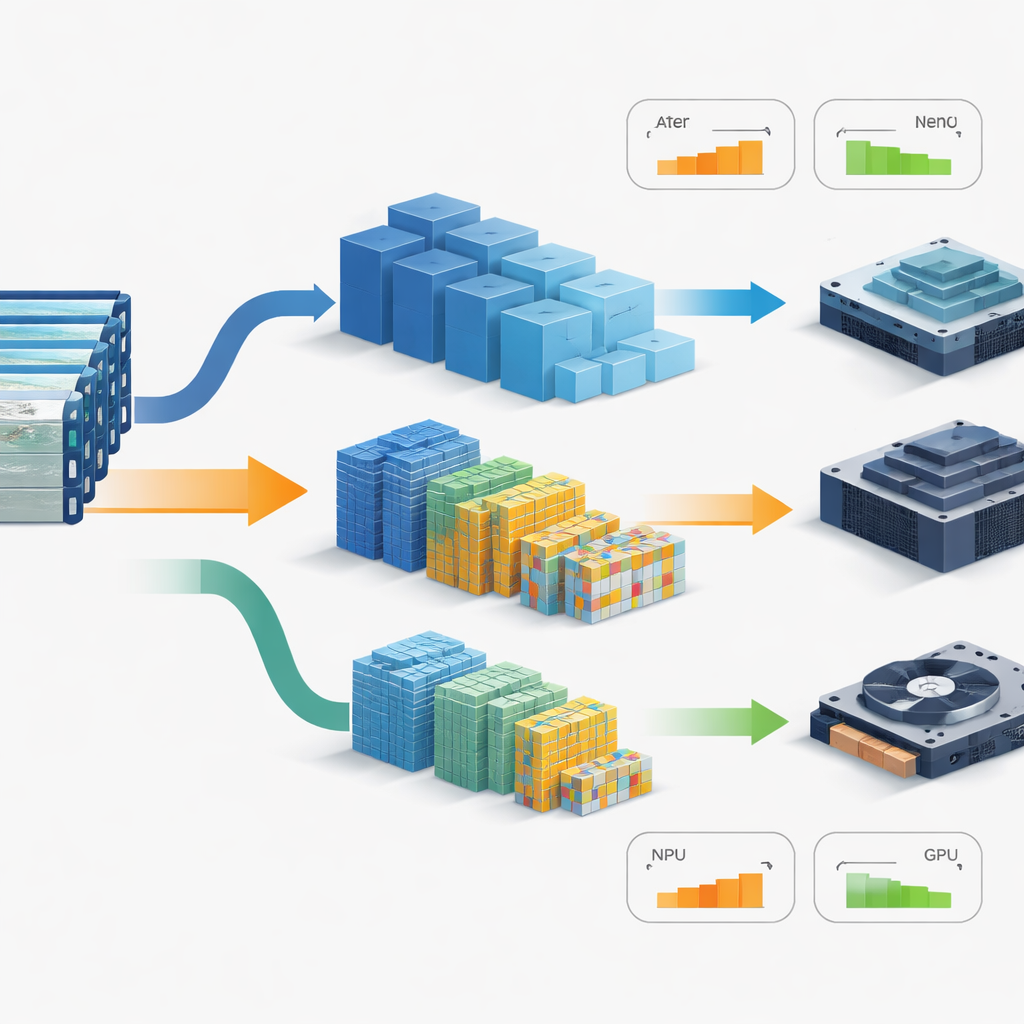

I stället för att köra dessa modeller på ett stort skrivbords‑GPU vänder teamet sig till två edge‑plattformar som liknar hjärnor i drönare och små robotar: en Raspberry Pi 5 och en Nvidia Jetson Orin NX. På Raspberry Pi testar de ren CPU‑körning och tilläggschip för neurala nätverk såsom Googles Edge TPU och Hailo‑8‑baserade Raspberry Pi AI HAT+. På Jetson‑kortet förlitar de sig på dess inbyggda GPU. Varje modell körs genom flera mjukvaruengines — från forskningsorienterade ramverk som PyTorch till starkt optimerade distributionsverktyg som TensorRT, NCNN, MNN, Paddle Lite och TensorFlow Lite — för att se hur mjukvaruval förändrar hastighet, energiförbrukning och noggrannhet.

Mäter hastighet, effekt och precision tillsammans

För att efterlikna verklig användning mäter författarna inte bara kärncykeltiden för nätverket. De matar in en hel högupplöst videoström, inklusive avkodning av ramarna, förberedelse för modellen, själva detektionen och upprensning av resultaten. De definierar ”realtid” som minst 25 bearbetade bilder per sekund, standardvideons takt. Medan modellernas råa detektionskvalitet förblir hög över många körningar, varierar den totala bildfrekvensen och energianvändningen kraftigt. På Raspberry Pi leder körning av stora modeller enbart på CPU till flera sekunders fördröjning per bild och extremt dålig energieffektivitet. Dedikerade neurala chip förändrar bilden: Hailo‑8‑vägen ger YOLOv8 både hög energieffektivitet och stark noggrannhet, medan Edge TPU kör snabbt men tvingar lägre inmatningsupplösning och aggressiv rundning, vilket sänker detektionskvaliteten långt under praktiska nivåer.

GPU‑tuning vänder vinnaren

Jetson Orin NX, med sin kraftfullare GPU, tillåter en närmare granskning av dragkampen mellan modellarkitektur och distributionsmjukvara. Här krymper TensorRT — en verktygskedja som kompilerar och komprimerar modeller för Nvidia‑hårdvara — inferenstider dramatiskt och ökar bilder per sekund per watt för båda detektorerna. Under standard forskningsinställning verkar YOLOv8 snabbare. Efter full TensorRT‑optimering och lågprecisionsaritmetik kommer RT‑DETR ikapp och överträffar till och med YOLOv8 i rå genomströmning för stora modeller. Men när författarna normaliserar resultaten efter den annonserade mängden beräkningar varje modell utför, använder YOLOv8 fortfarande mindre tid och energi per enhet nominellt arbete, medan RT‑DETR visar sig vara mer känslig för konverteringssteg mellan verktygskedjor.

Varför råa siffror inte berättar hela historien

För att reda ut dessa resultat separerar artikeln tre beståndsdelar av prestanda: den grundläggande mängden beräkning varje modell verkar kräva på papperet, hur dess byggstenar faktiskt flyttar data genom minnet, och den overhead som läggs på av runtime‑mjukvaran. Transformermoduler som i RT‑DETR förlitar sig på attention‑lager som kopplar många bildpositioner till varandra, vilket skapar stora mellanliggande datastrukturer som kan belasta minne och schemaläggning även om de nominella operationstalen ser måttliga ut. Konvolutionstunga designer som YOLOv8 lämpar sig däremot lättare för sammanslagna kernels och lokal återanvändning av data på inbäddade GPU:er. Författarna visar också att en del av noggrannhetsförlusten som ofta skylls på lågprecisionsaritmetik faktiskt uppstår tidigare, vid konvertering från det ursprungliga träningsramverket till en hårdvaruoptimerad motor.

Vad detta betyder för verkliga enheter

I slutändan når ingen av de stora modelluppsättningarna på någon enhet det strikta målet på 25 bilder per sekund för hela videopipelinen. Studiens slutsats för ingenjörer är att valet av en ”edge‑redo” detektor inte är lika enkelt som att läsa av parametertal eller teoretiska operationstal. Verklig framgång beror på hur modellens struktur samspelar med den specifika chipet, hur väl runtime‑mjukvaran kompilerar och schemalägger dess operationer, och hur mycket noggrannhet som överlever export och kvantisering. För närvarande kommer det att krävas hårdvarumedveten fintrimning och i många fall mindre varianter av dessa modeller — snarare än de största och mest precisa — för att uppnå verklig realtidsprestanda på små, effektbegränsade plattformar.

Citering: Suchý, I., Turčaník, M. Review of large YOLOv8 and RT-DETR energy efficiency on edge devices for real-time detection. Sci Rep 16, 10908 (2026). https://doi.org/10.1038/s41598-026-46453-6

Nyckelord: edge AI, objektdetektion, energieffektivitet, inbyggd GPU, modellkvantisering