Clear Sky Science · fr

Revue de l'efficacité énergétique des grands YOLOv8 et RT-DETR sur des appareils edge pour la détection en temps réel

Caméras intelligentes à la périphérie

Des drones de livraison aux caméras de surveillance du trafic, de plus en plus de machines doivent reconnaître seules personnes et objets, loin des centres de données gourmands en énergie. Cet article pose une question pratique derrière cette tendance : les grands modèles de détection d'objets actuels, à haute précision, peuvent-ils s'exécuter rapidement et efficacement sur de petits ordinateurs comme un Raspberry Pi ou des cartes AI compactes utilisées en robotique, sans vider leurs batteries ?

Deux cerveaux rivaux pour repérer les objets

Les auteurs se concentrent sur deux détecteurs d'objets modernes devenus des références en vision par ordinateur. Le premier, appelé YOLOv8, est une évolution épurée des réseaux de neurones convolutionnels classiques, longtemps appréciés pour leur compromis vitesse/ précision. L'autre, RT-DETR, combine ces convolutions avec des blocs transformeurs, un type de réseau plus récent emprunté aux modèles de langage qui excelle à capter les motifs à longue portée. L'étude utilise les versions « large » des deux modèles, comparables en taille, et teste leur capacité à repérer des objets quotidiens dans la célèbre collection d'images COCO.

Petits ordinateurs, nombreux chemins logiciels

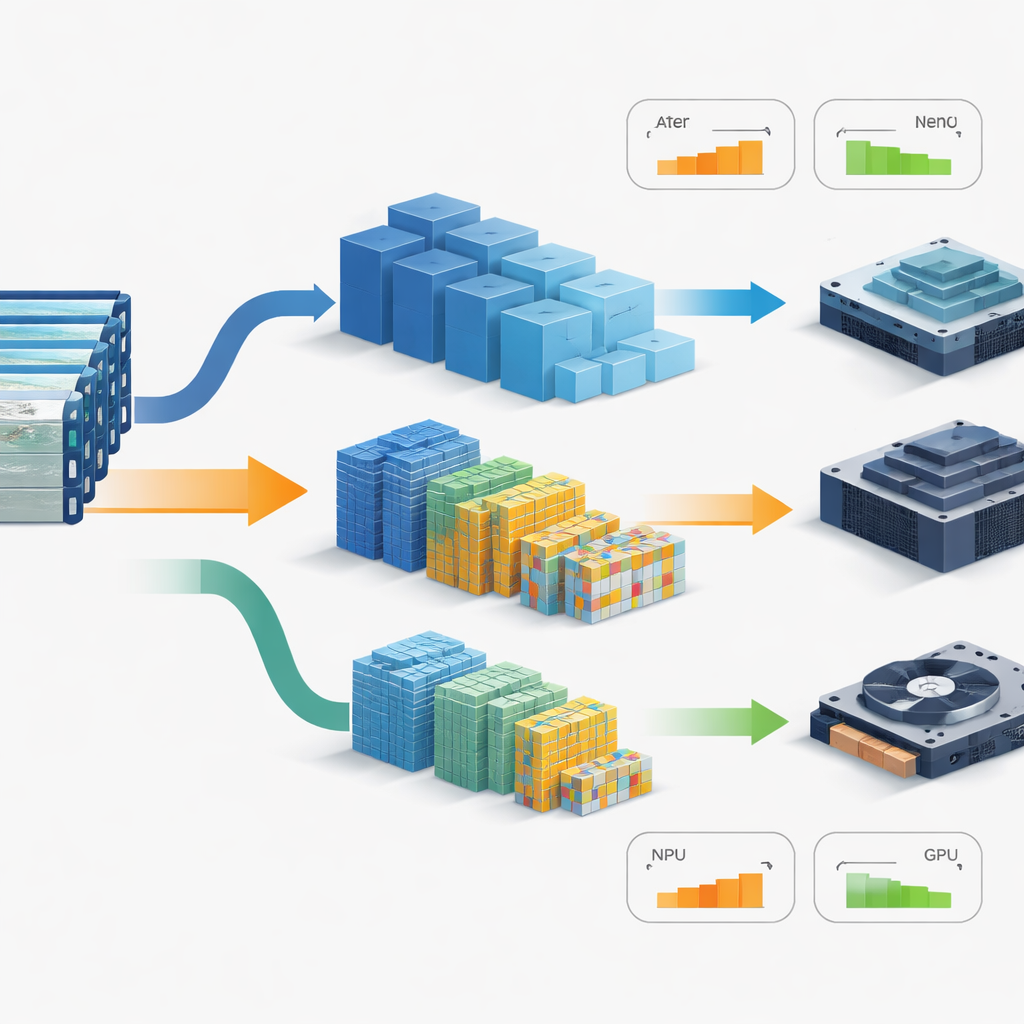

Plutôt que d'exécuter ces modèles sur un gros GPU de bureau, l'équipe se tourne vers deux plateformes edge qui ressemblent aux cerveaux de drones et de petits robots : un Raspberry Pi 5 et un Nvidia Jetson Orin NX. Sur le Raspberry Pi, ils testent l'exécution CPU brute et des puces neuronales additionnelles comme l'Edge TPU de Google et le Raspberry Pi AI HAT+ basé sur Hailo-8. Sur la carte Jetson, ils s'appuient sur son GPU intégré. Chaque modèle est testé via plusieurs moteurs logiciels — des frameworks de recherche comme PyTorch jusqu'aux outils de déploiement très optimisés comme TensorRT, NCNN, MNN, Paddle Lite et TensorFlow Lite — pour voir comment le choix du logiciel reconfigure la vitesse, la consommation et la précision.

Mesurer vitesse, consommation et précision ensemble

Pour reproduire un usage réel, les auteurs ne chronomètrent pas seulement le réseau central. Ils injectent un flux vidéo haute définition complet, incluant le décodage des images, leur préparation pour le modèle, l'exécution de la détection et la mise en forme des résultats. Ils définissent le « temps réel » comme au moins 25 images traitées par seconde, le débit d'une vidéo standard. Si la qualité brute de détection des modèles reste élevée selon de nombreux runtimes, le débit global et la consommation énergétique varient fortement. Sur le Raspberry Pi, exécuter les grands modèles uniquement sur le CPU entraîne des délais de plusieurs secondes par image et une très mauvaise efficacité énergétique. Les puces neuronales dédiées changent la donne : la voie Hailo-8 offre à YOLOv8 à la fois une forte efficacité énergétique et une bonne précision, tandis que l'Edge TPU est rapide mais impose une résolution d'entrée plus faible et un arrondi numérique agressif, ce qui dégrade la qualité de détection bien en dessous de niveaux pratiques.

L'optimisation GPU renverse le vainqueur

Le Jetson Orin NX, avec son GPU plus puissant, permet d'examiner de plus près le bras de fer entre la conception du modèle et le logiciel de déploiement. Ici, TensorRT — une chaîne d'outils qui compile et compresse les modèles pour le matériel Nvidia — réduit considérablement les temps d'inférence et augmente les images par seconde par watt pour les deux détecteurs. Dans la configuration de recherche par défaut, YOLOv8 semble plus rapide. Après optimisation complète avec TensorRT et l'utilisation d'arithmétique basse précision, RT-DETR rattrape son retard et dépasse même YOLOv8 en débit brut pour les grands modèles. Pourtant, lorsque les auteurs normalisent les résultats par la quantité annoncée de calcul que réalise chaque modèle, YOLOv8 utilise encore moins de temps et d'énergie par unité de travail nominale, tandis que RT-DETR se montre plus sensible aux étapes de conversion entre chaînes d'outils.

Pourquoi les chiffres bruts ne racontent pas toute l'histoire

Pour démêler ces constats, l'article sépare trois ingrédients de la performance : la quantité de calcul théorique requise par chaque modèle, la façon dont ses blocs élémentaires déplacent réellement les données en mémoire, et le surcoût apporté par le logiciel d'exécution. Les transformeurs comme ceux de RT-DETR reposent sur des couches d'attention qui mettent en relation de nombreux emplacements d'image entre eux, produisant de grandes structures intermédiaires qui peuvent solliciter la mémoire et l'ordonnancement même si leur nombre d'opérations nominal semble modeste. Les architectures dominées par les convolutions, comme YOLOv8, se prêtent en revanche plus facilement à des noyaux fusionnés et à la réutilisation locale des données sur GPU embarqués. Les auteurs montrent aussi qu'une partie de la perte de précision imputée à l'arithmétique basse précision provient en réalité plus tôt, lors de la conversion du framework de formation original vers un moteur optimisé pour le matériel.

Ce que cela signifie pour les appareils réels

Au final, aucune des configurations de grands modèles sur les deux appareils n'atteint l'objectif strict de 25 images par seconde pour l'ensemble du pipeline vidéo. La conclusion pratique pour les ingénieurs est que choisir un détecteur « prêt pour l'edge » n'est pas aussi simple que lire le nombre de paramètres ou les opérations théoriques. Le succès réel dépend de la façon dont la structure du modèle interagit avec la puce spécifique, de la qualité avec laquelle le logiciel runtime compile et ordonne ses opérations, et de la quantité de précision qui survit à l'exportation et à la quantification. Pour l'instant, obtenir une vraie performance en temps réel sur des plateformes petites et à puissance limitée exigera encore un réglage conscient du matériel et, dans de nombreux cas, des versions plus petites de ces modèles plutôt que les plus grands et les plus précis.

Citation: Suchý, I., Turčaník, M. Review of large YOLOv8 and RT-DETR energy efficiency on edge devices for real-time detection. Sci Rep 16, 10908 (2026). https://doi.org/10.1038/s41598-026-46453-6

Mots-clés: IA en périphérie, détection d'objets, efficacité énergétique, GPU embarqué, quantification de modèle