Clear Sky Science · zh

MuGu:用于医学图像分割的预训练 SAM 与轻量级模型之间的互导学习

为医学影像带来更清晰的计算机视觉

医生依赖计算机在肺、结肠、脑和肝脏的影像中标注可疑区域——但现有工具面临权衡:小型模型在医院环境中运行快速却可能漏掉细微病变,而大型最先进模型虽然更准确,却过于庞大和昂贵,无法普遍部署。本文提出了一种新方法,使强大的“基础”模型能够在不束缚小模型发展的情况下指导其训练,旨在将顶级的图像理解能力带入日常临床场景。

教导小模型的挑战

医学图像分割任务是描绘器官、血管或病灶在影像中的精确轮廓。传统深度学习系统通常针对特定任务或器官设计,当数据或成像条件变化时表现会下降。更新的基础模型(例如 SAM-Med)能适应多种任务,但需要大量计算资源和内存。现有将两者结合的尝试通常在整个训练过程中、对每张图像都让大模型监督小模型。作者表明,这种持续且均一化的监督在小模型赶上来后反而会妨碍其发展,阻止小模型充分形成自身优势。

模型之间的双向对话

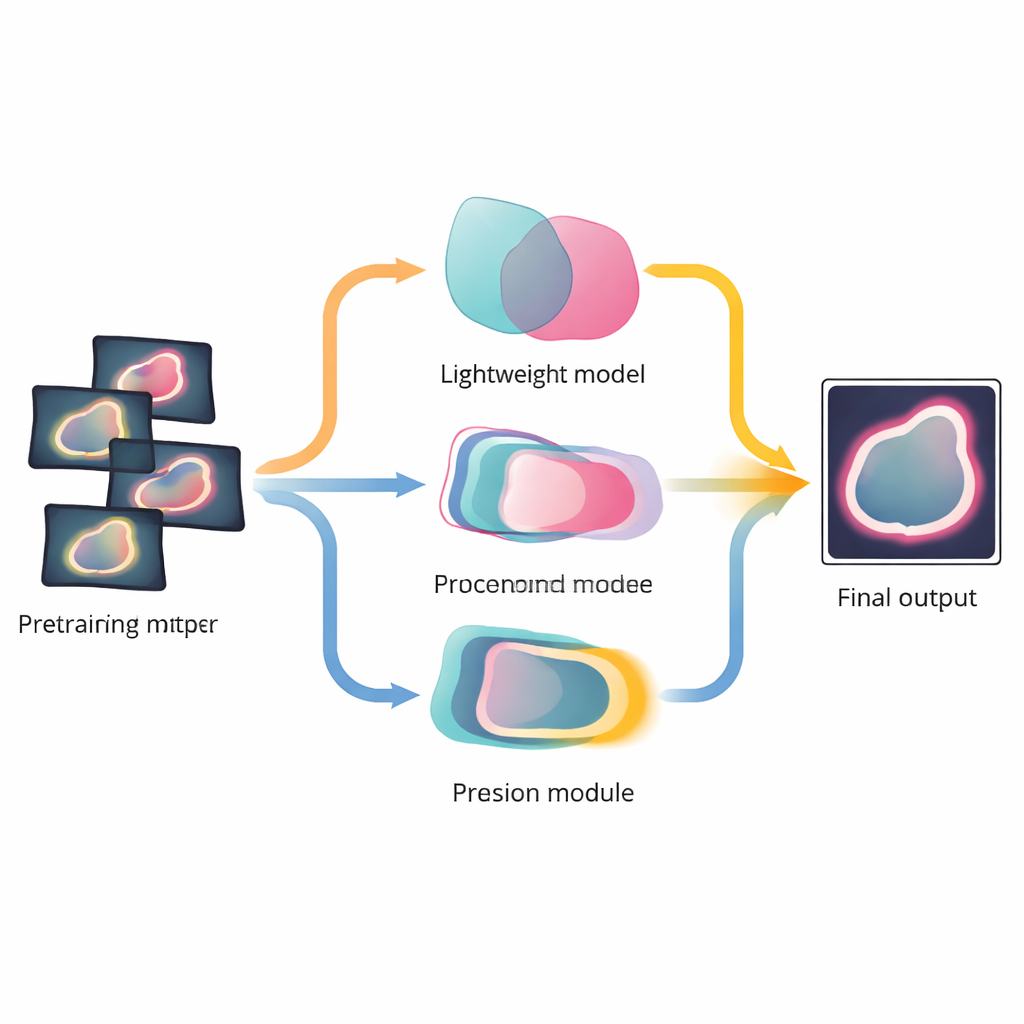

作者提出了 MuGu(来自“mutual guidance”,互导)的框架,让大模型与小模型以更有选择性和动态的方式相互影响。核心是一种精简的分割网络——即轻量模型——它配备了两个分支头,分别预测前景(例如肿瘤)和背景。这一设计帮助小网络更好地评估自身的置信度。MuGu 引入了轻量网络与 SAM-Med 之间的反馈回路,而非单向知识流动。

让置信度决定何时需要帮助

第一个关键思想称为置信提示引导(Confidence Prompt Guidance),只在 SAM-Med 最有价值的地方调用它。训练期间,MuGu 测量小模型的前景与背景预测与 SAM-Med 在每张图像上的输出的一致性。当两者严重不一致——即小模型不确定或错误时——将其预测转化为一个“提示”,请求 SAM-Med 对该具体案例提供更详细的指导。当两者已达成一致时,SAM-Med 则退后。随着时间推移,需要干预的图像数量下降,使得强大模型能集中在最难的样本上,而不是掩盖小模型的能力。

通过协同聚焦锐化边界

第二项创新,集成结构边界引导(Ensemble Structure Boundary Guidance),关注许多医学任务中最关键的信息:健康与异常组织之间的精确边界。MuGu 将三种视角——大模型的分割、小模型的前景预测以及背景预测——融合为共享的边界信号。一个专门的注意力机制学习在每个阶段应多大程度地信任每个分支,随后将融合的边界信息用于细化轻量模型的内部特征和训练损失。重要的是,训练完成后,系统可以仅使用高效的轻量模型生成最终分割,无需再调用 SAM-Med。

在多器官和多种扫描类型上的验证收益

研究者在四个公开数据集上测试了 MuGu,这些数据集涵盖肺部病灶、结肠息肉、脑动脉和肝脏血管,包含二维图像和完整三维体积。在所有数据集上,MuGu 都优于常用的分割网络,并超过了将大模型与小模型简单配对的直接方法。它提高了整体重叠评分并减少了边界错误,同时将计算需求保持在接近传统轻量模型的水平。对训练过程的分析表明,随着轻量网络性能提升,MuGu 会自动减少对基础模型的依赖,转而更多信任小模型自身的预测。

将强大 AI 更贴近临床

简而言之,这项工作展示了大型且昂贵的模型如何成为小模型的聪明导师而非永久的拐杖。通过仅在置信度低时调用大模型,并联合细化解剖结构的轮廓,MuGu 训练出了一个高效网络,在关键任务上能与教师模型匹敌甚至超越。该方法有望帮助医院和诊所以有限硬件部署更强大的 AI 助手,将更可靠的自动化影像解读带入日常实践。

引用: Wang, C., Wang, Z., Chen, W. et al. MuGu:mutual guidance learning between pretrained SAM and lightweight model for medical image segmentation. Sci Rep 16, 12099 (2026). https://doi.org/10.1038/s41598-026-41924-2

关键词: 医学图像分割, 基础模型, 深度学习, 计算机辅助诊断, 模型压缩