Clear Sky Science · de

MuGu: gegenseitiges Guidance-Lernen zwischen vortrainiertem SAM und leichtgewichtigem Modell für die medizinische Bildsegmentierung

Schärfere Computer-Vision für medizinische Scans

Ärztinnen und Ärzte verlassen sich auf Computer, die verdächtige Bereiche in Aufnahmen von Lunge, Darm, Gehirn und Leber hervorheben — doch bei den heutigen Werkzeugen gibt es einen Zielkonflikt: Kleine Modelle laufen schnell in Kliniken, können aber subtile Details übersehen, während riesige, hochmoderne Modelle zwar genauer sind, jedoch zu schwer und zu kostspielig für den flächendeckenden Einsatz. Dieses Papier stellt eine neue Methode vor, mit der ein leistungsfähiges „Foundation“-Modell ein kleineres Modell unterrichten kann, ohne es auszubremsen, mit dem Ziel, erstklassiges Bildverständnis in den klinischen Alltag zu bringen.

Die Herausforderung, kleinere Modelle zu lehren

Die medizinische Bildsegmentierung besteht darin, die exakte Kontur von Organen, Gefäßen oder Läsionen in Aufnahmen nachzuzeichnen. Traditionelle Deep-Learning-Systeme sind meist auf eine bestimmte Aufgabe oder ein Organ zugeschnitten und tun sich schwer, wenn sich Daten oder Aufnahmebedingungen ändern. Neuere Foundation-Modelle wie SAM-Med können sich an viele Aufgaben anpassen, benötigen jedoch beträchtliche Rechenleistung und Speicher. Bestehende Versuche, die beiden Ansätze zu kombinieren, lassen das große Modell typischerweise während des gesamten Trainings und bei jedem Bild das kleine Modell beaufsichtigen. Die Autorinnen und Autoren zeigen, dass diese konstante, uniforme Beaufsichtigung das kleinere Modell tatsächlich behindern kann, sobald es in seiner Leistung aufzuholen beginnt, und ihm verhindert, eigene Stärken voll zu entwickeln.

Ein zweiseitiges Gespräch zwischen Modellen

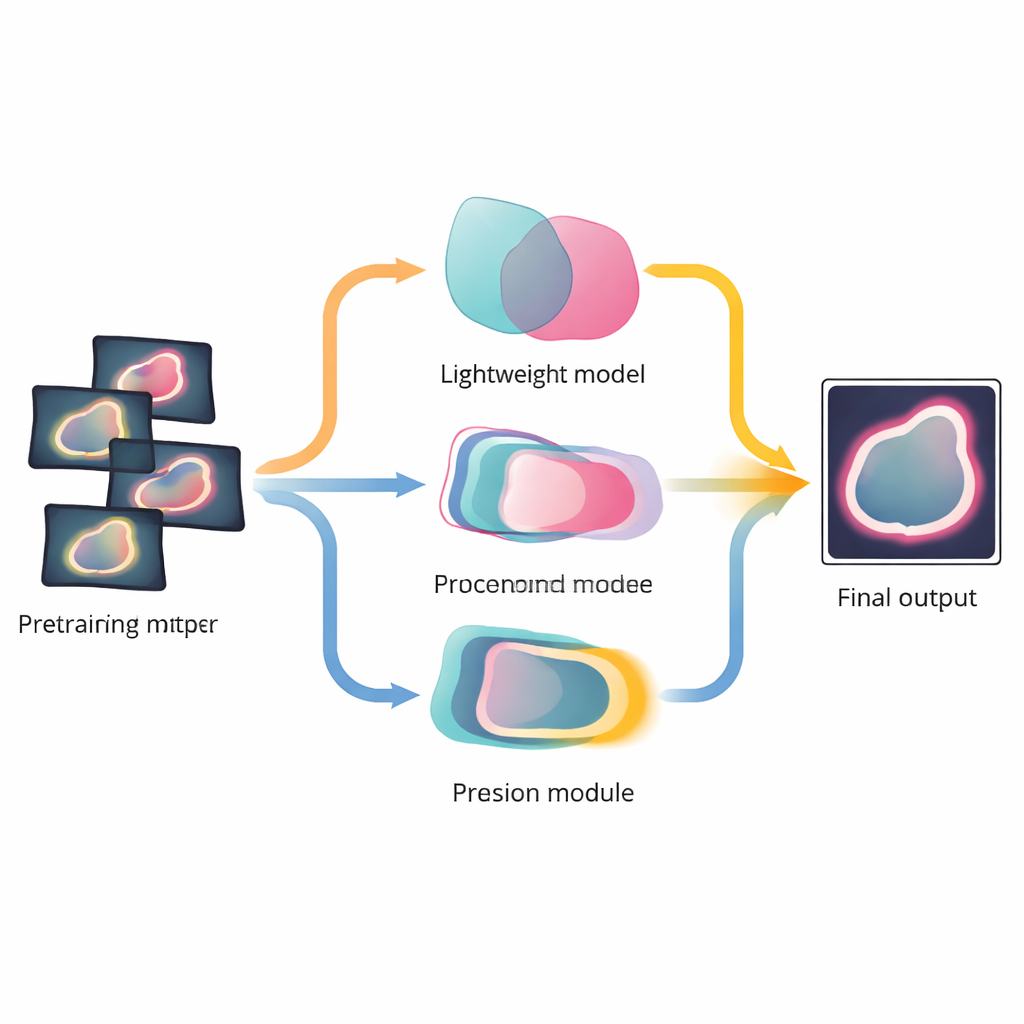

Die Autorinnen und Autoren schlagen MuGu vor, kurz für „mutual guidance“ (gegenseitige Anleitung), ein Framework, in dem große und kleine Modelle sich selektiver und dynamischer gegenseitig beeinflussen. Im Kern steht ein schlankes Segmentationsnetz — das leichtgewichtige Modell — das mit zwei Köpfen ausgestattet ist, die vorhersagen, was Vordergrund (zum Beispiel ein Tumor) und was Hintergrund ist. Dieses Design hilft dem kleineren Netzwerk, seine eigene Sicherheit besser einzuschätzen. MuGu führt dann eine Feedback-Schleife zwischen dem leichtgewichtigen Netzwerk und SAM-Med ein, statt eines einseitigen Wissensflusses.

Die Entscheidung der Zuversicht, wann Hilfe nötig ist

Die erste zentrale Idee, Confidence Prompt Guidance, besteht darin, SAM-Med nur dort einzubeziehen, wo es am nützlichsten ist. Während des Trainings misst MuGu, wie gut die Vorder- und Hintergrundvorhersagen des kleinen Modells mit der Ausgabe von SAM-Med für jedes Bild übereinstimmen. Bei starker Unstimmigkeit — das heißt, wenn das kleine Modell unsicher oder falsch ist — wird seine Vorhersage in ein „Prompt“ umgewandelt, das SAM-Med um detailliertere Anleitung für diesen konkreten Fall bittet. Wenn die beiden Modelle bereits übereinstimmen, tritt SAM-Med in den Hintergrund. Mit der Zeit sinkt die Anzahl der Bilder, die eine solche Intervention benötigen, sodass sich das leistungsfähige Modell auf die schwierigsten Beispiele konzentriert, anstatt das kleinere zu überlagern.

Konturen schärfen durch kooperative Fokussierung

Die zweite Innovation, Ensemble Structure Boundary Guidance, konzentriert sich auf die kritischsten Informationen vieler medizinischer Aufgaben: die präzise Grenze zwischen gesundem und abnormem Gewebe. MuGu verschmilzt drei Perspektiven — die Segmentierung des großen Modells, die Vordergrundvorhersage des kleinen Modells und seine Hintergrundvorhersage — zu einem gemeinsamen Grenzsignal. Ein spezialisierter Aufmerksamkeitsmechanismus lernt, wie viel jeder Zweig in jeder Phase vertraut werden kann, und diese fusionierten Grenzinformationen werden dann genutzt, um die internen Merkmale und den Trainingsverlust des leichtgewichtigen Modells zu verfeinern. Wichtig ist, dass das System nach Abschluss des Trainings finale Segmentierungen nur mit dem effizienten kleinen Modell erzeugen kann, ohne SAM-Med zu benötigen.

Nachgewiesene Verbesserungen über Organe und Aufnahmetypen hinweg

Die Forschenden testeten MuGu auf vier öffentlichen Datensätzen, die zusammen Lungenläsionen, Darmpolypen, Hirnarterien und Lebergefäße abdecken, wobei sowohl 2D-Bilder als auch vollständige 3D-Volumen verwendet wurden. In allen Fällen übertraf MuGu weit verbreitete Segmentationsnetzwerke und schlug auch einfache Methoden zur Kombination großer und kleiner Modelle. Es verbesserte die Überlappungswerte insgesamt und reduzierte Fehler an den Grenzen, während die Rechenanforderungen deutlich näher an denen eines konventionellen leichtgewichtigen Modells blieben. Analysen des Trainingsprozesses zeigten, dass MuGu mit fortschreitendem Lernen des leichtgewichtigen Netzwerks automatisch die Abhängigkeit vom Foundation-Modell zugunsten der eigenen Vorhersagen des kleineren Netzwerks verringerte.

Leistungsfähige KI näher an die Klinik bringen

Einfach gesagt zeigt diese Arbeit, wie ein großes, teures Modell eher als kluger Tutor denn als dauerhafte Krücke für ein kleineres Modell dienen kann. Indem das große Modell nur bei geringer Zuversicht hinzugezogen und gleichzeitig die Konturen anatomischer Strukturen gemeinsam verfeinert werden, trainiert MuGu ein effizientes Netzwerk, das seinen Lehrer in Schlüsselaufgaben ebenbürtig oder sogar überlegen sein kann. Dieser Ansatz könnte Krankenhäusern und Praxen helfen, stärkere KI-Assistenten auf bescheidener Hardware einzusetzen und so zuverlässigere automatisierte Auswertungen medizinischer Scans in den Alltag zu bringen.

Zitation: Wang, C., Wang, Z., Chen, W. et al. MuGu:mutual guidance learning between pretrained SAM and lightweight model for medical image segmentation. Sci Rep 16, 12099 (2026). https://doi.org/10.1038/s41598-026-41924-2

Schlüsselwörter: medizinische Bildsegmentierung, Foundation-Modelle, Tiefes Lernen, computerassistierte Diagnose, Modellkompression