Clear Sky Science · sv

MuGu: ömsesidig vägledningsinlärning mellan förtränad SAM och lättviktsmodell för medicinsk bildsegmentering

Skarpare datorseende för medicinska skanningar

Läkare förlitar sig på datorer för att markera misstänkta områden i skanningar av lungor, tarm, hjärna och lever — men dagens verktyg står inför en kompromiss: små modeller kör snabbt på sjukhus men kan missa subtila detaljer, medan stora moderna modeller är mer exakta men för tunga och kostsamma för allmänt bruk. Denna artikel presenterar ett nytt sätt att låta en kraftfull "grundmodell" lära en mindre modell utan att hålla tillbaka den, med målet att föra toppnivåförståelse av bilder till vardagliga kliniska miljöer.

Utmaningen i att lära mindre modeller

Medicinsk bildsegmentering handlar om att spåra den exakta konturen av organ, kärl eller lesioner i skanningar. Traditionella djupinlärningssystem är vanligtvis utformade för en specifik uppgift eller ett organ och får svårt när data eller bildförhållanden förändras. Nyare grundmodeller, såsom SAM-Med, kan anpassas till många uppgifter men kräver stora beräkningsresurser och mycket minne. Befintliga försök att kombinera de två låter ofta den stora modellen övervaka den lilla genom hela träningen och på varje bild. Författarna visar att denna konstanta, enhetliga övervakning faktiskt kan skada den mindre modellen när den börjar komma ikapp i prestanda, eftersom den hindrar den från att fullt ut utveckla sina egna styrkor.

En tvåvägskonversation mellan modeller

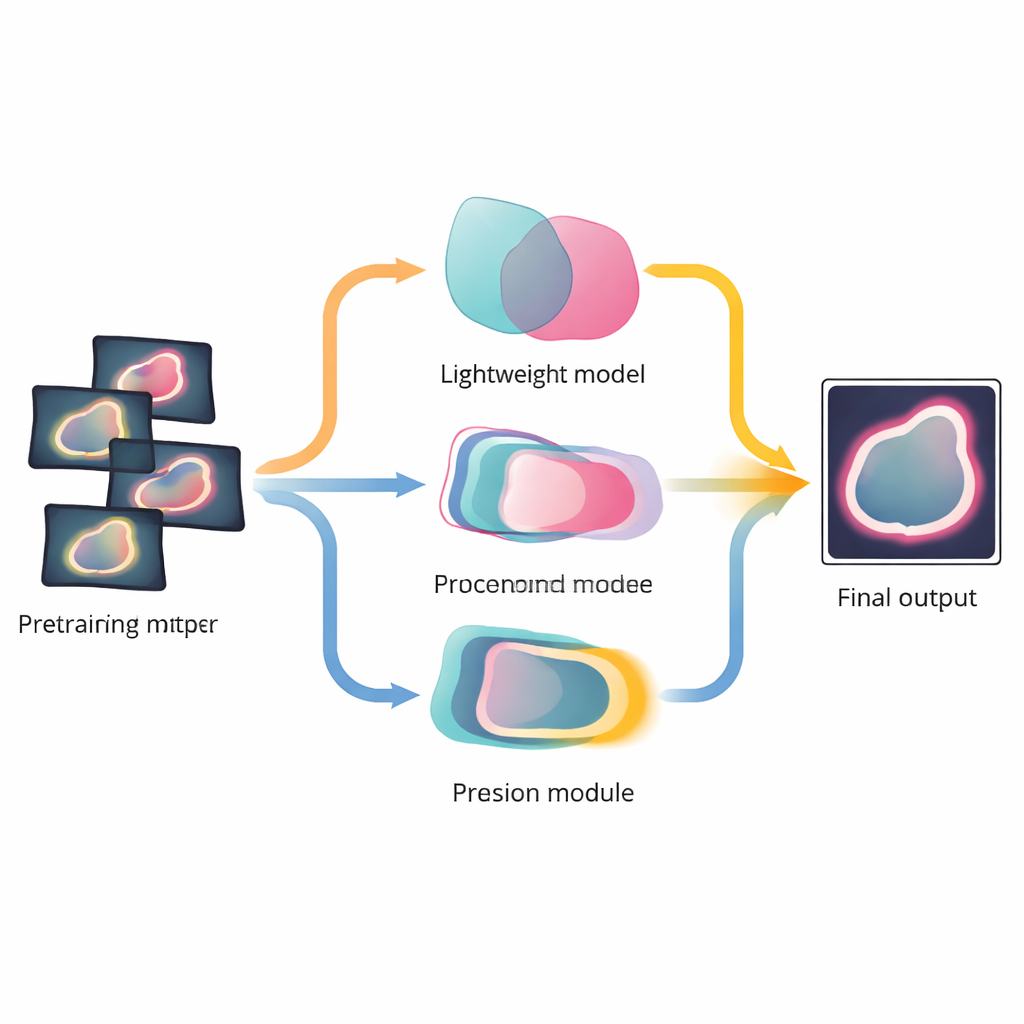

Författarna föreslår MuGu, en förkortning för "mutual guidance" (ömsesidig vägledning), ett ramverk där den stora och den lilla modellen påverkar varandra på ett mer selektivt och dynamiskt sätt. I centrum finns ett strömlinjeformat segmenteringsnätverk — lättviktsmodellen — utrustat med två huvuden som förutspår vad som är förgrund (till exempel en tumör) respektive bakgrund. Denna design hjälper det mindre nätverket att bättre bedöma sin egen säkerhet. MuGu introducerar sedan en återkopplingsslinga mellan lättviktsnätverket och SAM-Med, snarare än ett envägsflöde av kunskap.

Låt självförtroendet avgöra när hjälp behövs

Den första nyckelidén, kallad Confidence Prompt Guidance, går ut på att involvera SAM-Med endast där det är mest användbart. Under träning mäter MuGu hur väl den lilla modellens förgrunds- och bakgrundsförutsägelser överensstämmer med SAM-Meds output för varje bild. När det råder stark oenighet — vilket innebär att den lilla modellen är osäker eller felaktig — omvandlas dess förutsägelse till en "prompt" som ber SAM-Med om mer detaljerad vägledning för det specifika fallet. När de två modellerna redan är överens backar SAM-Med. Över tid minskar antalet bilder som kräver sådan intervention, så den kraftfulla modellen kan fokusera på de svåraste exemplen istället för att överskugga den mindre modellen.

Fördjupade konturer genom kooperativt fokus

Den andra innovationen, Ensemble Structure Boundary Guidance, fokuserar på den mest kritiska informationen i många medicinska uppgifter: den precisa gränsen mellan frisk och onormal vävnad. MuGu förenar tre perspektiv — den stora modellens segmentering, den lilla modellens förgrundsprognos och dess bakgrundsprognos — till en gemensam kantsignal. En specialiserad uppmärksamhetsmekanism lär sig hur mycket varje gren ska litas på i varje steg, och denna sammansmälta kantinformation används sedan för att förfina lättviktsmodellens interna funktioner och träningsförlust. Viktigt är att när träningen är klar kan systemet producera slutliga segmenteringar med endast den effektiva lilla modellen, utan att behöva SAM-Med alls.

Visade förbättringar över organ och skanningstyper

Forskarna testade MuGu på fyra publika dataset som tillsammans täcker lunglesioner, kolonpolyper, hjärnans artärer och leverkärl, med både 2D-bilder och fulla 3D-volymer. Över alla dessa överträffade MuGu välanvända segmenteringsnätverk och slog även enkla sätt att para stora och små modeller. Det förbättrade övergripande överlappningspoäng och minskade kantfel, samtidigt som beräkningsbehoven hölls mycket närmare en konventionell lättviktsmodell. Analys av träningsprocessen visade att när det lättviktsnätverket förbättrades skiftade MuGu automatiskt beroendet bort från grundmodellen och mot den lilla modellens egna förutsägelser.

Att föra kraftfull AI närmare kliniken

Enkelt uttryckt visar detta arbete hur en stor, kostsam modell kan agera som en smart handledare snarare än ett permanent krycka för en mindre modell. Genom att kalla in den stora modellen endast när självförtroendet är lågt och genom att gemensamt förfina konturerna av anatomiska strukturer tränar MuGu ett effektivt nätverk som kan mäta sig med eller till och med överträffa sin lärare i nyckeluppgifter. Detta tillvägagångssätt kan hjälpa sjukhus och kliniker att distribuera starkare AI-assistenter på blygsam hårdvara och därigenom göra automatiserade avläsningar av medicinska skanningar mer tillförlitliga i vardagen.

Citering: Wang, C., Wang, Z., Chen, W. et al. MuGu:mutual guidance learning between pretrained SAM and lightweight model for medical image segmentation. Sci Rep 16, 12099 (2026). https://doi.org/10.1038/s41598-026-41924-2

Nyckelord: medicinsk bildsegmentering, grundmodeller, djupinlärning, datorstödd diagnostik, modellkomprimering