Clear Sky Science · fr

MuGu : apprentissage par guidage mutuel entre SAM préentraîné et modèle léger pour la segmentation d'images médicales

Une vision par ordinateur plus nette pour les examens médicaux

Les médecins s'appuient sur des outils informatiques pour repérer les zones suspectes dans les scanners des poumons, du côlon, du cerveau et du foie — mais les outils actuels font face à un compromis : les petits modèles s'exécutent rapidement dans les hôpitaux mais peuvent manquer des détails subtils, tandis que les grands modèles de pointe sont plus précis mais trop lourds et coûteux pour une utilisation généralisée. Cet article présente une nouvelle méthode permettant à un puissant modèle « fondamental » d'enseigner à un modèle plus petit sans le freiner, dans le but d'apporter une compréhension d'image de haut niveau aux contextes cliniques quotidiens.

Le défi d'enseigner aux petits modèles

La segmentation d'images médicales consiste à tracer le contour exact des organes, vaisseaux ou lésions dans les examens. Les systèmes d'apprentissage profond traditionnels sont généralement adaptés à une tâche ou un organe précis et peinent lorsque les données ou les conditions d'imagerie changent. Les nouveaux modèles fondamentaux, comme SAM-Med, peuvent s'adapter à de nombreuses tâches mais exigent une puissance de calcul et une mémoire importantes. Les tentatives existantes de combinaison des deux laissent typiquement le grand modèle superviser le petit pendant tout l'entraînement et sur chaque image. Les auteurs montrent que cette supervision constante et uniforme peut en réalité nuire au petit modèle dès qu'il commence à rattraper son retard, l'empêchant de développer pleinement ses propres atouts.

Une conversation à double sens entre modèles

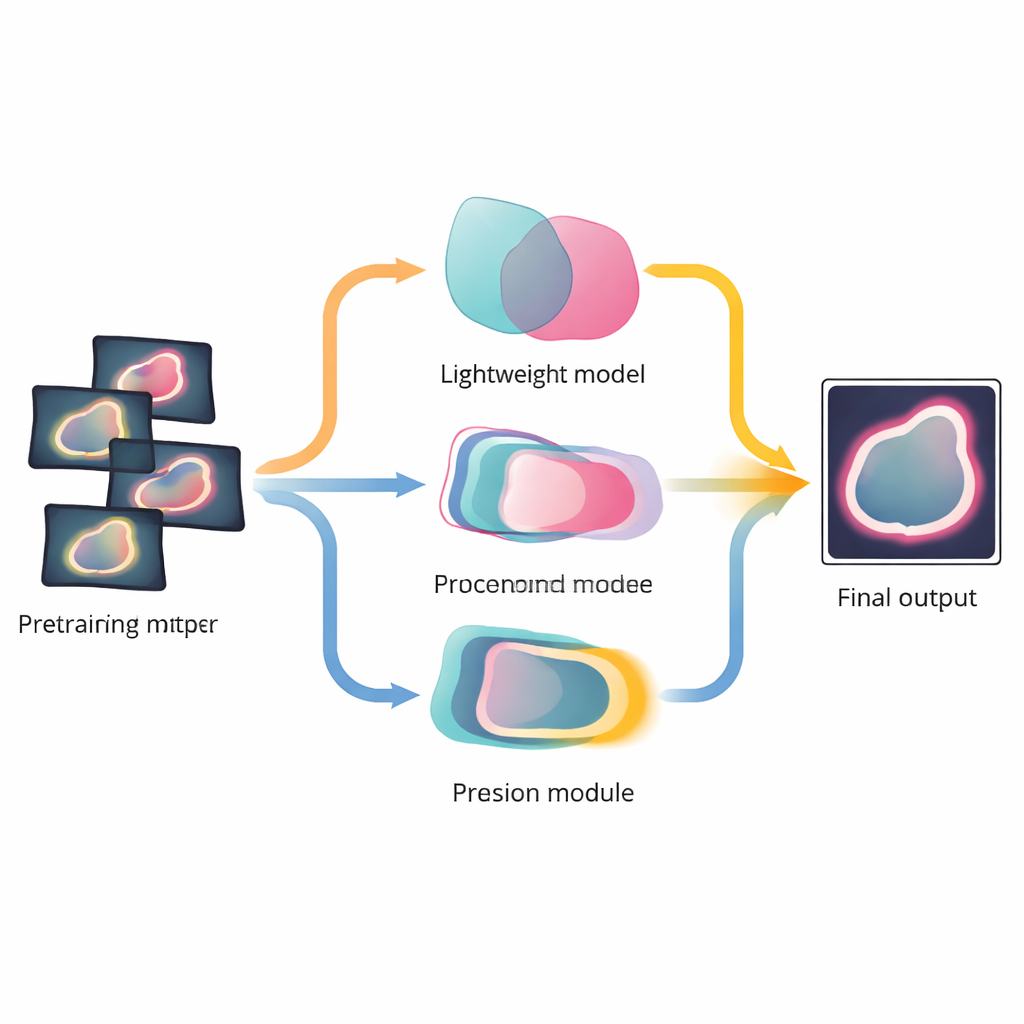

Les auteurs proposent MuGu, pour « mutual guidance » (guidage mutuel), un cadre où les grands et petits modèles s'influencent de façon plus sélective et dynamique. Au cœur de l'approche se trouve un réseau de segmentation allégé — le modèle léger — doté de deux têtes qui prédisent ce qui appartient au premier plan (par exemple, une tumeur) et ce qui relève de l'arrière-plan. Cette conception aide le petit réseau à mieux évaluer sa propre certitude. MuGu introduit ensuite une boucle de rétroaction entre le réseau léger et SAM-Med, plutôt qu'un flux de connaissances unidirectionnel.

Laisser la confiance décider quand l'aide est nécessaire

La première idée clé, appelée Confidence Prompt Guidance, consiste à solliciter SAM-Med uniquement là où il est le plus utile. Pendant l'entraînement, MuGu mesure dans quelle mesure les prédictions de premier plan et d'arrière-plan du petit modèle concordent avec la sortie de SAM-Med pour chaque image. Lorsqu'il existe un fort désaccord — signifiant que le petit modèle est incertain ou en erreur — sa prédiction est convertie en un « prompt » qui demande à SAM-Med des indications plus détaillées sur ce cas précis. Lorsque les deux modèles sont déjà d'accord, SAM-Med se met en retrait. Avec le temps, le nombre d'images nécessitant une telle intervention diminue, de sorte que le modèle puissant se concentre sur les exemples les plus difficiles au lieu d'éclipser le plus petit.

Aiguiser les contours par une attention coopérative

La deuxième innovation, Ensemble Structure Boundary Guidance, se concentre sur l'information la plus critique dans de nombreuses tâches médicales : la frontière précise entre tissu sain et tissu anormal. MuGu fusionne trois perspectives — la segmentation du grand modèle, la prédiction de premier plan du petit modèle et sa prédiction d'arrière-plan — en un signal de frontière partagé. Un mécanisme d'attention spécialisé apprend à quel point faire confiance à chaque branche à chaque étape, et cette information de frontière fusionnée est ensuite utilisée pour affiner les caractéristiques internes du modèle léger et sa fonction de perte pendant l'entraînement. Il est important de noter qu'une fois l'entraînement terminé, le système peut produire des segmentations finales en n'utilisant que le modèle léger efficace, sans avoir besoin de SAM-Med.

Gains démontrés sur plusieurs organes et types d'examens

Les chercheurs ont évalué MuGu sur quatre jeux de données publics couvrant ensemble les lésions pulmonaires, les polypes colorectaux, les artères cérébrales et les vaisseaux hépatiques, en utilisant à la fois des images 2D et des volumes 3D complets. Sur l'ensemble de ces jeux, MuGu a surpassé des réseaux de segmentation largement utilisés et a également battu des méthodes simples d'association de grands et petits modèles. Il a amélioré les scores de recouvrement globaux et réduit les erreurs de frontière, tout en maintenant des besoins computationnels beaucoup plus proches de ceux d'un modèle léger conventionnel. L'analyse du processus d'entraînement a montré que, à mesure que le réseau léger s'améliorait, MuGu diminuait automatiquement sa dépendance au modèle fondamental et s'appuyait davantage sur les prédictions du plus petit modèle.

Rapprocher l'IA puissante de la clinique

En termes simples, ce travail montre comment un grand modèle coûteux peut agir comme un tuteur intelligent plutôt que comme une béquille permanente pour un modèle plus petit. En faisant appel au grand modèle uniquement lorsque la confiance est faible et en affinant conjointement les contours des structures anatomiques, MuGu entraîne un réseau efficace qui peut rivaliser avec son enseignant, voire le surpasser sur des tâches clés. Cette approche pourrait aider hôpitaux et cliniques à déployer des assistants d'IA plus performants sur du matériel modeste, offrant des interprétations automatisées des examens médicaux plus fiables au quotidien.

Citation: Wang, C., Wang, Z., Chen, W. et al. MuGu:mutual guidance learning between pretrained SAM and lightweight model for medical image segmentation. Sci Rep 16, 12099 (2026). https://doi.org/10.1038/s41598-026-41924-2

Mots-clés: segmentation d'images médicales, modèles fondamentaux, apprentissage profond, diagnostic assisté par ordinateur, compression de modèle