Clear Sky Science · es

MuGu: aprendizaje de orientación mutua entre SAM preentrenado y modelo ligero para segmentación de imágenes médicas

Visión por ordenador más precisa para exploraciones médicas

Los médicos dependen de los ordenadores para resaltar zonas sospechosas en exploraciones de pulmón, colon, cerebro e hígado, pero las herramientas actuales afrontan un compromiso: los modelos pequeños se ejecutan rápido en entornos clínicos pero pueden pasar por alto detalles sutiles, mientras que los modelos enormes y de vanguardia son más precisos pero demasiado pesados y costosos para su uso generalizado. Este artículo presenta una nueva forma de permitir que un potente modelo «fundacional» enseñe a un modelo más pequeño sin limitarlo, con el objetivo de llevar una comprensión de imágenes de primer nivel a entornos clínicos cotidianos.

El reto de enseñar a modelos más pequeños

La segmentación de imágenes médicas consiste en trazar el contorno exacto de órganos, vasos o lesiones en las exploraciones. Los sistemas tradicionales de aprendizaje profundo suelen estar diseñados para una tarea u órgano concretos y tienen dificultades cuando cambian los datos o las condiciones de imagen. Los modelos fundacionales más recientes, como SAM-Med, pueden adaptarse a muchas tareas pero requieren gran potencia de cálculo y memoria. Los intentos existentes de combinar ambos tipos suelen dejar que el modelo grande supervise al pequeño de forma continua y en cada imagen. Los autores muestran que esa supervisión constante y uniforme puede perjudicar al modelo pequeño una vez que empieza a mejorar, impidiéndole desarrollar plenamente sus propias fortalezas.

Una conversación bidireccional entre modelos

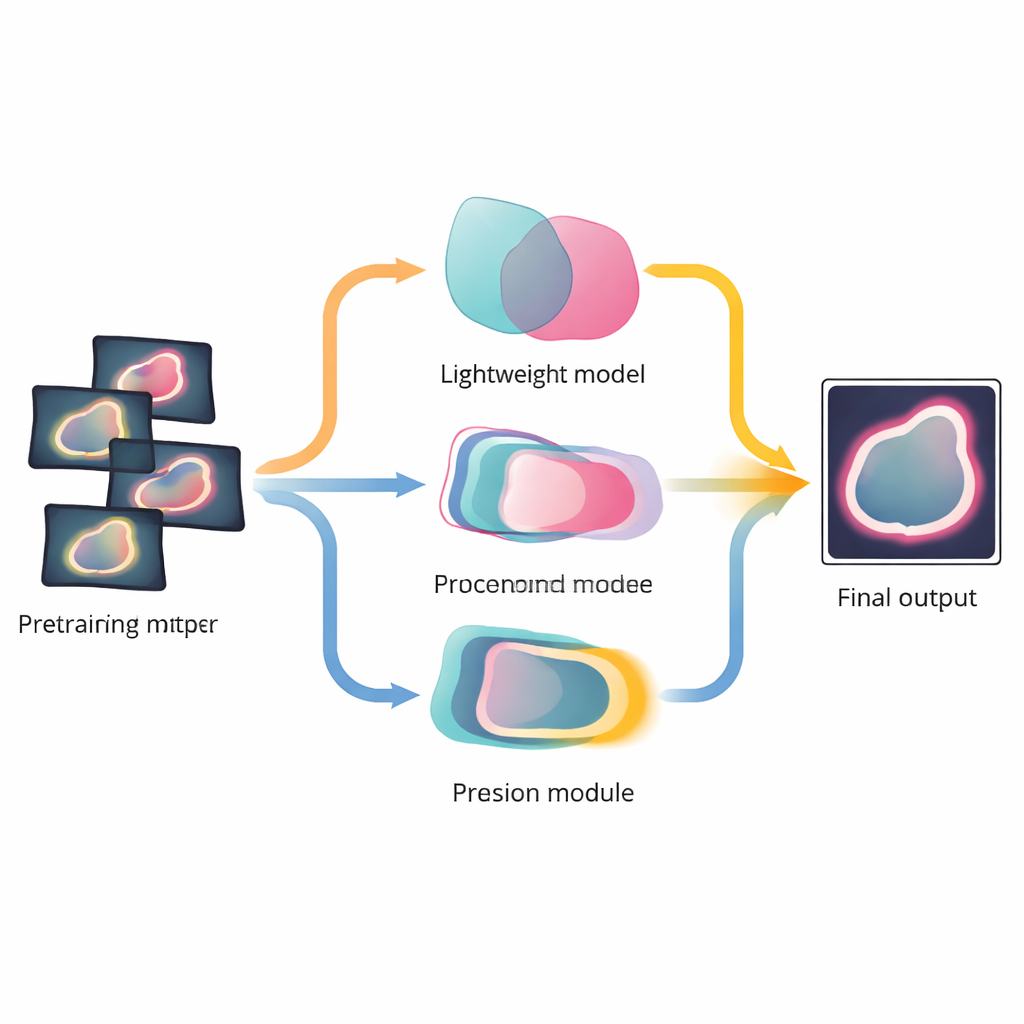

Los autores proponen MuGu, abreviatura de «mutual guidance» (orientación mutua), un marco en el que el modelo grande y el pequeño se influyen de manera más selectiva y dinámica. En su núcleo hay una red de segmentación simplificada —el modelo ligero— equipada con dos cabezas que predicen qué es primer plano (por ejemplo, un tumor) y qué es fondo. Este diseño ayuda a la red pequeña a juzgar mejor su propia certeza. MuGu introduce entonces un bucle de retroalimentación entre la red ligera y SAM-Med, en lugar de un flujo de conocimiento unidireccional.

Dejar que la confianza decida cuándo se necesita ayuda

La primera idea clave, llamada Confidence Prompt Guidance, consiste en involucrar a SAM-Med solo donde resulta más útil. Durante el entrenamiento, MuGu mide cómo de bien coinciden las predicciones de primer plano y fondo del modelo pequeño con la salida de SAM-Med en cada imagen. Cuando hay un fuerte desacuerdo —es decir, el modelo pequeño está inseguro o equivocado— su predicción se convierte en un «prompt» que pide a SAM-Med una orientación más detallada en ese caso concreto. Cuando ambos modelos ya coinciden, SAM-Med se retira. Con el tiempo, el número de imágenes que requieren dicha intervención disminuye, de modo que el modelo potente se concentra en los ejemplos más difíciles en lugar de eclipsar al más pequeño.

Afinar los límites mediante enfoque cooperativo

La segunda innovación, Ensemble Structure Boundary Guidance, se centra en la información más crítica en muchas tareas médicas: el límite preciso entre tejido sano y anómalo. MuGu fusiona tres perspectivas —la segmentación del modelo grande, la predicción de primer plano del modelo pequeño y su predicción de fondo— en una señal de contorno compartida. Un mecanismo de atención especializado aprende cuánto confiar en cada rama en cada etapa, y esta información de contorno fusionada se utiliza para refinar las características internas y la función de pérdida del modelo ligero. Es importante señalar que, una vez finalizado el entrenamiento, el sistema puede producir segmentaciones finales usando solo el modelo pequeño eficiente, sin necesitar para nada a SAM-Med.

Ganancias demostradas en órganos y tipos de exploración

Los investigadores evaluaron MuGu en cuatro conjuntos de datos públicos que cubren lesiones pulmonares, pólipos de colon, arterias cerebrales y vasos hepáticos, usando tanto imágenes 2D como volúmenes 3D completos. En todos ellos, MuGu superó a redes de segmentación ampliamente usadas y también a formas sencillas de emparejar modelos grandes y pequeños. Mejora las puntuaciones de solapamiento generales y reduce los errores en los contornos, manteniendo al mismo tiempo las demandas computacionales mucho más próximas a las de un modelo ligero convencional. El análisis del proceso de entrenamiento mostró que, conforme la red ligera mejoraba, MuGu desplazaba automáticamente la dependencia del modelo fundacional hacia las propias predicciones del modelo pequeño.

Acercar la IA potente a la clínica

En términos sencillos, este trabajo muestra cómo un modelo grande y costoso puede actuar como tutor inteligente en lugar de una muleta permanente para un modelo más pequeño. Al recurrir al modelo grande solo cuando la confianza es baja y al refinar conjuntamente los contornos de las estructuras anatómicas, MuGu entrena una red eficiente que puede igualar o incluso superar a su maestro en tareas clave. Este enfoque podría ayudar a hospitales y clínicas a desplegar asistentes de IA más potentes en hardware modesto, llevando lecturas automatizadas de exploraciones médicas más fiables a la práctica diaria.

Cita: Wang, C., Wang, Z., Chen, W. et al. MuGu:mutual guidance learning between pretrained SAM and lightweight model for medical image segmentation. Sci Rep 16, 12099 (2026). https://doi.org/10.1038/s41598-026-41924-2

Palabras clave: segmentación de imágenes médicas, modelos fundacionales, aprendizaje profundo, diagnóstico asistido por ordenador, compresión de modelos