Clear Sky Science · it

MuGu: apprendimento a guida reciproca tra SAM preaddestrato e modello leggero per la segmentazione di immagini mediche

Visione computerizzata più precisa per le scansioni mediche

I medici si affidano ai computer per evidenziare aree sospette nelle scansioni di polmoni, colon, cervello e fegato — ma gli strumenti odierni affrontano un compromesso: i modelli piccoli girano velocemente negli ospedali ma possono perdere dettagli sottili, mentre i grandi modelli all’avanguardia sono più accurati ma troppo pesanti e costosi da impiegare ovunque. Questo articolo presenta un nuovo modo per permettere a un potente modello «di base» di insegnare a un modello più piccolo senza ostacolarlo, con l’obiettivo di portare una comprensione delle immagini di alto livello negli ambienti clinici quotidiani.

La sfida di istruire modelli più piccoli

La segmentazione di immagini mediche consiste nel tracciare il profilo esatto di organi, vasi o lesioni nelle scansioni. I sistemi tradizionali di deep learning sono solitamente progettati per un compito o un organo specifico e faticano quando i dati o le condizioni di imaging cambiano. I più recenti modelli di base, come SAM-Med, possono adattarsi a molti compiti ma richiedono risorse di calcolo e memoria significative. I tentativi esistenti di combinare i due approcci di solito lasciano il modello grande a supervisionare quello piccolo per tutta la durata dell’addestramento e su ogni immagine. Gli autori dimostrano che questa supervisione costante e uniforme può in realtà danneggiare il modello più piccolo una volta che questo comincia a colmare il divario nelle prestazioni, impedendogli di sviluppare appieno le proprie capacità.

Una conversazione a doppio senso tra i modelli

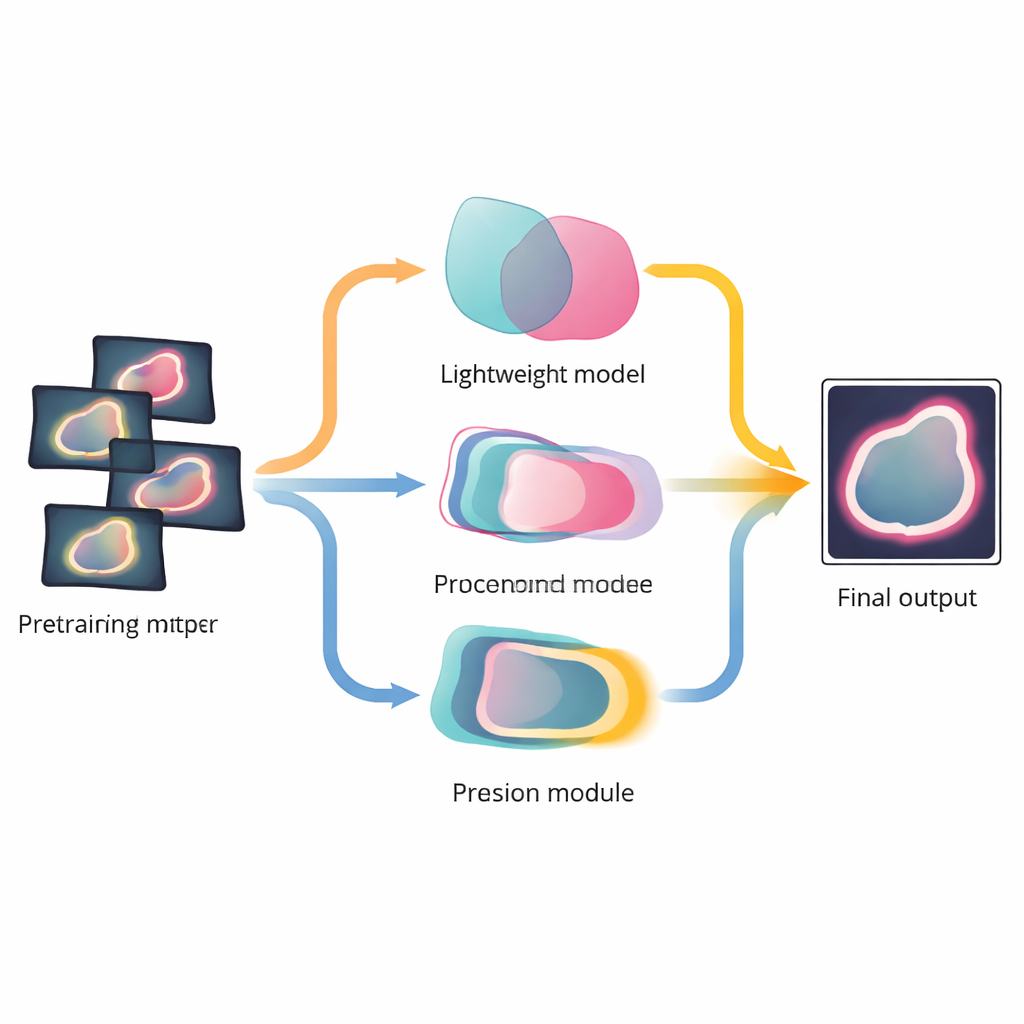

Gli autori propongono MuGu, abbreviazione di «mutual guidance», un framework in cui il modello grande e quello piccolo si influenzano a vicenda in modo più selettivo e dinamico. Al centro c’è una rete di segmentazione snella — il modello leggero — dotata di due teste che predicono ciò che è primo piano (per esempio un tumore) e ciò che è sfondo. Questo progetto aiuta la rete più piccola a valutare meglio la propria certezza. MuGu introduce quindi un circuito di feedback tra la rete leggera e SAM-Med, invece di un flusso di conoscenza monodirezionale.

Lasciare che sia la fiducia a decidere quando serve aiuto

La prima idea chiave, chiamata Confidence Prompt Guidance, coinvolge SAM-Med solo dove è più utile. Durante l’addestramento, MuGu misura quanto le predizioni di primo piano e sfondo del modello piccolo corrispondono all’output di SAM-Med per ogni immagine. Quando c’è forte disaccordo — cioè quando il modello piccolo è insicuro o sbaglia — la sua predizione viene convertita in un «prompt» che chiede a SAM-Med una guida più dettagliata per quel caso specifico. Quando i due modelli sono già d’accordo, SAM-Med si ritrae. Col tempo, il numero di immagini che richiedono tale intervento diminuisce, così il modello potente si concentra sugli esempi più difficili invece di oscurare quello più piccolo.

Affinare i contorni tramite attenzione cooperativa

La seconda innovazione, Ensemble Structure Boundary Guidance, si concentra sull’informazione più critica in molti compiti medici: il confine preciso tra tessuto sano e anomalo. MuGu fonde tre prospettive — la segmentazione del modello grande, la predizione di primo piano del modello piccolo e la sua predizione di sfondo — in un segnale di confine condiviso. Un meccanismo di attenzione specializzato impara quanto fidarsi di ciascun ramo a ogni stadio, e queste informazioni sul confine fuse vengono poi usate per affinare le caratteristiche interne del modello leggero e la sua funzione di perdita durante l’addestramento. È importante notare che, una volta completato l’addestramento, il sistema può produrre le segmentazioni finali utilizzando solo il modello efficiente, senza necessitare di SAM-Med.

Benefici dimostrati su organi e tipi di scansione

I ricercatori hanno testato MuGu su quattro dataset pubblici che coprono nel complesso lesioni polmonari, polipi del colon, arterie cerebrali e vasi epatici, utilizzando sia immagini 2D sia volumi 3D completi. In tutti i casi, MuGu ha superato reti di segmentazione ampiamente usate e ha battuto anche metodi semplici di accoppiamento tra modelli grandi e piccoli. Ha migliorato i punteggi di sovrapposizione complessiva e ridotto gli errori al contorno, mantenendo le richieste computazionali molto più vicine a quelle di un modello leggero convenzionale. L’analisi del processo di addestramento ha mostrato che, man mano che la rete leggera migliorava, MuGu spostava automaticamente l’affidamento dal modello di base verso le predizioni del modello più piccolo.

Portare l’IA potente più vicino alla clinica

In termini semplici, questo lavoro mostra come un modello grande e costoso possa svolgere il ruolo di tutor intelligente piuttosto che di stampella permanente per un modello più piccolo. Chiamando in causa il modello grande solo quando la fiducia è bassa e raffinando congiuntamente i contorni delle strutture anatomiche, MuGu allena una rete efficiente che può rivaleggiare o addirittura superare il suo insegnante nei compiti chiave. Questo approccio potrebbe aiutare ospedali e cliniche a distribuire assistenti IA più robusti su hardware modesto, portando letture automatizzate delle scansioni mediche più affidabili nella pratica quotidiana.

Citazione: Wang, C., Wang, Z., Chen, W. et al. MuGu:mutual guidance learning between pretrained SAM and lightweight model for medical image segmentation. Sci Rep 16, 12099 (2026). https://doi.org/10.1038/s41598-026-41924-2

Parole chiave: segmentazione di immagini mediche, modelli di base, deep learning, diagnosi assistita al computer, compressione del modello