Clear Sky Science · pl

MuGu: wzajemne uczenie z przewodnictwem między wstępnie wytrenowanym SAM a lekkim modelem do segmentacji obrazów medycznych

Ostre widzenie komputerowe dla skanów medycznych

Lekarze polegają na komputerach, które uwydatniają podejrzane ogniska na skanach płuc, jelita grubego, mózgu i wątroby — jednak współczesne narzędzia stoją przed kompromisem: małe modele działają szybko w warunkach szpitalnych, ale mogą przeoczyć subtelne szczegóły, podczas gdy ogromne, najnowocześniejsze modele są dokładniejsze, lecz zbyt ciężkie i kosztowne, by stosować je powszechnie. W artykule przedstawiono nowy sposób, by pozwolić potężnemu „modelowi fundamentowemu” uczyć mniejszy model bez tłumienia jego rozwoju, z zamiarem przeniesienia najwyższego poziomu rozumienia obrazów do codziennej praktyki klinicznej.

Wyzwanie nauczania mniejszych modeli

Segmentacja obrazów medycznych polega na wyznaczaniu dokładnego obrysu narządów, naczyń lub zmian patologicznych na skanach. Tradycyjne systemy uczenia głębokiego są zwykle dostosowane do konkretnego zadania lub narządu i mają trudności, gdy zmieniają się dane lub warunki obrazowania. Nowe modele fundamentowe, takie jak SAM-Med, potrafią adaptować się do wielu zadań, ale wymagają znacznej mocy obliczeniowej i pamięci. Istniejące próby łączenia obu podejść zwykle polegają na tym, że duży model nadzoruje mały przez cały czas szkolenia i dla każdego obrazu. Autorzy wykazują, że takie stałe, jednolite nadzorowanie może wręcz szkodzić mniejszemu modelowi, gdy ten zaczyna doganiać w wydajności, uniemożliwiając mu pełne rozwinięcie własnych zalet.

Dwukierunkowa rozmowa między modelami

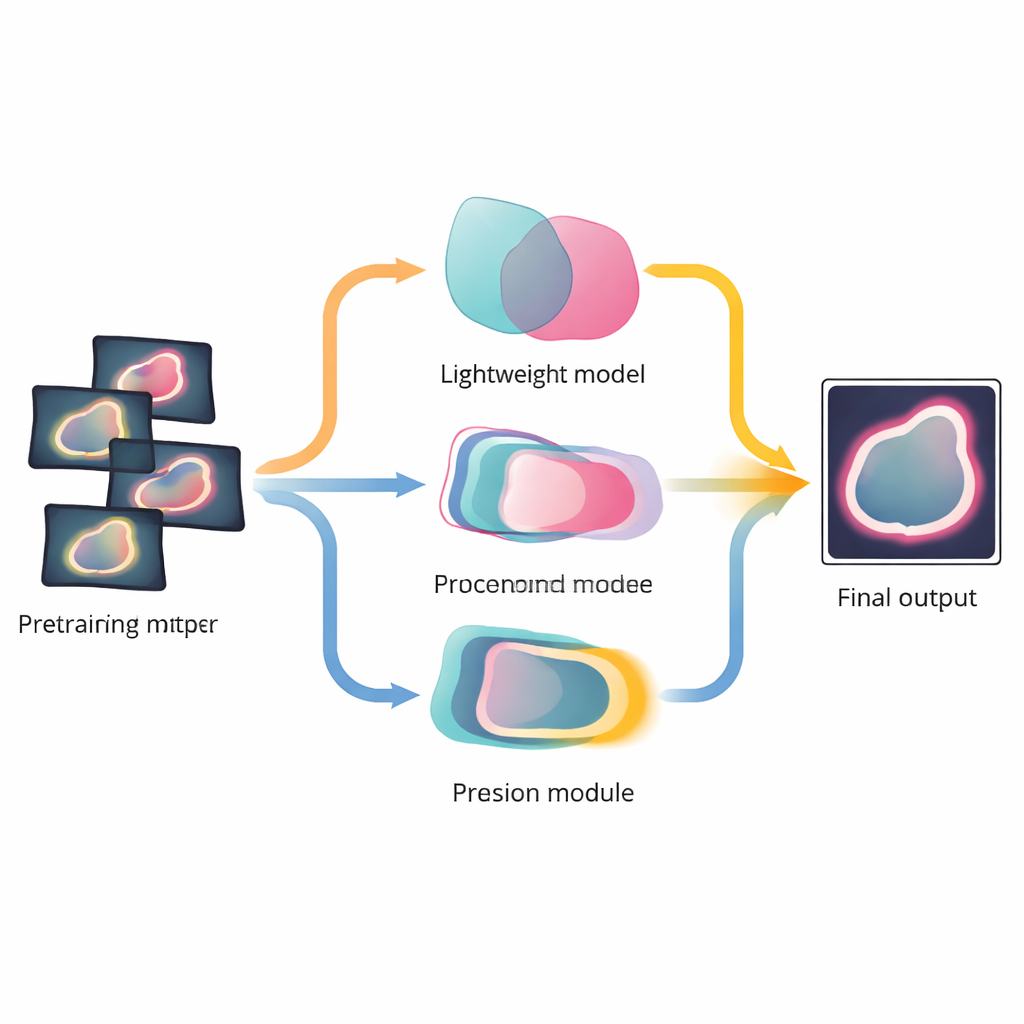

Autorzy proponują MuGu, czyli „wzajemne przewodnictwo”, ramy, w których duży i mały model wpływają na siebie w sposób bardziej selektywny i dynamiczny. W centrum stoi odchudzona sieć segmentacyjna — lekki model — wyposażona w dwa wyjścia przewidujące, co jest pierwszoplanem (np. guz) i co jest tłem. Taka konstrukcja pomaga mniejszej sieci lepiej oceniać własną pewność. MuGu wprowadza następnie pętlę informacji zwrotnej między siecią lekką a SAM-Med, zamiast jednokierunkowego przepływu wiedzy.

Pozwolić pewności decydować, kiedy potrzebna jest pomoc

Pierwszy kluczowy pomysł, nazwany Confidence Prompt Guidance, polega na angażowaniu SAM-Med tylko tam, gdzie jest to najbardziej użyteczne. Podczas treningu MuGu mierzy, na ile przewidywania pierwszoplanowe i tła małego modelu zgadzają się z wyjściem SAM-Med dla poszczególnych obrazów. Gdy występuje silna niezgodność — co oznacza, że mały model jest niepewny lub błędny — jego predykcja zostaje przekształcona w „prompt”, który prosi SAM-Med o bardziej szczegółowe wskazówki dla tego konkretnego przypadku. Gdy oba modele już się zgadzają, SAM-Med wycofuje się. Z czasem liczba obrazów wymagających takiej interwencji maleje, więc potężny model koncentruje się na najtrudniejszych przykładach zamiast przytłaczać mniejszy model.

Wyostrzanie granic przez współpracujące skupienie

Drugą innowacją jest Ensemble Structure Boundary Guidance, która koncentruje się na najistotniejszych informacjach w wielu zadaniach medycznych: precyzyjnej granicy między tkanką zdrową a zmienioną. MuGu łączy trzy perspektywy — segmentację dużego modelu, przewidywanie pierwszoplanowe małego modelu oraz jego przewidywanie tła — w wspólny sygnał granicy. Specjalny mechanizm uwagi uczy się, ile zaufać każdej gałęzi na każdym etapie, a scalone informacje o granicy są następnie używane do udoskonalania wewnętrznych cech lekkiego modelu i funkcji straty w treningu. Co ważne, po zakończeniu treningu system potrafi generować ostateczne segmentacje używając wyłącznie wydajnego, małego modelu, bez potrzeby korzystania z SAM-Med.

Udowodnione korzyści dla różnych narządów i typów skanów

Badacze przetestowali MuGu na czterech publicznych zbiorach danych obejmujących zmiany w płucach, polipy jelita grubego, tętnice mózgu i naczynia wątroby, wykorzystując zarówno obrazy 2D, jak i pełne objętości 3D. We wszystkich przypadkach MuGu przewyższył szeroko stosowane sieci segmentacyjne, a także pokonał proste sposoby łączenia dużych i małych modeli. Poprawił ogólne miary nakładania i zmniejszył błędy graniczne, zachowując przy tym wymagania obliczeniowe znacznie bliższe tym typowym dla konwencjonalnego modelu lekkiego. Analiza procesu treningowego pokazała, że w miarę jak sieć lekka się poprawiała, MuGu automatycznie zmniejszał zależność od modelu fundamentowego i przesuwał zaufanie ku własnym predykcjom mniejszego modelu.

Przybliżenie potężnej sztucznej inteligencji do kliniki

Mówiąc prościej, praca ta pokazuje, jak duży, kosztowny model może pełnić rolę mądrego nauczyciela zamiast trwałej podpórki dla modelu mniejszego. Dzięki odwoływaniu się do dużego modelu tylko wtedy, gdy pewność jest niska, oraz wspólnemu dopracowywaniu obrysów struktur anatomicznych, MuGu trenuje wydajną sieć, która może równać się lub nawet przewyższać swojego nauczyciela w kluczowych zadaniach. Podejście to może pomóc szpitalom i klinikom wdrażać silniejsze asystenty AI na umiarkowanym sprzęcie, dostarczając bardziej niezawodnych automatycznych odczytów skanów medycznych w codziennej praktyce.

Cytowanie: Wang, C., Wang, Z., Chen, W. et al. MuGu:mutual guidance learning between pretrained SAM and lightweight model for medical image segmentation. Sci Rep 16, 12099 (2026). https://doi.org/10.1038/s41598-026-41924-2

Słowa kluczowe: segmentacja obrazów medycznych, modele fundamentowe, uczenie głębokie, komputerowo wspomagana diagnostyka, kompresja modeli