Clear Sky Science · pt

MuGu: aprendizagem de orientação mútua entre SAM pré-treinado e modelo leve para segmentação de imagens médicas

Visão computacional mais nítida para exames médicos

Médicos contam com computadores para destacar pontos suspeitos em exames dos pulmões, cólon, cérebro e fígado — mas as ferramentas atuais enfrentam um trade-off: modelos pequenos rodam rapidamente em hospitais, porém podem perder detalhes sutis, enquanto modelos enormes e de ponta são mais precisos, mas pesados e caros demais para uso generalizado. Este artigo introduz uma nova maneira de permitir que um modelo “fundação” poderoso ensine um modelo menor sem restringi-lo, com o objetivo de levar compreensão de imagem de alto nível a cenários clínicos cotidianos.

O desafio de ensinar modelos menores

Segmentação de imagens médicas é a tarefa de traçar o contorno exato de órgãos, vasos ou lesões em exames. Sistemas tradicionais de aprendizado profundo costumam ser ajustados a uma tarefa ou órgão específico e têm dificuldade quando os dados ou as condições de imagem mudam. Modelos fundação mais recentes, como o SAM-Med, podem se adaptar a muitas tarefas, mas exigem grande poder de processamento e memória. Tentativas existentes de combinar os dois geralmente deixam o modelo grande supervisionar o pequeno durante todo o treinamento e em cada imagem. Os autores mostram que essa supervisão constante e uniforme pode, na verdade, prejudicar o modelo menor assim que ele começa a alcançar desempenho semelhante, impedindo-o de desenvolver plenamente suas próprias forças.

Uma conversa de mão dupla entre modelos

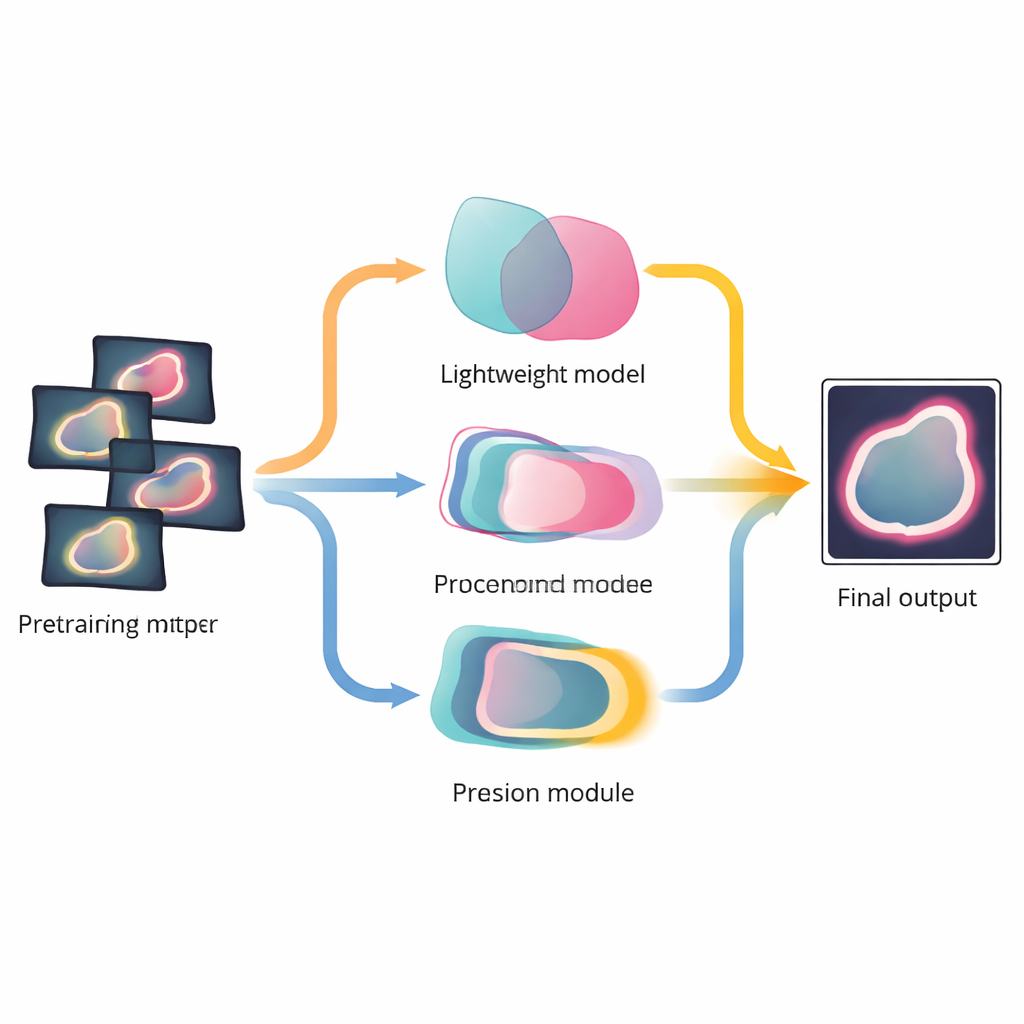

Os autores propõem o MuGu, abreviação de “mutual guidance” (orientação mútua), um framework onde os modelos grande e pequeno se influenciam de forma mais seletiva e dinâmica. No centro está uma rede de segmentação enxuta — o modelo leve — equipada com duas cabeças que predizem o que é primeiro plano (por exemplo, um tumor) e o que é plano de fundo. Esse desenho ajuda a rede menor a avaliar melhor sua própria certeza. O MuGu então introduz um loop de feedback entre a rede leve e o SAM-Med, em vez de um fluxo de conhecimento unidirecional.

Deixar a confiança decidir quando é necessário auxílio

A primeira ideia-chave, chamada Confidence Prompt Guidance (orientação por prompt baseada em confiança), consiste em envolver o SAM-Med apenas onde ele é mais útil. Durante o treinamento, o MuGu mede quão bem as predições de primeiro plano e plano de fundo do modelo pequeno coincidem com a saída do SAM-Med em cada imagem. Quando há forte desacordo — isto é, quando o modelo pequeno está incerto ou errado — sua predição é convertida em um “prompt” que pede ao SAM-Med uma orientação mais detalhada para aquele caso específico. Quando os dois modelos já concordam, o SAM-Med se afasta. Com o tempo, o número de imagens que precisam de intervenção diminui, de modo que o modelo poderoso se concentra nos exemplos mais difíceis em vez de ofuscar o menor.

Afinando contornos por meio de foco cooperativo

A segunda inovação, Ensemble Structure Boundary Guidance (orientação de fronteira por estrutura em conjunto), concentra-se na informação mais crítica em muitas tarefas médicas: o contorno preciso entre tecido saudável e anormal. O MuGu funde três perspectivas — a segmentação do modelo grande, a predição de primeiro plano do modelo pequeno e sua predição de plano de fundo — em um sinal de fronteira compartilhado. Um mecanismo de atenção especializado aprende quanto confiar em cada ramo em cada estágio, e essa informação de fronteira fundida é então usada para refinar as características internas do modelo leve e a função de perda durante o treinamento. Importante: uma vez finalizado o treinamento, o sistema pode produzir segmentações finais usando apenas o modelo pequeno eficiente, sem necessidade do SAM-Med.

Ganho comprovado em órgãos e tipos de exame

Os pesquisadores testaram o MuGu em quatro conjuntos de dados públicos que cobrem, conjuntamente, lesões pulmonares, pólipos do cólon, artérias cerebrais e vasos do fígado, usando tanto imagens 2D quanto volumes 3D completos. Em todos eles, o MuGu superou redes de segmentação amplamente usadas e também venceu formas diretas de emparelhar modelos grandes e pequenos. Ele melhorou as métricas de sobreposição geral e reduziu erros de contorno, mantendo as demandas computacionais muito mais próximas às de um modelo leve convencional. A análise do processo de treinamento mostrou que, à medida que a rede leve melhorava, o MuGu deslocava automaticamente a dependência do modelo fundação para as próprias predições do modelo menor.

Levando IA poderosa mais perto da clínica

Em termos simples, este trabalho mostra como um modelo grande e caro pode atuar como um tutor inteligente em vez de uma muleta permanente para um modelo menor. Ao convocar o modelo grande apenas quando a confiança é baixa e ao refinar conjuntamente os contornos de estruturas anatômicas, o MuGu treina uma rede eficiente que pode rivalizar ou até superar seu professor em tarefas-chave. Essa abordagem pode ajudar hospitais e clínicas a implantar assistentes de IA mais robustos em hardware modesto, trazendo leituras automatizadas de exames médicos mais confiáveis à prática cotidiana.

Citação: Wang, C., Wang, Z., Chen, W. et al. MuGu:mutual guidance learning between pretrained SAM and lightweight model for medical image segmentation. Sci Rep 16, 12099 (2026). https://doi.org/10.1038/s41598-026-41924-2

Palavras-chave: segmentação de imagens médicas, modelos fundamentais, aprendizado profundo, diagnóstico assistido por computador, compressão de modelo