Clear Sky Science · nl

MuGu: wederzijdse begeleidingsleer tussen voorgetrainde SAM en lichtgewicht model voor medische beeldsegmentatie

Heldere computerbeeldvorming voor medische scans

Artsen vertrouwen op computers om verdachte plekken in scans van longen, dikke darm, hersenen en lever te markeren — maar de huidige hulpmiddelen kennen een afweging: kleine modellen draaien snel in ziekenhuizen maar kunnen subtiele details missen, terwijl enorme state-of-the-art modellen nauwkeuriger zijn maar te zwaar en duur om overal in te zetten. Dit artikel introduceert een nieuwe manier waarop een krachtig "fundatiemodel" een kleiner model kan leren zonder het te onderdrukken, met het doel topklasse beeldbegrip naar alledaagse klinische omgevingen te brengen.

De uitdaging van het onderwijzen van kleinere modellen

Medische beeldsegmentatie is de taak van het nauwkeurig uits tekenen van organen, vaten of laesies in scans. Traditionele deep-learningsystemen zijn meestal op een specifieke taak of orgaan afgestemd en hebben moeite wanneer data of beeldvormingcondities veranderen. Nieuwere fundatiemodellen, zoals SAM-Med, kunnen zich aan veel taken aanpassen maar vereisen aanzienlijke rekenkracht en geheugen. Bestaande pogingen om de twee te combineren laten doorgaans het grote model het kleine gedurende de hele training en voor elk beeld superviseren. De auteurs tonen aan dat deze constante, uniforme supervisie het kleinere model juist kan schaden zodra het begint in te lopen qua prestaties, doordat het verhindert dat het zijn eigen sterke punten volledig ontwikkelt.

Een tweerichtingsgesprek tussen modellen

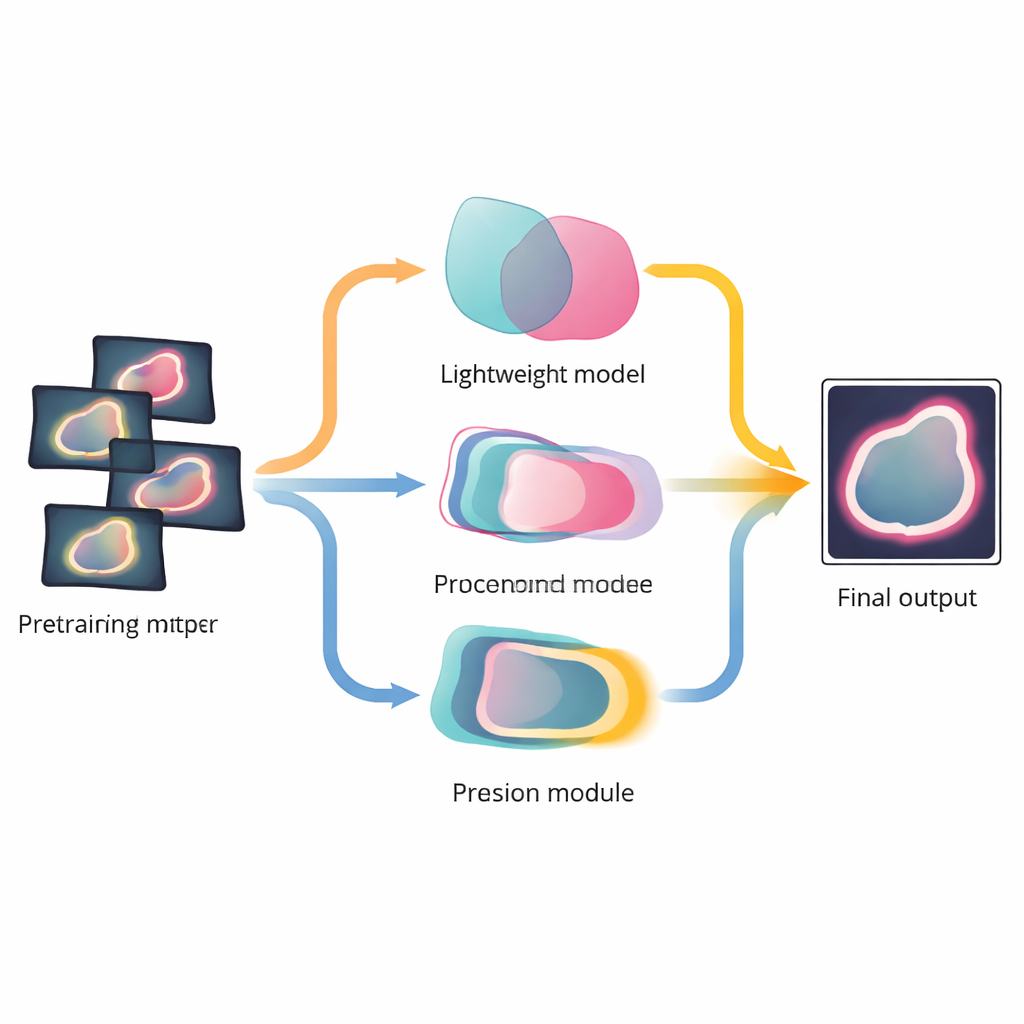

De auteurs stellen MuGu voor, een afkorting van "mutual guidance", een raamwerk waarin het grote en het kleine model elkaar op een selectievere en dynamischere manier beïnvloeden. Centraal staat een gestroomlijnd segmentatienetwerk — het lichtgewicht model — voorzien van twee hoofden die voorspellen wat voorgrond (bijvoorbeeld een tumor) en wat achtergrond is. Dit ontwerp helpt het kleinere netwerk beter zijn eigen zekerheid in te schatten. MuGu introduceert vervolgens een feedbacklus tussen het lichtgewicht netwerk en SAM-Med, in plaats van een eenrichtingsstroom van kennis.

De zekerheid laten bepalen wanneer hulp nodig is

Het eerste kernidee, Confidence Prompt Guidance, is om SAM-Med alleen te betrekken waar het het meest nuttig is. Tijdens de training meet MuGu hoe goed de voorgrond- en achtergrondvoorspellingen van het kleine model overeenkomen met de output van SAM-Med voor elk beeld. Wanneer er sterke onenigheid is — wat betekent dat het kleine model onzeker of fout zit — wordt de voorspelling omgezet in een "prompt" die SAM-Med vraagt om meer gedetailleerde begeleiding voor dat specifieke geval. Wanneer de twee modellen al overeenkomen, treedt SAM-Med terug. In de loop van de tijd daalt het aantal beelden dat zo’n tussenkomst nodig heeft, zodat het krachtige model zich op de moeilijkste voorbeelden kan concentreren in plaats van het kleinere model te overschaduwen.

Grenslijnen verscherpen door gezamenlijke focus

De tweede innovatie, Ensemble Structure Boundary Guidance, richt zich op de meest kritische informatie in veel medische taken: de precieze grens tussen gezond en afwijkend weefsel. MuGu combineert drie perspectieven — de segmentatie van het grote model, de voorgrondvoorspelling van het kleine model en diens achtergrondvoorspelling — tot een gedeeld grenssignaal. Een gespecialiseerde attentie-mechanisme leert hoeveel vertrouwen aan elke tak toe te kennen in elke fase, en deze gefuseerde grensinformatie wordt vervolgens gebruikt om de interne kenmerken en de trainingsloss van het lichtgewicht model te verfijnen. Belangrijk is dat zodra de training is voltooid, het systeem definitieve segmentaties kan produceren met alleen het efficiënte kleine model, zonder SAM-Med te hoeven gebruiken.

Aangetoonde verbeteringen voor verschillende organen en scantypes

De onderzoekers testten MuGu op vier openbare datasets die samen longlaesies, colonpoliepen, hersenarteriën en leverslagaders bestrijken, gebruikmakend van zowel 2D-beelden als volledige 3D-volumes. In alle gevallen presteerde MuGu beter dan veelgebruikte segmentatienetwerken en overtrof het ook eenvoudige manieren om grote en kleine modellen te combineren. Het verbeterde de algemene overlap-scores en verminderde grensfouten, terwijl de rekenkundige eisen veel dichter bij die van een conventioneel lichtgewicht model bleven. Analyse van het trainingsproces toonde aan dat MuGu, naarmate het lichtgewicht netwerk verbeterde, automatisch de afhankelijkheid van het fundatiemodel verschuift naar de eigen voorspellingen van het kleinere model.

Krachtige AI dichter bij de kliniek brengen

Simpel gezegd laat dit werk zien hoe een groot, kostbaar model kan fungeren als een slimme tutor in plaats van als een permanente kruk voor een kleiner model. Door het grote model alleen in te schakelen wanneer de onzekerheid laag is en door gezamenlijk de contouren van anatomische structuren te verfijnen, traint MuGu een efficiënt netwerk dat op sleutel taken zijn leraar kan evenaren of zelfs overtreffen. Deze benadering kan ziekenhuizen en klinieken helpen sterkere AI-assistenten op bescheiden hardware uit te rollen, en zo betrouwbaardere geautomatiseerde uitlezingen van medische scans in de dagelijkse praktijk brengen.

Bronvermelding: Wang, C., Wang, Z., Chen, W. et al. MuGu:mutual guidance learning between pretrained SAM and lightweight model for medical image segmentation. Sci Rep 16, 12099 (2026). https://doi.org/10.1038/s41598-026-41924-2

Trefwoorden: medische beeldsegmentatie, fundatiemodellen, deep learning, computerondersteunde diagnose, modelcompressie