Clear Sky Science · sv

Hybrid djupinlärning och YAMNet‑funktioner för astmadiagnos från andningsljud

Lyssna på andetag i stället för att blåsa i ett rör

För miljontals människor med astma innebär en tydlig diagnos ofta ett besök på kliniken och lungfunktionsprov som kan vara ansträngande, tidskrävande och svåra att upprepa regelbundet. Denna studie undersöker en helt annan idé: att använda ljudet av någons andning och hosta, inspelat med något så enkelt som en telefonmikrofon eller en digitalt stetoskop, för att avgöra om de har astma eller en annan lungsjukdom. Genom att omvandla dessa ljud till mönster som en dator kan känna igen siktar forskarna på att bygga ett exakt, prisvärt verktyg som en dag kan stödja fjärrkontroller och mobilhälsoprogram.

Varför andningsljud bär på dolda ledtrådar

Astma påverkar luftvägarna, förtränger dem och gör luftflödet ostadigt. Det ger upphov till karaktäristiska ljud som pip (visslingstoner) och krepitationer (korta knäppande ljud), som läkare traditionellt lyssnar efter med ett stetoskop. Men personer med andra lungsjukdomar — som kronisk obstruktiv lungsjukdom (KOL), bronkit eller lunginflammation — kan producera liknande ljud, vilket gör diagnostik svår även för specialister. Standardtester som spirometri kräver klinikbesök, utbildad personal och specialutrustning, och de kan missa hela variationen av astmatyper. Författarna menar att noggrann analys av inspelade andningsljud skulle kunna fånga dessa subtila skillnader på ett mer praktiskt sätt och hjälpa till att skilja mellan flera lungsjukdomar liksom normal andning.

Bygga en smart lyssnare för lungljud

Teamet designade ett "smart lyssnarsystem" som börjar med verkliga inspelningar från en offentlig Kaggle‑datamängd kallad Asthma Detection Dataset v2. Dessa är korta klipp av hosta och andning insamlade med vanliga mobiltelefoner i vardagliga miljöer, märkta som astma, KOL, lunginflammation, bronkit eller frisk. Eftersom inspelningarna varierar i längd och kvalitet rengör forskarna först materialet: de standardiserar volymen, tar bort långa tystnader, filtrerar bort mycket låga och mycket höga frekvenser och delar upp ljudet i fasta sexsekundersbitar som är tillräckligt långa för att fånga hela andetagscykler. De skapar också realistiska variationer — något snabbare eller långsammare uppspelning, tonhöjdsförskjutning och tillägg av mild bakgrundsbrus — för att lära systemet att hantera röriga, verkliga förhållanden i stället för enbart prydliga laboratorieinspelningar.

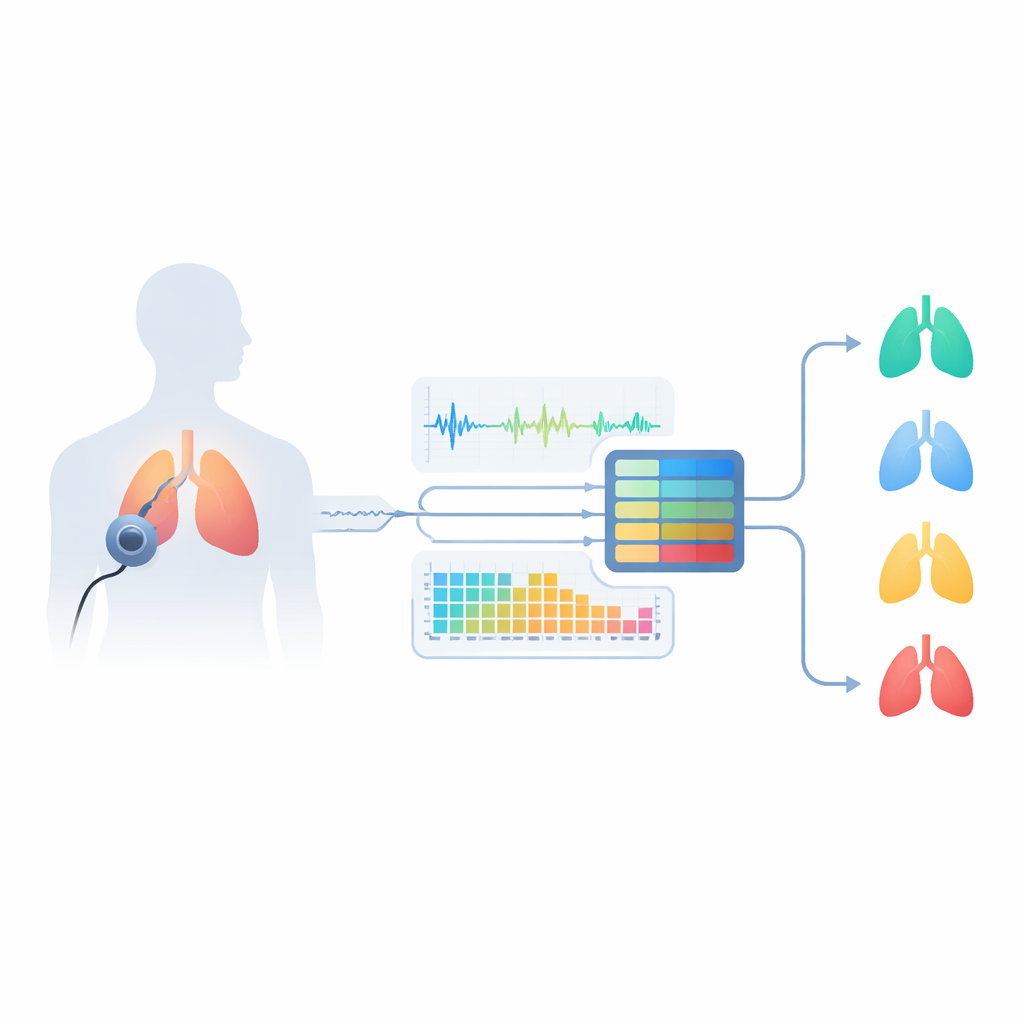

Kombinera mänskligt tolkbara och djupa mönster

I systemets kärna finns en hybridmetod som lyssnar på två sätt samtidigt. En gren extraherar klassiska ljudbeskrivare som ljudtekniker och kliniker förstår, såsom hur energi fördelas över tonhöjder, hur snabbt signalen korsar nollnivån och hur ljudenergin stiger och faller över tid. Dessa mått är kända för att framhäva pip och krepitationer. Den andra grenen matar samma ljud in i YAMNet, en kompakt djupinlärningsmodell ursprungligen tränad av Google på en stor variation av vardagsljud. YAMNet omvandlar varje sekund av andning till ett rikt numeriskt "fingeravtryck" som fångar mönster för komplexa för att beskrivas manuellt. Forskarna fusionerar sedan dessa två perspektiv av ljudet och skickar den kombinerade informationen genom ytterligare moduler som zoomar in på mönster i flera skalor och automatiskt betonar de mest informativa kanalerna innan en slutgiltig klassificerare gör diagnosen.

Testa noggrannheten och göra svart låda mer genomskinlig

För att se hur väl deras system fungerar använde författarna en noggrann teststrategi kallad stratifierad femfaldig korsvalidering, vilket säkerställer att varje lungsjukdom är rättvist representerad i tränings‑ och testfaserna. Modellen nådde cirka 98,6 % noggrannhet och liknande höga F1‑värde och area under kurvan, vilket tydligt överträffade flera starka alternativ, inklusive konventionella maskininlärningsmodeller, standardkonvolutionsnätverk på spektrogrambilder och en enklare version som endast använde YAMNet. Viktigt är att teamet inte nöjde sig med rubriknummer. De använde visualiseringsverktyg för att visa hur olika tillstånd ger upphov till distinkta vågformer och spektrogrammönster, och tillämpade SHAP, en metod lånad från spelteori, för att belysa vilka egenskaper och dolda enheter i nätverket som starkast påverkar varje prediktion. Dessa analyser visade att modellen fokuserar på kliniskt meningsfulla tecken såsom ihållande högfrekventa band och plötsliga utbrott som korrelerar med pip och krepitationer.

Vad detta kan innebära för vardaglig vård

Enkelt uttryckt visar studien att ett noggrant byggt djupinlärningssystem kan "lyssna" på andning med nästan expertnivå i noggrannhet, även när inspelningarna görs på vanliga enheter i bullriga miljöer. Genom att blanda förståeliga ljudfunktioner med kraftfulla inlärda representationer, och genom att förklara sina beslut via visuella kartor och funktionsviktsskalor, kommer systemet närmare en pålitlig digital assistent snarare än en mystisk svart låda. Även om det fortfarande behöver testas på fler och större datamängder och valideras i klinisk praxis, pekar detta tillvägagångssätt mot framtida verktyg som kan köras på telefoner eller lättviktig hårdvara och hjälpa läkare och patienter att övervaka astma och relaterade lungsjukdomar snabbt, icke‑invasivt och kostnadseffektivt.

Citering: Shatat, G.A.EL., Moustafa, H.ED., Saraya, M.S. et al. Hybrid deep learning and YAMNet features for asthma diagnosis from respiratory sounds. Sci Rep 16, 13781 (2026). https://doi.org/10.1038/s41598-026-49247-y

Nyckelord: astmadiagnos, andningsljud, djupinlärning, mobil hälsa, medicinsk audiosanalys