Clear Sky Science · de

Hybride Deep‑Learning‑ und YAMNet‑Merkmale für die Asthmadiagnose aus Atemgeräuschen

Atmen lauschen statt in ein Rohr zu blasen

Für Millionen von Menschen mit Asthma bedeutet eine klare Diagnose oft einen Besuch in der Klinik und Lungenfunktionstests, die ermüdend, zeitaufwändig und schwer regelmäßig zu wiederholen sein können. Diese Studie untersucht eine ganz andere Idee: die Verwendung der Geräusche beim Atmen und Husten, aufgezeichnet mit so einfachen Geräten wie einem Telefonmikrofon oder einem digitalen Stethoskop, um festzustellen, ob jemand Asthma oder eine andere Lungenerkrankung hat. Indem diese Geräusche in Muster verwandelt werden, die ein Computer erkennen kann, wollen die Forschenden ein genaues, erschwingliches Werkzeug entwickeln, das eines Tages ferngestützte Kontrollen und mobile Gesundheits‑Apps unterstützen könnte.

Warum Atemgeräusche versteckte Hinweise tragen

Asthma betrifft die Atemwege, verengt sie und macht den Luftstrom unregelmäßig. Das erzeugt charakteristische Geräusche wie Pfeif‑ und Trillerlaute (Wheezes) und Knister‑ oder Knackgeräusche (Crackles), die Ärztinnen und Ärzte traditionell mit einem Stethoskop hören. Allerdings können auch Menschen mit anderen Lungenerkrankungen – etwa chronisch obstruktiver Lungenerkrankung (COPD), Bronchitis oder Pneumonie – ähnliche Geräusche erzeugen, was die Diagnose selbst für Fachleute schwierig macht. Standardtests wie die Spirometrie erfordern Klinikbesuche, geschultes Personal und spezielle Geräte und erfassen möglicherweise nicht die gesamte Vielfalt der Asthmatypen. Die Autorinnen und Autoren argumentieren, dass die sorgfältige Analyse aufgezeichneter Atemgeräusche diese feinen Unterschiede bequemer erfassen und helfen könnte, mehrere Lungenerkrankungen sowie gesundes Atmen zu unterscheiden.

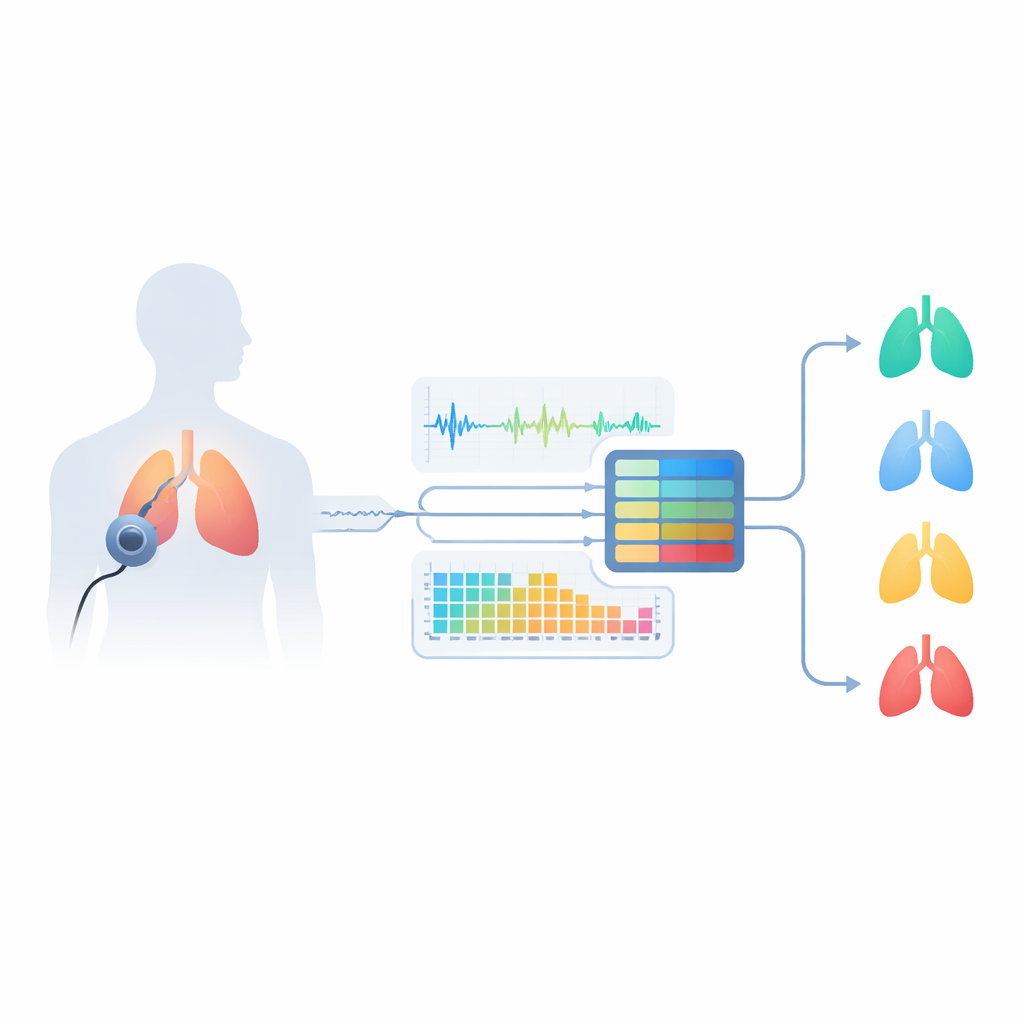

Ein intelligenter Zuhörer für Lungengeräusche

Das Team entwickelte ein „intelligentes Zuhörsystem“, das mit realen Aufnahmen aus einem öffentlichen Kaggle‑Datensatz namens Asthma Detection Dataset v2 beginnt. Dabei handelt es sich um kurze Clips von Husten und Atmung, die mit normalen Mobiltelefonen in Alltagsumgebungen gesammelt und als Asthma, COPD, Pneumonie, Bronchitis oder gesund gekennzeichnet sind. Da die Aufnahmen in Länge und Qualität variieren, bereinigen die Forschenden sie zunächst: Sie standardisieren die Lautstärke, entfernen lange Stillepassagen, filtern sehr tiefe und sehr hohe Frequenzen und schneiden das Audio in feste sechssekündige Abschnitte, die lang genug sind, um vollständige Atemzyklen zu erfassen. Außerdem erzeugen sie realistische Variationen – leichtes Beschleunigen oder Verlangsamen der Aufnahme, Verschiebung der Tonhöhe und Hinzufügen sanfter Hintergrundgeräusche – damit das System lernt, mit unordentlichen Real‑World‑Bedingungen zurechtzukommen statt nur mit makellosen Laboraufnahmen.

Kombination aus menschlich lesbaren und tiefen Mustern

Kern des Systems ist ein hybrider Ansatz, der gleichzeitig auf zwei Arten „zuhört“. Ein Zweig extrahiert klassische Audiodeskriptoren, die Audioingenieure und Kliniker verstehen, etwa wie Energie über Tonhöhen verteilt ist, wie oft das Signal die Nulllinie kreuzt und wie die Schallenergie im Zeitverlauf an- und abnimmt. Diese Maße heben bekanntermaßen Wheezes und Crackles hervor. Der zweite Zweig speist dasselbe Audio in YAMNet, ein kompaktes Deep‑Learning‑Modell, das Google ursprünglich auf einer großen Vielfalt alltäglicher Geräusche trainiert hat. YAMNet verwandelt jede Sekunde Atmung in einen reichhaltigen numerischen „Fingerabdruck“, der Muster erfasst, die zu komplex sind, um sie manuell zu beschreiben. Die Forschenden verschmelzen dann diese beiden Klangperspektiven und leiten die kombinierten Informationen durch zusätzliche Module, die Muster in mehreren Skalen fokussieren und automatisch die informativsten Kanäle hervorheben, bevor ein finaler Klassifikator die Diagnose stellt.

Genauigkeit testen und die Black Box durchsichtig machen

Um die Leistungsfähigkeit ihres Systems zu prüfen, verwendeten die Autorinnen und Autoren eine sorgfältige Teststrategie, die so genannte stratifizierte Fünf‑Fach‑Kreuzvalidierung, um sicherzustellen, dass jede Lungenerkrankung in Trainings‑ und Testphasen fair vertreten ist. Das Modell erreichte etwa 98,6 % Genauigkeit sowie ähnlich hohe F1‑Werte und Flächen unter der Kurve und übertraf damit deutlich mehrere starke Alternativen, einschließlich konventioneller Machine‑Learning‑Modelle, standardmäßiger Faltungsnetzwerke auf Spektrogramm‑Bildern und einer einfacheren Version, die nur YAMNet verwendet. Wichtig ist, dass das Team nicht bei Schlagzahlen stehenblieb. Sie nutzten Visualisierungstools, um zu zeigen, wie verschiedene Erkrankungen unterschiedliche Wellenformen und Spektrogramm‑Muster erzeugen, und setzten SHAP ein, eine aus der Spieltheorie entlehnte Methode, um hervorzuheben, welche Merkmale und verborgenen Einheiten im Netzwerk jede Vorhersage am stärksten beeinflussen. Diese Analysen zeigten, dass das Modell sich auf klinisch sinnvolle Hinweise konzentriert, wie anhaltende hochfrequente Bänder und plötzliche Ausbrüche, die Wheezes und Crackles entsprechen.

Was das für die alltägliche Versorgung bedeuten könnte

Einfach ausgedrückt zeigt die Studie, dass ein sorgfältig aufgebautes Deep‑Learning‑System Atemgeräusche mit annähernd fachärztlicher Genauigkeit „hören“ kann, selbst wenn Aufnahmen mit gewöhnlichen Geräten in lauten Umgebungen gemacht wurden. Durch die Verbindung verständlicher Audio‑Merkmale mit leistungsfähigen gelernten Repräsentationen und durch die Erklärung seiner Entscheidungen mittels visueller Karten und Merkmals‑Wichtigkeitswerte rückt das System näher an einen vertrauenswürdigen digitalen Assistenten statt an eine rätselhafte Black Box. Obwohl es noch an größeren und vielfältigeren Datensätzen getestet und in der klinischen Praxis validiert werden muss, weist dieser Ansatz auf zukünftige Werkzeuge hin, die auf Telefonen oder leichtgewichtiger Hardware laufen und Ärztinnen, Ärzten und Patienten helfen könnten, Asthma und verwandte Lungenerkrankungen schnell, nichtinvasiv und kostengünstig zu überwachen.

Zitation: Shatat, G.A.EL., Moustafa, H.ED., Saraya, M.S. et al. Hybrid deep learning and YAMNet features for asthma diagnosis from respiratory sounds. Sci Rep 16, 13781 (2026). https://doi.org/10.1038/s41598-026-49247-y

Schlüsselwörter: Asthmadiagnose, Atemgeräusche, Deep Learning, mobile Gesundheit, medizinische Audiowertung