Clear Sky Science · sv

Projektion-kärnregularisering för diffusionsbaserad multimodal fjärranalyssegmentering

Skarpare kartor från ovan

Moderna städer bevakas uppifrån av flottor av flygplan och satelliter som fångar inte bara färgrika fotografier utan också 3D-höjdinformation. Att omvandla denna rikedom av data till precisa kartor över byggnader, vägar, träd och bilar är avgörande för planering, katastrofinsatser och miljöövervakning. Denna artikel presenterar ett nytt sätt att föra samman dessa olika vyer och att rensa upp i brusiga förutsägelser, vilket ger skarpare och mer pålitliga marktäcktkartor från flygbilder.

Varför det är svårt att blanda vyer från skyn

System för flygburen kartläggning kombinerar ofta två huvudsakliga typer av indata: sanna ortofoton, som ser ut som detaljerade färgbilder av markytan, och digitala ytmodeller, som registrerar höjden för varje punkt. Foton är rika på textur och färg men kan förvrängas av skuggor och perspektiv. Höjdkartor fångar byggnaders former och trädkrontor men kan vara brusiga eller grova. Traditionella djupinlärningsmetoder staplar ofta dessa indata eller fusionerar dem på enkla sätt. Som en följd kan de missanpassa geometri och textur, sudda ut gränser mellan objekt och missa små föremål som bilar, särskilt i täta stadsmiljöer.

Från brusiga gissningar till förfinade scener

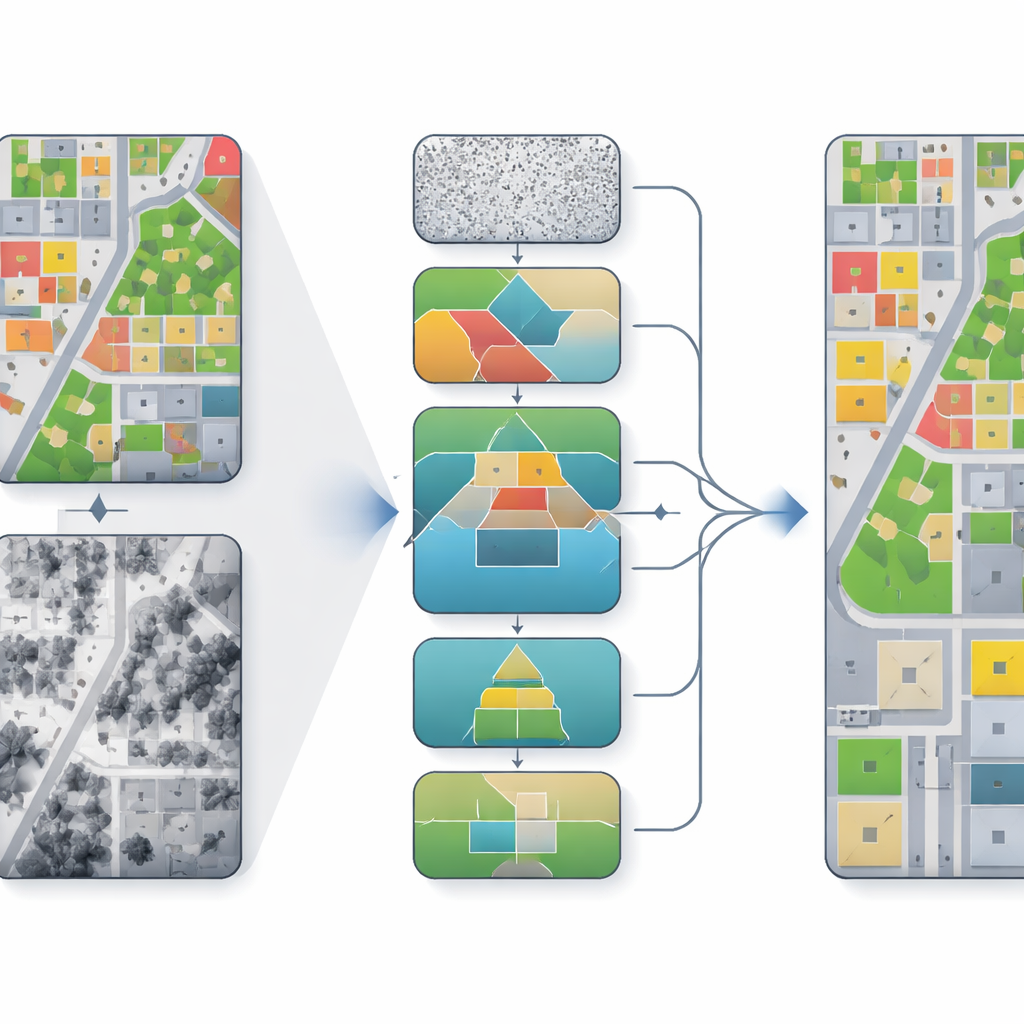

Författarna bygger vidare på diffusionsmodeller, en familj algoritmer som börjar från brusiga förutsägelser och upprepade gånger förfinar dem mot ett renare resultat. Istället för att betrakta segmentering som ett engångsbeslut tar modellen många små steg och förbättrar gradvis kartan över vilken pixel som tillhör vilken klass. I deras ramverk, kallat PKDiff, styrs denna förfining av två nyckelidéer: ett smartare sätt att slå ihop foto- och höjdinformation, och ett nytt sätt att säkerställa att den övergripande mönstringen av förutsägelser stämmer överens med vad som förväntas över en hel bild, inte bara pixel för pixel.

Få bilder och höjder att samarbeta bättre

För att bättre kombinera styrkorna i foto- och höjddatat använder modellen en modul för Cross-Attention Dual-Encoder Fusion. Den ena grenen fokuserar på färg och textur, den andra på höjd och struktur. På grova skalor styr höjdinformation modellen mot rätt övergripande layout—var byggnader, vägar och parker bör ligga. På finare skalor hjälper höjdskillnader längs kanter till att skärpa gränser, till exempel vid taklinjer eller mellan träd och gräs. En separat avbrusningskomponent, kallad Hierarchical EMA-Gated Recursive Denoising, för information över skalor och tidsteg och avgör hur mycket nya förfiningar ska litas på jämfört med tidigare uppskattningar. Detta minskar risken att tidiga misstag fortsätter att förstärkas när modellen itererar.

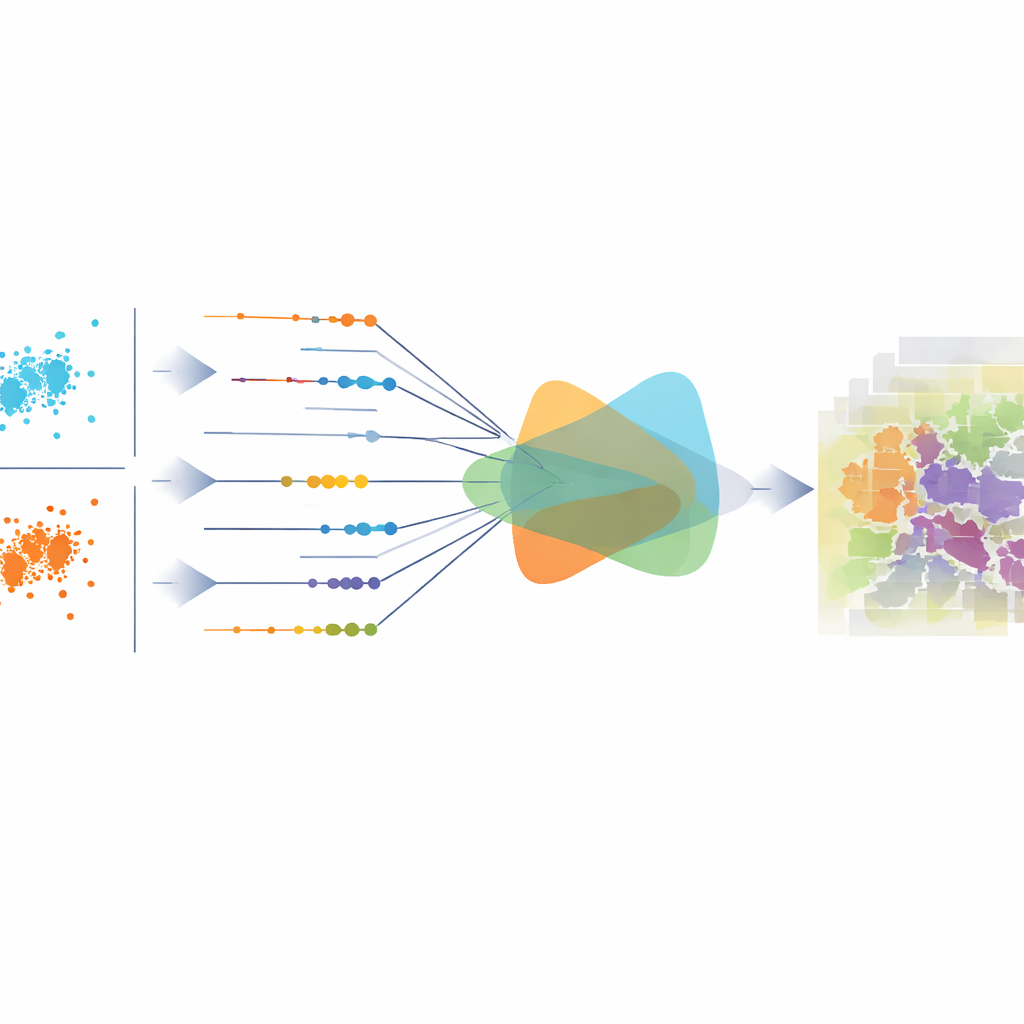

Justera helhetsbilden, inte bara individuella pixlar

De flesta befintliga metoder tränas med förluster som ser på varje pixel för sig, såsom korsentropi eller medelkvadratfel. Dessa kan förbättra lokal noggrannhet men kan fortfarande producera förutsägelser som är statistiskt ur balans över hela bilden—till exempel att överskatta vägytor eller underskatta vegetation. Arbetets centrala bidrag är en projektion-kärnregulariserare som mäter hur väl den övergripande fördelningen av förutspådda klasser matchar den verkliga. Det görs genom att betrakta varje pixels klasssannolikheter som en punkt i ett högdimensionellt rum, projicera dessa punkter på många endimensionella riktningar och jämföra hur de två uppsättningarna projektioner skiljer sig. Istället för att provta dessa riktningar slumpmässigt härleder författarna en elegant sluten formel som effektivt aggregerar skillnader över alla riktningar, vilket gör måttet både stabilt och känsligt för subtila förskjutningar.

Bättre gränser och mer konsekventa kartor

Författarna testar sin metod på två välkända urbana benchmarks från de tyska orterna Vaihingen och Potsdam, vilka innehåller mycket högupplösta bilder och höjdkartor tillsammans med mark-sanna etiketter för markytor, byggnader, vegetation, träd, bilar och skräp. I flera standardmått för noggrannhet överträffar PKDiff en rad starka konvolutionella, transformerbaserade och andra diffusionsbaserade modeller. Vinsterna är särskilt tydliga för kategorier där geometri spelar störst roll, såsom byggnader, låg vegetation och små bilar: gränser är skarpare, objekt mindre fragmenterade och stora regioner som vägar får mer konsekventa etiketter. Enkelt uttryckt ger det föreslagna tillvägagångssättet, genom att omsorgsfullt förena textur och höjd samtidigt som det säkerställer att förutsägelserna "ser rätt ut" i aggregat, renare och mer tillförlitliga kartor från komplexa flyguppgifter.

Citering: Tong, X., Yang, F., Yang, Q. et al. Projection Kernel regularization for diffusion-based multimodal remote sensing segmentation. Sci Rep 16, 14385 (2026). https://doi.org/10.1038/s41598-026-44603-4

Nyckelord: segmentering av fjärranalys, multimodal fusion, diffusionsmodeller, stadskartläggning, flygbilder