Clear Sky Science · fr

Régularisation par noyau de projection pour la segmentation multimodale par diffusion en télédétection

Des cartes plus nettes vues du ciel

Les villes modernes sont observées depuis le ciel par des flottes d'avions et de satellites, qui capturent non seulement des photos en couleur mais aussi des informations 3D sur l'altitude. Transformer cet ensemble riche de données en cartes précises des bâtiments, routes, arbres et voitures est crucial pour l'aménagement, la gestion des catastrophes et le suivi environnemental. Cet article présente une nouvelle manière de fusionner ces vues différentes et d'épurer des prédictions bruyantes, produisant des cartes d'occupation du sol plus nettes et plus fiables à partir d'images aériennes.

Pourquoi il est difficile de mêler ces vues aériennes

Les systèmes de cartographie aérienne combinent souvent deux types d'entrées principaux : des orthophotos véritables, qui ressemblent à des images couleurs détaillées du sol, et des modèles numériques de surface (MNS), qui enregistrent l'altitude de chaque point. Les photos regorgent de texture et de couleur mais peuvent être déformées par les ombres et la perspective. Les cartes d'altitude saisissent la géométrie des bâtiments et des canopées d'arbres mais peuvent être bruyantes ou de résolution grossière. Les méthodes d'apprentissage profond traditionnelles empilent ces entrées ou les fusionnent de façons simples. En conséquence, elles peuvent désaligner géométrie et texture, estomper les contours entre objets et manquer de petits éléments comme les voitures, surtout dans des scènes urbaines denses.

De devinettes bruyantes à des scènes raffinées

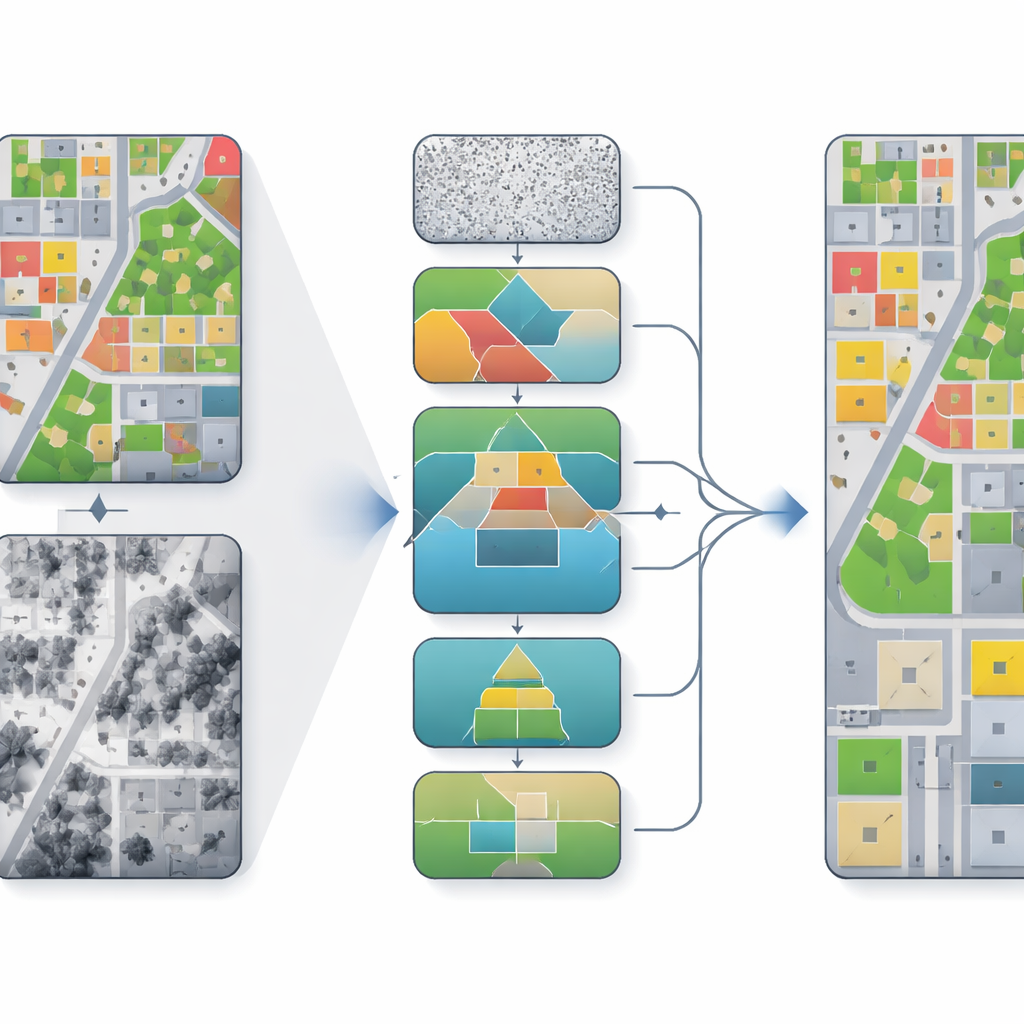

Les auteurs s'appuient sur les modèles de diffusion, une famille d'algorithmes qui partent de prédictions bruitées et les affinent itérativement vers un résultat plus propre. Plutôt que de traiter la segmentation comme une décision en une seule étape, le modèle effectue de nombreux petits pas, améliorant progressivement la carte d'appartenance de chaque pixel à une classe. Dans leur cadre, nommé PKDiff, ce raffinement est guidé par deux idées clés : une façon plus intelligente de fusionner l'information photo et altitude, et une nouvelle manière de s'assurer que le schéma global des prédictions correspond à ce qui est attendu sur l'image entière, pas seulement pixel par pixel.

Faire coopérer images et altitudes

Pour mieux combiner les forces des données photo et altitude, le modèle utilise un module de fusion à double encodeur avec attention croisée. Une branche se concentre sur la couleur et la texture, l'autre sur l'altitude et la structure. À des échelles grossières, l'information d'altitude oriente le modèle vers la bonne organisation globale — où doivent se situer bâtiments, routes et parcs. À des échelles plus fines, les différences d'altitude le long des bords aident à affiner les contours, par exemple aux lignes de toiture ou entre arbres et gazon. Un composant de débruitage séparé, appelé débruitage récursif hiérarchique avec porte EMA, transmet l'information à travers les échelles et les pas temporels, décidant combien faire confiance aux nouvelles améliorations par rapport aux estimations précédentes. Cela réduit le risque que des erreurs initiales soient amplifiées au fil des itérations.

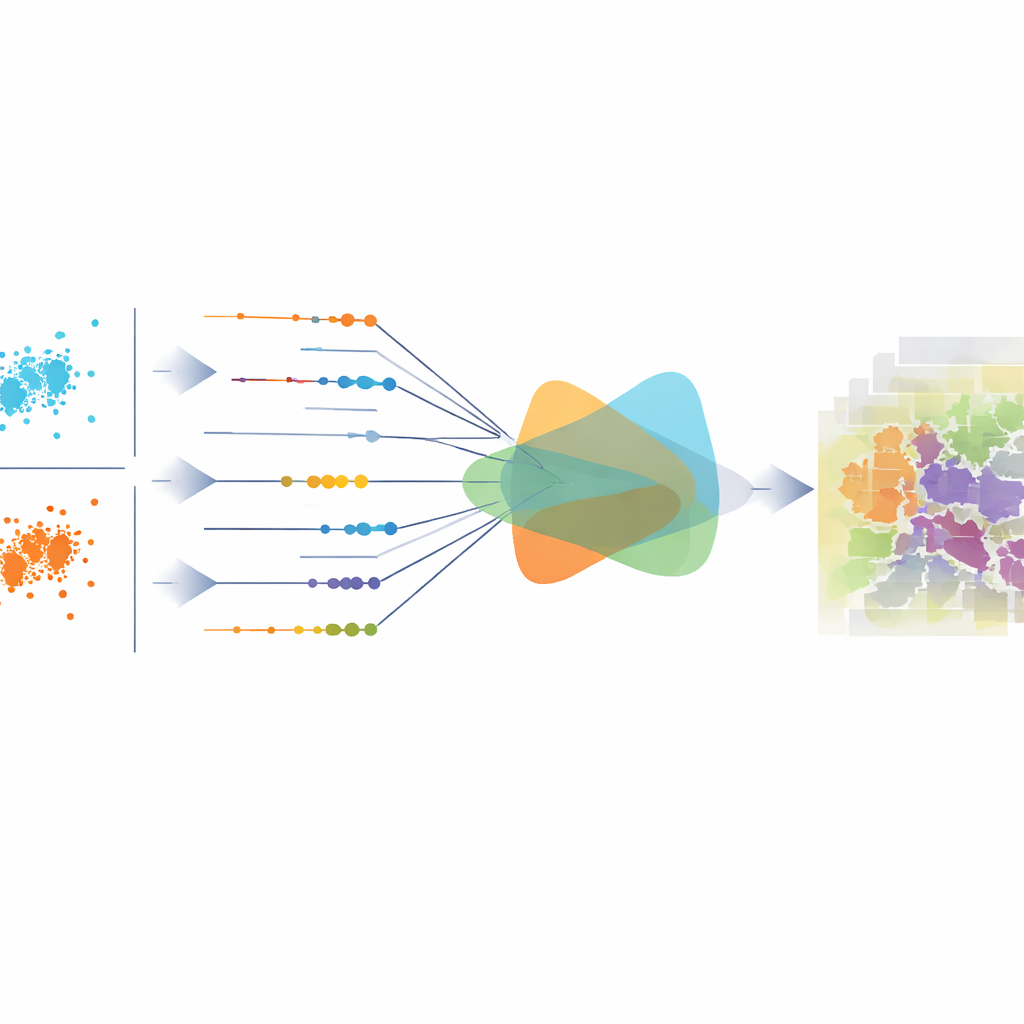

Aligner la vue d'ensemble, pas seulement les pixels individuels

La plupart des méthodes existantes entraînent leurs modèles avec des pertes qui considèrent chaque pixel indépendamment, comme l'entropie croisée ou l'erreur quadratique moyenne. Celles-ci peuvent améliorer la précision locale mais produire des prédictions déséquilibrées au niveau de l'image entière — par exemple en surestimant les routes ou en sous-estimant la végétation. La contribution centrale de ce travail est un régularisateur par noyau de projection qui mesure à quel point la distribution globale des classes prédites correspond à la distribution réelle. Il traite les probabilités de classe de chaque pixel comme un point dans un espace de haute dimension, projette ces points sur de nombreuses directions unidimensionnelles, puis compare comment les deux ensembles de projections diffèrent. Plutôt que d'échantillonner ces directions au hasard, les auteurs dérivent une formule compacte en forme fermée qui agrège efficacement les différences sur toutes les directions, rendant la mesure à la fois stable et sensible aux décalages subtils.

Des contours plus nets et des cartes plus cohérentes

Les auteurs évaluent leur méthode sur deux jeux de référence urbains bien connus des villes allemandes de Vaihingen et Potsdam, qui comprennent des images et des cartes d'altitude à très haute résolution ainsi que des labels de vérité terrain pour les surfaces, bâtiments, végétation basse, arbres, voitures et éléments divers. Sur plusieurs mesures standards de précision, PKDiff surpasse une gamme de modèles convolutionnels, basés sur Transformers et d'autres modèles de diffusion. Les gains sont particulièrement visibles sur les catégories où la géométrie importe le plus, comme les bâtiments, la végétation basse et les petites voitures : les contours sont plus nets, les objets moins fragmentés, et de grandes régions comme les routes sont étiquetées de manière plus cohérente. En termes simples, en fusionnant avec soin texture et altitude tout en imposant que ses prédictions « aient l'air correctes » globalement, l'approche proposée produit des cartes plus propres et plus fiables à partir de données aériennes complexes.

Citation: Tong, X., Yang, F., Yang, Q. et al. Projection Kernel regularization for diffusion-based multimodal remote sensing segmentation. Sci Rep 16, 14385 (2026). https://doi.org/10.1038/s41598-026-44603-4

Mots-clés: segmentation en télédétection, fusion multimodale, modèles de diffusion, cartographie urbaine, imagerie aérienne