Clear Sky Science · pt

Regularização do Kernel de Projeção para segmentação multimodal por difusão em sensoriamento remoto

Mapas mais nítidos visto de cima

Cidades modernas são observadas de cima por frotas de aviões e satélites, que capturam não apenas fotos coloridas, mas também informações 3D de elevação. Converter essa riqueza de dados em mapas precisos de edifícios, ruas, árvores e carros é vital para planejamento, resposta a desastres e monitoramento ambiental. Este artigo apresenta uma nova forma de fundir essas diferentes visões e de limpar previsões ruidosas, produzindo mapas de cobertura do solo mais nítidos e confiáveis a partir de imagens aéreas.

Por que misturar visões do céu é difícil

Sistemas de mapeamento aéreo costumam combinar dois tipos principais de entradas: ortofotos verdadeiras, que se parecem com imagens detalhadas do solo, e modelos digitais de superfície, que registram a altura de cada ponto. Fotos são ricas em textura e cor, mas podem ser distorcidas por sombras e perspectiva. Mapas de altura capturam formas de edifícios e copas de árvores, mas podem ser ruidosos ou de baixa resolução. Métodos tradicionais de aprendizado profundo ou empilham essas entradas juntas ou as fundem de maneiras simples. Como resultado, podem desalinha r geometria e textura, borrar os contornos entre objetos e deixar de detectar pequenas feições como carros, especialmente em cenas urbanas densas.

De palpites ruidosos a cenas refinadas

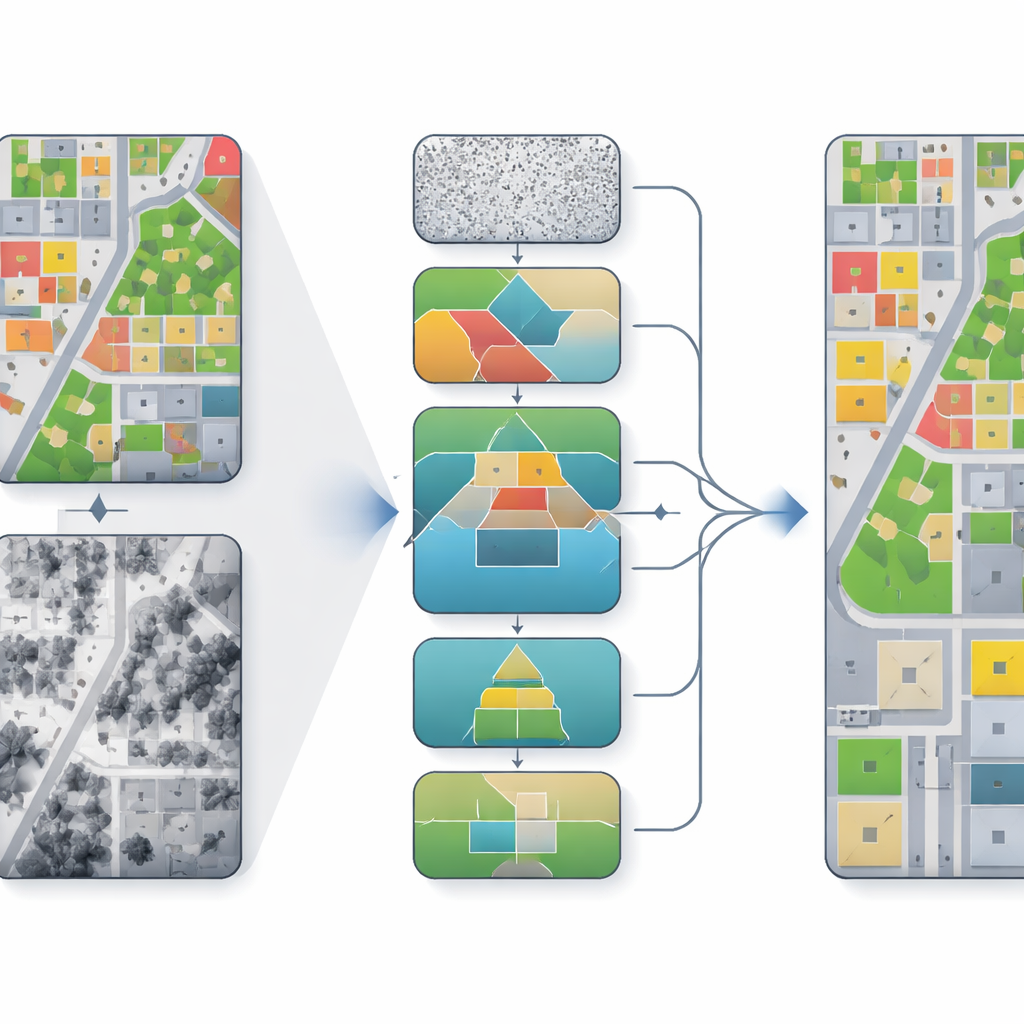

Os autores partem de modelos de difusão, uma família de algoritmos que começam com previsões ruidosas e as refinam repetidamente rumo a um resultado mais limpo. Em vez de tratar a segmentação como uma decisão única, o modelo dá muitos pequenos passos, melhorando gradualmente o mapa de qual pixel pertence a qual classe. No arcabouço proposto, chamado PKDiff, esse refinamento é guiado por duas ideias-chave: uma forma mais inteligente de fundir informação foto e altura, e um novo modo de garantir que o padrão global de predições corresponda ao esperado em toda a imagem, não apenas pixel a pixel.

Fazendo imagens e alturas funcionarem em conjunto

Para combinar melhor as forças dos dados de foto e altura, o modelo usa um módulo de Fusão com Codificadores Duplos e Cross-Attention. Um ramo foca em cor e textura, o outro em altura e estrutura. Em escalas grosseiras, a informação de altura guia o modelo para o layout geral correto — onde devem ficar edifícios, ruas e parques. Em escalas finas, diferenças de altura ao longo de bordas ajudam a tornar os contornos mais nítidos, por exemplo em beirais de telhado ou entre árvores e gramados. Um componente separado de remoção de ruído, chamado Denoising Recursivo Hierárquico com EMA-Gated, passa informação entre escalas e etapas temporais, decidindo quanto confiar em novos refinamentos versus estimativas anteriores. Isso reduz o risco de que erros iniciais se amplifiquem ao longo das iterações do modelo.

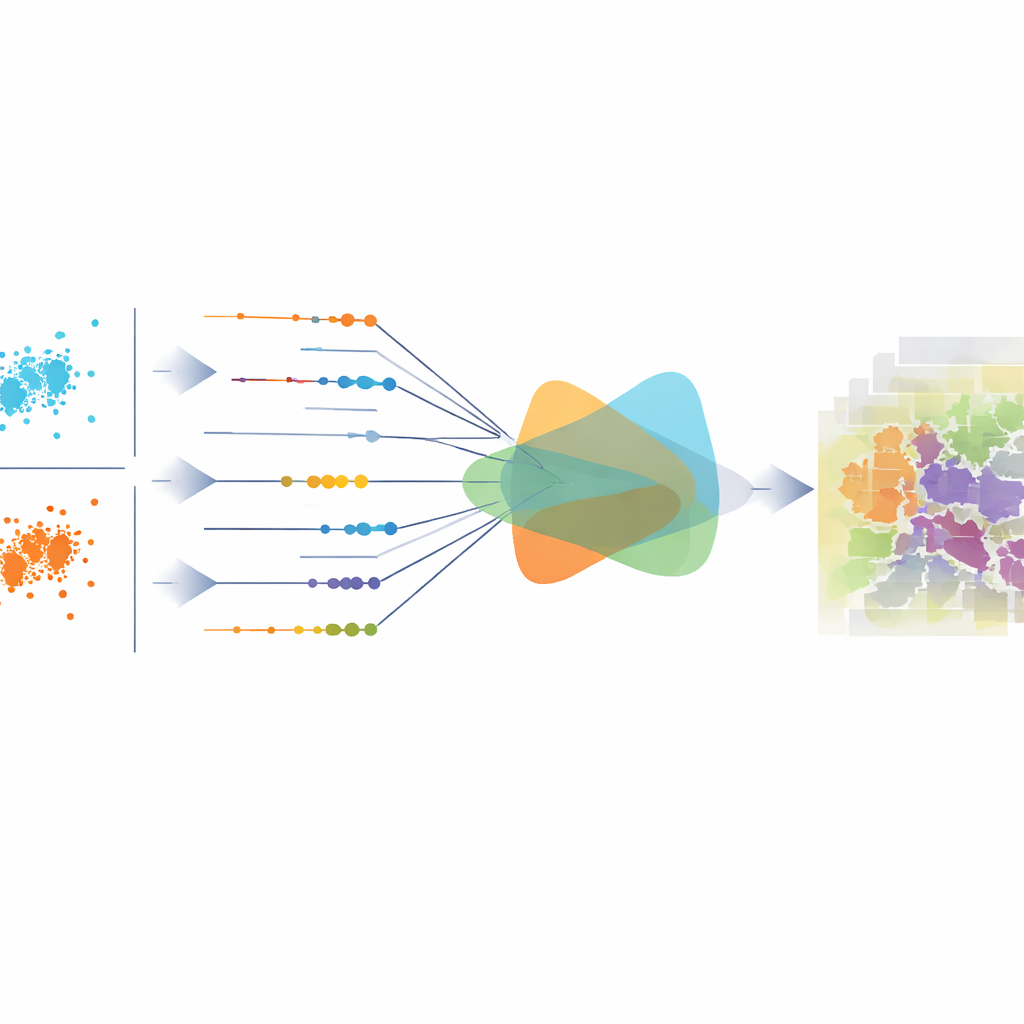

Alinhando o panorama geral, não apenas pixels individuais

A maioria dos métodos existentes treina seus modelos com perdas que analisam cada pixel isoladamente, como entropia cruzada ou erro quadrático médio. Essas perdas podem melhorar a precisão local, mas ainda assim produzir previsões que estejam estatisticamente desequilibradas ao longo da imagem — por exemplo, superestimando ruas ou subestimando vegetação. A contribuição central deste trabalho é um regularizador de kernel de projeção que mede quão bem a distribuição global das classes previstas corresponde à real. Ele faz isso ao considerar as probabilidades de classe de cada pixel como um ponto em um espaço de alta dimensão, projetando esses pontos em muitas direções unidimensionais e comparando como os dois conjuntos de projeções diferem. Em vez de amostrar essas direções aleatoriamente, os autores derivam uma fórmula em forma fechada que agrega eficientemente as diferenças ao longo de todas as direções, tornando a medida tanto estável quanto sensível a deslocamentos sutis.

Contornos melhores e mapas mais consistentes

Os autores testam seu método em dois benchmarks urbanos bem conhecidos das cidades alemãs de Vaihingen e Potsdam, que incluem imagens de altíssima resolução e mapas de altura junto com rótulos de referência para superfícies, edifícios, vegetação, árvores, carros e detritos. Em várias medidas de acurácia padrão, PKDiff supera uma gama de fortes modelos convolucionais, baseados em Transformer e outros modelos baseados em difusão. Os ganhos são especialmente claros em categorias onde a geometria importa mais, como edifícios, vegetação baixa e carros pequenos: os contornos ficam mais nítidos, os objetos menos fragmentados e grandes regiões como ruas são rotuladas de forma mais consistente. Em termos simples, ao fundir cuidadosamente textura e altura e ao mesmo tempo impor que suas predições “pareçam corretas” em conjunto, a abordagem proposta gera mapas mais limpos e confiáveis a partir de dados aéreos complexos.

Citação: Tong, X., Yang, F., Yang, Q. et al. Projection Kernel regularization for diffusion-based multimodal remote sensing segmentation. Sci Rep 16, 14385 (2026). https://doi.org/10.1038/s41598-026-44603-4

Palavras-chave: segmentação em sensoriamento remoto, fusão multimodal, modelos de difusão, mapeamento urbano, imagens aéreas