Clear Sky Science · nl

Projectie-kernelregularisatie voor diffusiegebaseerde multimodale segmentatie van op afstand verkregen beelden

Scherpere kaarten van bovenaf

Moderne steden worden van bovenaf in de gaten gehouden door vloten vliegtuigen en satellieten die niet alleen kleurrijke foto’s vastleggen maar ook driedimensionale hoogteinformatie. Het omzetten van deze overvloed aan gegevens in nauwkeurige kaarten van gebouwen, wegen, bomen en auto’s is essentieel voor planning, hulp bij rampen en milieumonitoring. Dit artikel introduceert een nieuwe manier om deze verschillende gezichtspunten te combineren en ruis in voorspellingen te verminderen, waardoor scherpere en betrouwbaardere grondbedekkingskaarten uit luchtbeelden ontstaan.

Waarom het combineren van luchtbeelden moeilijk is

Luchtkaartsystemen combineren vaak twee hoofdtypen invoer: true orthophoto’s, die eruitzien als gedetailleerde kleurbeelden van het oppervlak, en digitale oppervlaktedimensies (height maps), die vastleggen hoe hoog elk punt is. Foto’s zitten vol textuur en kleur maar kunnen worden verstoord door schaduwen en perspectief. Hoogtemodellen leggen gebouwvormen en boomkruinen vast maar kunnen ruisig of grof zijn. Traditionele deep-learningmethoden stapelen deze inputs of fuseren ze op eenvoudige manieren. Als gevolg daarvan kunnen geometrie en textuur niet goed op elkaar aansluiten, vervagen grenzen tussen objecten en worden kleine objecten zoals auto’s gemist, vooral in dichtbebouwde stedelijke scènes.

Van ruisachtige schattingen naar verfijnde scènes

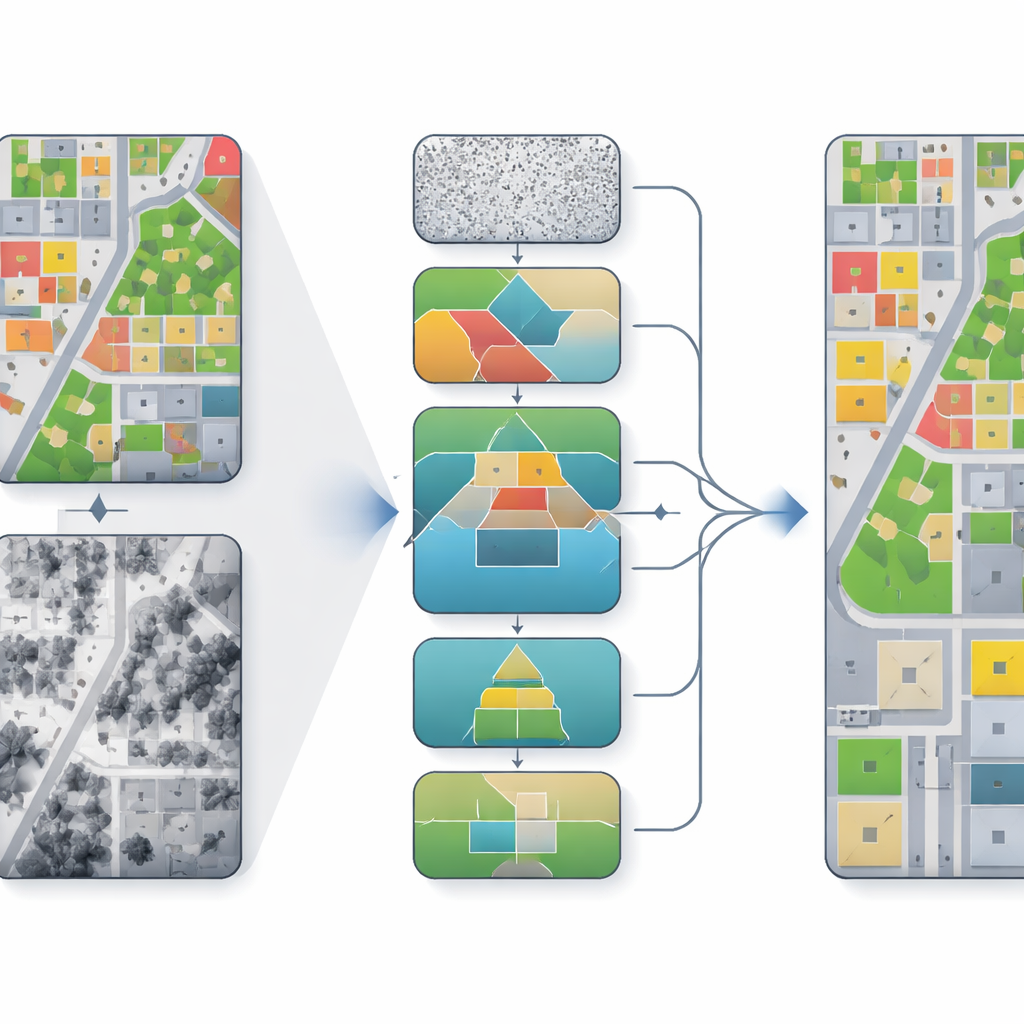

De auteurs bouwen voort op diffusiemodellen, een familie algoritmen die beginnen met ruisachtige voorspellingen en die herhaaldelijk verfijnen naar een schoner resultaat. In plaats van segmentatie als een eenmalige beslissing te behandelen, maakt het model vele kleine stappen en verbetert het geleidelijk de kaart van welke pixel bij welke klasse hoort. In hun raamwerk, PKDiff genoemd, wordt deze verfijning gestuurd door twee kernideeën: een slimmer manier om foto- en hoogteinformatie te fuseren, en een nieuwe manier om te garanderen dat het totale patroon van voorspellingen overeenkomt met wat over een heel beeld verwacht wordt, niet alleen pixel voor pixel.

Helpen dat beelden en hoogtes samenwerken

Om de sterke punten van foto- en hoogtedata beter te combineren, gebruikt het model een Cross-Attention Dual-Encoder Fusion-module. De ene tak richt zich op kleur en textuur, de andere op hoogte en structuur. Op grove schaal stuurt hoogteinformatie het model naar de juiste algemene indeling — waar gebouwen, wegen en parken zouden moeten liggen. Op fijnere schaal helpen hoogteverschillen langs randen om grenzen te verscherpen, bijvoorbeeld bij dakranden of tussen bomen en gras. Een aparte denoisingcomponent, genaamd Hierarchical EMA-Gated Recursive Denoising, draagt informatie over schalen en tijdstappen heen en beslist hoeveel vertrouwen te geven aan nieuwe verfijningen versus eerdere schattingen. Dit vermindert het risico dat vroege fouten steeds verder verergeren terwijl het model iteratief verbetert.

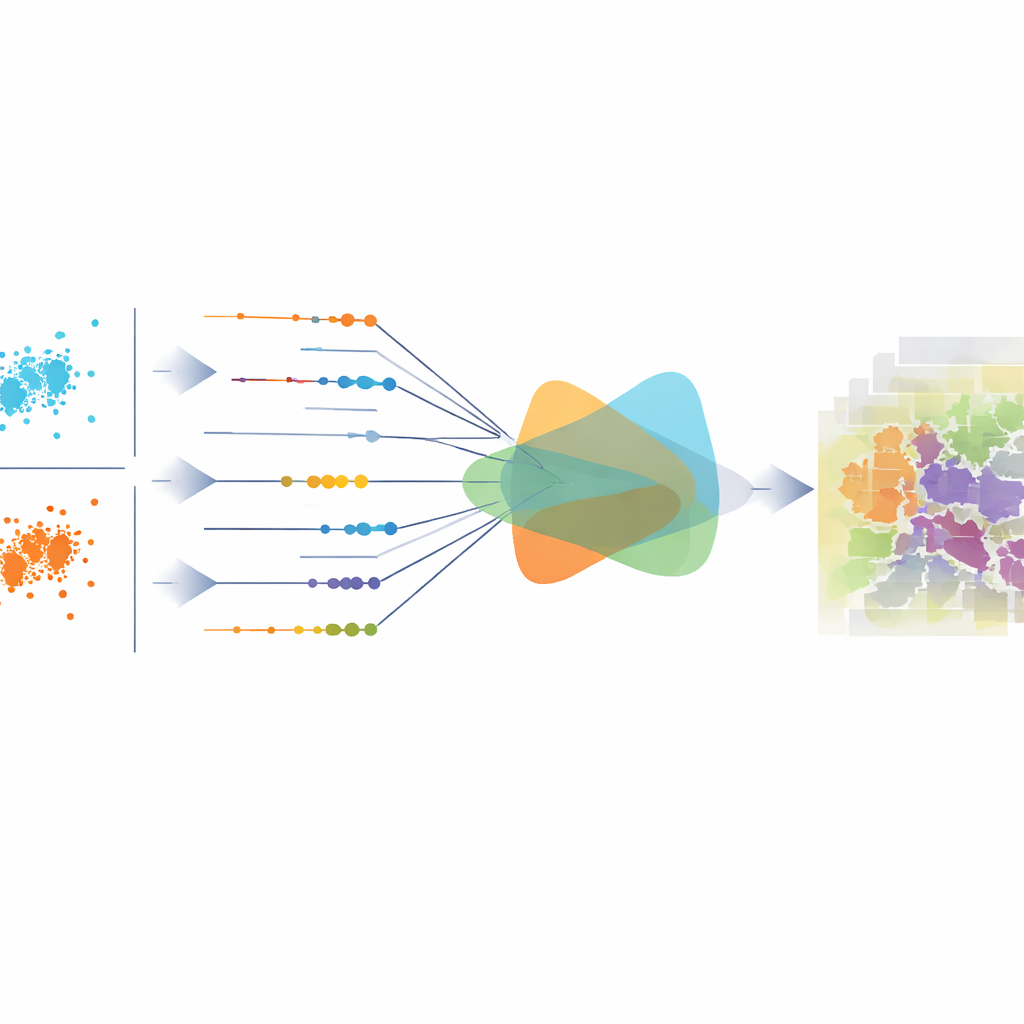

Het grote geheel uitlijnen, niet alleen individuele pixels

De meeste bestaande methoden trainen hun modellen met verliezen die elke pixel afzonderlijk beschouwen, zoals cross-entropy of mean squared error. Deze kunnen de lokale nauwkeurigheid verbeteren maar kunnen toch voorspellingen opleveren die statistisch uit balans zijn over het gehele beeld — bijvoorbeeld het overschatten van wegen of het onderschatten van vegetatie. De centrale bijdrage van dit werk is een projectie-kernelregularisator die meet hoe goed de algehele distributie van voorspelde klassen overeenkomt met de werkelijke. Dit gebeurt door de kansverdelingen per pixel te zien als punten in een hoog-dimensionale ruimte, die punten te projecteren op vele eendimensionale richtingen en te vergelijken hoe de twee sets projecties verschillen. In plaats van deze richtingen willekeurig te bemonsteren, leiden de auteurs een nette gesloten-formule af die efficiënt verschillen over alle richtingen aggregeert, waardoor de maat zowel stabiel als gevoelig voor subtiele verschuivingen wordt.

Beter afgebakende grenzen en meer consistente kaarten

De auteurs testen hun methode op twee bekende stedelijke benchmarks uit de Duitse plaatsen Vaihingen en Potsdam, die zeer hoge resolutiebeelden en hoogtemodellen bevatten samen met grondwaarheidslabels voor oppervlaktes, gebouwen, vegetatie, bomen, auto’s en rommel. Over meerdere gangbare nauwkeurigheidsmaatstaven presteert PKDiff beter dan een reeks sterke convolutionele, Transformer-gebaseerde en andere diffusiemodellen. De verbeteringen zijn vooral duidelijk voor categorieën waar geometrie het meest telt, zoals gebouwen, lage vegetatie en kleine auto’s: grenzen zijn scherper, objecten minder gefragmenteerd en grote gebieden zoals wegen consistenter gelabeld. In eenvoudige termen: door textuur en hoogte zorgvuldig te fuseren en tegelijkertijd af te dwingen dat de voorspellingen in aggregate "juist lijken", levert de voorgestelde aanpak schonere, betrouwbaardere kaarten uit complexe luchtdata.

Bronvermelding: Tong, X., Yang, F., Yang, Q. et al. Projection Kernel regularization for diffusion-based multimodal remote sensing segmentation. Sci Rep 16, 14385 (2026). https://doi.org/10.1038/s41598-026-44603-4

Trefwoorden: segmentatie van op afstand verkregen beelden, multimodale fusie, diffusiemodellen, stedelijke kaartvorming, luchtbeelden