Clear Sky Science · es

Regularización del núcleo de proyección para segmentación multimodal basada en difusión en teledetección

Mapas más nítidos desde las alturas

Las ciudades modernas son observadas desde arriba por flotas de aviones y satélites que capturan no solo fotos a color, sino también información 3D de altura. Convertir esta riqueza de datos en mapas precisos de edificios, carreteras, árboles y vehículos es vital para la planificación, la respuesta a desastres y el monitoreo ambiental. Este artículo presenta una nueva forma de fusionar estas distintas vistas y limpiar predicciones ruidosas, produciendo mapas de cobertura del suelo más nítidos y fiables a partir de imágenes aéreas.

Por qué es difícil mezclar vistas desde el cielo

Los sistemas de cartografía aérea suelen combinar dos tipos principales de entradas: ortofotos verdaderas, que parecen imágenes detalladas a color del terreno, y modelos digitales de superficie, que registran la altura de cada punto. Las fotos ofrecen riqueza de textura y color pero pueden verse distorsionadas por sombras y perspectiva. Los mapas de altura capturan la forma de edificios y copas de árboles, pero pueden ser ruidosos o de baja resolución. Los métodos tradicionales de aprendizaje profundo o bien apilan estas entradas o las fusionan de maneras simples. Como resultado, pueden desalinear geometría y textura, difuminar los contornos entre objetos y pasar por alto pequeñas características como coches, especialmente en escenas urbanas densas.

De conjeturas ruidosas a escenas refinadas

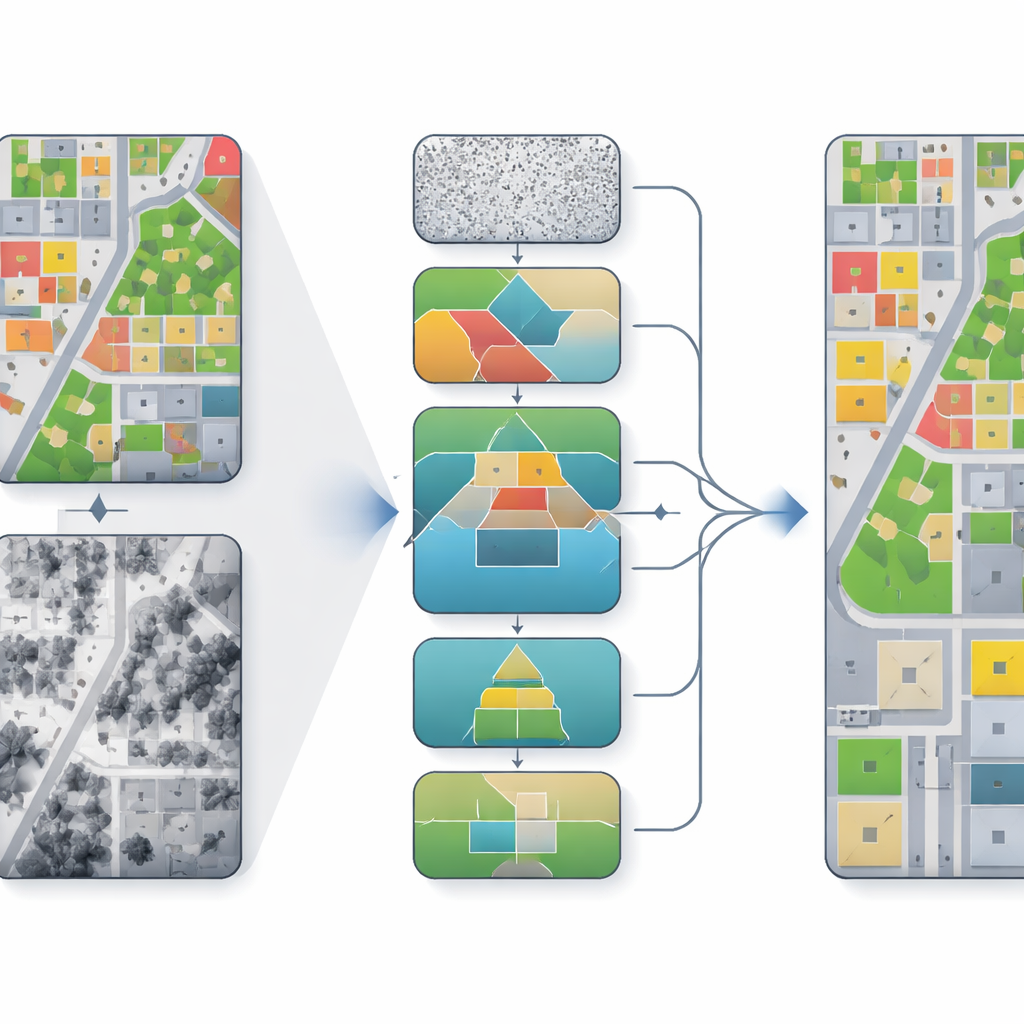

Los autores se basan en modelos de difusión, una familia de algoritmos que parten de predicciones ruidosas y las refinan repetidamente hacia un resultado más limpio. En lugar de tratar la segmentación como una decisión única, el modelo realiza muchos pequeños pasos, mejorando gradualmente el mapa de a qué clase pertenece cada píxel. En su marco, llamado PKDiff, este refinamiento se guía por dos ideas clave: una forma más inteligente de fusionar información de foto y altura, y una nueva manera de asegurar que el patrón global de predicciones coincida con lo esperado en toda la imagen, no solo píxel por píxel.

Hacer que imágenes y alturas funcionen juntas

Para combinar mejor las ventajas de los datos fotográficos y de altura, el modelo utiliza un módulo de fusión con codificadores duales y atención cruzada. Una rama se centra en el color y la textura; la otra, en la altura y la estructura. A escalas gruesas, la información de altura orienta al modelo hacia la disposición general correcta—dónde deberían estar edificios, carreteras y parques. A escalas más finas, las diferencias de altura a lo largo de los bordes ayudan a afinar los contornos, por ejemplo en las líneas de los tejados o entre árboles y césped. Un componente de denoising separado, denominado Denoising Recursivo Jerárquico con EMA y compuertas, transmite información entre escalas y pasos temporales, decidiendo cuánto confiar en las nuevas refinaciones frente a las estimaciones previas. Esto reduce el riesgo de que errores iniciales se amplifiquen a medida que el modelo itera.

Alinear el panorama general, no solo píxeles individuales

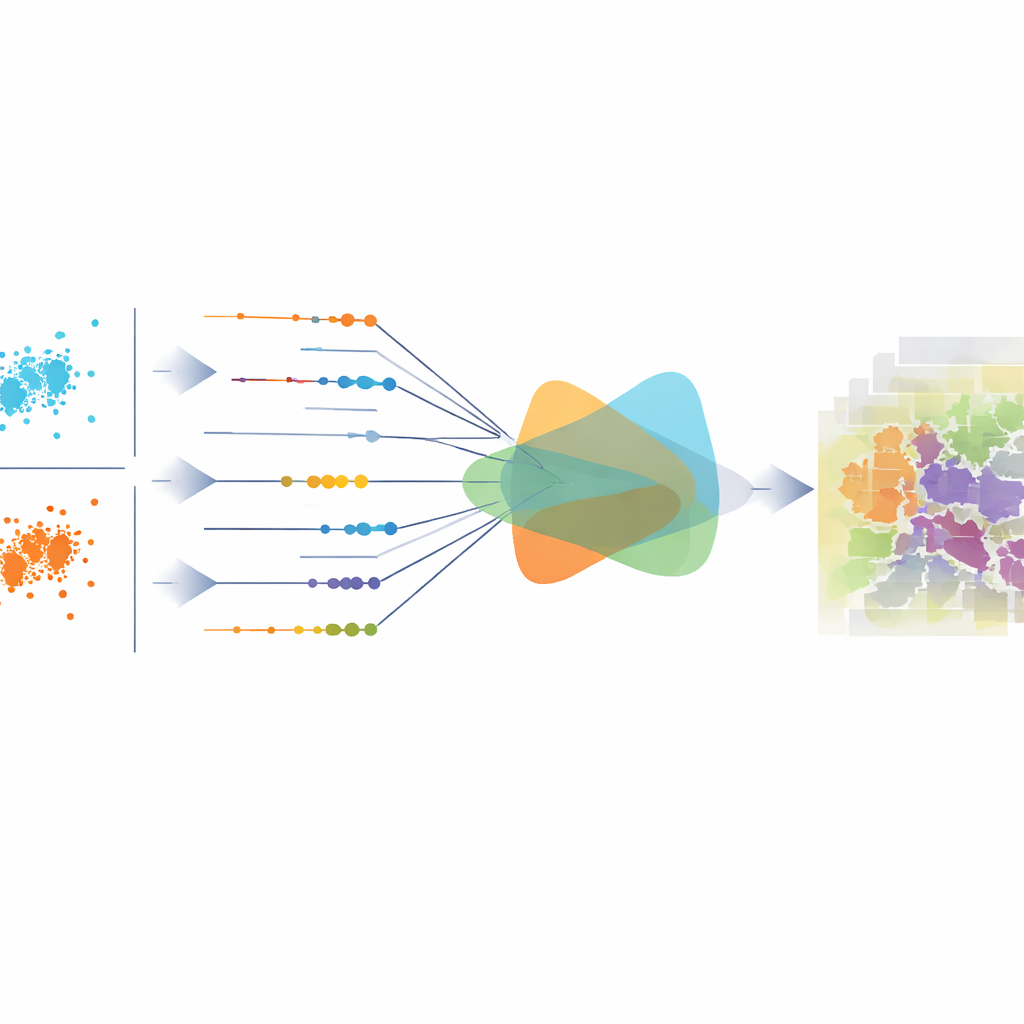

La mayoría de los métodos existentes entrenan sus modelos con pérdidas que consideran cada píxel por separado, como la entropía cruzada o el error cuadrático medio. Estas pueden mejorar la precisión local pero aún producir predicciones que están estadísticamente desajustadas a lo largo de toda la imagen—por ejemplo, sobreestimando carreteras o subestimando vegetación. La contribución central de este trabajo es un regularizador de núcleo de proyección que mide qué tan bien la distribución global de clases predichas se ajusta a la real. Lo hace tratando las probabilidades de clase de cada píxel como un punto en un espacio de alta dimensión, proyectando esos puntos en muchas direcciones unidimensionales y comparando cómo difieren los dos conjuntos de proyecciones. En lugar de muestrear esas direcciones al azar, los autores derivan una fórmula cerrada elegante que agrega eficientemente las diferencias a través de todas las direcciones, haciendo la medida tanto estable como sensible a desplazamientos sutiles.

Contornos más precisos y mapas más coherentes

Los autores evalúan su método en dos conocidos benchmarks urbanos de las localidades alemanas de Vaihingen y Potsdam, que incluyen imágenes y mapas de altura de muy alta resolución junto con etiquetas de referencia para superficies, edificios, vegetación baja, árboles, coches y desorden. En varias medidas de precisión estándar, PKDiff supera a una gama de modelos potentes basados en convoluciones, Transformers y otros modelos basados en difusión. Las mejoras son especialmente evidentes en categorías donde la geometría importa más, como edificios, vegetación baja y coches pequeños: los contornos son más nítidos, los objetos menos fragmentados y regiones grandes como las carreteras se etiquetan de forma más consistente. En términos sencillos, al fusionar cuidadosamente textura y altura y al mismo tiempo forzar que sus predicciones “sean coherentes” en conjunto, el enfoque propuesto produce mapas más limpios y confiables a partir de datos aéreos complejos.

Cita: Tong, X., Yang, F., Yang, Q. et al. Projection Kernel regularization for diffusion-based multimodal remote sensing segmentation. Sci Rep 16, 14385 (2026). https://doi.org/10.1038/s41598-026-44603-4

Palabras clave: segmentación en teledetección, fusión multimodal, modelos de difusión, cartografía urbana, imágenes aéreas