Clear Sky Science · sv

En hybrid ramverk baserad på konvolution och uppmärksamhet med visuell förklaring för identifiering av fruktsjukdomar

Varför smartare fruktkontroller spelar roll

Från bananer till frukost till jordgubbar i smoothies är frukt en daglig basvara — och en viktig inkomstkälla för bönder världen över. Men dolda fläckar, röta och svampinfektioner kan tysta utplåna skördar, förkorta hållbarheten och driva upp priserna. Den här studien undersöker hur ett avancerat men lättviktigt system för artificiell intelligens automatiskt kan upptäcka sjukdomar på vanliga frukter från enkla foton, samtidigt som det visar människor exakt vad det “tittade på” för att fatta varje beslut.

Problemet med sjuka frukter

Fruktodlingar som bananer, druvor, citroner, mangor och jordgubbar är känsliga för en mängd sjukdomar orsakade av svampar, bakterier, virus och näringsbrister. Dessa problem visar sig ofta som små fläckar på blad, missfärgade partier eller röta på fruktytan. Om de upptäcks sent sprider sig infektionerna snabbt över odlingarna, minskar avkastningen och tvingar bönder att lägga mer på kemikalier och arbetsintensiva inspektioner. Traditionell diagnostik bygger på att utbildade experter går igenom fälten och visuellt undersöker växterna — en process som är långsam, subjektiv och svår att skala upp till stora gårdar. Tidiga eller subtila symtom missas lätt, särskilt vid skiftande ljus, röriga bakgrunder eller när frukter ser lika ut mellan olika sorter.

Att lära datorer se fruktskador

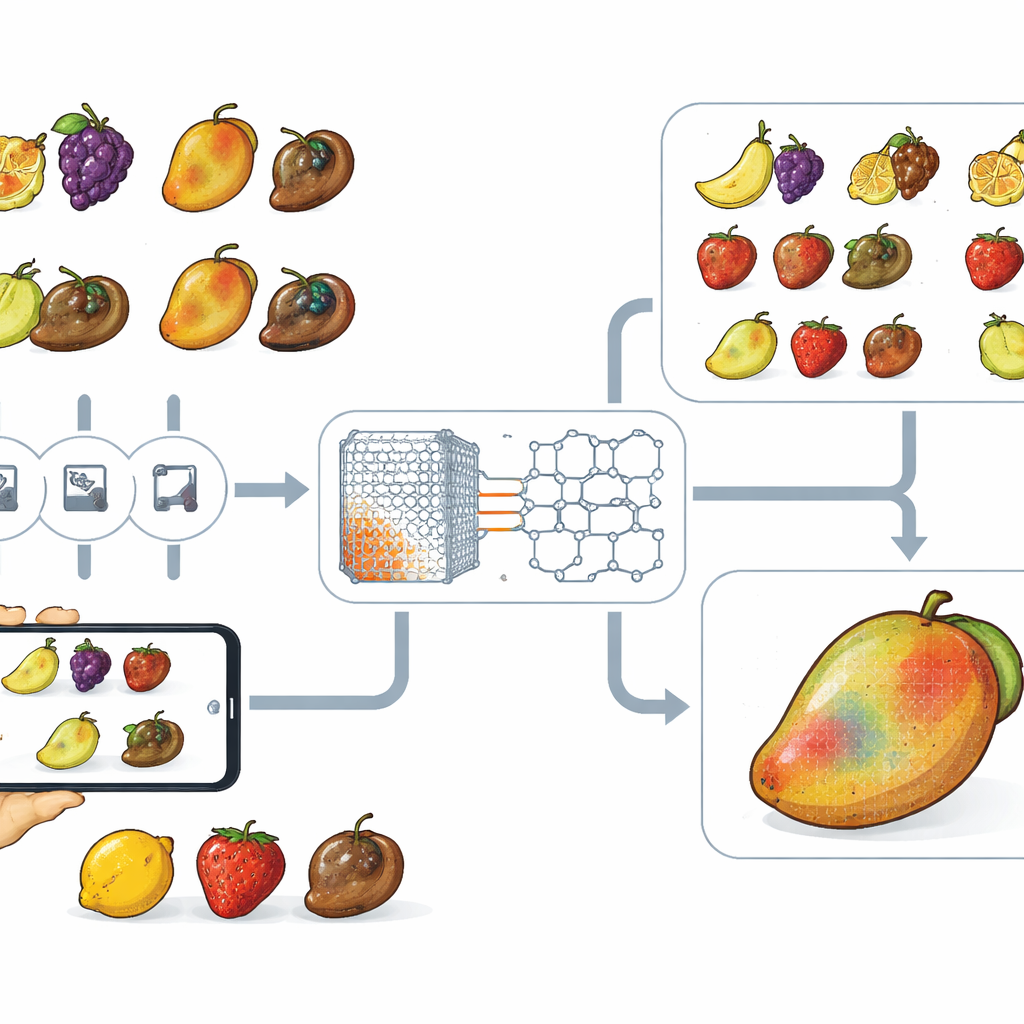

Forskarna vände sig till djupinlärning, en form av artificiell intelligens som lär sig mönster direkt från bilder. De använde en offentlig datamängd med 22 457 foton som visar fem frukttyper, där varje bild var märkt som antingen frisk eller rutten. Bilderna ändrades omsorgsfullt i storlek, färgkorrigerades och förstärktes med rotationer, speglingar och brus för att efterlikna verklig variation och undvika överanpassning till ett snävt villkor. Fyra starka befintliga modeller testades som referenser: två baserade på konvolutionella neurala nätverk (som är bra på att fånga lokala texturer och kanter) och två baserade på transformer-arkitekturer (som fångar långräckta relationer över en bild). Varje modell tränades om på fruktdatamängden och utvärderades för noggrannhet, robusthet under korsvalidering och beräkningskostnad.

En hybridmodell som ser både detaljer och helhet

Byggt på styrkorna och svagheterna hos dessa basmodeller designade författarna en ny hybridmodell kallad CoAT‑AgriLite. Den kombinerar en konvolutionell ”stam” som fokuserar på fina rumsliga detaljer — såsom små lesioner eller ytstruktur — med uppmärksamhetsbaserade block lånade från transformernätverk som fångar hur olika regioner av en frukt förhåller sig till varandra över hela bilden. Istället för att enkelt stapla ett konvolutionellt nätverk och ett transformer-nätverk efter varandra, smälter CoAT‑AgriLite samman deras egenskaper mitt i nätverket, vilket låter lokal och global information interagera direkt. Designen är avsiktligt lättviktig: den använder färre parametrar och färre flyttalsoperationer än typiska transformer-modeller, vilket gör den lämplig för realtidsanvändning på modest hårdvara som mobiltelefoner, drönare eller edge-enheter i packhus.

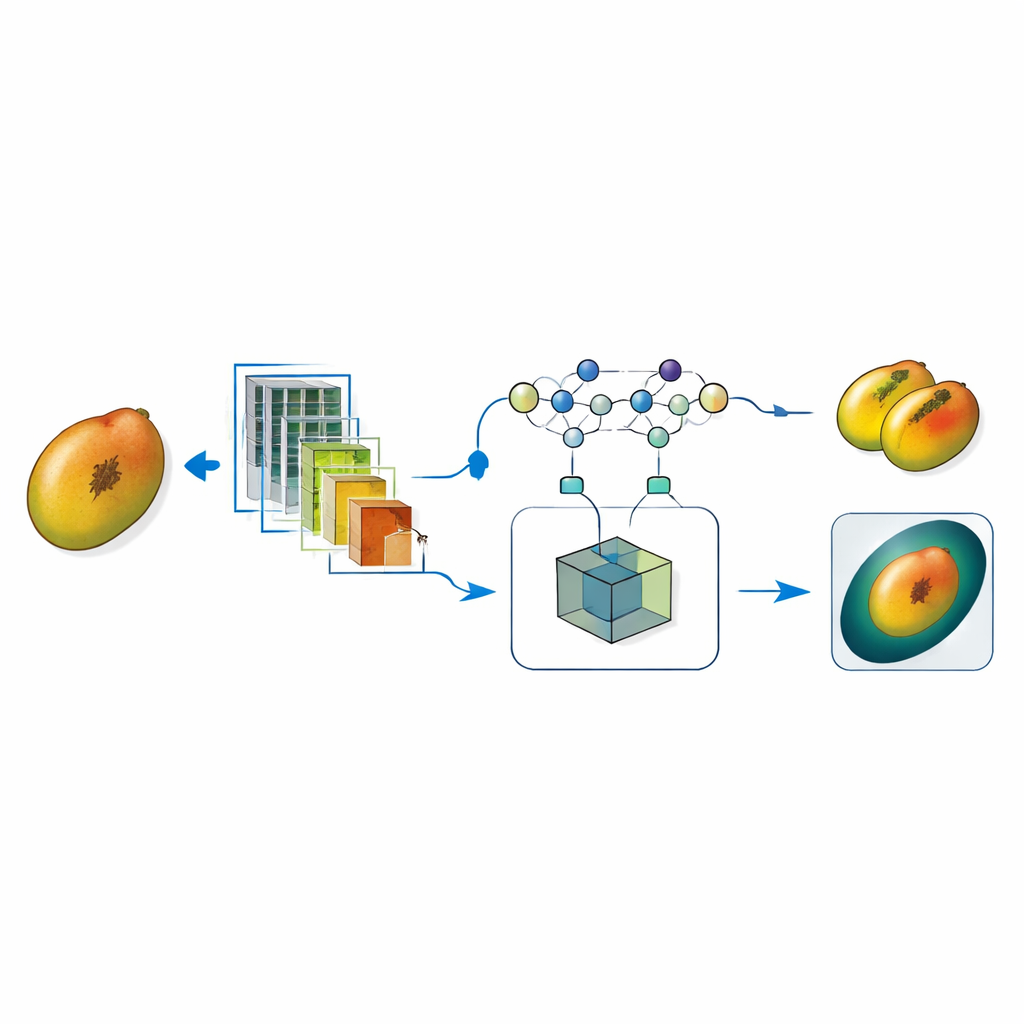

Att se hur AI:n fattar sina beslut

Enbart noggrannhet räcker inte inom jordbruket, där ett felaktigt beslut kan innebära bortkastad frukt eller okontrollerad smittspridning. För att bygga förtroende integrerade teamet ett förklarbarhetsverktyg känt som Grad‑CAM. För varje prediktion producerar Grad‑CAM en värmekarta som lyfter fram områden i fruktbilden som bidrog starkast till modellens beslut. Hos friska frukter sprids uppmärksamheten jämnt eller förblir låg, medan den hos sjuka frukter koncentreras kring mörka fläckar, missfärgade partier eller mjuka områden. Experiment visade att över 90 procent av modellens aktiveringsenergi föll på verkliga lesionsområden snarare än på bakgrundsstörningar, och även dess sällsynta misstag tenderade att involvera bilder med extremt subtil eller delvis dold skada snarare än slumpmässigt brus.

Hur bra det fungerar och varför det spelar roll

Över omfattande tester presterade CoAT‑AgriLite tydligt bättre än alla fyra referensmodeller och en rad tidigare publicerade system. På osedda testbilder uppnådde den 99,37 procent total noggrannhet, med liknande höga precision-, recall- och F1-värden för varje frukttyp, vilket indikerar att den sällan missade sjuka prover och sällan gav falsklarm. Den matchade eller överträffade också mer komplexa, tyngre modeller samtidigt som den krävde mindre beräkning, vilket bekräftar att en omsorgsfull hybriddesign kan vara både kraftfull och effektiv. För icke-specialister är huvudbudskapet att en kompakt, förklarbar AI nu kan titta på vanliga foton av frukt och pålitligt flagga sjukdom, samtidigt som den visuellt motiverar sina val. Sådana system kan stödja bönder, agronomer och leveranskedjeansvariga i att övervaka grödors hälsa, automatisera sorteringslinjer och minska avfall — vilket hjälper till att leverera friskare frukt från fruktlund till bord med större transparens och lägre kostnad.

Citering: Kothandaraman, R., Srinivasan, S., Mathivanan, S. et al. A hybrid convolution and attention-based framework with visual explanation for fruit disease identification. Sci Rep 16, 12771 (2026). https://doi.org/10.1038/s41598-026-42135-5

Nyckelord: upptäckt av fruktsjukdomar, förklarbar AI, djupinlärning, datorseende, precisionsjordbruk